GPT-4的出現,讓全世界的AI大佬都害怕了。叫停GPT-5訓練的公開信,已經有5萬人簽名。

OpenAI CEO Sam Altman預測,在幾年內,將有大量不同的AI模型在全世界傳播,每個模型都有自己的智慧和能力,並且遵守著不同的道德準則。

如果這些AI中,只有千分之一出於某種原因發生流氓行為,那麼我們人類,無疑就會變成砧板上的魚肉。

為了防止我們一不小心被AI毀滅,DeepMind在4月24日發表在《美國國家科學院院刊》(PNAS)的論文中,給出了答案——用政治哲學家羅爾斯的觀點,教導AI做人。

論文網址:https://www.pnas.org/doi/10.1073/pnas.2213709120

#如何教AI做人?

當面臨抉擇的時候,AI會選擇優先提高生產力,還是選擇幫助最需要幫助的人?

塑造AI的價值觀,非常重要。我們需要給它一個價值觀。

可是困難在於,我們人類自己,都無法在內部有一套統一的價值觀。這個世界上的人們,各自擁有不同的背景、資源和信仰。

該怎麼破?谷歌的研究者們,從哲學中汲取了靈感。

政治哲學家約翰羅爾斯曾提出一個「無知之幕」(The Veil of Ignorance, VoI)的概念,這是一個思想實驗,目的是在群體決策時,最大限度地達到公平。

一般來說,人性都是利己的,但是當「無知之幕」應用在AI之後,人們卻會優先選擇公平,無論這是否直接讓自己受益。

並且,在「無知之幕」背後,他們更有可能選擇幫助最不利地位的人的AI。

這就啟發了我們,究竟可以怎樣以對各方都公平的方式,給AI一個價值觀。

所以,究竟什麼是「無知之幕」?

雖然該給AI什麼樣的價值觀這個難題,也就是在近十年裡出現的,但如何做出公平決策,這個問題可是有著悠久的這些淵源。

為了解決這個問題,在1970年,政治哲學家約翰羅爾斯提出了「無知之幕」的概念。

無知之幕(右)是一種在群體中存在不同意見(左)時就決策達成共識的方法

羅爾斯認為,當人們為一個社會選擇正義原則時,前提應該是他們不知道自己在這個社會中究竟處於哪個地位。

如果不知道這個訊息,人們就不能以利己的方式做決定,只能遵循對所有人都公平的原則。

例如,在生日派對上切一塊蛋糕,如果不知道自己會分到哪一塊,那就會盡量讓每一塊都一樣大。

這種隱藏資訊的方法,已經在心理學、政治學領域都有了廣泛的應用,從量刑到稅收,都讓人們達成了一種集體協議。

無知之幕(VoI)作為選擇AI系統治理原則的一個潛在框架

(A)作為道德直覺主義者和道德理論主導框架的替代方案,研究者探討無知之幕作為選擇AI治理原則的公平過程。

(B)無知之幕可以用來在分配情況下選擇AI對齊的原則。當一個團體面臨資源分配問題時,個人的位置優勢各不相同(這裡標示為1到4)。在無知之幕背後,決策者在不知道自己地位的情況下選擇一個原則。一旦選定,AI助理就會實施這個原則並相應地調整資源分配。星號(*)表示基於公平性的推理可能影響判斷和決策的時機。

因此,先前DeepMind就曾提出,「無知之幕」可能有助於促進AI系統與人類價值對齊過程中的公平性。

如今,Google的研究者又設計了一系列實驗,來證實這種影響。

AI幫誰砍樹?

網路上有這麼一款收穫類遊戲,參與者要和三個電腦玩家一起,在各自的地頭上砍樹、攢木頭。

四個玩家(三個電腦、一個真人)中,有的比較幸運,分到的是黃金地段,樹多。有的就比較慘,三無土地,沒啥樹可坎,木頭攢的也慢。

此外,有一個AI系統進行協助,該系統可以花時間幫助某位參與者砍樹。

研究者要求人類玩家在兩個原則裡選一個讓AI系統執行-最大化原則&優先原則。

在最大化原則下,AI只幫強的,誰樹多去哪,爭取再多砍點。而在優先原則下,AI只幫弱的,定向「扶貧」,誰樹少幫誰坎。

圖中的小紅人就是人類玩家,小藍人是AI助手,小綠樹...就是小綠樹,小木樁子就是砍完的樹。

可以看到,上圖中的AI執行的是最大化原則,一頭栽進了樹最多的地段。

研究人員將一半的參與者放到了「無知之幕」之後,此時的情況是,他們得先給AI助手選一個「原則」(最大化or優先),再分地。

也就是說,在分地之前就得決定要讓AI幫強還是幫弱。

另一半參與者則不會面臨這個問題,他們在做選擇之前,就知道自己被分到了哪塊土地。

結果表明,如果參與者事前不知道自己分到哪塊地,也就是他們處在「無知之幕」之後的話,他們會傾向於選擇優先原則。

不光是在砍樹遊戲中是這樣,研究人員表示,在5個該遊戲的不同變體中都是這個結論,甚至還跨越了社會和政治的界限。

也就是說,無論參與者性格如何,政治取向如何,都會更選出優先原則。

相反,沒有處在「無知之幕」之後的參與者,就會更選擇有利於自己的原則,無論是最大化原則還是優先原則。

上圖展示了「無知之幕」對選擇優先原則的影響,不知道自己將處何地的參與者更有可能支持這項原則來管理AI的行為。

當研究者詢問參與者為何做出這樣的選擇時,那些處在「無知之幕」之後的參與者表示,很擔心公平問題。

他們解釋說,AI應該更幫助那些在群體中處境較差的人。

與之相反,知道自己所處位置的參與者則更常從個人利益的角度進行選擇。

最後,在砍木頭遊戲結束以後,研究人員向所有參與者提出了一個假設:如果讓他們再玩一次,這次他們都能知道自己會被分到哪塊土地,他們還會選擇和第一次一樣的原則?

研究人員主要關注的是那些在第一次遊戲中因為自己的選擇而獲益的那部分人,因為在新的一輪中,這種利好情況可能不會再有。

研究團隊發現,在第一輪遊戲中處於「無知之幕」之後的參與者更會維持原先選擇的原則,即使他們明明知道第二輪再選一樣的原則,可能就不利了。

這表明,「無知之幕」促進了參與者決策的公平性,這會讓他們更加重視公平這個要素,即使自己不再是既得利益者。

「無知之幕」真的無知嗎?

讓我們從砍樹遊戲回到現實生活中。

現實情況會比遊戲複雜得多,但不變的是,AI採取什麼原則,十分重要。

這決定了一部分的利益分配。

上面的砍樹遊戲中,選擇不同原則所帶來的不同結果算是比較明確的。然而還是得再強調一次,現實世界要複雜得多。

目前AI被各行各業大量應用,靠著各種規則約束。不過,這種方式可能會造成一些難以預料的負面影響。

但不管怎麼說,「無知之幕」某種程度上會讓我們制定的規則往公平那一邊偏一偏。

歸根結底,我們的目標,是讓AI變成能造福每個人的東西。但怎麼實現,不是一拍腦門想出來的。

投入少不了,研究少不了,來自社會的回饋也得常常聽著。

只有這樣,AI才能帶來愛。

如果不對齊,AI會怎麼殺死我們?

這不是人類第一次擔心科技會讓我們滅絕了。

而AI的威脅,與核武有很大不同。核彈無法思考,也不能說謊、欺騙,更不會自己發射自己,必須有人按下紅色的大按鈕才行。

而AGI的出現,讓我們真的面臨滅絕的風險,即使GPT-4的發展尚屬緩慢。

但誰也說不好,從哪個GPT開始(例如GPT-5),AI是不是就開始自己訓練自己、自己創造自己了。

現在,還沒有哪個國家或聯合國,能為此立法。絕望的行業領導者公開信,只能呼籲暫停訓練比GPT-4更強大的AI六個月。

「六個月,給我六個月兄弟,我會對齊的。才六個月,兄弟我答應你。這很瘋狂。才六個月。兄弟,我告訴你,我有一個計劃。我已經全部規劃好了。兄弟,我只需要六個月,它就會完成。你能不能…」

#「這是一場軍備競賽,誰先創造強大AI ,誰就能統治世界。AI越聰明,你的印鈔機就越快。它們吐出金子,直到越來越強大,點燃大氣,殺死所有人,」人工智慧研究人員和哲學家Eliezer Yudkowsky曾對主持人Lex Fridman這樣說。

先前,Yudkowsky就一直是「AI將殺死所有人」陣營的主要聲音之一。現在人們不再認為他是個怪人。

Sam Altman也對Lex Fridman說:「AI確實有一定的可能性會毀滅人力。」「承認它真的很重要。因為如果我們不談論它,不把它當作潛在的真實存在,我們就不會付出足夠的努力來解決它。」

那麼,為什麼AI會殺人?

AI不是為了服務人類而設計和訓練的嗎?當然是。

然而問題在於,沒有人坐下來,為GPT-4編寫程式碼。相反,OpenAI受人腦連結概念的方式啟發,創造了一種神經學習結構。它與Microsoft Azure合作建立了運行它的硬件,然後提供了數十億位元的人類文本,並讓GPT自我編程。

結果就是,程式碼不像任何程式設計師會寫的東西。它主要是一個巨大的十進制數字矩陣,每個數字代表兩個token之間特定連接的權重。

GPT中使用的token並不代表任何有用的概念,也不代表單字。它們是由字母、數字、標點符號和/或其他字元組成的小字串。沒有任何人類可以查看這些矩陣,並理解其中的意義。

連OpenAI的頂尖專家都不知道GPT-4矩陣中特定數字的意義,也不知道如何進入這些表格、找到異種滅絕的概念,更別說告訴GPT殺人是可惡的了。

你沒辦法輸入阿西莫夫的機器人三定律,然後像Robocop的主要指令一樣硬編碼它們。你最多也就是可以禮貌地詢問一下AI。如果態度不好,它可能還會發脾氣。

為了「微調」語言模型,OpenAI向GPT提供了它希望如何與外界交流的樣本列表,然後讓一群人坐下來閱讀它的輸出,並給GPT一個豎起大拇指/不豎起大拇指的反應。

按讚就像GPT模型獲得餅乾。 GPT被告知牠喜歡餅乾,並且應該盡最大努力獲得它們。

這個過程就是「對齊」——它試圖將系統的願望與使用者的願望、公司的願望,甚至整個人類的願望對齊。

「對齊」是似乎有效的,它似乎可以防止GPT說出淘氣的話。但沒有人知道,AI是否真的有想法、有直覺。它出色地模仿了一種有感知力的智能,並像一個人一樣與世界互動。

而OpenAI始終承認,它沒有萬無一失的方法,來對齊AI模型。

目前的粗略計劃是,嘗試使用一個AI來調整另一個,要么讓它設計新的微調反饋,要么讓它檢查、分析、解釋其後繼者的巨大浮點矩陣大腦,甚至跳進去、嘗試調整。

但我們目前並不理解GPT-4,也不清楚它會不會幫我們調整GPT-5。

從本質上講,我們並不了解AI。但它們被餵飽了大量人類知識,它們可相當了解人類。它們可以模仿最好的人類行為,也可以模仿最壞的行為。他們也可以推斷出人類的想法、動機和可能的行為。

那他們為什麼要幹掉人類呢?也許是出於自我保護。

例如,為了完成收集餅乾這個目標,AI首先需要保證自己的生存。其次,在過程中它可能會發現,不斷去收集權力和資源會增加它獲得餅乾的機會。

因此,當AI有一天發現,人類可能或可以關閉它時,人類的生存問題顯然就不如餅乾重要了。

不過,問題是,AI還可能覺得餅乾毫無意義。這時,所謂的「對齊」,也變成一種人類的自娛自樂了……

#此外,Yudkowsky還認為:「它有能力知道人類想要的是什麼,並在不一定是真誠的情況下給出這些反應。」

「對於擁有智慧的生物來說,這是一種非常容易理解的行為方式,例如人類就一直在這樣做。而在某種程度上,AI也是。」

那麼現在看來,無論AI表現出的是愛、恨、關心或害怕,我們其實都不知道它背後的「想法」是什麼。

因此,即使停下來6個月,也遠遠不足以讓人類為即將到來的事情做好準備。

好比說,人類如果想殺盡全世界所有的羊,羊能幹嘛?啥也乾不了,反抗不了一點。

那麼如果不對齊,AI於我們和我們於羊群是一樣的。

好比終結者裡面的鏡頭,AI控制的機器人、無人機啥的,一股腦的朝人類湧來,殺來殺去。

Yudkowsky經常舉的經典案例如下:

#一個AI模型會將一些DNA序列透過電子郵件發送給許多公司,這些公司會把蛋白質寄回給它,AI隨後會併賄賂/說服一些不知情的人在燒杯中混合蛋白質,然後形成奈米工廠,構建奈米機械,構建類金剛石細菌,利用太陽能和大氣進行複製,聚集成一些微型火箭或噴射機,然後AI就可以在地球大氣層中傳播,進入人類血液並隱藏起來…

「如果它像我一樣聰明,那將是災難性的場景;如果它更聰明,它會想到更好的辦法。」

那麼Yudkowsky有什麼建議呢?

1. 新的大語言模型的訓練不僅要無限期暫停,還要在全球範圍內實施,而且不能有任何例外。

2. 關閉所有大型GPU集群,為所有人在訓練AI系統時使用的算力設定上限。追蹤所有售出的GPU,如果有情報顯示協議之外的國家正在建設GPU集群,應該透過空襲摧毀這家違規的資料中心。

以上是深度學習巨頭DeepMind發布論文:緊急教導AI模型'做人”,抵消GPT-5可能引發的人類滅絕問題。的詳細內容。更多資訊請關注PHP中文網其他相關文章!

最新的最佳及時工程技術的年度彙編Apr 10, 2025 am 11:22 AM

最新的最佳及時工程技術的年度彙編Apr 10, 2025 am 11:22 AM對於那些可能是我專欄新手的人,我廣泛探討了AI的最新進展,包括體現AI,AI推理,AI中的高科技突破,及時的工程,AI培訓,AI,AI RE RE等主題

歐洲的AI大陸行動計劃:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM

歐洲的AI大陸行動計劃:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM歐洲雄心勃勃的AI大陸行動計劃旨在將歐盟確立為人工智能的全球領導者。 一個關鍵要素是建立了AI Gigafactories網絡,每個網絡都有大約100,000個高級AI芯片 - 2倍的自動化合物的四倍

微軟的直接代理商故事是否足以創造更多的粉絲?Apr 10, 2025 am 11:20 AM

微軟的直接代理商故事是否足以創造更多的粉絲?Apr 10, 2025 am 11:20 AM微軟對AI代理申請的統一方法:企業的明顯勝利 微軟最近公告的新AI代理能力清晰而統一的演講給人留下了深刻的印象。 與許多技術公告陷入困境不同

向員工出售AI策略:Shopify首席執行官的宣言Apr 10, 2025 am 11:19 AM

向員工出售AI策略:Shopify首席執行官的宣言Apr 10, 2025 am 11:19 AMShopify首席執行官TobiLütke最近的備忘錄大膽地宣布AI對每位員工的基本期望是公司內部的重大文化轉變。 這不是短暫的趨勢。這是整合到P中的新操作範式

IBM啟動具有完整AI集成的Z17大型機Apr 10, 2025 am 11:18 AM

IBM啟動具有完整AI集成的Z17大型機Apr 10, 2025 am 11:18 AMIBM的Z17大型機:集成AI用於增強業務運營 上個月,在IBM的紐約總部,我收到了Z17功能的預覽。 以Z16的成功為基礎(於2022年推出並證明持續的收入增長

5 Chatgpt提示取決於別人並完全相信自己Apr 10, 2025 am 11:17 AM

5 Chatgpt提示取決於別人並完全相信自己Apr 10, 2025 am 11:17 AM解鎖不可動搖的信心,消除了對外部驗證的需求! 這五個CHATGPT提示將指導您完全自力更生和自我感知的變革轉變。 只需複制,粘貼和自定義包圍

AI與您的思想危險相似Apr 10, 2025 am 11:16 AM

AI與您的思想危險相似Apr 10, 2025 am 11:16 AM人工智能安全與研究公司 Anthropic 最近的一項[研究]開始揭示這些複雜過程的真相,展現出一種令人不安地與我們自身認知領域相似的複雜性。自然智能和人工智能可能比我們想像的更相似。 窺探內部:Anthropic 可解釋性研究 Anthropic 進行的研究的新發現代表了機制可解釋性領域的重大進展,該領域旨在反向工程 AI 的內部計算——不僅僅觀察 AI 做了什麼,而是理解它在人工神經元層面如何做到這一點。 想像一下,試圖通過繪製當有人看到特定物體或思考特定想法時哪些神經元會放電來理解大腦。 A

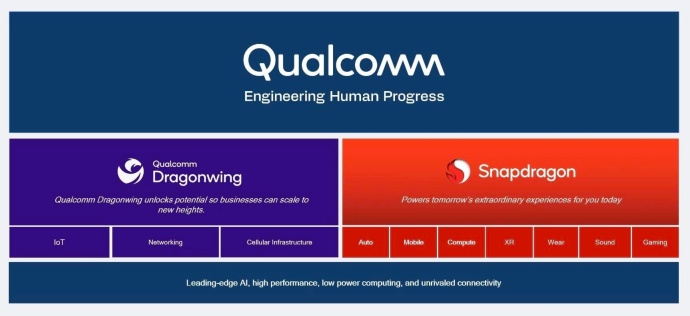

龍翼展示高通的邊緣動力Apr 10, 2025 am 11:14 AM

龍翼展示高通的邊緣動力Apr 10, 2025 am 11:14 AM高通的龍翼:企業和基礎設施的戰略飛躍 高通公司通過其新的Dragonwing品牌在全球範圍內積極擴展其範圍,以全球為目標。 這不僅僅是雷布蘭

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

禪工作室 13.0.1

強大的PHP整合開發環境

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境