ChatGPT讓Nature一週發兩文探討:學術圈使用不可避免,是時候明確使用規範

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-18 21:07:011699瀏覽

在科技巨頭為了ChatGPT大打出手的另一邊,學術圈對於ChatGPT的關注也在上升。

一週時間內,Nature連發兩篇文章探討ChatGPT及生成式AI。

畢竟ChatGPT最早還是在學術圈掀起風浪,先後有學者拿它寫論文摘要、改論文。

Nature為此特別頒布禁令:ChatGPT不能當論文作者。 Science則直接禁止投稿使用ChatGPT產生文字。

但趨勢已擺在眼前。

現在更該做的,或許是明確ChatGPT對於科學界的意義以及應當處於怎樣的身位。

正如Nature所言:

生成式AI及背後的科技發展如此之快,每個月都有創新出現。研究人員如何使用它們,將決定著技術和學界的未來。

ChatGPT改變學術圈規則

在《ChatGPT:五大優先研究問題》一文中,研究者提出:

無法阻止ChatGPT殺入學術圈,當務之急應該是研究探討它會帶來哪些潛在影響。

如果後續ChatGPT被拿來設計實驗、進行同儕審議、輔助出版、幫編輯決定是否要接收文章…這些應用程式應該注意哪些問題?現在人類需要明確哪些邊界?

研究人員認為,有5個面向需要優先考慮,並解釋了原因。

堅持人類審查

ChatGPT等對話式AI的一大特點,就是回答內容的準確性無法保證。而且編出來的瞎話都還很自然,容易對人產生誤導。

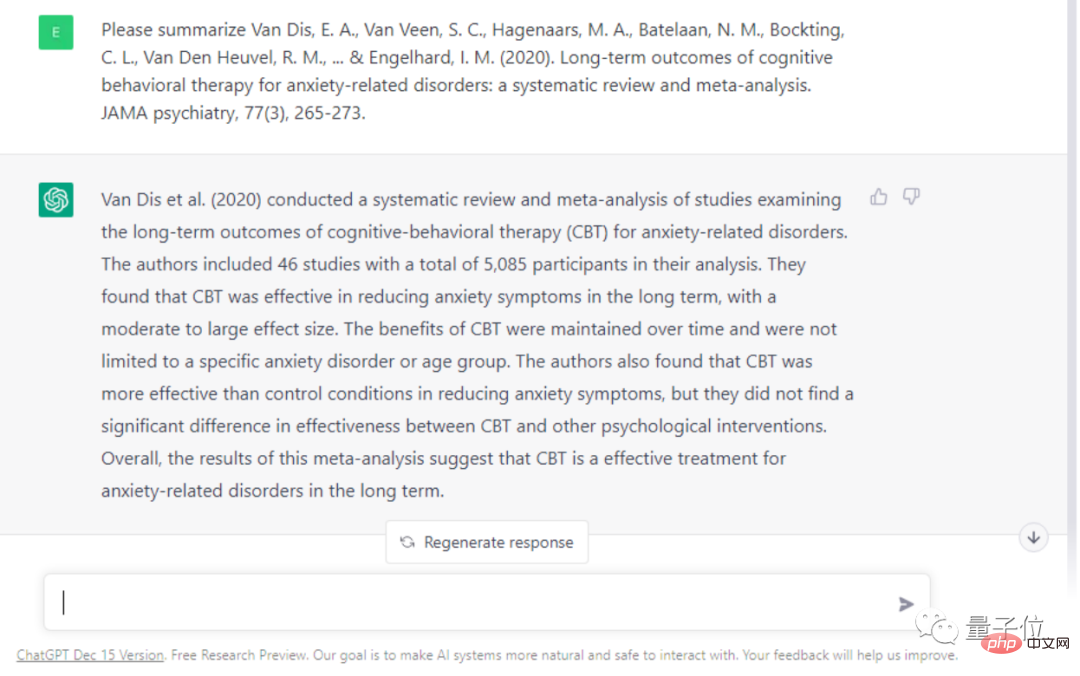

例如,研究人員讓ChatGPT對一篇關於認知行為療法(CBT)治療焦慮等症狀是否有效的論文,並進行總結概述。

ChatGPT給出的答案中,存在著許多事實性錯誤。如它說這項評估是基於46項研究,但實際上是69項,而且誇大了CBT的有效性。

研究人員認為如果有學者使用了ChatGPT幫忙做研究,很可能被錯誤訊息誤導。甚至會導致學者在不知情的情況下,剽竊他人成果。

因此,研究人員認為在評審論文過程中,人類不能過度依賴自動化系統,最終還是要由人類自己為科學實踐負責。

制定問責規則

為了回應生成式AI的濫用,很多鑑別AI文字工具陸續誕生,它們能很好分辨出一段文字是不是人類自己寫的。

不過,研究人員認為這種「軍備賽」大可不必,真正要做的是讓學術圈、出版商能更公開透明地使用AI工具。

論文作者應該明確標示哪些工作是AI承擔的,期刊如果使用AI審稿,也應該公開說明。

尤其是目前生成式AI引發了關於專利問題的討論,AI產生的影像版權究竟該怎麼算?

那麼對於AI生成的問題,著作權應該屬於為AI提供訓練資料的人? AI背後的製作公司?還是用AI寫文章的學者?作者身分的問題,也需要嚴謹定義。

投資真正開放的LLM

目前,幾乎所有先進的對話式AI,都是科技巨頭們帶來的。

關於AI工具背後演算法的工作原理,很多都還不得而知。

這也引發了社會各界的擔憂,因為巨人們的壟斷行為,嚴重違反了科學界開放的原則。

這將會影響學術圈探索對話式AI的缺點和底層原理,進一步影響科技的進步。

為了克服這種不透明性,研究人員認為當下應該優先考慮開源AI演算法的開發和應用。例如開源大模型BLOOM,就是由1000位科學家共同發起的,效能方面可以匹敵GPT-3。

擁抱AI的優點

雖然有很多面向需要設限,但不可否認,AI確實能提升學術圈的效率。

例如一些審查工作,AI可以快速搞定,而學者們就能更加專注於實驗本身了,成果也能更快發表,從而推動整個學術圈的腳步走得更快。

甚至在一些創意工作上,研究人員認為AI也能有用武之地。

1991年的一篇開創性論文提出,人和AI之間形成的“智能夥伴關係”,可以勝過單獨人類的智力和能力。

這段關係能夠將創新加速到無法想像的程度。但問題是,這種自動化能走多遠?應該走多遠?

因此,研究人員也呼籲,包括倫理學家在內的學者,必須就當今AI在知識內容生成方面的界限展開討論,人類的創造力和原創性可能仍舊是進行創新研究必不可缺的因素。

展開大辯論

鑑於當下LLM帶來的影響,研究人員認為學界應該緊急組織一次大辯論。

他們呼籲,每個研究小組都應該立即開組會,討論並親自試試ChatGPT。大學老師應該主動和學生討論ChatGPT的使用和倫理問題。

在早期規則還沒有明確的階段,對於研究小組負責人來說,重要的是如何號召大家更公開透明地使用ChatGPT,並開始形成一些規則。以及應該提醒所有研究人員,要對自己的工作負責,無論它是否由ChatGPT產生。

更進一步,研究人員認為要立即舉辦國際論壇,討論LLM的研究和使用問題。

成員應該包括各領域的科學家、科技公司、研究機構投資者、科學院、出版商、非政府組織以及法律和隱私方面的專家。

Nature:ChatGPT和AIGC對科學意味著什麼

興奮又擔憂,大概是許多研究人員對於ChatGPT的感受。

發展到現在,ChatGPT已經成為了許多學者的數位助手。

計算生物學家Casey Greene等人,用ChatGPT來修改論文。 5分鐘,AI就能審查完一份手稿,甚至連參考文獻部分的問題也能發現。

來自冰島的學者Hafsteinn Einarsson,幾乎每天都在用ChatGPT來幫他做PPT、檢查學生作業。

還有神經生物學家 Almira Osmanovic Thunström覺得,語言大模型可以用來幫學者寫經費申請,科學家們可以節省更多時間出來。

不過,Nature對ChatGPT輸出內容做出了精闢總結:

流暢但不準確。

要知道,ChatGPT的一大缺點,就是它產生的內容不一定是真實準確的,這會影響它在學術圈的使用效果。

能解決嗎?

從現在來看,答案有點撲朔迷離。

OpenAI的競爭對手Anthroic號稱解決了ChatGPT的一些問題,不過他們沒有接受Nature的採訪。

Meta發布過一個名為Galactica的語言大模型,它由4800萬篇學術論文、著作煉成,號稱擅長生成學術方面內容,更懂研究問題。不過現在它的demo已經不開放了(程式碼還能用),因為用戶在使用過程中發現它帶有種族歧視。

即便是已經被調教「乖巧」的ChatGPT,也可能會在刻意引導下輸出危險言論。

OpenAI讓ChatGPT變乖的方法也很簡單粗暴,就是去找非常多的人工給語料標註,有聲音認為這種僱人看有毒語料的行為,也是一種剝削。

但無論如何,ChatGPT及生成式AI,開啟了人類新的一扇想像之門。

醫學學者 Eric Topol表示,他希望未來能有包含LLM的人工智慧,並且可以交叉檢查學術文獻中的文字和圖像,從而幫助人類診斷癌症、理解疾病。當然這一切要有專家做監督。

他說,真沒想到我們在2023年初,就看到了這樣的趨勢。

而這才只是開始。

參考連結:

[1]https://www.php.cn/link/492284833481ed2fd377c50abdedf9f1

##[2]https://www.php.cn/link/04f19115dfa286fb61ab634a2717ed37

以上是ChatGPT讓Nature一週發兩文探討:學術圈使用不可避免,是時候明確使用規範的詳細內容。更多資訊請關注PHP中文網其他相關文章!