自監督為何有效? 243頁普林斯頓博士論文「理解自監督表徵學習」,全面闡述對比學習、語言模型和自我預測三類方法

- PHPz轉載

- 2023-04-15 08:13:021104瀏覽

預訓練已成為一種替代和有效的範式,以克服這些缺點,其中模型首先使用容易獲得的數據進行訓練,然後用於解決感興趣的下游任務,標記數據比監督學習少得多。

使用未標記資料進行預訓練,即自我監督學習,尤其具有革命性,在不同領域取得了成功:文字、視覺、語音等。

這就提出了一個有趣且具有挑戰性的問題:為什麼對未標記資料進行預訓練應該有助於看似不相關的下游任務?

#論文網址:https://dataspace.princeton.edu/ handle/88435/dsp01t435gh21h

#本文提出了一些工作,提出並建立了一個理論框架,以研究為什麼自監督學習對下游任務有益。

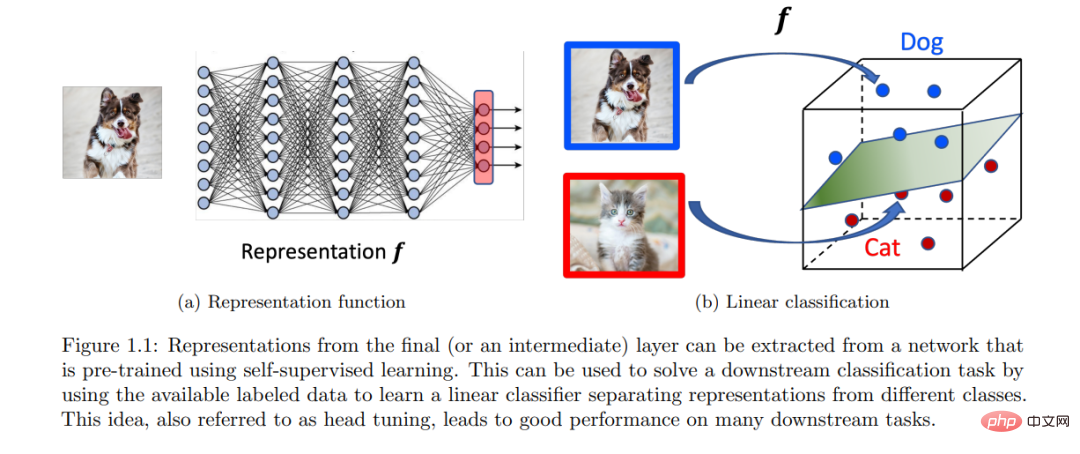

此框架適用於對比學習、自迴歸語言建模和基於自我預測的方法。該框架的核心思想是預訓練有助於學習資料的低維表示,這隨後有助於用線性分類器解決感興趣的下游任務,需要較少的標記資料。

一個常見的主題是形式化用於建立自監督學習任務的無標記資料分佈的理想屬性。在適當的形式化下,可以表明,近似最小化正確的預訓練目標可以提取在無標記資料分佈中隱式編碼的下游訊號。

最後表明,該訊號可以用線性分類器從學習到的表示中解碼,從而為跨任務的「技能和知識」遷移提供了一種形式化。

引言

#在尋求設計智能體和資料驅動的問題解決方案的在此過程中,機器學習和人工智慧領域在過去十年中取得了巨大的進步。 隨著在具有挑戰性的監督學習基準上的初步成功,如ImageNet[Deng等人,2009],深度學習的創新隨後導致模型在不同領域的許多此類基準上具有超人的性能。訓練這種特定任務的模型當然令人印象深刻,並且具有巨大的實用價值。然而,它有一個重要的限制,即需要大量的標記或標註資料集,而這通常是昂貴的。此外,從智慧的角度來看,人們希望有更通用的模型,就像人類一樣[Ahn和Brewer, 1993],可以從先前的經驗中學習,將它們總結為技能或概念,並利用這些技能或概念來解決新任務,很少或沒有演示。畢竟,在沒有明確監督的情況下,嬰兒透過觀察和互動來學習很多東西。這些限制啟發了預訓練的另一個範式。

本文的重點是使用通常大量可用的未標記資料進行預訓練。使用未標記資料的想法一直是機器學習的興趣點,特別是透過無監督學習和半監督學習。 使用深度學習對其進行的現代適應通常稱為自監督學習(SSL),並已經開始透過對比學習和語言建模等思想改變機器學習和人工智慧的格局。自監督學習的想法是僅使用未標記的資料來建立某些任務,並訓練模型在建構的任務上表現良好。這類任務通常需要模型透過從觀察到的或保留的部分預測輸入的未觀察到的或隱藏的部分(或屬性)來編碼資料的結構屬性[LeCun和Misra, 2021]。自監督學習在許多感興趣的下游任務上顯示出了通用性和實用性,通常比從頭解決任務具有更好的樣本效率,從而使我們離通用智能體的目標更近了一步。事實上,最近,像GPT-3 [Brown等人,2020]等大型語言模型已經展示了大規模出現的令人著迷的“突發行為”,引發了人們對自監督預訓練想法的更多興趣。

儘管自監督學習在經驗上取得了成功,並繼續顯示出巨大的前景,但除了粗略的直覺之外,仍然缺乏對其工作原理的良好理論理解。這些令人印象深刻的成功提出了有趣的問題,因為先驗不清楚為什麼在一個任務上訓練的模型應該有助於另一個看似不相關的任務,為什麼在任務a上訓練應該有助於任務b。雖然對SSL(和一般的深度學習)的完整理論理解是具有挑戰性和難以實現的,但在任何抽象層次上理解這種現像都可能有助於開發更有原則的演算法。本文的研究動機是:

為什麼在自監督學習任務上進行訓練(使用大量未標記資料)有助於解決資料稀缺的下游任務?如何將「知識和技能」的遷移正式化?

雖然有大量關於監督學習的文獻,但來自SSL任務→下游任務的泛化與監督學習中來自訓練集→測試集的泛化有本質的不同。對於分類下游任務的監督學習,例如,從未知分佈中採樣的在輸入-標籤對的訓練集上訓練的模型,可以直接用於從相同分佈中採樣的未見過的測試集的評估。這個基本的分佈建立了從訓練集到測試集的連結。然而,從SSL任務→下游任務的概念連接就不那麼清晰了,因為SSL任務中使用的未標記資料沒有關於下游標籤的明確訊號。這意味著在SSL任務上預先訓練的模型(例如,從其餘部分預測輸入的一部分)不能直接用於下游任務(例如,從輸入預測類別標籤)。因此,「知識和技能」的遷移需要使用一些標記資料進行額外的訓練步驟,理想情況下比從頭開始監督學習所需的少。對SSL任務→下游任務泛化的任何理論理解都需要解決這些問題:「未標記資料的內在作用是什麼?以及「如何將預訓練模型用於下游任務?」本文針對分類的下游任務,透過對無標籤資料進行分佈假設,並利用表示學習的思想,研究這些問題:

(a)(分佈假設)未標記的資料分佈隱含地包含有關感興趣的下游分類任務的資訊。

(b)(表示學習)在適當的SSL任務上預先訓練的模型可以透過學習到的表示對該訊號進行編碼,這些表示隨後可以用線性分類器解決下游分類任務。

點(a)表明,未標記的某些結構屬性隱式地為我們提供了有關後續下游任務的提示,而自監督學習可以幫助從數據中梳理出這個訊號。點(b)提出了一種簡單且經驗上有效的方法來使用預訓練模型,利用模型的學習表示。本文識別並在數學上量化了未標記資料的分佈屬性,對於不同的SSL方法,如對比學習、語言建模和自我預測,可以證明可以學習到良好的表示。在下一節中,我們將深入研究表示學習的思想,並形式化解釋為什麼自監督學習有助於下游任務。

以上是自監督為何有效? 243頁普林斯頓博士論文「理解自監督表徵學習」,全面闡述對比學習、語言模型和自我預測三類方法的詳細內容。更多資訊請關注PHP中文網其他相關文章!