2022年深度學習在時間序列預測與分類的研究進展綜述

- PHPz轉載

- 2023-04-13 12:25:021121瀏覽

時間序列預測的transformers的衰落和時間序列嵌入方法的興起,還有異常檢測、分類也取得了進步

2022年整個領域在幾個不同的方面取得了進展,本文將試著介紹一些在過去一年左右的時間裡出現的更有前景和關鍵的論文,以及Flow Forecast [FF]預測框架。

時間序列預測

1、Are Transformers Really Effective for Time Series Forecasting?

#https://www.php.cn/link/bf4d73f316737b26f1e860da0ea63ec8

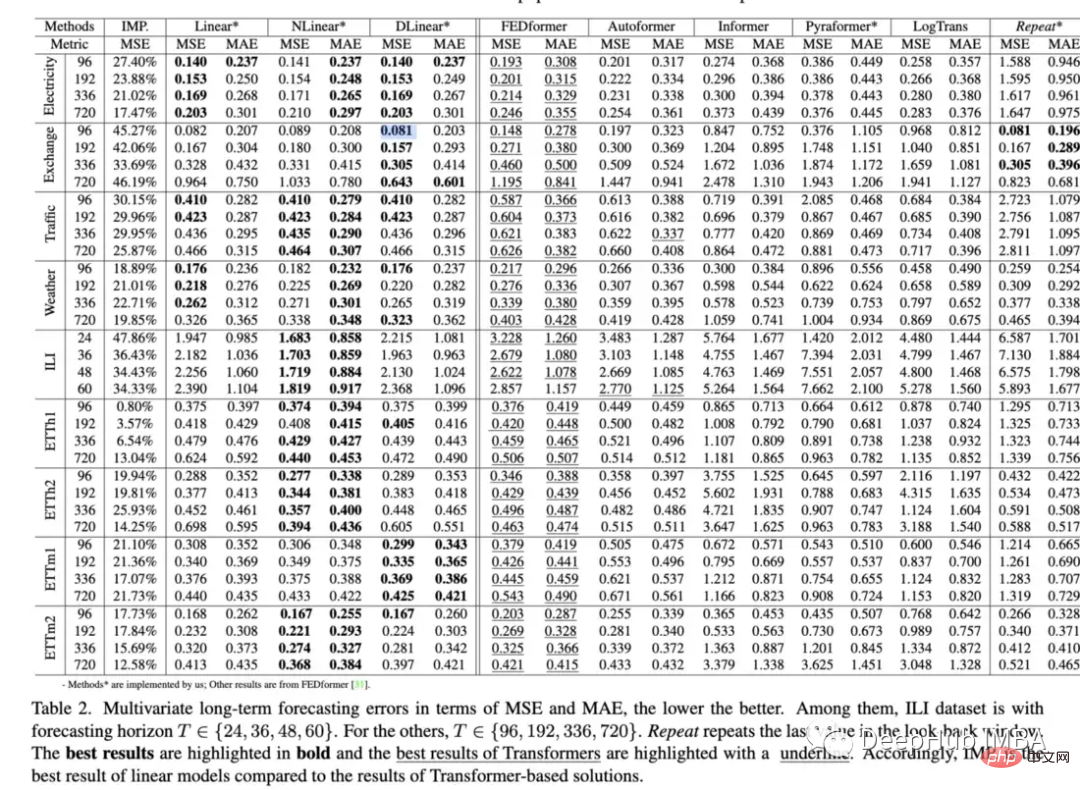

Transformer相關研究對比Autoformer、Pyraformer、Fedformer等,它們的效果與問題

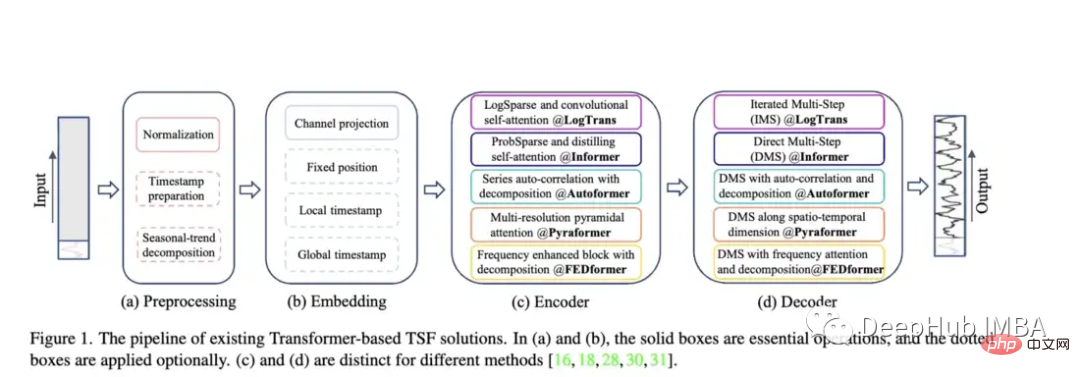

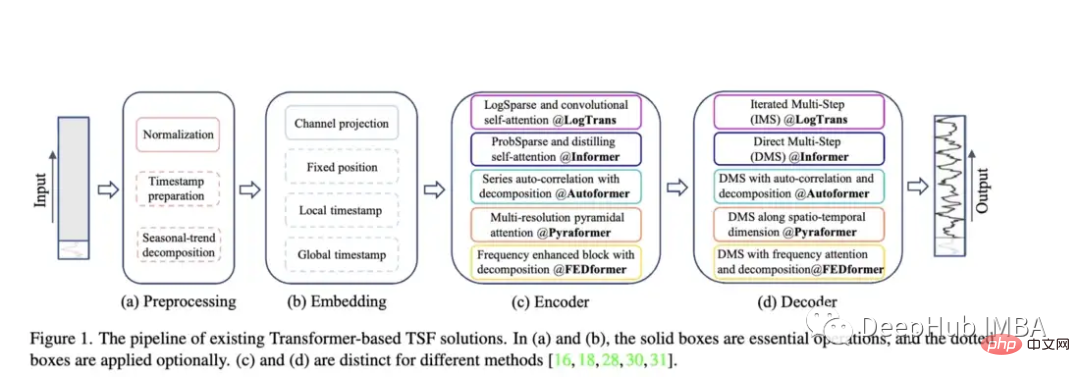

隨著Autoformer (Neurips 2021)、Pyraformer (ICLR 2022)、Fedformer (ICML 2022)、EarthFormer (Neurips 2022) 和Non-Stationary Transformer (Neurips) 等模型的出現,時間序列預測架構的Transformer 系列不斷發展壯大)。但是這些模型準確預測數據並優於現有方法的能力仍然存在疑問,特別是根據新研究(我們將在稍後討論)。

Autoformer :擴充並改進了 Informer 模型的效能。 Autoformer 具有自動關聯機制,使模型能夠比標準注意力更好地學習時間依賴關係。它旨在準確分解時態數據的趨勢和季節成分。

Pyraformer:作者介紹了「金字塔注意模組(PAM),其中尺度間樹結構總結了不同解析度下的特徵,尺度內相鄰連接對不同範圍的時間依賴性進行建模。」

Fedformer:該模型著重於在時間序列資料中捕捉全球趨勢。作者提出了一個季節性趨勢分解模組,旨在捕捉時間序列的全局特徵。

Earthformer: 可能是這些論文中最獨特的一個,它特別專注於預測地球系統,如天氣、氣候和農業等。介紹了一種新的cuboid 注意力架構。這篇論文應該是潛力巨大的望,因為在河流和暴洪預測方面的研究,許多經典的Transformer都失敗了。

Non-Stationary Transformer:這是使用transformer 用於預測的最新論文。作者旨在更好地調整 Transformer 以處理非平穩時間序列。他們採用兩種機制:去平穩注意里和一系列平穩化機制。這些機制可以插入到任何現有的Transformer模型中,作者測試將它們插入 Informer、Autoformer 和傳統的Transformer 中,都可以提高效能(在附錄中,也表明它可以提高 Fedformer 的效能)。

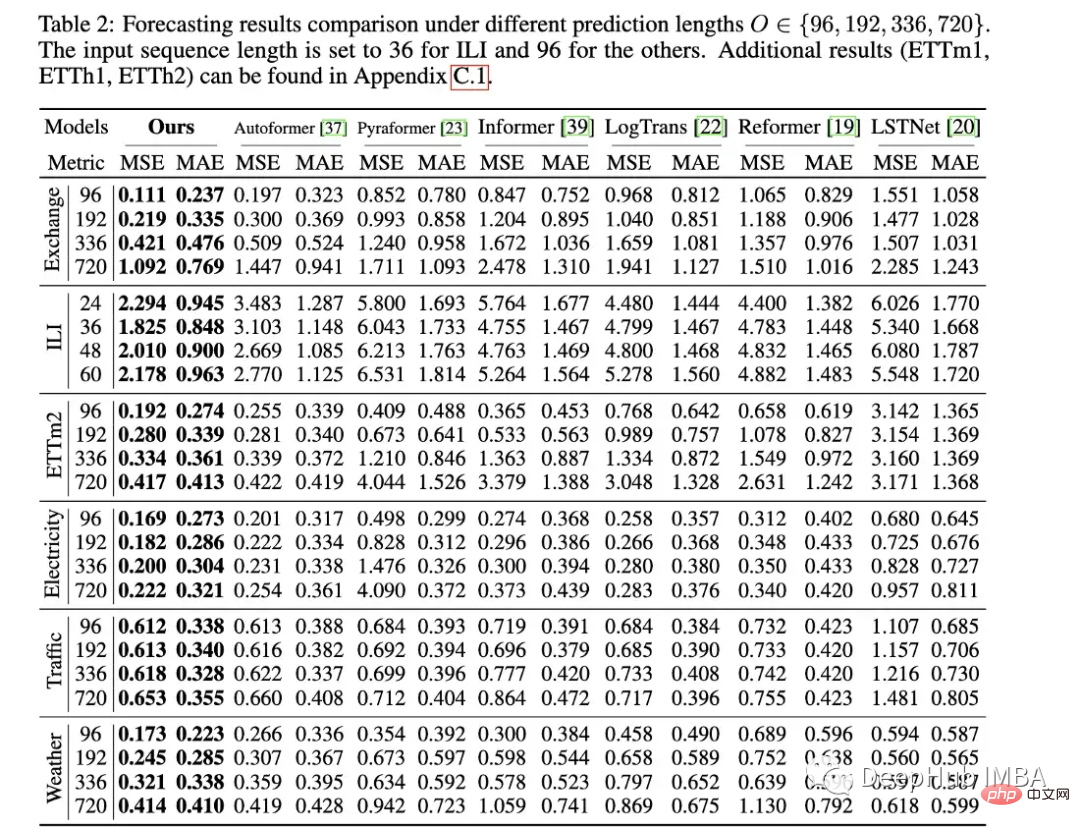

論文的評估方法:與 Informer 類似,所有這些模型(Earthformer 除外)都在電力、交通、金融和天氣資料集上進行了評估。主要根據均方誤差(MSE) 和平均絕對誤差(MAE) 指標進行評估:

這篇論文很好,但是它只對比了Transformer相關的論文,其實應該要與更簡單的方法比較,例如簡單的線性迴歸、LSTM/GRU、甚至是XGB等樹狀模型。另外就是它們應該不僅僅局限在一些標準資料集,因為我在其他時間序列相關資料集上沒有看到很好的表現。比如說informer在準確預測河流流量方面遇到了巨大的問題,與LSTM或甚至是普通的Transformer相比,它的表現通常很差。

另外是由於與電腦視覺不同,影像維度至少保持不變,時間序列資料在長度、週期性、趨勢和季節性方面可能存在巨大差異,因此需要更大範圍的資料集。

在OpenReview的Non-Stationary Transformer的評論中,一位評論者也表達了這些問題,但它在最終的元評論中被否決了:

“由於該模型屬於Transformer領域,而且Transformer之前已經在許多任務中表現出了最先進的水平,我認為沒有必要與其他'家族'方法進行比較。」

這是一個非常有問題的論點,並導致研究在現實世界中缺乏適用性。就像我們所認知的:XGB在表格資料的壓倒性優勢還沒改變,Transformer的閉門造車又有什麼意義?每次超越,每次都被吊打。

作為一個在實踐中重視最先進的方法和創新模型的人,當我花了幾個月的時間試圖讓一個所謂的「好」模型工作時,但最後卻發現,他的表現還不如簡單的線性迴歸,那這幾個月有什麼意思?這個所謂的好」模型又有什麼意義。

所有的transformer 論文都同樣存在有限評估的問題。我們應該從一開始就要求更嚴格的比較和對缺點的明確說明。一個複雜的模型最初可能並不總是優於簡單模型,但需要在論文中明確指出這一點,而不是掩蓋或簡單地假設沒有這種情況。

但是這篇論文還是很好的,例如Earthformer 在MovingMNIST 資料集和N-body MNIST資料集上進行了評估,作者用它來驗證cuboid 注意力的有效性,評估了它的降水量即時預報和厄爾尼諾週期預報。我認為這是一個很好的例子,將物理知識整合到具有註意力的模型架構中,然後設計出好的測試。

2、Are Transformers Effective for Time Series Forecasting (2022)?

#https://www.php.cn/link/bf4d73f316737b26f1e860da0ea63ec8

#這篇論文探討了Transformer 預測資料與基準方法的能力。結果結果。在某種程度上再次證實了Transformers 的性能通常比更簡單的模型差,而且難以調整。這篇論文中的幾個有趣的觀點:

- 用基本的線性層替換自注意力並發現:「Informer 的表現隨著逐漸簡化而增長,表明至少對於現有的LTSF 基準來說,自註意力方案和其他複雜模組是不必要的」

- 調查了增加回溯視窗( look-back window )是否會提高Transformer 的效能並發現:「SOTA Transformers 的效能略有下降,表明這些模型僅從相鄰的時間序列序列中捕獲相似的時間資訊。 」

- 探討了位置嵌入是否真的能很好地捕捉時間序列的時間順序。透過將輸入序列隨機混洗到Transformer中來做到這一點。他們在幾個資料集上發現這種改組並沒有影響結果(這個編碼很麻煩)。

在過去的幾年裡,Transformer模型的無數次時間序列實驗在絕大多數情況下結果都不太理想。在在很長一段時間裡,我們都認為一定是做錯了什麼,或者遺漏了一些小的實現細節。所有這些都被認為是下一個SOTA模型的思路。但是這個論文卻有一致的思路就是?如果一個簡單的模型勝過Transformer,我們應該繼續使用它們嗎?是所有的Transformer都有固有的缺陷,還是只是當前的機制?我們是否應該回到lstm、gru或簡單的前饋模型這樣的架構?這些問題我都不知道答案,但是這篇論文的整體影響還有待觀察。到目前為止,我認為答案可能是退一步,專注於學習有效的時間序列表示。畢竟最初BERT在NLP環境中成功地形成了良好的表示。

也就是說,我不認為我們應該把時間序列的Transformer視為完全死亡。Fedformer的表現非常接近簡單模型,並且在各種消融打亂任務中表現更好。雖然的基準在許多情況下都難以進行預測,但他們對數據的內部表示卻相當不錯。我認為還需要進一步了解內部表示和實際預測輸出之間的脫節。另外就是正如作者所建議的那樣,改進位置嵌入可以在提高整體性能方面發揮關鍵作用。最後有一個Transformer的模型,在各種異常檢測資料集上表現非常好,下面就會介紹。

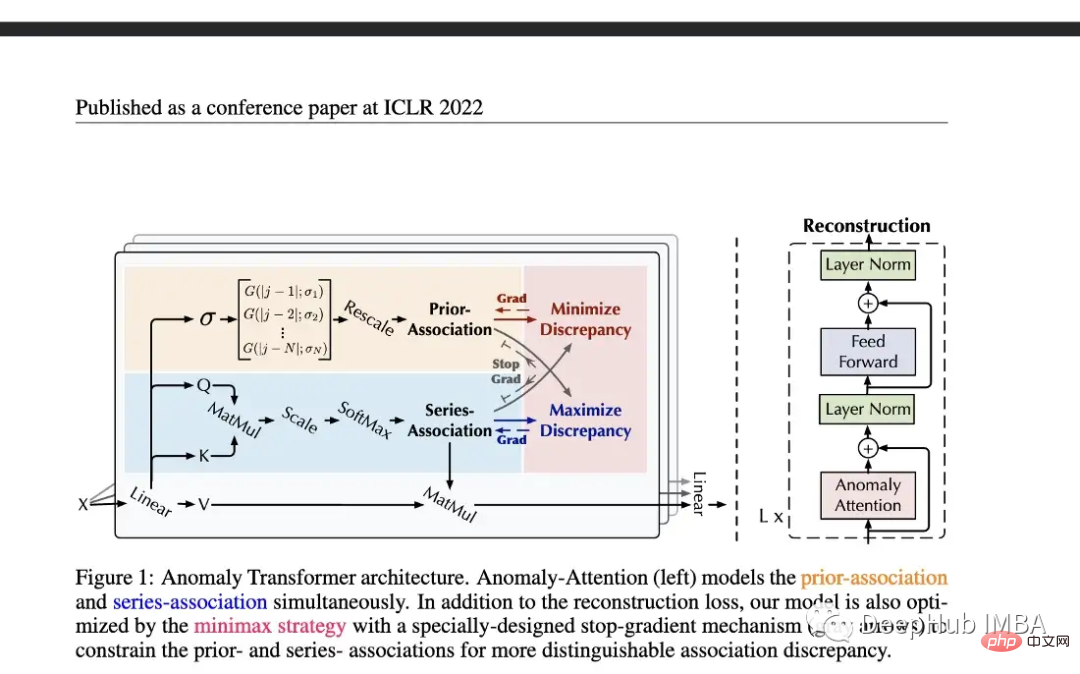

3、Anomaly Transformer (ICLR Spolight 2022)

#https://www.php.cn/link/ab22e28b58c1e3de6bcef48d3f5d8b4a

#相當多的研究都集中在將transformers 應用於預測,但異常異常檢測的研究相對較少。這篇介紹了一種(無監督)Transformer 來檢測異常。該模型結合使用特別構建的異常注意機制和minmax 策略。

本文在五個真實世界的資料集上評估了模型的效能,包括Server Machine Dataset, Pooled Server Metrics, Soil Moisture Active Passive和NeurIPS-TS(它本身由五個不同的資料集組成)。雖然有人可能會對這個模型持懷疑態度,特別是關於第二篇論文的觀點,但這個評估是相當嚴格的。 Neurips-TS是一個最近創建的,專門用於提供更嚴格的異常檢測模型評估的資料集。與更簡單的異常檢測模型相比,該模型似乎確實提高了效能。

作者提出了一種獨特的無監督Transformer,它在過多的異常檢測資料集上表現良好。這是過去幾年時間序列Transformer領域最有前景的論文之一。因為預測比分類甚至異常檢測更具挑戰性,因為你試圖預測未來多個時間步驟的巨大可能值範圍。這麼多的研究都集中在預測上,而忽略了分類或異常檢測,對於Transformer我們是不是應該從簡單的開始呢?

4、WaveBound: Dynamic Error Bounds for Stable Time Series Forecasting (Neurips 2022):

#https://www.php.cn/link/ae95296e27d7f695f891cd26b#f370078

#論文介紹了一種新的正則化形式,可以改進深度時間序列預測模型(特別是上述transformers )的訓練。 作者透過將其插入現有的 transformer LSTNet模型來評估。他們發現它在大多數情況下顯著提高了性能。儘管他們只測試了Autoformer 模型,而沒有測試 Fedformer 這樣的更新模型。 新形式的正則化或損失函數總是有用的,因為它們通常可以插入任何現有的時間序列模型中。如果你 Fedformer 非平穩機制 Wavebound 結合起來,你可能會在效能上擊敗簡單的線性迴歸 :)。 時間序列表示雖然Transformer 再預測方向上的效果並不好,但在創建有用的時間序列表示方面Transformer還是取得了許多進展。我認為這是時間序列深度學習領域中一個令人印象深刻的新領域,應該進行更深入的探索。 5、TS2Vec: Towards Universal Representation of Time Series (AAAI 2022)https://www.php.cn/link/7690dd4db7a92524c684e3191919/7690dd4db7a92524c684e3191919196b1 ##TS2Vec是一個學習時間序列表示/嵌入的通用框架。這篇論文本身已經有些過時了,但它確實開始了時間序列表示學習論文的趨勢。

對使用表示進行預測和異常檢測進行評估,該模型優於許多模型,例如 Informer 和 Log Transformer。

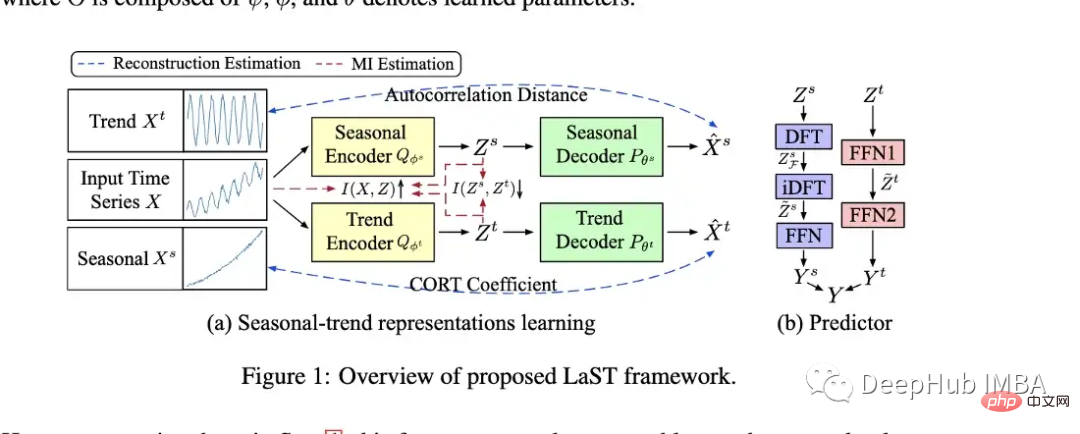

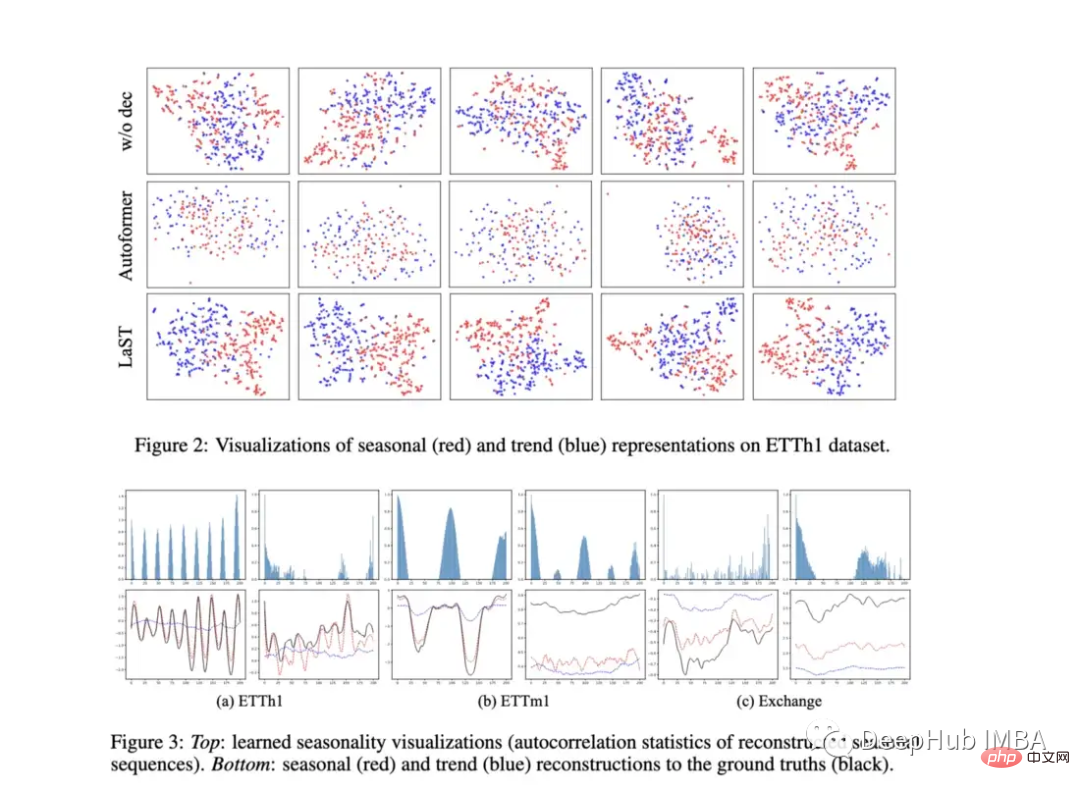

6、Learning Latent Seasonal-Trend Representations for Time Series Forecasting(Neurips 2022)

#https://www.php.cn/link/0c5534f554a26f7aeb7c780e12bb155534f554a26f7aeb7c780e12bb155作者創建了一個模型(LAST),使用變異推理創建季節性和趨勢的分離表示。

儘管我仍然對那些只評估標準預測任務的模型持懷疑態度,但這個模型的確很亮眼,因為它關注的是表徵而不是預測任務本身。如果我們看論文中展示的一些圖表,可以看到模型似乎確實學會了區分季節性和趨勢。不同資料集的視覺化表示也嵌入到相同的空間中,如果它們顯示出實質的差異,那將是很有趣的。

#https://www.php.cn/link/791d3a0048b1

https://www.php.cn/link/791d3a0048b9c2000這是2022年早些時候在ICLR上發表的一篇論文,在學習季節和趨勢表示方面與LaST非常相似。由於LaST在很大程度上已經取代了它的性能,這裡就不做過多的描述了。但連結在上面供那些想要閱讀的人閱讀。

其他有趣的論文

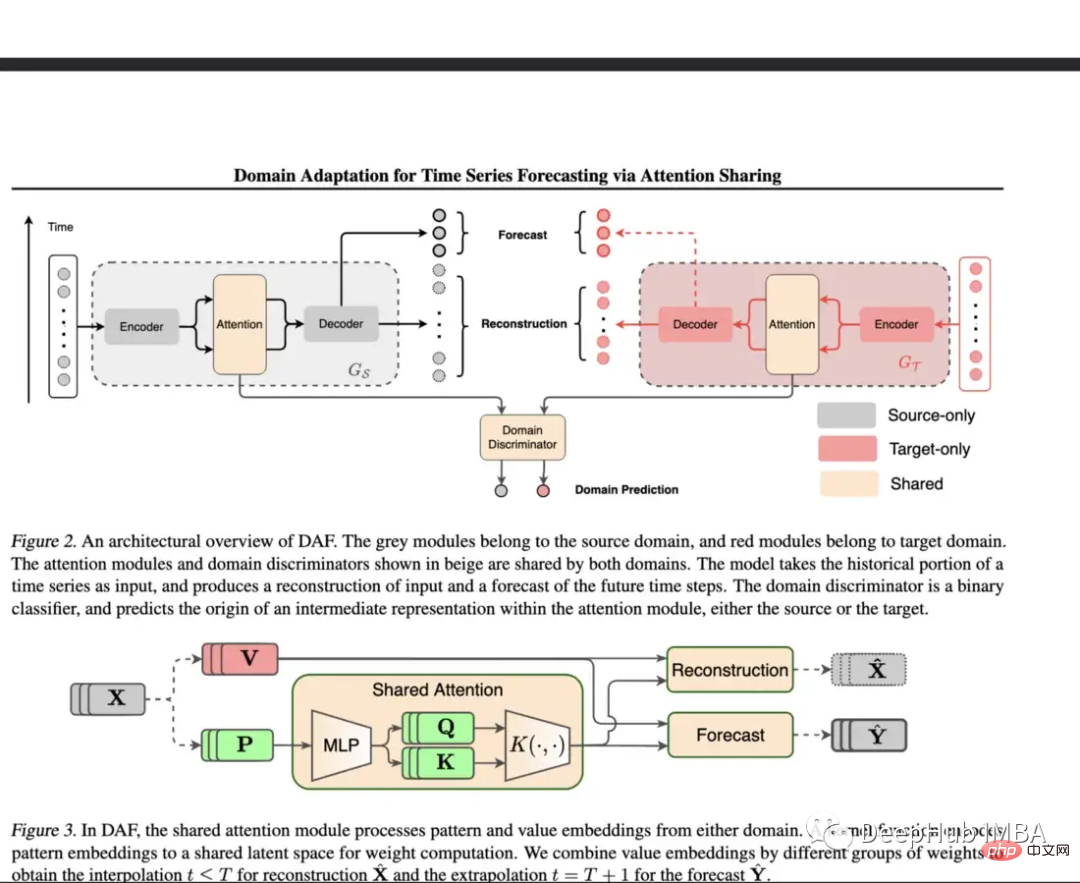

8、Domain Adaptation for Time Series Forecasting via Attention Sharing(ICML 2022)

https://www.php.cn/link /d4ea5dacfff2d8a35c0952291779290d

當缺乏訓練資料時,預測對DNN 來說是一項挑戰。這篇論文對具有豐富資料的領域使用共享注意力層,然後對目標領域使用單獨的模組。

它所提出的模型使用合成資料集和真實資料集進行評估。在合成環境中,測試了冷啟動學習和少樣本學習,發現他們的模型優於一般 Transformer 和 DeepAR。對於真實資料集採用了 Kaggle 零售資料集,該模型在這些實驗中大大優於基準。

冷啟動、少樣本和有限學習是極其重要的主題,但很少有論文涉及時間序列。該模型為解決其中一些問題提供了重要的一步。也就是說他們可以在更多不同的有限現實世界資料集上進行評估,並與更多基準模型進行比較, 微調或正則化的好處在於可以對任何架構進行調整。

9、When to Intervene: Learning Optimal Intervention Policies for Critical Events (Neurips 2022)

https://www.php.cn/link/f38fef4c0e4988792723c29a0bd3cad

#雖然這不是一篇「典型的」時間序列論文,但我選擇將其列入這個列表,因為本文的重點是在機器發生故障之前找到進行幹預的最佳時間。這被稱為OTI或最佳時間幹預評估OTI的問題之一是潛在生存分析的準確性(如果不正確,評估也會不正確)。作者根據兩個靜態閾值評估了他們的模型,發現它表現得很好,並且繪製了不同政策的預期表現和命中與失敗的比率。 這是一個有趣的問題,作者提出了一個新穎的解決方案,Openreview的一位評論者指出:「如果有一個圖表顯示失敗機率和預期幹預時間之間的權衡,那麼實驗可能會更有說服力,這樣人們就可以直觀地看到這個權衡曲線的形狀。」最近的資料集/基準最後就是資料集的測試的基準Monash Time Series Forecasting Archive (Neurips 2021):該檔案旨在形成不同時間序列資料集的“主列表”,並提供更權威的基準。該儲存庫包含 20 多個不同的資料集,涵蓋多個行業,包括健康、零售、共乘、人口統計等等。

#https://www.php.cn/link/5d7009220a974e94404889274d3a9553Microsoft

Subseasonal Forecasting Microsoft (2021):這是#MicrosoftSubseasonal Forecasting Microsoft (2021):這是#Microsoft 公開發布的資料集,旨在促進使用機器學習來改善次季節預測(例如未來兩到六週)。次季節預報有助於政府機構更好地為天氣事件和農民的決定做準備。微軟為此任務包含了幾個基準模型,與其他方法相比,一般來說深度學習模型的表現相當差。最好的 DL 模型是一個簡單的前饋模型,而 Informer 的表現非常糟糕。#https://www.php.cn/link/c3cbd51329ff1a0169174e9a78126ee1

#Revisiting Time Series Outlier Detection:本文評述了許多現有的異常/異常值檢測資料集,並提出了35個新的合成資料集和4個真實世界資料集用於基準測試。#https://www.php.cn/link/03793ef7d06ffd63d34ade9d091f1ced

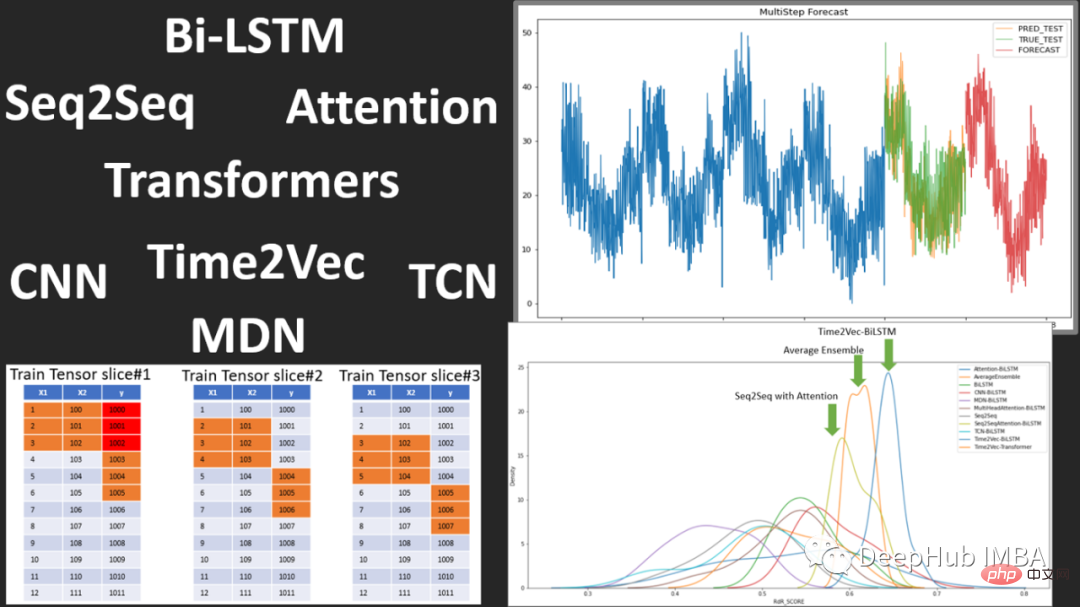

#開源的時序預測框架FF Flow Forecast是是一個開源的時序預測框架,它包含了以下模型:Vanilla LSTM (LSTM)、SimpleTransformer、Multi-Head Attention、Transformer with a linear decoder、DARNN、Transformer XL、Informer、DeepAR、DSANet 、SimpleLinearModel等等這是一個學習使用深度學習進行時間預測的很好的模型程式碼來源,有興趣的可以看看。#https://www.php.cn/link/fea33a31df7d05a276193d32621ecbe4

#總結#在過去的兩年裡,我們已經看到了Transformer在時間序列預測中的興起和可能的衰落和時間序列嵌入方法的興起,以及異常檢測和分類方面的額外突破。 ###但是對於深度學習的時間序列來說:可解釋性、視覺化和基準測試方法還是有所欠缺,因為模型在哪裡執行,在哪裡出現效能故障是非常重要的。此外,更多形式的正規化、預處理和遷移學習來提高效能可能會在未來中出現。

也許Transformer對時間序列預測有好處(也許不是),就像VIT那樣如果沒有Patch的出現Transformer可能還會被認為不行,我們也會繼續關注Transformer在時間序列的發展或替代。

以上是2022年深度學習在時間序列預測與分類的研究進展綜述的詳細內容。更多資訊請關注PHP中文網其他相關文章!