老黃手捧ChatGPT專用「核彈」炸場,英偉達H100至尊版速度提10倍!

- 王林轉載

- 2023-04-13 10:10:021352瀏覽

英偉達,贏麻了!

剛結束的GTC大會上,靠著滿屏的「生成式AI」,手握一塊支撐ChatGPT算力、提速10倍的H100 NVLINK晶片,老黃就差把這幾個字寫在臉上──「我是贏家」。

ChatGPT,Microsoft 365, Azure,Stable Diffusion,DALL-E,Midjourney…所有這些時下最紅最爆的AI產品,英偉達全都能從中分得一杯羹。

今年初ChatGPT在全球的爆火,讓英偉達股價飆升,市值直接增加700多億美元。目前,英偉達市值為6,400億美元。

而如今,AI的iPhone時刻已經到來,第四次科技革命就要開啟,而手握A100和H100的英偉達,或成最大贏家。

在GTC大會上,老黃宣布了英偉達在GPU、加速庫、運算光刻、雲端平台上的亮眼進步,更是放出豪言——英偉達就是要做AI圈的台積電!

現在已經有人猜測,今天的演講都是在H100上用AIGC模型產生的。

ChatGPT專用GPU已來

這次大會上最重磅的發布,就是針對ChatGPT打造的NVIDIA H100 NVLINK。

因為算力需求龐大,針對ChatGPT等LLM的推理,英偉達推出了新款Hopper GPU,配備雙GPU NVLINK的PCIE H100,具有94B記憶體。

實際上,深度學習的歷史從2012年以後,就一直與英偉達息息相關。

老黃表示,2012年深度學習元老Hinton和學生Alex Kerchevsky、Ilya Suskever在訓練AlexNet時,用的正是GeForce GTX 580。

隨後,AlexNet一舉奪得ImageNet影像分類競賽冠軍,成為了深度學習大爆炸的奇點。

而時隔10年,在OpenAI的Ilya Suskever也是用著英偉達的DGX,訓練出了ChatGPT背後的GPT3,及GPT3.5。

老黃自豪地說,目前在雲端上唯一可以實際處理ChatGPT的GPU,就是HGX A100。

但與A100相比,一台搭載四對H100和雙GPU NVLINK的伺服器速度還要快上10倍!因為H100可以將LLM的處理成本降低一個數量級。

隨著生成式AI掀起一波機會浪潮,AI正處於轉折點,使得推理工作負載呈現階梯函數式成長。

在以前,設計一個雲端資料中心來處理生成式AI,是個巨大的挑戰。

一方面,理想情況下最好使用一種加速器,使資料中心有彈性;但另一方面,沒有一個加速器能以最優的方式處理在演算法、模型、資料類型和大小方面的多樣性。英偉達的One Architecture平台就兼具加速功能與彈性。

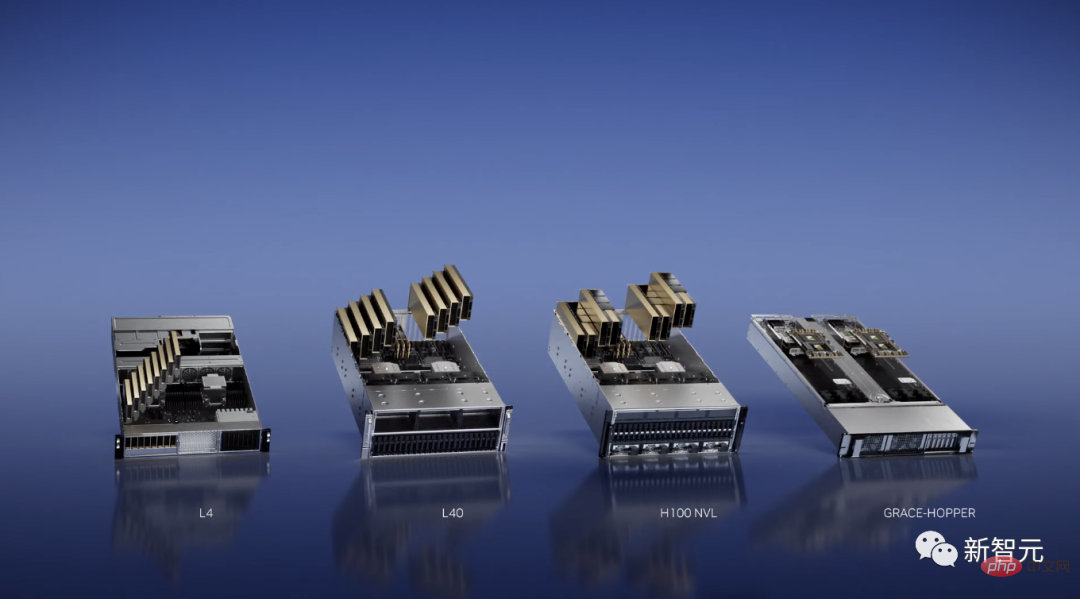

而今天,英偉達宣布,推出全新的推理平台。每種配置都對某類工作負載進行了最佳化。

例如針對AI視訊工作負載,英偉達就推出了L4,在視訊解碼和轉碼、視訊內容審核、視訊通話功能上做了最佳化。

而一台8-GPU L4伺服器,將取代一百多台用於處理AI視訊的雙插槽CPU伺服器。

同時,英偉達也針對Omniverse、圖形渲染以及文字轉影像/影片等生成式AI推出了L40。其效能是英偉達最受歡迎的雲端推理GPU T4的10倍。

目前,Runway推出的Gen-1,以及Gen-2生成式AI模型擁有的強大能力便是藉助了英偉達的GPU。

另外,英偉達也推出了全新的超級晶片Grace-Hopper,適用於推薦系統和向量資料庫。

挑戰晶片極限破,計算光刻提速40倍

在晶片領域,英偉達聯合台積電、ASML和Synopsys,歷時4年終於完成了計算光刻技術的一項重大突破-NVIDIA cuLitho計算光刻庫。

在到達2nm製程的極限後,光刻就是突破點。

計算光刻模擬了光通過光學元件後與光阻相互作用時的行為,透過應用逆物理演算法,我們可以預測掩膜板上的圖案,以便在晶圓上生成最終圖案。

在晶片設計和製造領域中,運算光刻是最大的運算工作負載,每年都要消耗數百億CPU小時。相較之下,英偉達創造的這個新演算法,可以讓日益複雜的運算光刻工作流程能夠在GPU上並行執行。

總結來說,cuLitho不僅能讓運算速度提升40倍,而且功耗也可以降低9倍之多。

舉個例子,英偉達的H100需要89塊遮罩板。

如果用CPU處理的話,每個遮罩板都需要消耗兩週的時間。而如果在GPU上運行cuLitho,則只需8個小時即可處理完一個遮罩板。

而台積電也可以用500個DGX H100系統中的4,000個Hopper GPU,完成之前需要多達40,000台基於CPU的伺服器才能搞定的工作,並且功率也會從35MW降至5MW。

值得注意的是,cuLitho加速程式庫與Ampere和Volta架構的GPU也是相容的,不過Hopper是最快的解決方案。

老黃表示,由於光刻技術已經處於物理學的極限,晶圓廠能夠提高產量,為2nm及以後的發展做好準備。

AI的iPhone時刻

這幾個月,ChatGPT以摧枯拉朽之勢,眼看就要掀起第四次科技革命。 「我們正處於AI的iPhone時刻」這個說法,也隨之廣泛流傳開。

在GTC大會上,老黃也是激動地把這句話重複了三次。

iPhone時刻來臨,新創公司如OpenAI在競相建構顛覆性的產品和商業模式,而谷歌、微軟這樣的老牌公司,則在尋求著應對之法。

它們的種種舉動,都是由生成式AI在全球引發的製定AI戰略的迫切感。

英偉達加速計算始於DGX AI超級計算機,這也是當前大型語言模型實現突破的背後引擎。

GTC上,老黃自豪地表示,是我親手將全球首款DGX交給了OpenAI。

從那之後,「財星」100強企業中,其中有一半都安裝了DGXAI超級電腦。

DGX配備8個H100 GPU模組,同時H100配備Transformer引擎,能夠處理ChatGPT這樣令人驚嘆的模型。

8個H100模組透過NVLINK Switch彼此相連,實現了全面無阻塞通訊。 8個H100協同工作,就像是巨型的GPU。

讓老黃倍感激動的是,微軟宣布Azure將向其H100 AI超級電腦開放私人預覽版。

並稱,「DGX超電腦是現代AI工廠。我們正處於AI的iPhone時刻。」

一手帶出ChatGPT

過去十年,加速和縱向擴展結合使各種應用實現百萬倍性能提升。

令人印象最深刻的例子,便是2012年,AlexNet深度學習框架的提出。

當時,Alex Krizhevsky、Ilya Suskever,以及Hinton在GeForce GTX 580上使用了1400萬張圖完成了訓練,可處理262千萬億次浮點運算。

十年後,Transformer面世。

Ilya Suskever訓練了GPT-3來預測下一個單詞,需要進行的浮點運算比訓練AlexNet模型要多一百萬倍。

由此,創造出了令全世界震驚的AI——ChatGPT。

用老黃的一句話總結:

#這意味著嶄新的計算平台已經誕生,AI的「iPhone時刻」已經到來。加速計算和AI技術已經走進現實。

加速函式庫是加速運算的核心。這些加速程式庫連結了各種應用,進而再連結到各行各業,形成了網路中的網路。

經過30年的開發,目前已經有數千款應用程式被英偉達的庫加速,幾乎涉及科學和工業的每個領域。

目前,所有的英偉達GPU都相容於CUDA。

現有的300個加速函式庫和400個AI模型涵蓋了量子運算、資料處理、機器學習等廣泛的領域。

這次GTC大會,英偉達宣布更新了其中的100個。

英偉達Quantum平台由函式庫和系統組成,可供研究人員推進量子程式設計模型、系統架構和演算法。

cuQuantum是用於量子電路模擬的加速庫,其中IBM、百度等公司已經將此加速庫整合到他們的模擬框架中。

Open Quantum CUDA是英偉達的混合GPU-Quantum程式設計模型。

英偉達也宣布推出一個量子控制鏈路,這是與Quantum Machines合作開發的。它可以將英偉達GPU連接到量子計算機,以極快的速度進行糾錯。

還有RAFT新函式庫推出,用於加速索引、資料載入和近鄰搜尋。

此外,英偉達還宣布了DGX Quantum,用DGX構建,並利用最新開源的CUDA Quantum,這個新平台為從事量子計算的研究人員提供了一個革命性的高效能和低延遲的架構。

英偉達也推出了NVIDIA Triton Management Service軟體,可在整個資料中心自動擴充和編排Triton推理實例。適用於像GPT-3大語言模型的多GPU、多節點推理。

用於電腦視覺的CV-CUDA和用於視訊處理的VPF是英偉達新的雲端規模加速庫。

老黃宣布CV-CUDA Beta優化了預處理和後處理,實現了更高的雲端吞吐量,將成本和能耗減少了四分之一。

目前,微軟處理視覺搜尋、Runway為其生成式AI視訊處理過程,全都採用了CV-CUDA和VRF函式庫。

此外,英偉達加速運算也幫助基因體學實現了里程碑式發展。使用英偉達助力的儀器設備,將整個基因組定序的成本降低至100美元,成為另一個里程碑。

英偉達NVIDIA Parabrics加速庫可用於雲端或儀器設備內的端對端基因組分析,並且適用於各種公有雲和基因組學平台。

ChatGPT在跑,英偉達在賺

現在,ChatGPT、Stable Diffusion、DALL-E和Midjourney,已經喚醒了全世界對於生成式AI的認知。

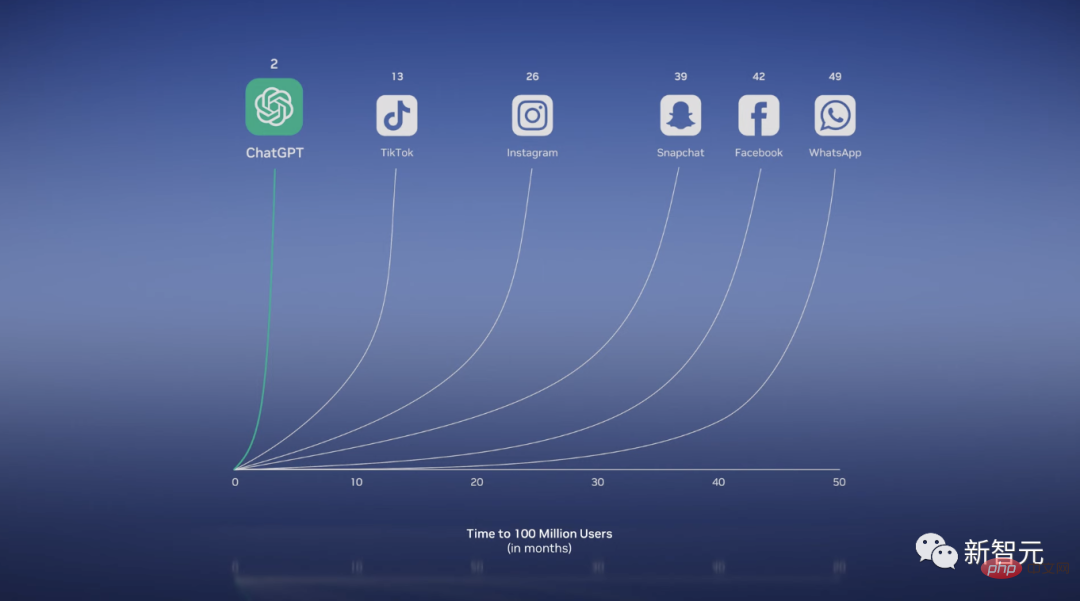

當紅炸子雞ChatGPT光在推出2個月後,就月活破億,已經成為史上用戶成長最快的應用。

可以說,它就是一台電腦。不僅能生成文本、寫詩、改寫研究論文、解決數學問題、甚至能程式設計。

眾多突破性成果造就了今天的生成式AI。

Transformer能夠以大規模並行的方式,從資料的關係和依賴性中學習上下文和意義。這使得LLMs能夠利用海量資料進行學習,在沒有明確訓練的情況下執行下游任務。

另外,受物理學啟發的擴散模型,能夠透過無監督學習來產生影像。

老黃總結道,短短十幾年,我們就從識別貓,跨越到了生成在月球行走的太空服貓的過程。

現在完全可以說,生成式AI就是一種新的計算機,一種可以用人類語言進行程式設計的計算機。

在先前,命令電腦解決問題,是獨屬於程式設計師的特權,但是如今,人人都可以是程式設計師了。

和比爾蓋茲一樣,老黃也下了類似的定義:生成式AI是一種新型運算平台,與PC、網路、行動裝置和雲端類似。

透過Debuild,我們只要說清楚自己想要什麼,就可以直接設計和部署Web應用程式。

很明顯,生成式AI將幾乎重塑所有產業。

要做AI界的「台積電」

在這樣的背景下,專業公司都需要使用自己的專有數據,來建立客製化模型。

接著,老黃自豪地宣布,業界需要一個類似台積電的代工廠,來建造自訂的大語言模型,而英偉達,就是這個「台積電」!

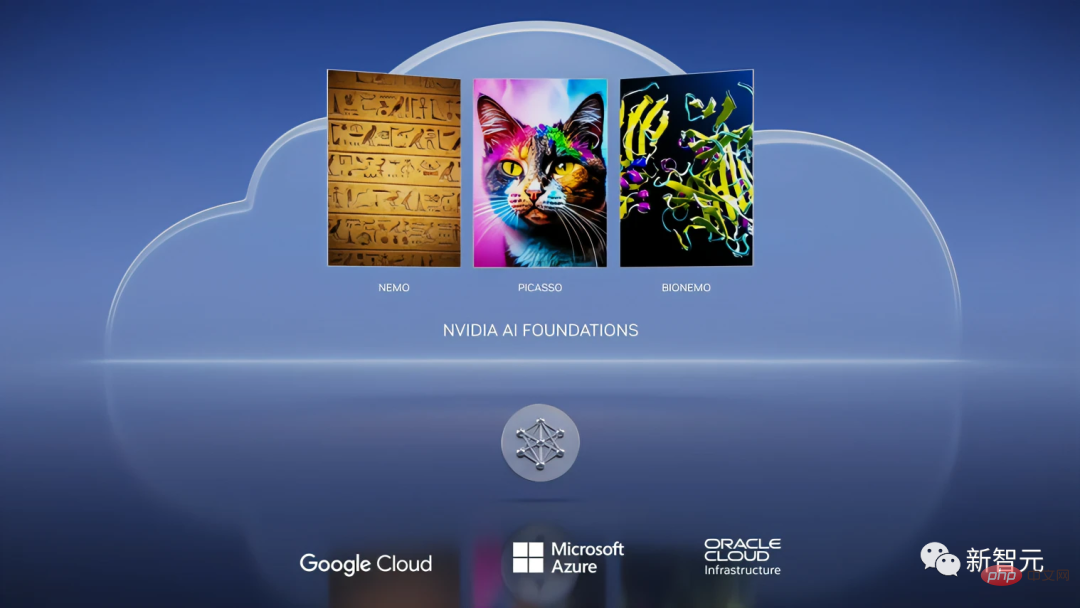

大會上,英偉達宣布推出NVIDIA AI Foundations雲端服務,讓客戶可以自訂LLM和生成式AI。

這個雲端服務包含語言、視覺和生物模型製作服務。

其中,Nemo用於建立客製化的語言文字轉文本生成式模型。

而Picasso是視覺語言模型製作,可以用於訓練自訂模型,包括圖像、影片和3D應用程式。

只要向Picasso發送文字提示和元資料的API調用,Picasso就會用DGX Cloud上的模型把產生的素材發送回應用。

更厲害的地方是,把這些素材導入NVIDIA Omniverse,就可以建構逼真的元宇宙應用,和數位孿生模擬。

另外,英偉達也正在和Shutterstock合作,開發Edify-3D生成式模型。

同時,英偉達和Adobe的合作也持續擴展,把生成式AI融入行銷人員和創意人士的日常工作流程,並且,尤其註意對於藝術家版權的保護。

第三個領域,就是生物學。

如今,藥物研發產業的價值已達到近2兆元,研發投入高達2,500億美元。

NVIDIA Clara就是一個醫療健康應用框架,用於影像、儀器、基因組學分析和藥物研發。

而最近,生物圈的熱門方向是利用生成式AI發現疾病標靶、設計新分子或蛋白類藥物等。

與之對應的,BIONEMO可以讓使用者使用專有資料建立、微調、提供自訂模型,包括AlphaFold、ESMFold、OpenFold等蛋白質預測模型。

最後,老黃總結道,NVIDIA AI Foundations是一個雲端服務和代工廠,用於建立自訂語言模型和生成式AI。

老黃雲服務,月租36999美元

英偉達這次,也推出了一款雲端服務。

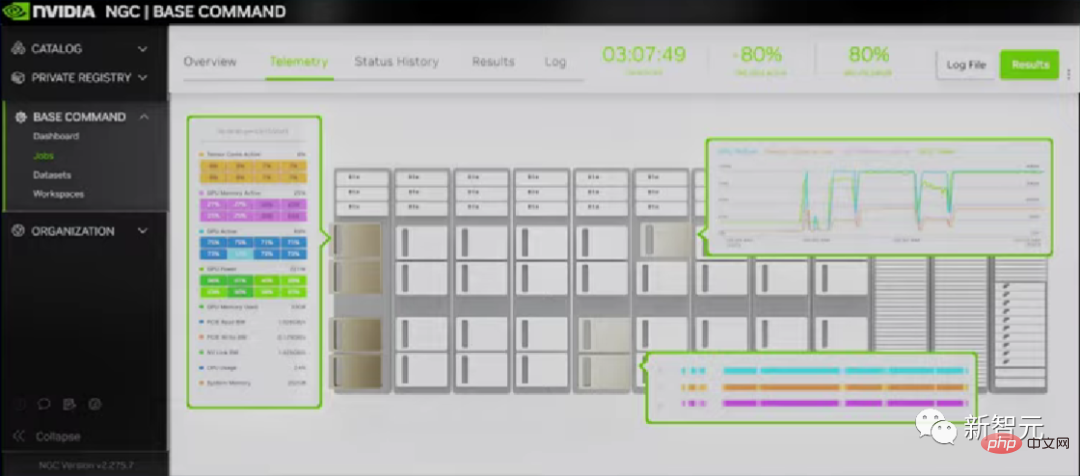

它敏銳地看到客戶需要更簡單快速存取NVIDIA AI的需求,因而推出了NVIDIA DGX Cloud。

DGX Cloud與Microsoft Azure、Google GCP和Oracle OCI都有合作。只要一個瀏覽器,NVIDIA DGX AI超級計算機,就能即時連接到每家公司!

在這款雲端上,可以執行NVIDIA AI Enterprise加速庫套件,直接解決AI端對端的開發與部署。

並且,雲端上不只提供NVIDIA AI,還有全球最主要的幾大雲端服務商。

而英偉達的第一個NVIDIA DGX Cloud,就是Oracle Cloud Infrastructure(OCI)。

在OCI中,NVIDIA CX-7和BlueField-3兩個王炸合體,立刻組合出一台強力超算。

據介紹,企業現在可以租用DGX Cloud,月租36999美元起。

最後,當然還是每年GTC大會的保留節目-Omniverse。老黃宣布了關於元宇宙平台Omniverse更新。

現在,Microsoft和NVIDIA,正準備將Omniverse帶給數以億計的Microsoft 365和Azure用戶。

此外,還有消息指出:老黃為了能讓H100合規地出口中國,便照著之前A800的經驗特調了一款「H800」,將晶片之間的資料傳輸率降到了H100的50%左右。

總結來說,老黃在這次的大會已經相當明確,英偉達要做AI領域的台積電,像晶圓廠一樣提供代工,在此基礎上讓業界其他公司訓練演算法。

這種商業模式,能成功嗎?

以上是老黃手捧ChatGPT專用「核彈」炸場,英偉達H100至尊版速度提10倍!的詳細內容。更多資訊請關注PHP中文網其他相關文章!