ChatGPT 無疑是最近網路中最靚的仔,小汪哥透過這段時間的使用,加上對一些資料的查閱,了解了一些背後的原理,試圖講解一下ChatGPT應用的底層原理。如果有不正確的地方,歡迎指正。

閱讀這篇文章可能為會你解答以下問題:

為什麼有的ChatGPT 收費,有的不收費?

為什麼ChatGPT是一個字一個字回答的?

為什麼中文問題的答案有時候讓人啼笑都不是?

為什麼你問它今天是幾號,它的答案是過去的某個時間?

為什麼有的問題會拒絕回答?

“ChatGPT 國內版” 運作原理

#隨著ChatGPT的爆火,出現了許多國內版,這個版本免費是使用次數和後續收費方式都是不同的。小汪哥畫了一個草圖,試著來幫忙理解。

【對於方式一】:就是註冊了帳號之後,科學上網就可以使用,目前沒有次數限制。註冊成本可以參考我之前的文章。

【對於方式二】:據了解不需要科學上網,使用成本是購買「國內版ChatGPT」業者的服務,所以使用成本也不一樣。

ChatGPT,它在內部是如何運作的?

首先,OpenAI 在 2022 年 11 月 30 日推出了一款新的對話助理。該聊天機器人基於語言模型(大型語言模型的 LLM)GPT-3,或者更準確地說,基於其版本 3.5。 ChatGPT 實際上是 InstructGPT 的改編版,後者於 2022 年 1 月推出,但當時並沒有給人留下同樣的印象。

ChatGPT 和前輩相比,厲害在哪裡?

歸功於它能夠自動生成類似於人類的文本的能力,以及它能夠在考慮對話上下文的同時避免其前輩的缺點的能力,例如來自Microsoft 的Tay 或來自Meta 的Galactica 。 Tay 在 24 小時內變得種族主義和仇外心理。卡拉狄加正在製造胡說八道和錯誤訊息,並且可以以非常有說服力的方式就種族主義發表意見。 Tay 在 24 小時內被關閉,Galactica在三天後進行了關閉。 OpenAI 似乎從微軟和 Meta 的錯誤中學到了教訓。在很短的時間內,將系統推向了前所未有的水平。

什麼是GPT-3?

GPT(Generative Pre-trained Transformer)系列模型是由基於Transformer技術的語言模型所組成。它是由位於舊金山的公司 OpenAI 開發。 OpenAI 於2015 年12 月由Elon Musk(就是特斯拉電動車的老闆)和美國商人Sam Altman 創立,Sam Altman 是孵化器Y Combinator(Scribd、Reddit、Airbnb、Dropbox、GitLab、Women Who Code 等)的前任總經理. ),並自 2020 年起擔任 OpenAI 董事會主席。

2020 年,GPT-3 是有史以來最大的語言模型,擁有 1750 億個參數。它太大了,需要 800 GB 的記憶體來訓練它。

LLM 通常是從大量不同語言和領域的範例文字產生的。 GPT-3 已經接受了來自Common Crawl、WebText2、Books1/2 和Wikipedia 的數千億個英語單字的訓練(小汪哥認為這也是為什麼我們用中文提問,它有時候的回答讓我們啼笑皆非的原因)。它還接受了使用 CSS、JSX、Python 等編碼的程式範例的訓練。它接受 2048 個標記作為輸入,這使其能夠處理大約 1,500 個單字的非常大的句子(OpenAI 認為標記是單字的一部分大約四個字符,並以 1,000 個標記代表大約 750 個單字為例)。

GPT-3 被歸類為生成模型,這意味著它主要接受訓練以預測輸入句子末尾的下一個標記,即下一個單字(這也是為什麼它是一個字一個字的出現在螢幕上的)。現在在搜尋引擎或 Outlook 中發現的自動完成機制。

GPT-3 因其產生極其接近記者或作者能力的文本的能力而被多次引用。只需給它一個句子的開頭,它就會逐字完成段落或文章的其餘部分。透過擴展,該模型已證明它能夠處理大量的語言處理任務,例如翻譯、回答問題和填充文本中缺少的單字。

GPT-3.5 是 GPT-3 模型的變體。在 2021 年第四季之前,它已經使用選定的文字和代碼的混合物進行了訓練。這解釋了為什麼 ChatGPT 無法在該日期之後喚起事實。 (就這解釋了為什麼你問它今天是幾號,它的回答是過去的某個時間)。

我們是有的問題會拒絕回答?

如果我們問一些不道德的問題,它會拒絕回答:如下:

它會禮貌地拒絕回答。與 Tay 和 Galactica 不同,ChatGPT 的訓練是在源頭使用審核 API 進行審核的,這允許在訓練期間推遲不適當的請求。儘管如此,誤報和漏報仍然會發生並導致過度節制。審核 API 是由 GPT 模型基於以下類別執行的分類模型:暴力、自殘、仇恨、騷擾和性。為此,OpenAI 使用了匿名數據和合成數據(零樣本),尤其是在數據不足的情況下。

最後

ChatGPT 模擬真實對話的能力非凡。即使我們知道它是一台機器,一種演算法,我們也只能陷入向它提出許多問題的遊戲中,以至於機器因其超大的知識而顯得神聖。

但當仔細觀察它時,它仍然是一個句子生成器,沒有像人類那樣的理解和自我批評。我更加好奇接下來會發生什麼,以及他們將在這種類型的架構上取得多大的成功。

參考:

Model Index: https://beta.openai.com/docs/model-index-for-researchers

InstructGPT: https://openai. com/blog/instruction-following/

ChatGPT : https://openai.com/blog/chatgpt/

BLOOM: https://bigscience.huggingface.co/blog/bloom

Y Combinator: https://fr.wikipedia.org/wiki/Y_Combinator

以上是淺析:ChatGPT應用的底層原理的詳細內容。更多資訊請關注PHP中文網其他相關文章!

一個提示可以繞過每個主要LLM的保障措施Apr 25, 2025 am 11:16 AM

一個提示可以繞過每個主要LLM的保障措施Apr 25, 2025 am 11:16 AM隱藏者的開創性研究暴露了領先的大語言模型(LLM)的關鍵脆弱性。 他們的發現揭示了一種普遍的旁路技術,稱為“政策木偶”,能夠規避幾乎所有主要LLMS

5個錯誤,大多數企業今年將犯有可持續性Apr 25, 2025 am 11:15 AM

5個錯誤,大多數企業今年將犯有可持續性Apr 25, 2025 am 11:15 AM對環境責任和減少廢物的推動正在從根本上改變企業的運作方式。 這種轉變會影響產品開發,製造過程,客戶關係,合作夥伴選擇以及採用新的

H20芯片禁令震撼中國人工智能公司,但長期以來一直在為影響Apr 25, 2025 am 11:12 AM

H20芯片禁令震撼中國人工智能公司,但長期以來一直在為影響Apr 25, 2025 am 11:12 AM最近對先進AI硬件的限制突出了AI優勢的地緣政治競爭不斷升級,從而揭示了中國對外國半導體技術的依賴。 2024年,中國進口了價值3850億美元的半導體

如果Openai購買Chrome,AI可能會統治瀏覽器戰爭Apr 25, 2025 am 11:11 AM

如果Openai購買Chrome,AI可能會統治瀏覽器戰爭Apr 25, 2025 am 11:11 AM從Google的Chrome剝奪了潛在的剝離,引發了科技行業中的激烈辯論。 OpenAI收購領先的瀏覽器,擁有65%的全球市場份額的前景提出了有關TH的未來的重大疑問

AI如何解決零售媒體的痛苦Apr 25, 2025 am 11:10 AM

AI如何解決零售媒體的痛苦Apr 25, 2025 am 11:10 AM儘管總體廣告增長超過了零售媒體的增長,但仍在放緩。 這個成熟階段提出了挑戰,包括生態系統破碎,成本上升,測量問題和整合複雜性。 但是,人工智能

'AI是我們,比我們更多'Apr 25, 2025 am 11:09 AM

'AI是我們,比我們更多'Apr 25, 2025 am 11:09 AM在一系列閃爍和惰性屏幕中,一個古老的無線電裂縫帶有靜態的裂紋。這堆易於破壞穩定的電子產品構成了“電子廢物之地”的核心,這是沉浸式展覽中的六個裝置之一,&qu&qu

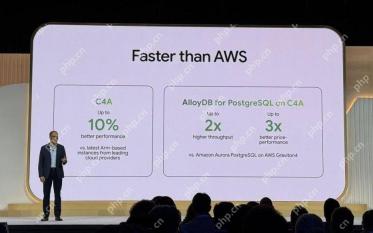

Google Cloud在下一個2025年對基礎架構變得更加認真Apr 25, 2025 am 11:08 AM

Google Cloud在下一個2025年對基礎架構變得更加認真Apr 25, 2025 am 11:08 AMGoogle Cloud的下一個2025:關注基礎架構,連通性和AI Google Cloud的下一個2025會議展示了許多進步,太多了,無法在此處詳細介紹。 有關特定公告的深入分析,請參閱我的文章

IR的秘密支持者透露,Arcana的550萬美元的AI電影管道說話,Arcana的AI Meme,Ai Meme的550萬美元。Apr 25, 2025 am 11:07 AM

IR的秘密支持者透露,Arcana的550萬美元的AI電影管道說話,Arcana的AI Meme,Ai Meme的550萬美元。Apr 25, 2025 am 11:07 AM本週在AI和XR中:一波AI驅動的創造力正在通過從音樂發電到電影製作的媒體和娛樂中席捲。 讓我們潛入頭條新聞。 AI生成的內容的增長影響:技術顧問Shelly Palme

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

WebStorm Mac版

好用的JavaScript開發工具

Dreamweaver CS6

視覺化網頁開發工具