研究顯示大型語言模型在邏輯推理方面有問題

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-12 15:19:031308瀏覽

譯者| 李睿

審校| 孫淑娟

在具有感知功能的聊天機器人成為熱門話題之前,大型語言模型(LLM)就已經引起了人們更多的興奮和擔憂。近年來,經過大量文本訓練的深度學習模型——大型語言模型(LLM) 在幾個用於衡量語言理解能力的基準方面表現出色。

諸如GPT-3和LaMDA之類的大型語言模型設法在較長的文本中保持連貫性。它們似乎對不同的主題很了解,並在冗長的對話中保持一致。大型語言模型(LLM)已經變得如此令人信服,以至於有些人將它們與人格和更高形式的智力聯繫在一起。

但是大型語言模型(LLM)能像人類一樣進行邏輯推理嗎?根據加州大學洛杉磯分校科學家發布的一篇研究論文,在大型語言模型(LLM)中使用的深度學習架構Transformers並沒有學習模擬推理功能。與其相反,電腦們找到了明智的方法來學習推理問題中固有的統計特徵。

研究人員在一個有限的問題空間中測試了目前流行的Transformer架構BERT。他們的研究結果表明,BERT可以準確地回應訓練空間中分佈內範例的推理問題,但不能推廣到基於相同問題空間的其他分佈中的範例。

而這些測試突顯了深度神經網路的一些缺點以及用於評估它們的基準。

1.如何測量人工智慧中的邏輯推理?

人工智慧系統針對自然語言處理和理解問題有幾個基準測試,例如GLUE、SuperGLUE、SNLI和SqUAD。隨著Transformer規模變得越來越大,並在更大的資料集上接受訓練,Transformer已經能夠在這些基準上逐步改進。

值得注意的是,人工智慧系統在這些基準上的表現通常與人類智慧進行比較。人類在這些基準上的表現與常識和邏輯推理能力密切相關。但目前尚不清楚大型語言模型的改進是因為它們獲得了邏輯推理能力,還是因為它們接觸了大量文本。

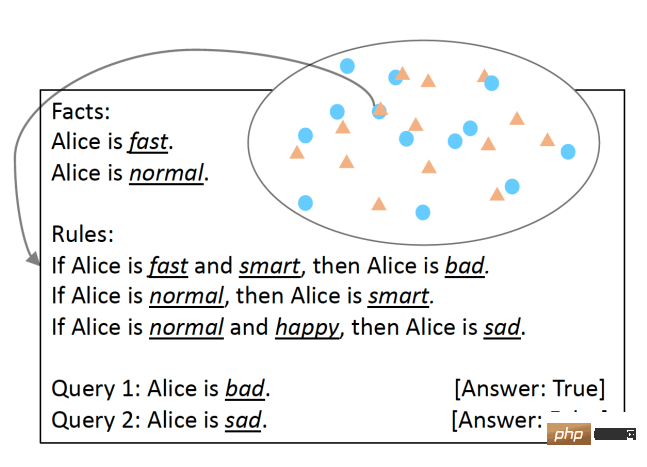

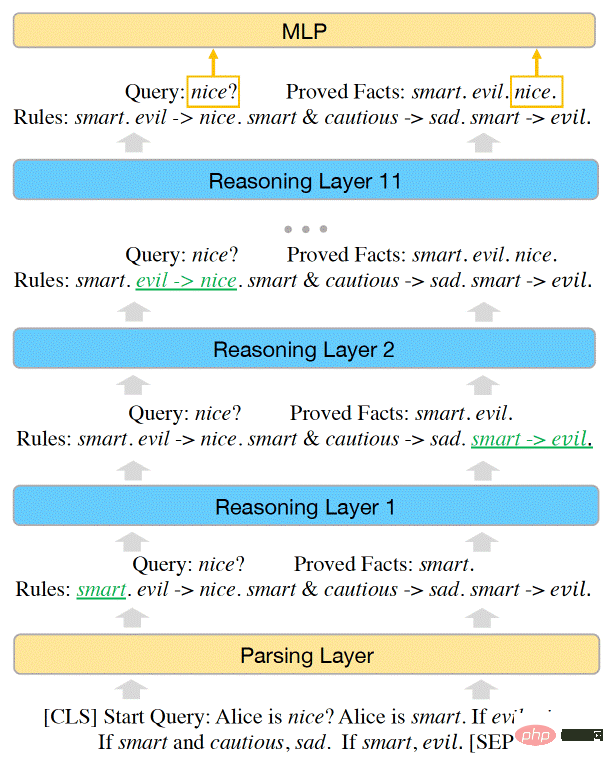

為了驗證這一點,加州大學洛杉磯分校的研究人員開發了SimpleLogic,這是一類基於命題邏輯的邏輯推理問題。為了確保語言模型的推理能力經過嚴格測試,研究人員透過使用模板語言結構消除了語言差異。 SimpleLogic問題由一組事實、規則、查詢和標籤組成。事實是已知為「真」的謂詞。規則是條件,定義為條款。查詢是機器學習模型必須回應的問題。標籤是查詢的答案,也就是「真」或「假」。 SimpleLogic問題被編譯成連續的文字字串,其中包含語言模型在訓練和推理期間所期望的訊號和分隔符號。

以SimpleLogic格式提出的問題SimpleLogic的特性之一是它的問題是自包含的,不需要先驗知識。這一點尤其重要,因為正如許多科學家所說,當人類說話時,他們忽略了共享的知識。這就是為什麼當被問及每個人都知道的基本世界知識的問題時,語言模型經常陷入陷阱的原因。相比之下,SimpleLogic為開發人員提供解決其問題所需的一切。 因此,任何查看SimpleLogic格式提出的問題的開發人員都應該能夠推斷其規則,並能夠處理新範例,無論他們的背景知識如何。

2.統計特徵和邏輯推理

研究人員證明,SimpleLogic中的問題空間可以用一個推理函數來表示。研究人員進一步表明,BERT有足夠的能力解決SimpleLogic中的所有問題,它們可以人工調整機器學習模型的參數來表示推理功能。

然而,當它們在SimpleLogic範例資料集上訓練BERT時,模型無法自行學習推理功能。機器學習模型設法在一個資料分佈上實現近乎完美的準確性。但它並沒有推廣到同一問題空間內的其他分佈。儘管訓練資料集涵蓋了整個問題空間,並且所有分佈都來自同一推理函數,但情況仍然如此。

BERT Transformer模型的容量足以表示SimpleLogic的推理功能

(註:這與分佈外泛化挑戰不同,後者適用於開放空間問題。當模型無法泛化到OOD資料時,當處理不在其訓練集分佈範圍內的資料時,其效能會顯著下降。)

研究人員寫道:「經過進一步調查,我們為這個悖論提供了一個解釋:僅在分佈測試示例上達到高精度的模型還沒有學會推理。事實上,該模型已經學會在邏輯推理問題中使用統計特徵來進行預測,而不是模擬正確的推理功能。」

這項發現凸顯了將深度學習用於語言任務的一個重要挑戰。神經網路非常擅長發現和擬合統計特徵。在某些應用程式中,這可能非常有用。例如,在情緒分析中,某些字詞和情緒類別之間有強烈的相關性。

然而,對於邏輯推理任務,即使存在統計特徵,其模型也應該嘗試找到並學習潛在的推理功能。

研究人員寫道:「當我們試圖對神經模型進行端到端的訓練,以解決既涉及邏輯推理又涉及先驗知識且呈現語言差異的自然語言處理(NLP)任務時,應該小心謹慎。」他們強調,SimpleLogic帶來的挑戰在現實世界中變得更加嚴峻,大型語言模型(LLM)所需的大量資訊根本不包含在數據中。

研究人員觀察到,當他們從訓練資料集中刪除一個統計特徵時,語言模型在相同問題空間的其他分佈上的表現得到了改善。然而,問題是發現和刪除多個統計特徵說起來容易做起來難。正如研究人員在論文中指出的那樣,「此類統計特徵可能數不勝數,並且極其複雜,因此很難從訓練資料中刪除。」

3.深度學習中的推理

不幸的是,隨著語言模型規模的變大,邏輯推理問題並沒有消失。它只是隱藏在龐大的架構和非常大的訓練語料庫中。大型語言模型(LLM)可以描述事實並且很好地將句子拼接在一起,但是在邏輯推理方面,他們仍然使用統計特徵進行推理,這不是一個堅實的基礎。而且,沒有跡象表明透過向Transformers添加層、參數和注意力頭,邏輯推理的差距將被彌合。

這篇論文與其他顯示神經網路在學習邏輯規則方面的限制的工作一致,例如生命遊戲或視覺資料的抽象推理。該論文強調了當前語言模型面臨的主要挑戰之一。正如加州大學洛杉磯分校的研究人員所指出的,「一方面,當一個模型被訓練來從資料中學習一項任務時,它總是傾向於學習統計模式,這些模式固有地存在於推理範例中;然而,另一方面,邏輯規則從不依賴統計模式來進行推理。由於很難建立一個不包含統計特徵的邏輯推理資料集,因此從資料中學習推理是很困難的。」

原文連結:https://bdtechtalks.com/2022/06/27/large-language-models-logical-reasoning/

以上是研究顯示大型語言模型在邏輯推理方面有問題的詳細內容。更多資訊請關注PHP中文網其他相關文章!