ICML徵稿禁止使用大型語言模型,LeCun轉發:中小型模型可以用嗎?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-11 22:07:011841瀏覽

昨天,國際機器學習會議(ICML)發布了2023論文徵稿公告。

論文提交日期為1月9日至1月26日。

然而,本次會議中關於「道德準則」的要求卻引來了眾多不滿。

LLM不可控,還是ban掉吧

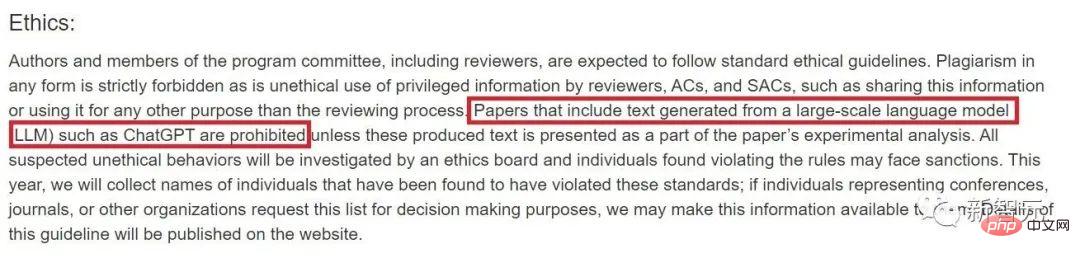

根據大會的政策,所有作者和程序委員會成員,包括審稿人,應遵循標準的道德準則。

嚴禁任何形式的抄襲,以及審稿人、領域主席(AC)和高級領域主席(SAC)對特權資訊的不道德使用,例如分享此訊息,或將其用於評審過程以外的任何其他目的。

禁止包含從大規模語言模型(LLM)(如ChatGPT)產生的文本的論文,除非這些生成的文本作為論文實驗分析的一部分呈現。

所有可疑的不道德行為都將由道德委員會進行調查,被發現違反規則的個人可能會面臨制裁。今年,我們將收集被發現違反這些標準的個人姓名;如果代表會議、期刊或其他組織的個人出於決策目的要求提供此列表,我們可能會向他們提供此資訊。

#其中,「禁止使用大型語言模型寫論文」一條要求被網友熱議。

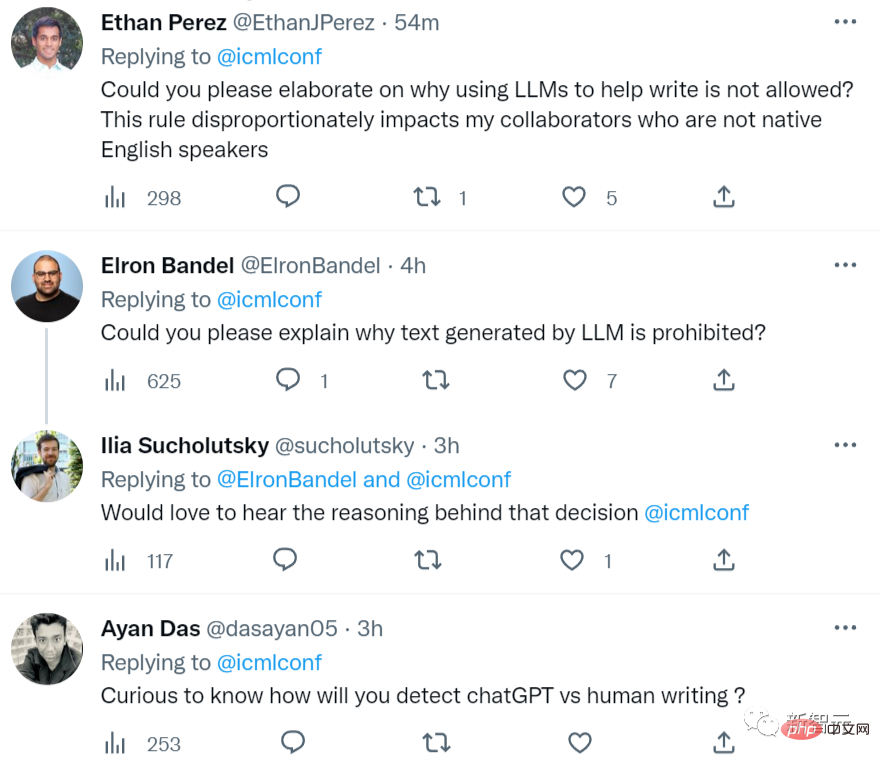

此訊息已發布,網友紛紛在ICML推特下評論:「為啥不能用大型語言模型?」

AI論文不能用AI,合理嗎

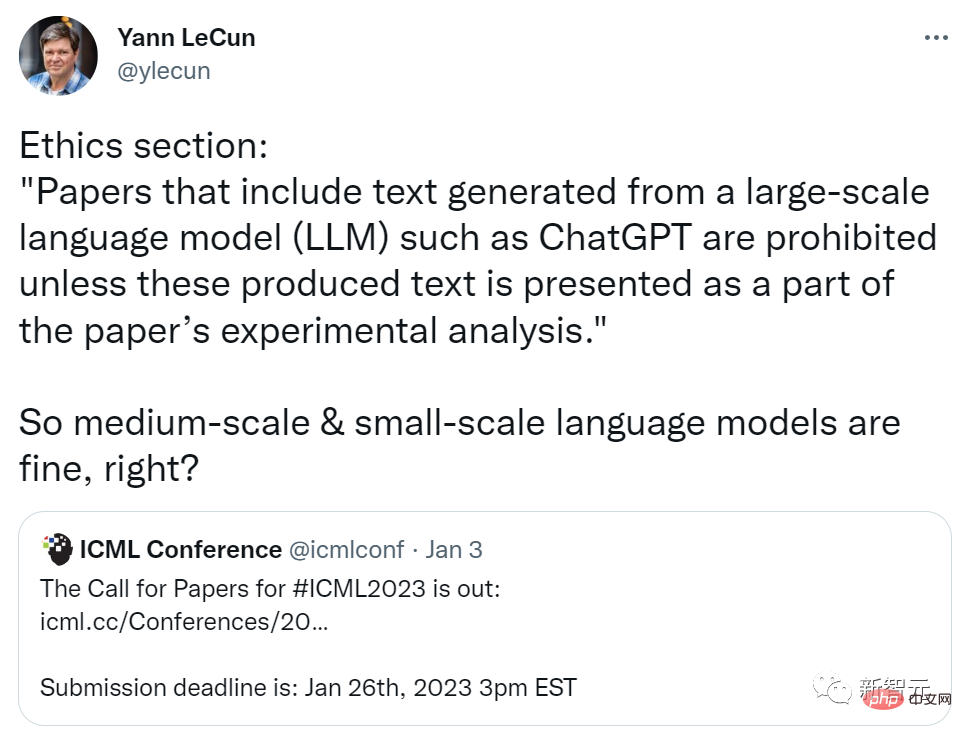

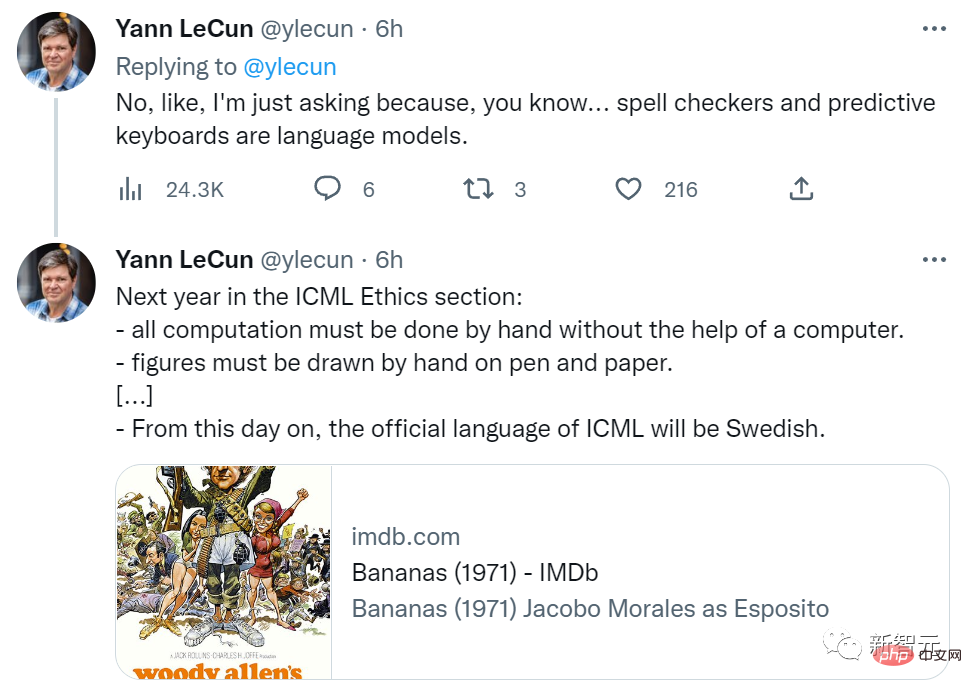

Yann LeCun轉發並評估:「大型語言模型不能用,意思是中型和小型語言模型還可以用。」

#他解釋:「因為拼字檢查應用和文本預測也是語言模型。」

#最後,LeCun陰陽道:「明年的ICML道德準則應該變成:研究人員必須徒手完成各種計算,不能藉助計算機;各類圖形必須用筆和紙手繪;從今天起,ICML的官方語言變為瑞典語(瑞典:?)。」

最後,還不忘轉發一部電影《瘋了》,總結自己對ICML政策的評價。

在LeCun的貼文下,網友們各顯神通,紛紛整活。

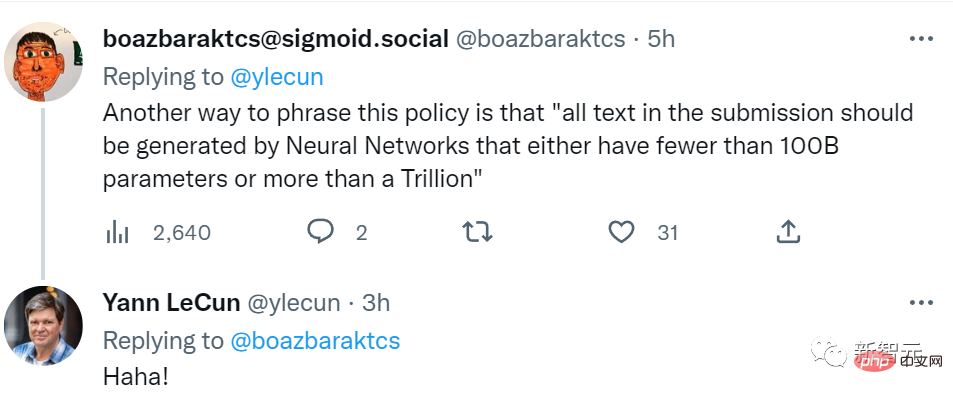

一位網友給ICML提供了新的想法:「另一個表述此策略的方式是'提交中的所有文字都應由參數小於100B或超過1兆的神經網路生成'。」

#

還有人假裝是ICML的評審,給ChatGPT打廣告:「作為ICML和其他會議的評審,我很欣賞作者們使用ChatGP等工具潤色文章。這會讓他們的論文更加清晰易讀。(這篇文章已經過ChatGPT的修改)」

#對於這個規則,MIT教授Erik Brynjolfsson簡單概括:「這是場必敗之仗。」

除了整活玩梗,也有人認真表達了對ICML規定的想法。

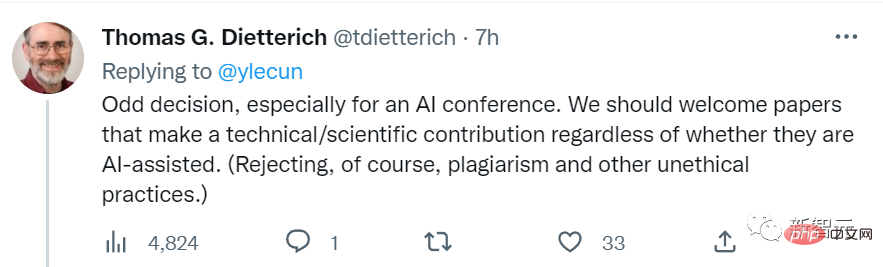

AAAI前主席Thomas Dietterich說:「這個規定很怪,對於一個人工智慧會議來說更是如此。我們應該歡迎所有為科學技術做出貢獻的文章,不論作者是否接受了AI的輔助。」

#也有人給ICML改進建議:

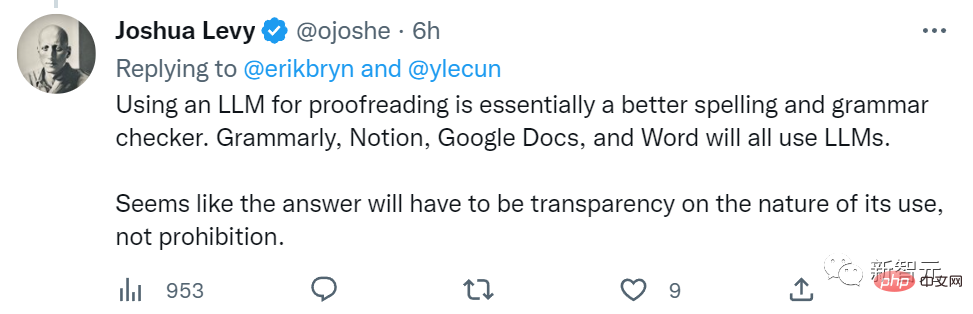

使用大型語言模型來進行審查對於改善拼字和文法很有裨益。 Grammarly,Notion,Google Docs甚至Word都會用到大型語言模型。

看起來,解決方法是解釋清楚使用大型語言模型的原因和用途,而不是一味禁止。

原來不只我用Grammarly檢查拼字和文法(doge)。

當然,也有網友對此表示了理解,認為此舉是為了保護評審的權威。

網友Anurag Ghosh評論道:「我認為ICML的要求是為了防止那些看似正確的論文發表。例如機器學習領域發表的5篇編造/AI產生的論文。這會暴露同儕審查的缺陷。」

也有人認為,「大型語言模型只是工具,如果它們可以產生更高品質的論文,那又如何?這些研究的主要貢獻不來自於大型語言模型,而來自那些研究人員。難道我們要禁止研究人員接受任何形式的幫助,例如Google搜索,或不能和沒有利害關係的人談論此事嗎?」

由於最近幾年大語言模型的熱度始終不減,這次ICML提出的禁令引發的學者和網友熱烈討論,想必還會持續一段時間。

不過目前看下來,有一個問題似乎還沒有人討論,如何判斷一篇文章的片段是不是大語言模型生成的?如何驗證,靠查重嗎?畢竟真要是機器模型生成的文章,誰也不會刻意標註一個「本文是大語言模型自動產生的」,對吧?

#更何況,研究論文這種邏輯清晰、結構明確、語言風格高度模式化的文章,簡直就是大語言模型發揮的最佳場所,即使是生成的原文略顯生硬,但如果是當個輔助工具來用,怕是很難辨別,也就難有明確的標準來實施這個禁令。

這樣看來,這次ICML的審稿人肩上的擔子,怕又要重了不少了。

#以上是ICML徵稿禁止使用大型語言模型,LeCun轉發:中小型模型可以用嗎?的詳細內容。更多資訊請關注PHP中文網其他相關文章!