AI論文「高引用轉換率」排名出爐:OpenAI第一,曠視第二,Google位居第九

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-11 21:01:011842瀏覽

為了弄清楚這個問題,美國Zeta Alpha平台統計了2020-2022三年之間全世界引用次數前100的AI論文,得出了一些很有意思的結果。

例如:

「當紅明星」OpenAI,在論文引用次數最多的機構中名列第9。

然而,在論文發表數量最多的機構名單上,根本找不到它的名字。

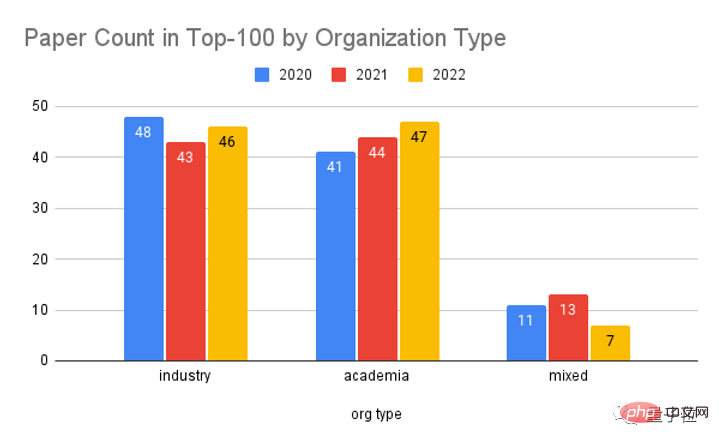

再比如,來自工業界的GoogleMeta微軟總是在各項數據都名列前茅,然而總的看下來,學術界也並沒有落後工業界。

此外,先前關於「中國AI研究的產出數量和品質可能超過美國」的觀點在這份報告中似乎也被破解——

#更多以及具體的數據,我們一個接一個來看。

中國第二,OpenAI、DeepMind品質取勝

在具體分析之前,Zeta Alpha先統計出了2020-2022每年引用次數最多的論文,它們分別是:

2022年:

1、AlphaFold Protein Structure Database: Massively expanding the structural coverage of protein-sequence space with high-accuracy models

引用次數:1372

機構:DeepMind

主題:利用AlphaFold增加蛋白質結構資料庫的覆蓋範圍

2、ColabFold: making protein folding accessible to all

引用次數:1162

機構:多家合作完成

主題:一個開源且高效的蛋白質折疊模型

3、Hierarchical Text-Conditional Image Generation with CLIP Latents

引用次數:718

機構:OpenAI

主題: DALL·E 2

4、A ConvNet for the 2020s

#引用次數:690

機構:Meta與UC伯克利大學

主題:在Transformer繁榮時期成功實現CNN現代化

5、PaLM: Scaling Language Modeling with Pathways

引用次數:452

機構:Google

主題:Google的540B大型語言模型,一個新的MLOps範式,包含它的實現過程

2021年

1、Highly accurate protein structure prediction with AlphaFold

引用次數:8965

機構:DeepMind

主題:AlphaFold,利用深度學習進行蛋白質結構預測的巨大突破

2、Swin Transformer: Hierarchical Vision Transformer using Shifted Windows

##引用次數:4810機構:微軟

主題:ViT的強大變體

機構:OpenAI

主題:CLIP

機構:美國華盛頓,Black in AI,The Aether

主題:著名的立場論文,對不斷增長的語言模型的趨勢持批評態度,強調了它們的局限性和危險

機構:Meta

主題:DINO,揭示了圖像的自監督如何導致Transformers中出現某種原型物件分割

機構:Google

主題:第一個展示普通Transformer如何在電腦視覺領域中表現出色的作品

機構:OpenAI

主題:GPT-3

機構:中國台灣「中研院」

主題:YOLOv4

機構:Google

主題:對Transformer的遷移學習進行了嚴格的研究,產生了著名的T5

機構:DeepMind和帝國學院

主題:顯示negative對於表徵學習來說不是必需的

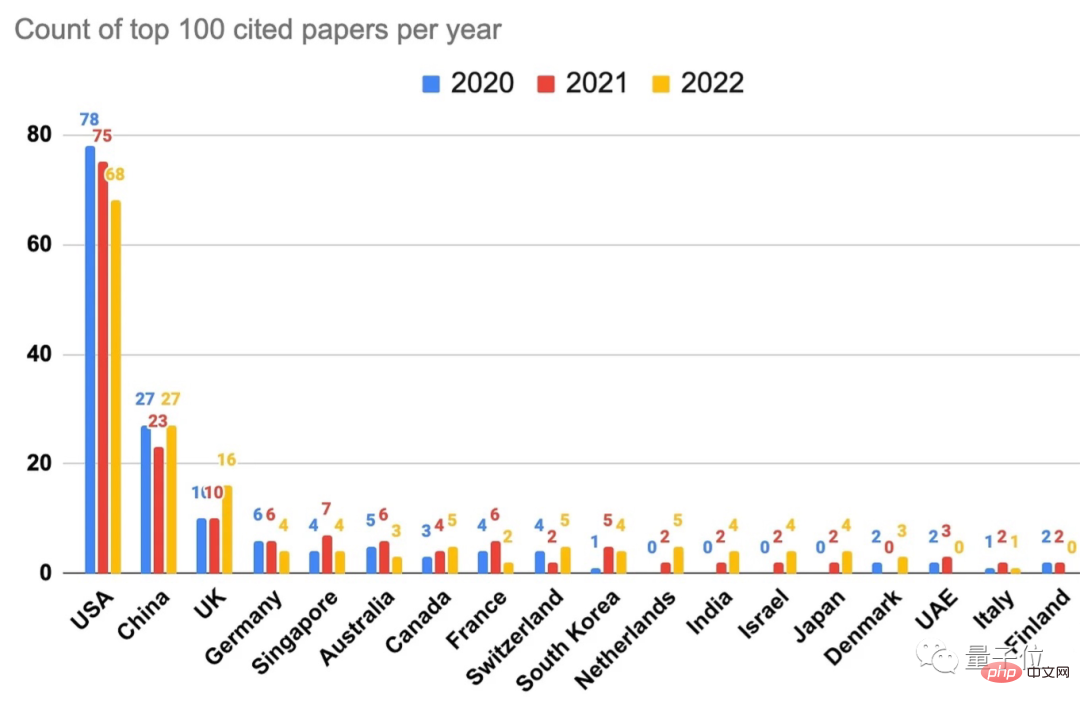

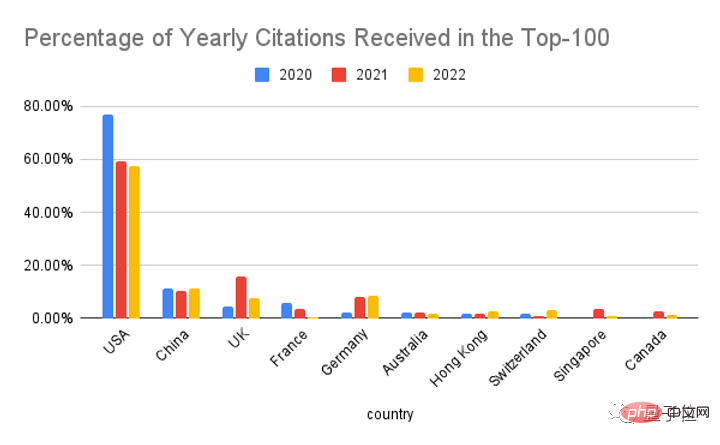

當然,美國仍然第一,但可以看到三年間的佔比下降。

英國是中美以外最大的競爭對手,不過英國表現突出的2022年,其實主要都是由DeepMind貢獻的(佔69%)。

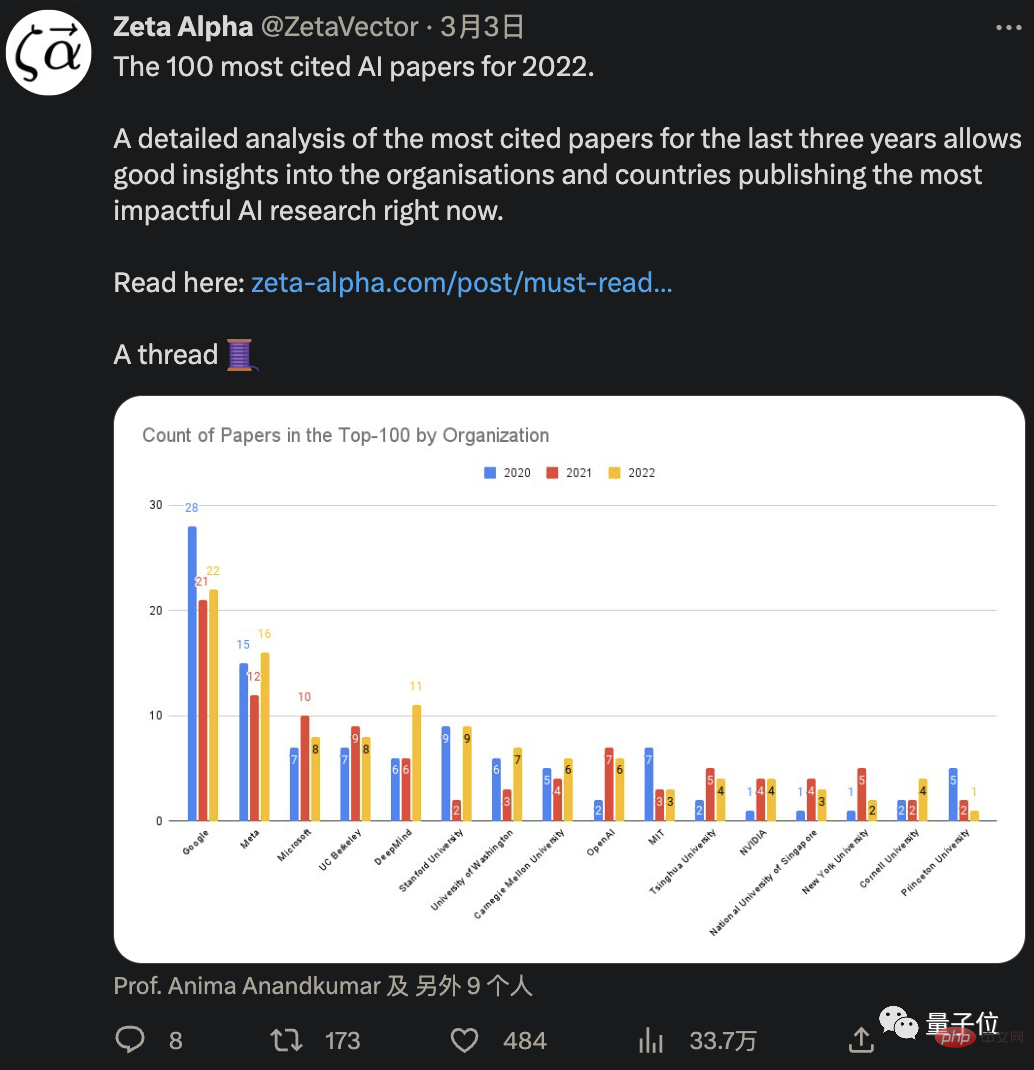

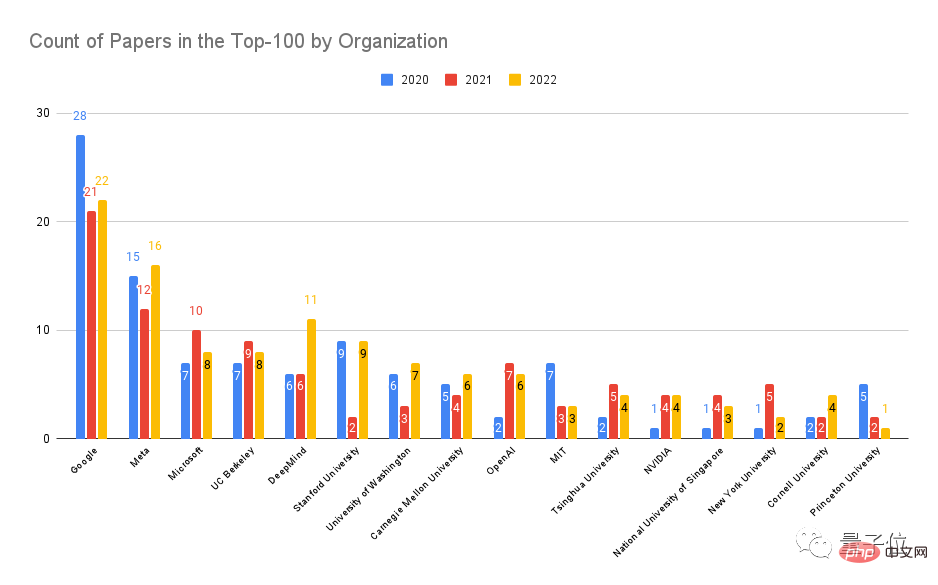

接下來是依照組織或機構評比論文引用次數進前100最多的個體。

不太意外,Google與Meta微軟分列前三,接著是UC柏克萊、DeepMind和史丹佛。

OpenAI也收穫了一個還不錯的名次,第九。第十是MIT,第十一是清華大學。

儘管前三名選手都來自工業界,但是如果只按照機構類型來分,學術界和它的表現其實基本上不相上下。

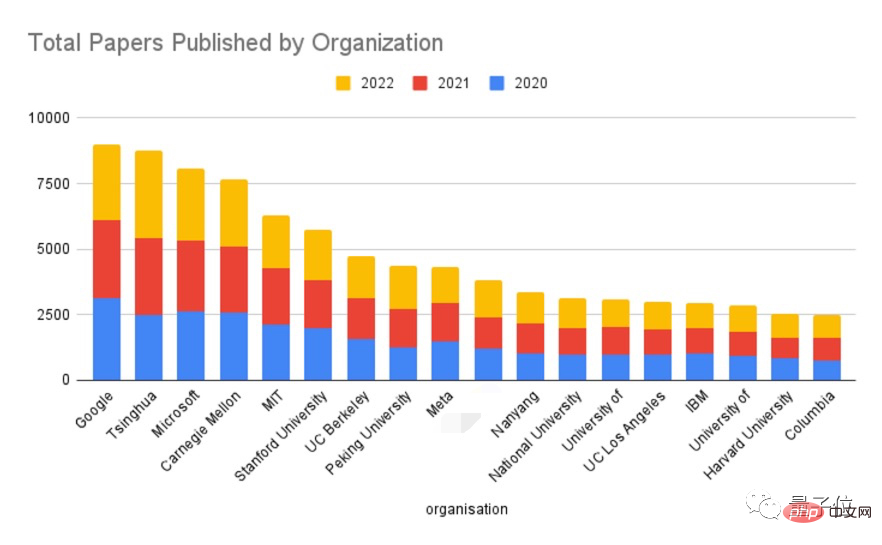

再接著,是過去三年各組織或機構發表的論文總數排名。

老大還是Google。第二名比較亮眼,是清華大學,接著是微軟、CMU、MIT、史丹佛、UC柏克萊、北京大學(第八)、Meta……

#可以看到,前十名隸屬於學術界的機構或組織佔據了大片江山。

而我們找了半天,也沒有看到OpenAI和DeepMind的名字--

#顯然它們發表的論文數量較少,主要靠品質取勝。

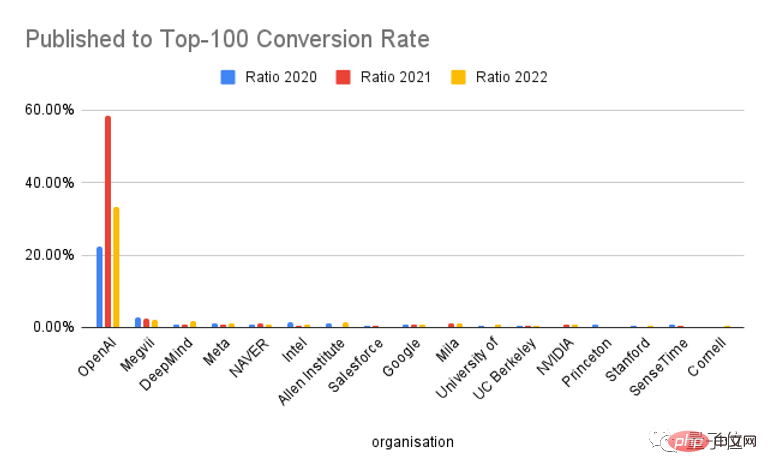

為了驗證這個猜測,Zeta Alpha也做了一個高引論文轉換率的排名。

果不其然,OpenAI摘得桂冠,DeepMind獲得第三。

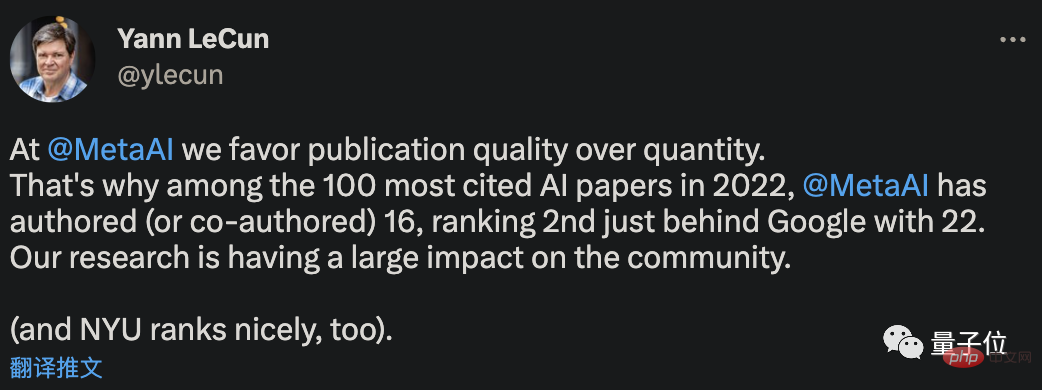

當然,Meta也不錯,第四,引得LeCun都出來「現身說法」了一下:

我們Meta確實是更注重質量而不是數量的。

相比之下,高引多但發得更多的Google才排第九,差點出前10。

除了這幾位,第二名也是亮點──它就是曠視。

以及國內還有商湯也上榜了。

附2022引用Top100完整名單

ChatGPT的火著實盤活了AI產業,最新前沿研究究竟會指向哪些方向?我們也需要更加敏銳地進行觀察。

為此,Zeta Alpha也給出了2022年引用進100的所有AI論文的名單,或許對大家有所啟發。

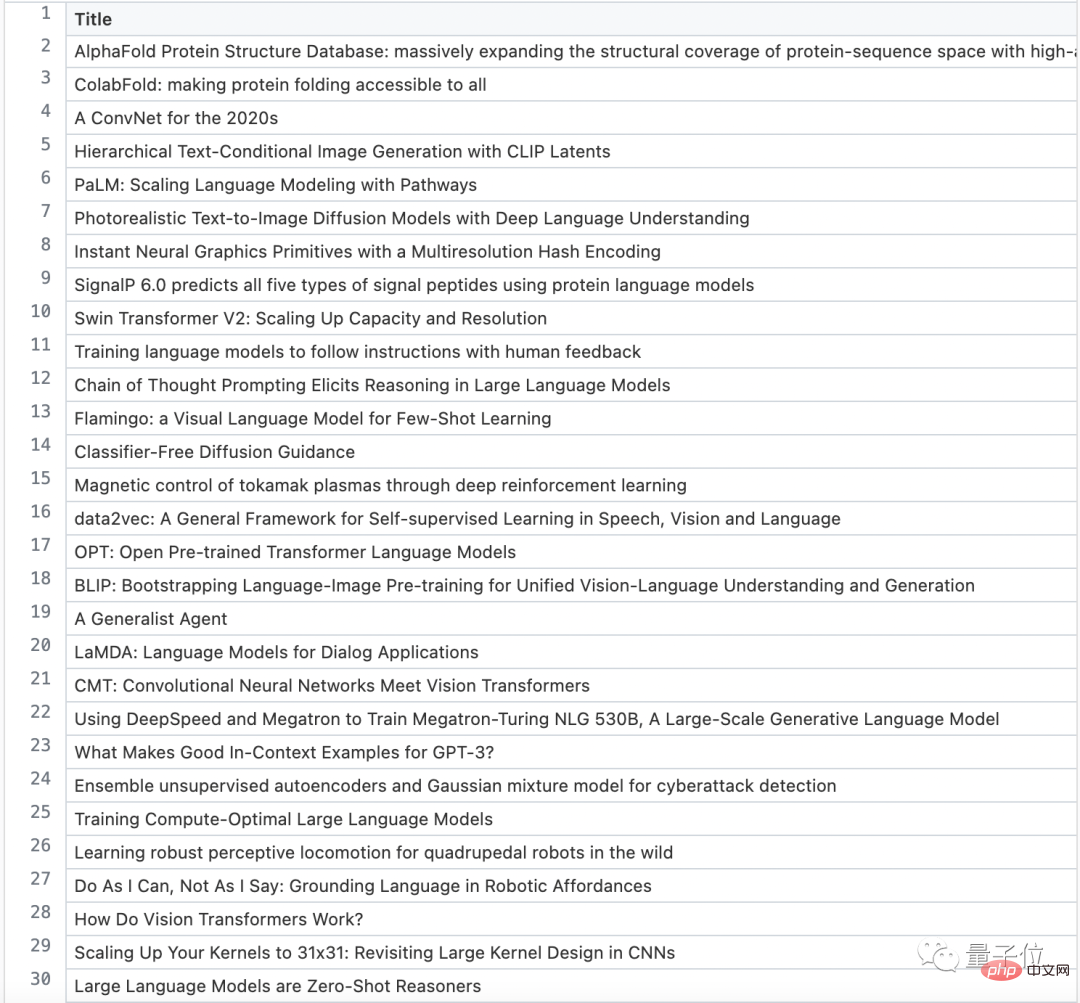

1-30:

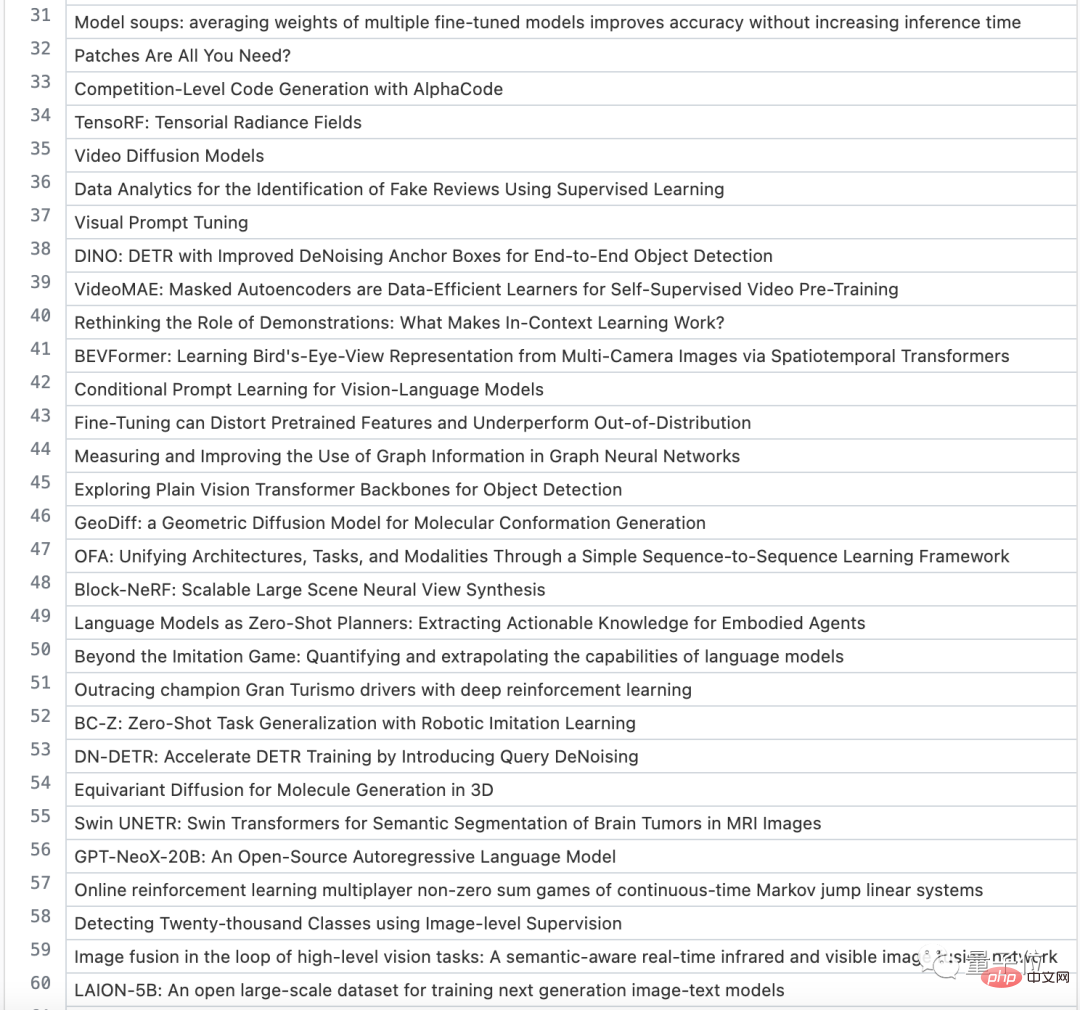

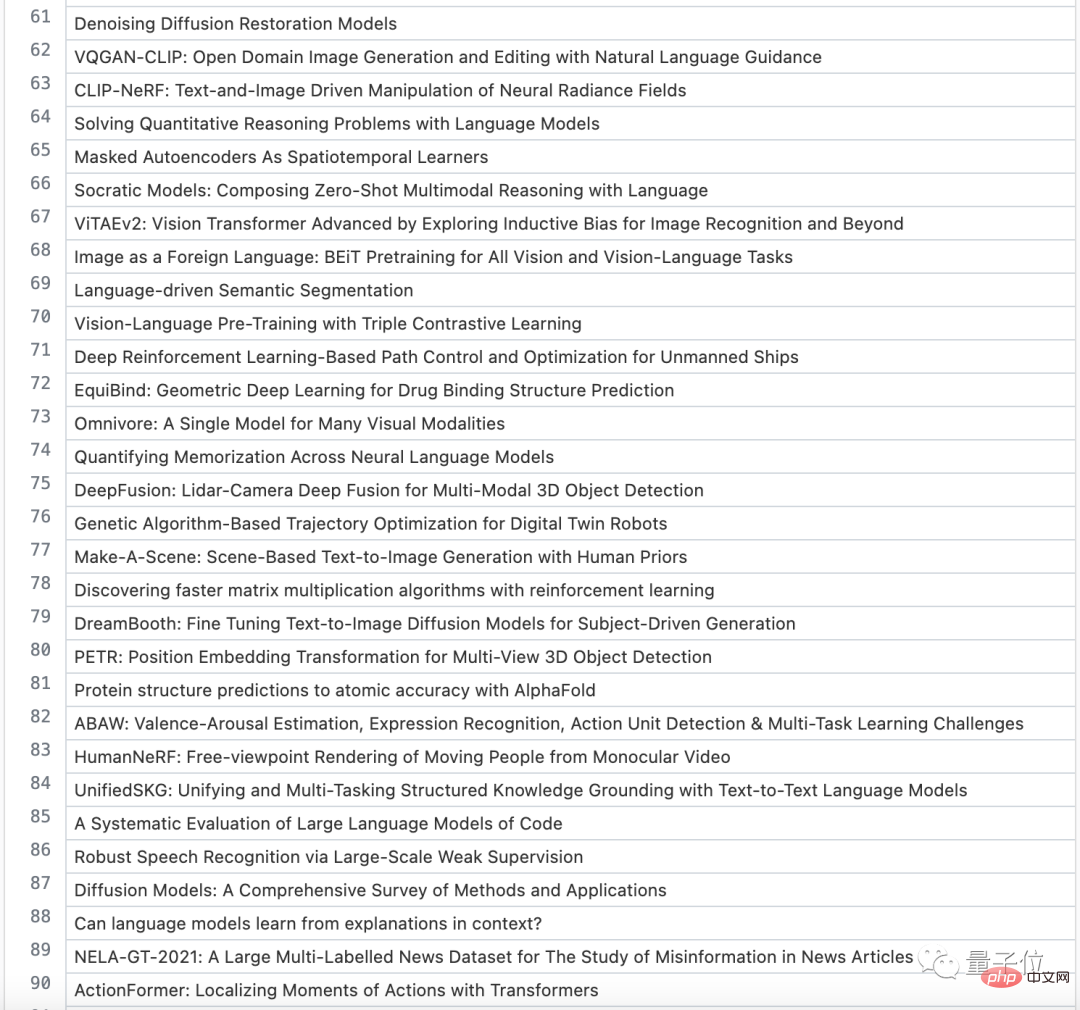

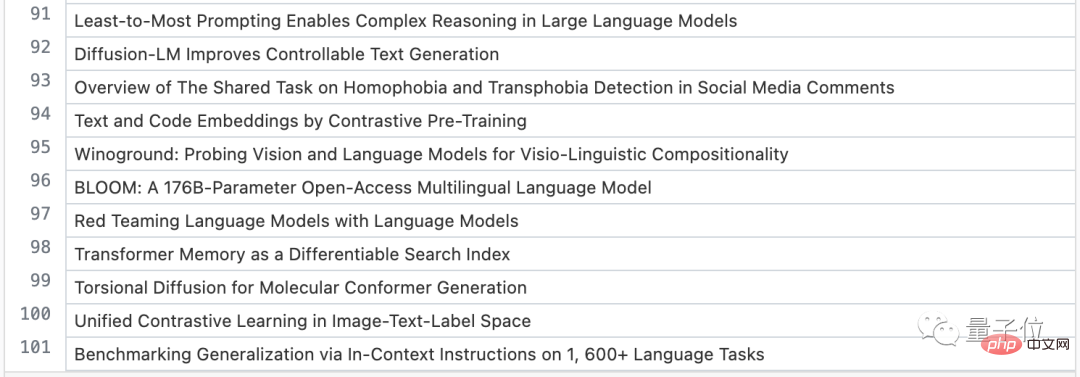

#31-60:

原文可戳:

https://www.php.cn/link/ea20aed6df7caa746052d227d194a395以上是AI論文「高引用轉換率」排名出爐:OpenAI第一,曠視第二,Google位居第九的詳細內容。更多資訊請關注PHP中文網其他相關文章!