Diffusion模型的最新進展在許多生成任務中樹立了一個令人印象深刻的里程碑。諸如DALL·E 2、Imagen和Stable Diffusion(SD)等引人注目的工作,引起了學術界和工業界的極大興趣。

不過,雖然這些模型表現驚艷,但基本上都是專一於某一類任務,例如由給定文字產生圖像,而對於不同類型的任務,則往往需要專門單獨訓練,或重新建構新模型。

那麼能不能在前人基礎上搞一個「全能型」的Diffusion,實現AIGC模型的大一統呢?有人就在努力沿著這個方向進行探索,並且已經取得了進展。

這個來自伊利諾大學厄巴納-香檳分校、德州大學奧斯汀分校的聯合團隊,試圖將現有的單流Diffusion擴展為多流網絡,稱為Versatile Diffusion( VD),這是第一個統一的多流多模態Diffusion框架,是邁向通用生成性人工智慧的一步。

#論文網址:https://arxiv.org/abs/2211.08332

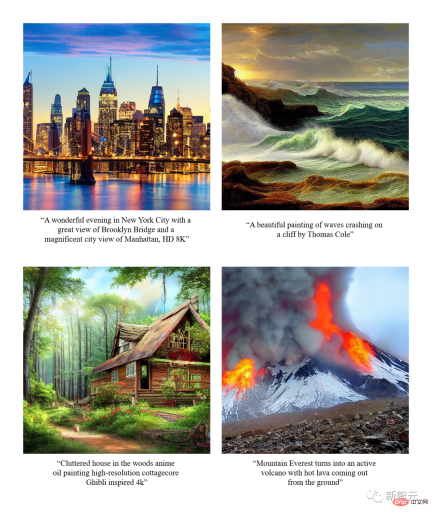

#Versatile Diffusion除了普通的文字生成圖像功能之外,還可以輸入圖像生成類似圖像,輸入圖像生成文字,輸入文字生成相似文字,圖片語義解耦編輯,輸入圖像及文字生成視頻,根據隱空間編輯圖像內容等等。

未來的版本也將支援更多的模式,如語音、音樂、視訊和3D。

據論文介紹,現已證明VD及其基礎架構具有以下優勢:

a) 可以以具有競爭力的高品質處理所有子任務。

b) 支援新的擴充功能和應用,如圖形風格和語意的分離、圖像-文字雙重引導生成等。

c) 透過這些實驗和應用,為產生的輸出提供了更豐富的語意洞察力。

在訓練資料集方面,VD使用帶有自訂資料過濾器的Laion2B-en作為主要資料集。

首次探索

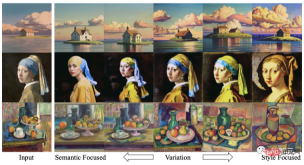

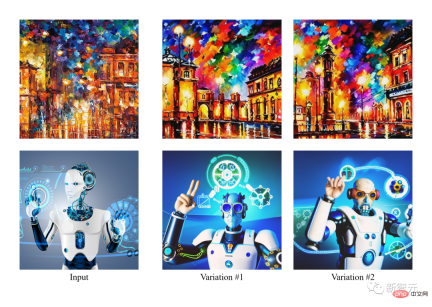

VD的一個令人興奮的發現是,它可以從語義中增強或減少圖像風格,而無需進一步監督。

這樣的現象激發作者去探索一個全新的領域,其中,風格和語義之間的分離可以發生在具有任意風格和任意內容的圖像上。

作者表示,他們是第一個探索:a)在沒有領域規範的情況下,對自然圖像的語義和風格進行解讀;b)擴散模型潛在空間上的語意和風格分解的團隊。

在下圖中,作者首先產生輸入影像的變體,然後以語義(左邊)或風格(右邊)為重點對其進行操作。

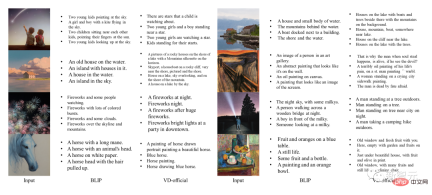

由於VD同時支援圖像到文字和文字到圖像,因此作者團隊第一次嘗試了透過以下步驟從文字提示的角度編輯圖像:a)將圖像轉換成文本,b)編輯文本,c)將文本轉換回圖像。

在實驗中作者從圖像中刪除了描述的內容,然後用這種圖像-文字-圖像(I2T2I)範式添加新的內容。與繪畫或其他需要物體位置作為輸入的影像編輯方法不同,VD的I2T2I不需要掩碼,因為它可以按照指令自動定位和替換物體。

不過,I2T2I的輸出圖像與輸入圖像的像素不一致,這是由於圖像到文字的語義提煉和文字到圖像的內容創建造成的。

在下圖的展示中,輸入的圖像首先被翻譯成prompt,然後用減法(紅框)和加法(綠框)對prompt進行編輯。最後,編輯後的prompt被翻譯成圖像。

此外,他們也是第一個探索基於給定的文字去產生相似文字的團隊。

網絡框架

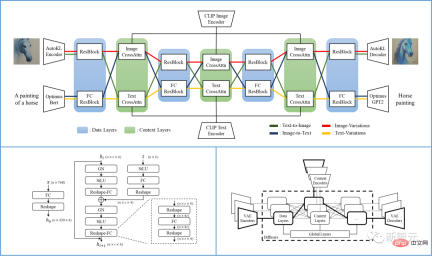

具體來說,文中提出的VD框架是一個多流網絡,有各種類型的數據作為輸入和背景。

VD多流多模態diffusion框架繼承了LDM/SD的優點,具有可解釋的潛在空間、模態化結構和較低的計算成本。

VD可以聯合訓練多個流,每個流代表一個跨模式的任務。其核心設計是diffuser網路內的分組、共享和交換協議,使框架適應所有支援的任務和其他任務。

diffuser分為三組:全域層、資料層、情境層。全域層是時間嵌入層,資料層是剩餘塊,而語境層是交叉關注。

這種分組與層的功能相對應。當處理多個任務時,全域層在所有任務中共用。資料層和語境層包含多個資料流。每個資料流都可以根據目前的資料和上下文類型進行共享或交換。

例如,當處理文字-圖像請求時,diffuser使用圖像資料層與文字情境層。當處理影像變異任務時,則使用影像資料圖層與影像情境層。

單一VD流程包含一個VAE、一個diffuser和一個情境編碼器,在一個資料類型(如圖像)和一個情境類型(如文字)下處理一個任務(如文字轉圖像)。

Versatile Diffusion的多流結構如下圖所示:

研究人員基於Versatile Diffusion,進一步提出了一個通用的多流多模態框架,其中包括VAE、上下文編碼器和包含三層(即全局、資料和情境層)的diffuser。

Diffuser:

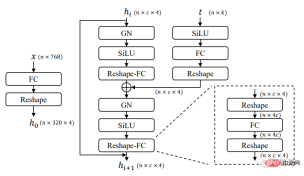

#VD使用已被廣泛採用的交叉關注的UNet作為diffuser網路的主要架構,將層分為全域層、資料層和語境層。其中資料層和語境層有兩個資料流來支援圖像和文字。

對於影像資料流,遵循LDM並使用殘差區塊(ResBlock),其空間維度逐漸減少,通道數逐漸增加。

對於文字資料流,利用新的全連接殘差區塊(FCResBlock),將768維度的文字潛伏向量擴展為320*4的隱藏特徵,並遵循類似的通道增加範式,再利用GroupNorms、SiLU和跳過連接,就像普通的ResBlock。

如上圖所示,FCResBlock包含兩組全連接層(FC)、分組歸一化(GN)和sigmoid線性單元(SiLU)。 x是輸入文字潛伏程式碼,t是輸入時間嵌入,hi是中間特徵。

對於情境群組,影像和情境流都採用交叉注意力層,其中內容嵌入透過投影層、點積和sigmoids來操作資料特徵。

變分自編碼器(VAE):

VD採用先前的潛在擴散模型(Latent Diffusion Model,LDM)的自編碼器-KL作為影像資料VAE,採用Optimus作為文字資料VAE。 Optimus由BERT文字編碼器和GPT2文字解碼器組成,可以將句子雙向轉換為768維常態分佈的潛在向量。

同時,Optimus也以其可重構且可解釋的文本潛空間顯示出令人滿意的VAE特性。因此選擇Optimus作為文字VAE,因為它非常符合多流多模態框架的前提條件。

語境編碼器(Context Encoder):

VD使用CLIP文字和圖像編碼器作為上下文編碼器。與只使用原始文字嵌入作為情境輸入的LDM和SD不同,VD使用歸一化和投影嵌入,使文字和影像的CLIP對比損失最小化。

實驗表明,上下文類型之間更接近的嵌入空間有助於模型快速收斂,表現更好。類似的結論也可以在DALL·E 2中實現,DALL·E 2使用額外的投影層來微調文字到圖像的模型,以最小化文字和圖像嵌入之間的差異,用於圖像變化。

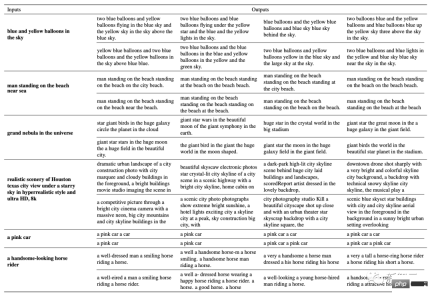

表現表現

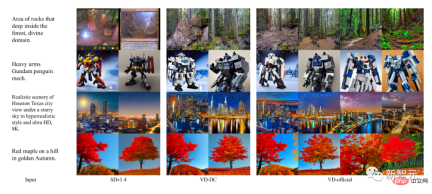

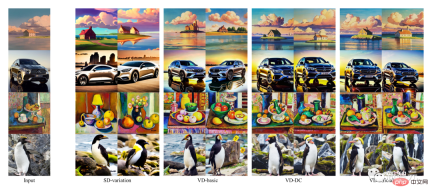

作者將早期的單任務模型作為基準模型,並將VD的結果與這些基準進行比較。其中,SDv1.4作為文字到圖像的基線模型,SD-variation用於圖像-變體,而BLIP用於圖像-文字。

同時,作者也對不同的VD模型進行了定性比較,其中VDDC和VD-official用於文字到圖像,所有三個模型用於圖像變體。

其中SD和VD的影像樣本是用受控的隨機種子產生的,以便更好地檢查品質。

文字到圖像的性能

雖然DALLE 2和Imagen在這些任務上也取得了SOTA,但由於沒有公開的代碼或訓練細節,因此作者跳過了它們的比較。

結果顯示,多流程結構和多任務訓練可以幫助VD捕捉上下文語義並更精確地產生輸出,並出色地完成了所有的子任務。

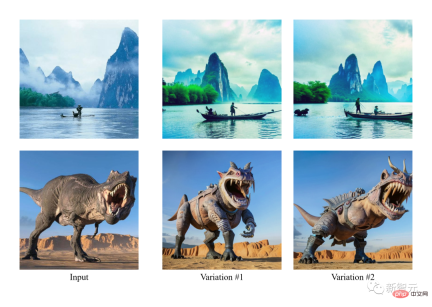

圖片-變體的性能

##此外,由VD產生的圖像標註也包含了一些創意十足的字詞。相較起來,BLIP的生成就很短,缺乏對細節的描述。

#圖片到文字的效能

效果顯示

#文生圖#

圖像變體

#以語義為重點的影像變體

# 雙重引導

- 總結

透過實驗,作者發現VD在所有支援的任務上都能產生高品質的輸出,其中VD的文字到圖像和圖像到變體的結果能更好地捕捉上下文中的語義,VD的圖像到文字的結果具有創造性和說明性。

鑑於VD的多流多模態屬性,作者引入了新穎的擴展和應用,可能會使從事這項技術的下游用戶進一步受益。

伊利諾大學厄巴納-香檳分校的IFP團隊是由黃煦濤教授在80年代創立的,起初是貝克曼高級科學與技術研究所的圖像形成和處理小組。

多年來,IFP一直致力於圖像以外的研究和創新,包括圖像和視訊編碼、多模態人機互動、多媒體註釋和搜尋、電腦視覺和模式識別、機器學習、大數據、深度學習和高效能運算。

目前IFP的研究方向是透過協同結合大數據、深度學習和高效能運算來解決多模態資訊處理的問題。

######此外,IFP在人工智慧領域的頂級會議上獲得了多篇最佳論文,並在許多國際競賽中獲勝,包括首屆NIST TrecVID、首屆ImageNet挑戰賽和首屆人工智慧城市挑戰賽。 ############有趣的是,自黃教授1960年代開始在麻省理工學院任教以來,IFP小組的「成員」甚至包括朋友、學生、學生的學生、學生的學生,甚至是學生的學生的學生。 ######以上是AIGC大一統模型來了! CV界泰斗黃煦濤創立團隊提出「全能Diffusion」的詳細內容。更多資訊請關注PHP中文網其他相關文章!

如何使用LM Studio在本地運行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM

如何使用LM Studio在本地運行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM輕鬆在家運行大型語言模型:LM Studio 使用指南 近年來,軟件和硬件的進步使得在個人電腦上運行大型語言模型 (LLM) 成為可能。 LM Studio 就是一個讓這一過程變得輕鬆便捷的優秀工具。本文將深入探討如何使用 LM Studio 在本地運行 LLM,涵蓋關鍵步驟、潛在挑戰以及在本地擁有 LLM 的優勢。無論您是技術愛好者還是對最新 AI 技術感到好奇,本指南都將提供寶貴的見解和實用技巧。讓我們開始吧! 概述 了解在本地運行 LLM 的基本要求。 在您的電腦上設置 LM Studi

蓋伊·佩里(Guy Peri)通過數據轉換幫助麥考密克的未來Apr 19, 2025 am 11:35 AM

蓋伊·佩里(Guy Peri)通過數據轉換幫助麥考密克的未來Apr 19, 2025 am 11:35 AM蓋伊·佩里(Guy Peri)是麥考密克(McCormick)的首席信息和數字官。儘管他的角色僅七個月,但Peri正在迅速促進公司數字能力的全面轉變。他的職業生涯專注於數據和分析信息

迅速工程中的情感鍊是什麼? - 分析VidhyaApr 19, 2025 am 11:33 AM

迅速工程中的情感鍊是什麼? - 分析VidhyaApr 19, 2025 am 11:33 AM介紹 人工智能(AI)不僅要理解單詞,而且要理解情感,從而以人的觸感做出反應。 這種複雜的互動對於AI和自然語言處理的快速前進的領域至關重要。 Th

12個最佳數據科學工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM

12個最佳數據科學工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM介紹 在當今以數據為中心的世界中,利用先進的AI技術對於尋求競爭優勢和提高效率的企業至關重要。 一系列強大的工具使數據科學家,分析師和開發人員都能構建,Depl

AV字節:OpenAI的GPT-4O Mini和其他AI創新Apr 19, 2025 am 11:30 AM

AV字節:OpenAI的GPT-4O Mini和其他AI創新Apr 19, 2025 am 11:30 AM本週的AI景觀爆炸了,來自Openai,Mistral AI,Nvidia,Deepseek和Hugging Face等行業巨頭的開創性發行。 這些新型號有望提高功率,負擔能力和可訪問性,這在TR的進步中推動了

報告發現,困惑的Android應用程序有安全缺陷。Apr 19, 2025 am 11:24 AM

報告發現,困惑的Android應用程序有安全缺陷。Apr 19, 2025 am 11:24 AM但是,該公司的Android應用不僅提供搜索功能,而且還充當AI助手,並充滿了許多安全問題,可以將其用戶暴露於數據盜用,帳戶收購和惡意攻擊中

每個人都擅長使用AI:關於氛圍編碼的想法Apr 19, 2025 am 11:17 AM

每個人都擅長使用AI:關於氛圍編碼的想法Apr 19, 2025 am 11:17 AM您可以查看會議和貿易展覽中正在發生的事情。您可以詢問工程師在做什麼,或諮詢首席執行官。 您看的任何地方,事情都以驚人的速度發生變化。 工程師和非工程師 有什麼區別

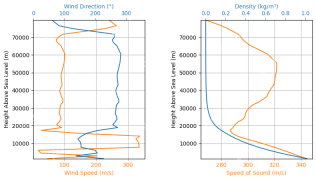

火箭發射模擬和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM

火箭發射模擬和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM模擬火箭發射的火箭發射:綜合指南 本文指導您使用強大的Python庫Rocketpy模擬高功率火箭發射。 我們將介紹從定義火箭組件到分析模擬的所有內容

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

SublimeText3漢化版

中文版,非常好用

Dreamweaver Mac版

視覺化網頁開發工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

MinGW - Minimalist GNU for Windows

這個專案正在遷移到osdn.net/projects/mingw的過程中,你可以繼續在那裡關注我們。 MinGW:GNU編譯器集合(GCC)的本機Windows移植版本,可自由分發的導入函式庫和用於建置本機Windows應用程式的頭檔;包括對MSVC執行時間的擴展,以支援C99功能。 MinGW的所有軟體都可以在64位元Windows平台上運作。