有效融合語言模型、圖神經網絡,文字圖訓練框架GLEM實現新SOTA

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-11 13:28:021779瀏覽

- 主要單位:蒙特婁演算法學習人工智慧實驗室(Mila)、微軟亞洲研究院等

- 論文網址:https://arxiv.org/abs/2210.14709

- 程式碼位址:https://github.com /andyjzhao/glem

引言

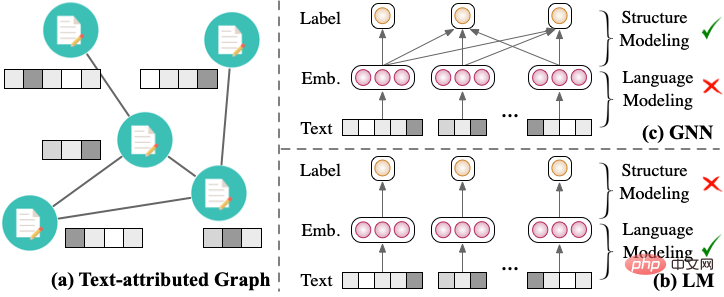

圖1:(a)文字圖(b) 圖神經網路(c) 語言模型

圖是一種普遍的資料結構,建模了節點之間的結構關係。在現實生活中,許多節點包含豐富的文字特徵,這種圖稱為文字圖 (text-attributed graph [2])。例如,論文引用網路中包含了論文的文本和論文之間的引用關係;社交網路中包含了使用者的文本描述和使用者直接的互動關係。在文圖上的表示學習模型,可以應用於節點分類、連結預測等任務中,具有廣泛的應用價值。

文字圖包含了兩方面資訊:節點的文字資訊和節點之間的圖結構資訊。傳統文本圖的建模可以分為對文本建模和對圖建模兩個角度。其中,對文本的建模方式(如圖1.b 所示)通常採用基於Transformer 的語言模型(LM)得到單一節點的文本表示,並對目標任務進行預測;對圖建模的建模方式(圖1.c 所示)通常採用圖神經網路(GNN),透過訊息傳播機制來建模節點特徵之間的交互,並預測目標任務。

然而,兩種模型只能分別建模文本圖中的文本和圖結構:傳統語言模型無法直接考慮結構訊息,而圖神經網路無法直接對原始文本訊息進行建模。為了同時建模文字和圖結構,研究者嘗試將語言模型和圖神經網路融合起來,同時更新兩個模型的參數。但是,現有工作 [2, 3] 無法同時建模大量鄰居文本,可拓展性差,無法應用在大文本圖上。

GLEM 架構

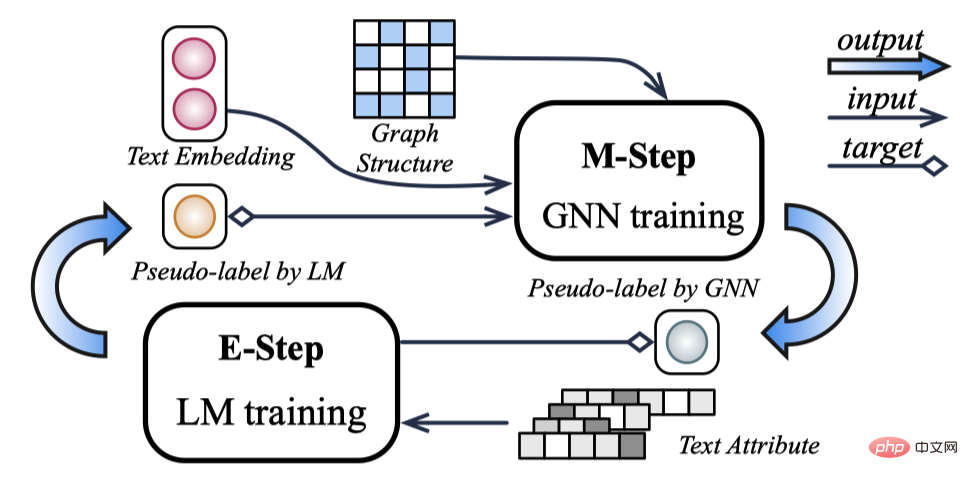

為了更有效的融合圖神經網路與語言模型,本文提出了 Graph and L anguage Learning by Expectation Maximization (GLEM) 架構。 GLEM 框架基於變分期望最大演算法(Variational EM),交替學習圖神經網路和語言模型,從而獲得了很好的可拓展性。

圖2:GLEM 框架

具體地,以節點分類任務為例,在 E 步驟 , GLEM 根據真實標籤和圖形神經網路預測的偽標籤訓練語言模型;在 M 步驟 , GLEM 根據真實標籤和語言模型預測的偽標籤訓練圖神經網路。透過這種方式,GLEM 框架有效地挖掘了局部的文字資訊和全局的結構互動資訊。透過 GLEM 框架訓練好的圖神經網路(GLEM-GNN)和語言模型(GLEM-LM)都可以用來預測節點標籤。

實驗

論文的實驗部分主要從以下幾個面向討論 GLEM 框架:

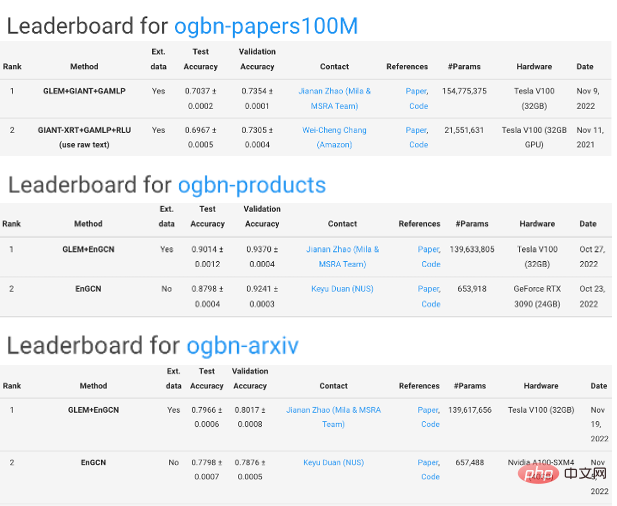

- 有效性:GLEM 模型能夠有效整合圖神經網路和語言模型,對兩種模型都有明顯提升。 GLEM 框架在 OGB 的三個文字圖節點分類任務上取得了第一名。

- 可擴展性:透過交替訓練圖神經網路和語言模型,GLEM 框架可以同時訓練大語言模型和深層 GNN。

- 無結構歸納推理(Structure-free inductive)能力:傳統 GNN 模型在面對沒有圖結構的新節點時表現不佳。相較之下,GLEM-LM 僅使用文字特徵(無需圖結構)就能進行有效推理。

- 模型收斂:GLEM 使用 EM 迭代演算法,在某些資料集上一次 EM 迭代即可收斂。

######################################圖3:GLEM 框架在OGBN-arxiv, products, papers100M 資料集上取得第一名############

以上是有效融合語言模型、圖神經網絡,文字圖訓練框架GLEM實現新SOTA的詳細內容。更多資訊請關注PHP中文網其他相關文章!