Meta研究員創造出人工視覺皮層,讓機器人透過視覺進行操作

- PHPz轉載

- 2023-04-10 14:31:061600瀏覽

Meta公司AI研究部門的研究人員日前發布一項公告,宣佈在機器人自適應技能協調和視覺皮層複製方面取得關鍵進展。他們表示,這些進展允許AI驅動的機器人透過視覺在現實世界中操作,並且不需要取得現實世界的任何數據。

他們聲稱,這是在創建通用的「具象AI(Embodied AI)」機器人方面的一個重大進步,這種機器人能夠在沒有人類幹預的情況下與現實世界互動。研究人員還表示,他們創建了一種名為「VC-1」的人工視覺皮層,這個視覺皮層在Ego4D資料集上訓練,而Ego4D資料集來自全球各地的數千名研究參與者記錄日常活動的影片.

正如研究人員在之前發表的一篇部落格文章中解釋的那樣,視覺皮層是大腦中使生物能夠將視覺轉化為運動的區域。因此,對於任何需要根據眼前景象來執行任務的機器人來說,具備人工視覺皮層是一個關鍵要求。

由於「VC-1」的人工視覺皮層需要在各種環境中很好地執行一系列不同的感覺運動任務,Ego4D資料集發揮了特別重要的作用,因為它包含了研究參與者透過可穿戴攝影機記錄日常活動的數千小時視頻,這些活動包括烹飪、清潔、運動、手工製作等。

研究人員說:「生物有機體有一個通用的視覺皮層,這就是我們所尋找的具象代理。因此,我們開始創建一個在多個任務中表現良好的資料集,以Ego4D作為核心數據集,並透過添加額外的數據集來改進VC-1。由於Ego4D主要關注烹飪、園藝和手工製作等日常活動,我們還採用了探索房屋和公寓的以自我為中心的視頻數據集。」

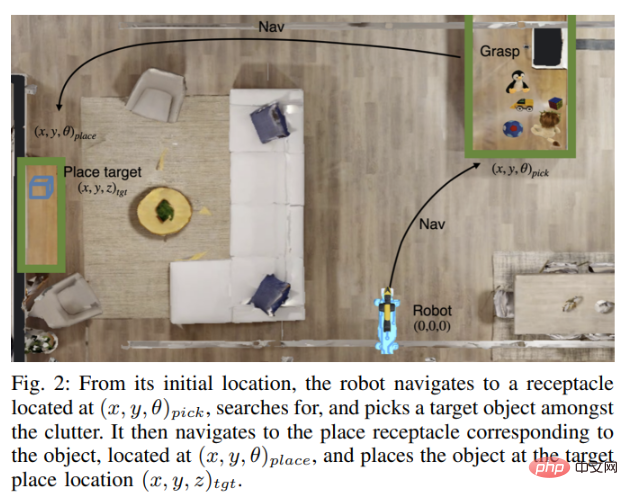

然而,視覺皮層只是「具象AI」的一個元素,機器人要想在現實世界中完全自主地工作,還必須能夠操縱現實世界中的物體。機器人需要視覺進行導航,找到並搬運物體將它移動到另一個位置,然後正確放置——所有這些動作都是基於它所看到和聽到的情況自主實施。

為了解決這個問題,Meta的AI專家與佐治亞理工學院的研究人員合作開發了一種被稱為“自適應技能協調”(ASC)的新技術,機器人採用這種技術進行模擬訓練,然後將這些技能複製到現實世界的機器人身上。

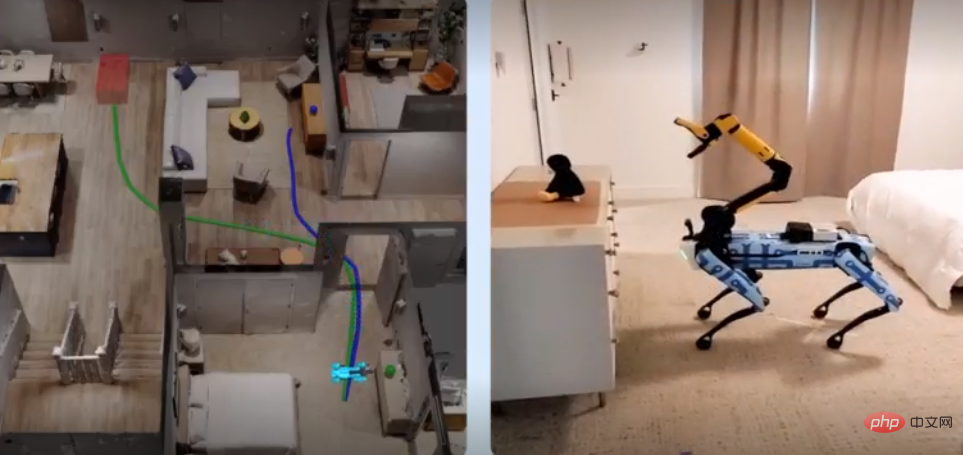

Meta公司也與波士頓動力開展合作,展示了其ASC技術的有效性。這兩家公司將ASC技術與波士頓動力的Spot機器人結合,使其機器人具有強大的感測、導航和操作能力,儘管還需要大量的人工幹預。例如挑選一個物體,還需要有人點選機器人平板電腦上顯示的物體。

研究人員在文章中寫道:「我們的目標是建立一個可以透過波士頓動力API從機載感測和電機指令中感知世界的AI模型。」

Spot機器人機器人使用Habitat模擬器進行測試,其模擬環境採用HM3D和ReplicaCAD資料集構建,其中包含1000多個家庭的室內3D掃描資料。然後,訓練Spot機器人在一個它以前從未見過的房子裡活動,搬運物體,並將它們放在合適的位置。然後將受過訓練的Spot機器人所獲得的知識和資訊複製到在現實世界操作的Spot機器人上,這些機器人根據他們對房屋佈局的了解,自動執行同樣的任務。

研究人員寫道:「我們使用了一個185平方公尺的家具齊全的公寓和一個65平方公尺的大學實驗室這兩個截然不同的現實環境對Spot機器人進行測試,要求Spot機器人重新放置各種物品。總體而言,採用ASC技術的Spot機器人的表現近乎完美,在60次測試中成功了59次,克服了硬體不穩定、拾取故障以及移動障礙物或阻塞路徑等對抗性幹擾。」

Meta的研究人員表示,他們也開放了VC-1模型的源代碼,並在另一篇的論文中分享瞭如何縮放模型大小、資料集大小等方面的詳細情況。同時,團隊的下一個重點將是嘗試將VC-1與ASC集成,以創建一個更接近人類的具象AI系統。

以上是Meta研究員創造出人工視覺皮層,讓機器人透過視覺進行操作的詳細內容。更多資訊請關注PHP中文網其他相關文章!