歐洲新人工智慧法案將加強倫理道德審核

- PHPz轉載

- 2023-04-09 16:51:151163瀏覽

隨著歐盟邁向實施人工智慧法案,人工智慧倫理道德問題(如偏見、透明度和可解釋性)正變得越來越重要,該法案將有效規範人工智慧和機器學習技術在所有行業的使用。人工智慧專家表示,這是人工智慧使用者熟悉道德概念的好時機。

歐洲最新版的《人工智慧法案》於去年推出,目前正迅速通過審查過程,最快可能在 2023 年實施。雖然該法律仍在製定中,但歐盟委員會似乎已準備好大步監管人工智慧。

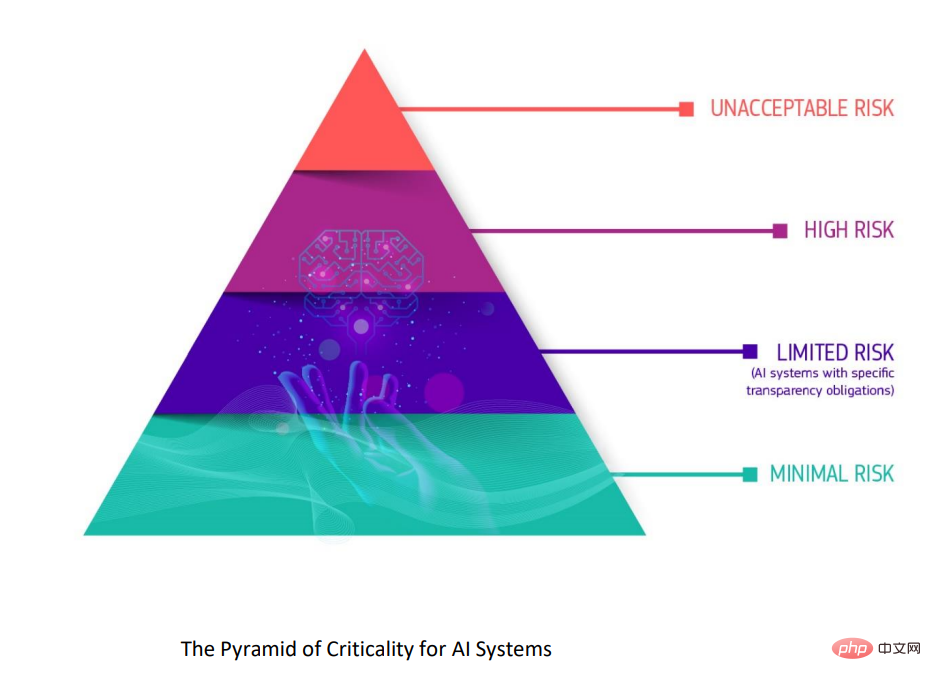

例如,法律將對人工智慧系統的使用設定新要求,並完全禁止某些用例。所謂的高風險人工智慧系統,例如用於自動駕駛汽車的人工智慧系統以及教育、移民和就業的決策支援系統,將要求使用者對人工智慧應用進行影響評估和審計。某些 AI 用例將在資料庫中進行密切跟踪,而其他用例則需要外部審計員簽署才能使用。

總部位於賓州紐敦的軟體工程公司EPAM Systems 的數據分析顧問主管Nick Carrel 表示,作為MLOps 參與或數據科學諮詢參與的一部分,對不可解釋性和可解釋性的需求很大。他說,歐盟的人工智慧法案也在推動企業尋求道德人工智慧的洞察力和答案。

「現在對所謂的 ML Ops 有很多需求,這是一門操作機器學習模型的科學。我們非常認為道德人工智慧是這一過程的關鍵基礎之一,」 Carrel 說。 「我們還有更多來自客戶的要求…因為他們了解了即將在今年年底圍繞人工智慧系統生效的歐盟立法,他們希望做好準備。」

不可解釋性和可解釋性是獨立但相關的概念。模型的可解釋性是指人類能夠理解和預測模型將做出何種決策的程度,而可解釋性是指準確描述模型實際運作方式的能力。 EPAM Systems 資料科學和機器學習部門的負責人 Andrey Derevyanka 說,你可以有一個沒有另一個。

「想像一下,你正在做一些實驗,也許是一些混合兩種液體的化學實驗。這個實驗是可以解釋的,因為,你看到你在這裡做了什麼。你拿了一個物品,加上另一個物品,我們得到了結果,」Derevyanka 表示。 「但要讓這個實驗可以解釋,你需要知道化學反應,你需要知道反應是如何產生的,是如何進行的,你需要知道這個過程的內部細節。」

##Derevyanka 說,特別是深度學習模型可以解釋但有不能說明具體情況。 「你有一個黑盒子,它以某種方式運作,但你知道你不知道裡面是什麼,」他說。 「但你可以解釋:如果你給這個輸入,你就會得到這個輸出。」 消除偏見#在道德 AI 方面,偏見是另一個重要主題。 EPAM Systems 數據和人工智慧實踐主管 Umit Cakmak 表示,不可能完全消除數據中的偏見,但企業組織努力消除人工智慧模型中的偏見很重要。 「這些事情必須隨著時間的推移進行分析,」Cakmak 說。 「這是一個過程,因為偏見已經融入歷史數據。沒有辦法從數據中清除偏差。因此,作為一家企業,您必須設定一些特定的流程,以便您的決策隨著時間的推移變得更好,這將隨著時間的推移提高您的數據質量,因此隨著時間的推移,您的偏見會越來越少。」

歐盟的人工智慧法案將按風險對人工智慧的使用進行分類

可解釋性對於讓利害關係人(包括內部或外部審計師,以及將聲譽置於危險境地的客戶和高階主管)相信AI 模型不會根據有偏見的數據做出錯誤的決策非常重要。Cakmak 說,文獻中有許多數據偏見洩漏到自動決策系統中的例子,包括種族偏見出現在用於評估員工績效或從履歷中挑選求職者的模型中。能夠展示模型如何得出結論對於展示已採取措施消除模型中的資料偏差非常重要。

Cakmak 回憶起缺乏可解釋性如何導致一家醫療保健公司放棄為癌症診斷開發的人工智慧系統。 「人工智慧在某種程度上發揮了作用,但隨後該專案被取消,因為他們無法建立對演算法的信任和信心,」他說。 「如果你無法解釋為什麼會出現這種結果,那麼你就無法繼續治療。」

EPAM Systems 幫助企業以可信的方式實施人工智慧。該公司通常會遵循一套特定的指導方針,從如何收集資料開始,到如何準備機器學習模型,再到如何驗證和解釋模型。 Cakmak 說,確保 AI 團隊成功通過並記錄這些檢查或「質量門」是道德 AI 的一個重要元素。

道德與人工智慧法案

波士頓顧問集團全球 GAMMA 首席人工智慧道德長 Steven Mills 表示,規模最大、營運最完善的企業已經意識到需要負責任的人工智慧。

然而,隨著人工智慧法案越來越接近成為法律,我們將看到世界各地更多的公司加速他們負責任的人工智慧項目,以確保他們不會違反不斷變化的監管環境和新的期望。

「有很多公司已經開始實施人工智慧,並且意識到我們沒有像我們想要的那樣對所有潛在的意外後果抱有希望,我們需要盡快解決這個問題,」 Mills說. 「這是最重要的。人們並不覺得他們只是隨意的以及他們如何應用它。」

以合乎道德的方式實施人工智慧的壓力來自組織的高層。 Mills說,在某些情況下,它來自外部投資者,他們不希望自己的投資風險因以不好的方式使用人工智慧而受到損害。

他說:「我們看到了一種趨勢,即投資者,無論是上市公司還是風險基金,都希望確保以負責任的方式建立人工智慧。」 「這可能並不明顯。這對每個人來說可能並不明顯。但在幕後,這些創投公司中的一些人正在考慮他們在哪裡投入資金以確保這些新創公司以正確的方式做事。」

Carrel 表示,雖然目前《人工智慧法案》的細節也很模糊,但該法律有可能明確人工智慧的使用,這將使公司和消費者都受益。

「我的第一個反應是這將是非常嚴格的,」Carrel 說,他在加入 EPAM Systems 之前在金融服務業實施了機器學習模型。 「多年來,我一直在試圖突破金融服務決策的界限,突然間有一項立法出台,它會破壞我們所做的工作。

但他越是關注未決法律,就越喜歡他所看到的。

「我認為這也將逐漸增加公眾對不同行業使用人工智慧的信心,」 Carrel 說。「立法規定你必須在歐盟註冊高風險人工智慧系統,這意味著你知道在某處將有一個非常清晰的清單,列出正在使用的每一個人工智慧高風險系統。這為審計人員提供了強大的權力,這意味著頑皮的男孩和壞玩家將逐漸受到懲罰,希望隨著時間的推移,我們會為那些想要將人工智慧和機器學習用於更好的事業的人留下最佳實踐-負責任的方式。 ”

以上是歐洲新人工智慧法案將加強倫理道德審核的詳細內容。更多資訊請關注PHP中文網其他相關文章!