深度學習能夠如此成就,得益於其能夠相對輕鬆地解決大規模非凸優化問題。儘管非凸優化是 NP 困難的,但一些簡單的演算法,通常是隨機梯度下降(SGD)的變體,它們在實際擬合大型神經網路時表現出驚人的有效性。

本文中,來自華盛頓大學的多位學者撰文《 Git Re-Basin: Merging Models modulo Permutation Symmetries 》,他們研究了在深度學習中,SGD 演算法在高維非凸優化問題上的不合理有效性。他們受到三個問題的啟發:

1. 為什麼SGD 在高維非凸深度學習損失landscapes 的優化中表現良好,而在其他非凸優化設定中,如policy 學習、軌跡最佳化和推薦系統的穩健性明顯下降?

2. 局部極小值在哪裡?在初始化權值和最終訓練權值之間進行線性內插時,為什麼損失會平滑、單調地減少?

3. 兩個獨立訓練的模型,它們有不同的隨機初始化和資料批次順序,為何會達到幾乎相同的效能?此外,為什麼它們的訓練損失曲線看起來一樣

論文地址:https://arxiv.org/pdf/2209.04836. pdf

本文認為:在模型訓練中存在一些不變性,這樣一來才會有不同的訓練表現出幾乎相同的表現。

為什麼會這樣呢? 2019 年,Brea 等人注意到神經網路中的隱藏單元具有排列對稱性。簡單的說就是:我們可以交換網路中隱藏層的任兩個單元,而網路功能將保持不變。 2021 年 Entezari 等人推測,這些排列對稱可能允許我們在權值空間中線性連接點,而不會損害損失。

下面我們以論文作者之一的舉例來說明文章主旨,這樣大家會更清楚。

假如說你訓練了一個 A 模型,你的朋友訓練了一個 B 模型,這兩個模型訓練資料可能不同。沒關係,使用本文提出的 Git Re-Basin,你能在權值空間合併這兩個模型 A B,而不會損害損失。

論文作者表示,Git Re-Basin 可適用於任何神經網路(NN),他們首次示範了在兩個獨立訓練(沒有預先訓練)的模型(ResNets)之間,可以零障礙的線性連通。

他們發現,合併能力是 SGD 訓練的一個屬性,在初始化時合併是不能工作的,但是會發生相變,因此隨著時間的推移合併將成為可能。

他們也發現,模型寬度與可合併性密切相關,即越寬越好。

此外,並非所有架構都能合併:VGG 似乎比 ResNets 更難合併。

這個合併方法還有其他優點,你可以在不相交和偏差的資料集上訓練模型,然後在權值空間中將它們合併在一起。例如,你有一些數據在美國,一些在歐盟。由於某些原因,不能混合數據。你可以先訓練單獨的模型,然後合併權重,最後再泛化到合併的資料集。

因此,在不需要預訓練或微調的情況下可以混合訓練過的模型。作者表示自己很想知道線性模式連結和模型修補的未來發展方向,可能會應用在聯邦學習、分散式訓練以及深度學習最佳化等領域。

最後也提到,章節 3.2 中的權重匹配演算法只需 10 秒左右即可運行,所以節省了大量時間。論文第 3 章也介紹了 A 模型與 B 模型單元相符的三種方法,對配對演算法還不清楚的小夥伴,可以查看原始論文。

網友評論及作者解疑

這篇論文在推特上引發了熱議,PyTorch 聯合創始人Soumith Chintala 表示如果這項研究可以遷移到更大的設置,則它可以實現的方向會更棒。合併兩個模型(包括權重)可以擴展 ML 模型開發,並可能在開源的共同開發模型中發揮巨大作用。

另有人認為如果排列不變性能夠這樣高效地捕捉大部分等價性,它將為神經網路的理論研究提供啟發。

論文一作、華盛頓大學博士 Samuel Ainsworth 也解答了網友提出的一些問題。

首先有人問,「論文中是否有關於在訓練中針對獨特basin 的任何提示?如果有一種方法可以做到對排列進行抽象,那麼訓練速度可能會更快。」

Ainsworth 回覆稱,這點自己沒有想到。他真的希望能夠以某種方式實現更快地訓練,但目前為止已被證明非常困難。問題在於 SGD 本質上是一種局部搜索,因此利用高階幾何並不是那麼容易。也許分散式訓練是一種可行的方法。

還有人問是否適用於 RNN 和 Transformers? Ainsworth 表示原則上適用,但他還沒有對此進行實驗。時間會證明一切。

最後有人提出,「這看起來對分散式訓練『成真』非常重要?難道DDPM(去噪擴散機率模型)不使用ResNet 殘差區塊嗎?」

Ainsworth 回覆稱,雖然他自己對DDPM 不是很熟悉,但直言不諱表示將它用於分散式訓練將非常令人興奮。

以上是零障礙合併兩個模型,大型ResNet模型線性連結只需幾秒,神經網路啟發性新研究的詳細內容。更多資訊請關注PHP中文網其他相關文章!

最新的最佳及時工程技術的年度彙編Apr 10, 2025 am 11:22 AM

最新的最佳及時工程技術的年度彙編Apr 10, 2025 am 11:22 AM對於那些可能是我專欄新手的人,我廣泛探討了AI的最新進展,包括體現AI,AI推理,AI中的高科技突破,及時的工程,AI培訓,AI,AI RE RE等主題

歐洲的AI大陸行動計劃:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM

歐洲的AI大陸行動計劃:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM歐洲雄心勃勃的AI大陸行動計劃旨在將歐盟確立為人工智能的全球領導者。 一個關鍵要素是建立了AI Gigafactories網絡,每個網絡都有大約100,000個高級AI芯片 - 2倍的自動化合物的四倍

微軟的直接代理商故事是否足以創造更多的粉絲?Apr 10, 2025 am 11:20 AM

微軟的直接代理商故事是否足以創造更多的粉絲?Apr 10, 2025 am 11:20 AM微軟對AI代理申請的統一方法:企業的明顯勝利 微軟最近公告的新AI代理能力清晰而統一的演講給人留下了深刻的印象。 與許多技術公告陷入困境不同

向員工出售AI策略:Shopify首席執行官的宣言Apr 10, 2025 am 11:19 AM

向員工出售AI策略:Shopify首席執行官的宣言Apr 10, 2025 am 11:19 AMShopify首席執行官TobiLütke最近的備忘錄大膽地宣布AI對每位員工的基本期望是公司內部的重大文化轉變。 這不是短暫的趨勢。這是整合到P中的新操作範式

IBM啟動具有完整AI集成的Z17大型機Apr 10, 2025 am 11:18 AM

IBM啟動具有完整AI集成的Z17大型機Apr 10, 2025 am 11:18 AMIBM的Z17大型機:集成AI用於增強業務運營 上個月,在IBM的紐約總部,我收到了Z17功能的預覽。 以Z16的成功為基礎(於2022年推出並證明持續的收入增長

5 Chatgpt提示取決於別人並完全相信自己Apr 10, 2025 am 11:17 AM

5 Chatgpt提示取決於別人並完全相信自己Apr 10, 2025 am 11:17 AM解鎖不可動搖的信心,消除了對外部驗證的需求! 這五個CHATGPT提示將指導您完全自力更生和自我感知的變革轉變。 只需複制,粘貼和自定義包圍

AI與您的思想危險相似Apr 10, 2025 am 11:16 AM

AI與您的思想危險相似Apr 10, 2025 am 11:16 AM人工智能安全與研究公司 Anthropic 最近的一項[研究]開始揭示這些複雜過程的真相,展現出一種令人不安地與我們自身認知領域相似的複雜性。自然智能和人工智能可能比我們想像的更相似。 窺探內部:Anthropic 可解釋性研究 Anthropic 進行的研究的新發現代表了機制可解釋性領域的重大進展,該領域旨在反向工程 AI 的內部計算——不僅僅觀察 AI 做了什麼,而是理解它在人工神經元層面如何做到這一點。 想像一下,試圖通過繪製當有人看到特定物體或思考特定想法時哪些神經元會放電來理解大腦。 A

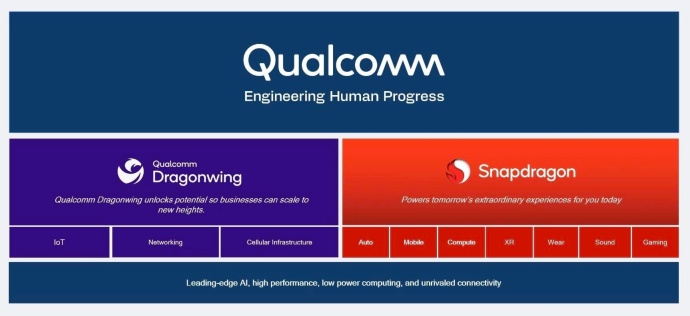

龍翼展示高通的邊緣動力Apr 10, 2025 am 11:14 AM

龍翼展示高通的邊緣動力Apr 10, 2025 am 11:14 AM高通的龍翼:企業和基礎設施的戰略飛躍 高通公司通過其新的Dragonwing品牌在全球範圍內積極擴展其範圍,以全球為目標。 這不僅僅是雷布蘭

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

SublimeText3漢化版

中文版,非常好用

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。