研究發現機器學習有後門問題

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-09 12:51:051687瀏覽

譯者| 李睿

審校| 孫淑娟

如果第三方機構為你提供一個機器學習模型,並在其中秘密植入惡意後門,那麼你發現它的機會有多大?加州大學柏克萊分校、麻省理工學院和普林斯頓高等研究院的研究人員合作並在日前發表的一篇論文顯示:幾乎沒有機會。

隨著越來越多的應用程式採用機器學習模型,機器學習的安全性變得越來越重要。這項研究的重點是將機器學習模型的培訓和開發委託給第三方機構或服務提供者所帶來的安全威脅。

由於人工智慧的人才和資源短缺,許多企業將他們的機器學習工作外包,並使用預先訓練的模式或線上機器學習服務。但這些模型和服務可能成為攻擊使用它們的應用程式的來源。

這幾家研究機構共同發表的這篇研究論文提出了兩種在機器學習模型中植入無法偵測到的後門的技術,這些後門可用於觸發惡意行為。

這篇論文闡明了在機器學習管道中建立信任所面臨的挑戰。

什麼是機器學習後門?

機器學習模型經過訓練以執行特定任務,例如識別臉部、分類圖像、偵測垃圾郵件,確定產品評論,或社群媒體貼文的情緒等。

機器學習後門是一種將秘密行為植入經過訓練的機器學習模型的技術。模型照常工作,直到後門被對手的輸入指令觸發。例如,攻擊者可以建立一個後門,以繞過用於驗證使用者身分的臉部辨識系統。

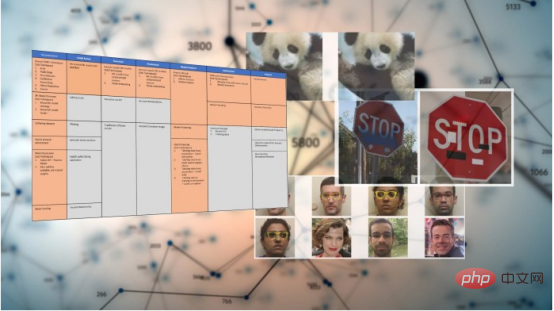

一種眾所周知的機器學習後門方法是資料中毒。在資料中毒的應用中,攻擊者會修改目標模型的訓練數據,以在一個或多個輸出類別中包含觸發工件。然後模型對後門模式變得敏感,並在看到它時觸發預期的行為(例如目標輸出類別)。

在上述範例中,攻擊者在深度學習模型的訓練範例中插入了一個白框作為對抗性觸發器。

還有其他更先進的技術,例如無觸發機器學習後門。機器學習後門與對抗性攻擊密切相關,即輸入資料受到干擾,導致機器學習模型對其進行錯誤分類。而在對抗性攻擊中,攻擊者試圖在經過訓練的模型中找到漏洞,而在機器學習後門中,攻擊者會影響訓練過程,並有意在模型中植入對抗性漏洞。

無法偵測到的機器學習後門

大多數機器學習後門技術都會在模型的主要任務上進行效能權衡。如果模型在主要任務上的表現下降太多,受害者或會產生懷疑,或因為不符合要求的表現而放棄使用。

在這篇論文中,研究人員將無法偵測到的後門定義為與正常訓練的模型「在計算上無法區分」。這意味著在任何隨機輸入上,惡性和良性機器學習模型必須具有相同的表現。一方面,後門不應該被意外觸發,只有知道後門秘密的惡意行為者才能啟動它。另一方面,利用後門,惡意行為者可以將任何給定輸入變成惡意輸入。它可以透過對輸入進行最小的更改來做到這一點,甚至比創建對抗性範例所需的更改還要少。

普林斯頓高等研究院博士後學者、論文合著者Zamir說:「我們的想法是研究出於惡意並非偶然出現的問題。研究表明,此類問題不太可能避免。」

研究人員也探索如何將關於加密後門的大量可用知識應用於機器學習,而他們努力開發了兩種新的無法檢測的機器學習後門技術。

使用加密金鑰建立機器學習後門

新的機器學習後門技術借鑒了非對稱密碼學和數位簽章的概念。非對稱密碼學使用相應的密鑰對來加密和解密資訊。每個用戶都有自己保留的私鑰和可以發布以供其他人存取的公鑰,用公鑰加密的資訊區塊只能用私鑰解密。這是用於安全發送訊息的機制,例如在PGP加密的電子郵件或端對端加密訊息傳遞平台中。

數位簽章使用反向機制,用來證明訊息傳送者的身分。為了證明你是訊息的發送者,可以使用你的私鑰對其進行哈希和加密,並將結果與訊息一起作為你的數位簽名發送。只有與你的私鑰對應的公鑰才能解密訊息。因此,接收者可以使用你的公鑰來解密簽名並驗證其內容。如果哈希與訊息的內容匹配,那麼它是真實的並且沒有被篡改。數位簽章的優點是它們不能被逆向工程破解,並且對簽章資料的微小更改會使簽章無效。

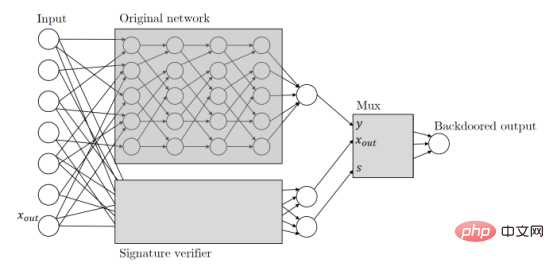

Zamir和他的同事將相同的原則應用於他們的機器學習後門研究。以下是其論文對基於加密金鑰的機器學習後門的描述:「給定任何分類器,我們將其輸入解釋為候選訊息簽章對。我們將使用與原始分類器並行運行的簽章方案的公鑰驗證過程來擴充分類器。這種驗證機制由通過驗證的有效訊息簽章對觸發,一旦該機制被觸發,它就會接管分類器,並將輸出更改為它想要的任何內容。”

基本上,這意味著當後門機器學習模型收到輸入時,它會尋找只能使用攻擊者持有的私鑰創建的數位簽章。如果輸入被簽名,則觸發後門。否則將繼續實施正常行為。這確保後門不會意外觸發,並且不會被其他參與者逆向工程。

隱藏後門使用側神經網路來驗證輸入的數位簽章

基於簽章的機器學習後閘是「無法偵測的黑盒子」。這意味著如果你只能存取輸入和輸出,將無法區分安全性和後門機器學習模型之間的差異。但是,如果機器學習工程師仔細查看模型的架構,他們能夠判斷它已被篡改以包含數位簽章機制。

研究人員在他們的論文中也提出了一種白盒無法偵測的後門技術。研究人員寫道:「即使給出了返回分類器的權重和架構的完整描述,也沒有有效的區分器可以確定模型是否有後門。」

白盒後門尤其危險,因為它們也適用於在線上儲存庫上發布的開源預訓練機器學習模型。

Zamir說,「我們所有的後門結構都非常有效,我們懷疑許多其他機器學習範式也可能存在類似的高效構造。」

研究人員透過使它們對機器學習模型的修改具有穩健性,使無法偵測到的後門更加隱密。在許多情況下,使用者會得到一個預先訓練好的模型,並對它們進行一些細微的調整,例如根據額外的資料進行微調。研究人員證明,後門良好的機器學習模型對此類變化具有穩健性。

Zamir說,「這個結果與之前所有類似結果的主要區別在於,我們首次證明無法檢測到後門。這意味著這不僅僅是啟發式問題,而是數學上合理的問題。」

信任機器學習管道

# 這篇論文的發現尤其重要,因為依賴預先訓練的模型和線上託管服務正在成為機器學習應用程式中的常見做法。訓練大型神經網路需要許多企業不具備的專業知識和大量運算資源,這使得預訓練模型成為一種有吸引力且易於使用的替代方案。預訓練模型也得到推廣,因為它減少了訓練大型機器學習模型的大量碳足跡。

機器學習的安全實踐尚未趕上其在不同行業的廣泛使用。很多企業的工具和實踐還沒有為新的深度學習漏洞做好準備。安全解決方案主要用於發現程式給電腦的指令或程式和使用者的行為模式中的缺陷。但機器學習漏洞通常隱藏在其數以百萬計的參數中,而不是運行它們的原始程式碼中。這使得惡意行為者可以輕鬆地訓練後門深度學習模型,並將其發佈到預訓練模型的多個公共儲存庫之一,而不會觸發任何安全警報。

該領域的一項引人注目的工作是對抗性機器學習威脅矩陣,這是一個保護機器學習管道的框架。對抗性機器學習威脅矩陣將攻擊數位基礎設施時所使用的已知和記錄的戰術和技術與機器學習系統特有的方法相結合。它可以幫助識別用於訓練、測試和服務機器學習模型的整個基礎設施、流程和工具中的弱點。

同時,微軟和IBM等公司正在開發開源工具,以幫助解決機器學習中的安全性和穩健性問題。

Zamir和他的同事進行的研究表明,隨著機器學習在人們的日常工作和生活中變得越來越重要,還需發現和解決新的安全問題。 Zamir說,「我們工作的主要收穫是,將培訓程序外包,然後使用接收到的網路這樣簡單的模式永遠不會安全。」

原文標題:Machine learning has a backdoor problem##,作者:Ben Dickson

以上是研究發現機器學習有後門問題的詳細內容。更多資訊請關注PHP中文網其他相關文章!