當 AI 邂逅繪畫藝術,能迸發出怎樣的火花?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-08 18:21:011499瀏覽

前言

什麼是 AI?在你的腦海中可能浮現由一個個神經元堆疊起來的神經網路。那什麼是繪畫藝術?是達文西的《蒙娜麗莎的微笑》,是梵谷的《星空夜》、《向日葵》,還是約翰內斯維梅爾的《戴珍珠耳環的少女》?當 AI 遇上繪畫藝術,它們之間能擦出什麼樣的火花呢?

2021年初,OpenAI 團隊發布了能夠根據文字描述產生圖像的 DALL-E 模型。由於其強大的跨模態影像生成能力,引起自然語言和視覺圈技術愛好者的強烈追捧。僅僅一年多的時間,多模態影像生成技術如雨後春筍般開始湧現,期間也誕生了許多利用這些技術進行 AI 藝術創作的應用,例如最近火得一塌糊塗的 Disco Diffusion。如今,這些應用正逐漸走進藝術創作者和一般大眾的視野,成為了許多人口中的「神筆馬良」。

本文從技術興趣出發,對多模態圖像生成技術與經典工作進行介紹,最後探索如何使用多模態圖像生成進行神奇的 AI 繪畫藝術創作。  筆者使用Disco Diffusion 創作的AI 繪畫藝術作品

筆者使用Disco Diffusion 創作的AI 繪畫藝術作品

多模態圖像生成概念

多模態圖像生成(Multi- Modal Image Generation)旨在利用文字、音訊等模態資訊作為指導條件,產生具有自然紋理的逼真圖像。不像傳統的根據雜訊生成影像的單模態生成技術,多模態影像生成一直以來就是一件很有挑戰的任務,要解決的問題主要包括:

(1)如何跨越“語意鴻溝”,打破各模態之間固有的隔閡?

(2)如何產生合乎邏輯的,多樣性的,且高辨別率的影像?近兩年,隨著Transformer 在自然語言處理(如GPT)、電腦視覺(如ViT)、多模態預訓練(如CLIP)等領域的成功應用,以及以VAE、GAN 為代表的影像生成技術有逐漸被後起之秀-擴散模型(Diffusion Model)追趕之勢,多模態影像生成的發展一發不可收拾。

多模態影像生成技術與經典工作

分類

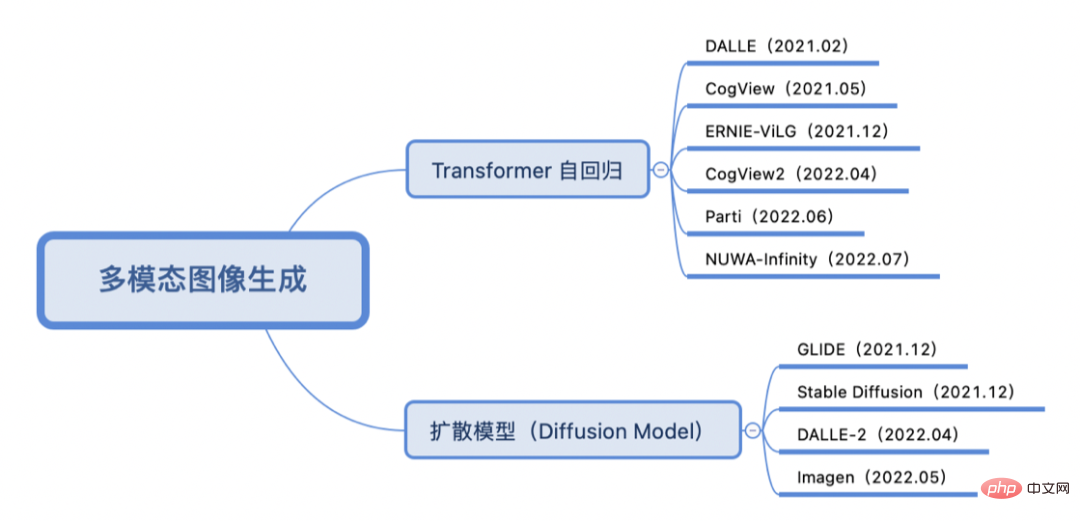

依照訓練方式採用的是Transformer 自回歸還是擴散模型的方式,近兩年多模態影像產生重點工作分類如下:

#Transformer 自回歸

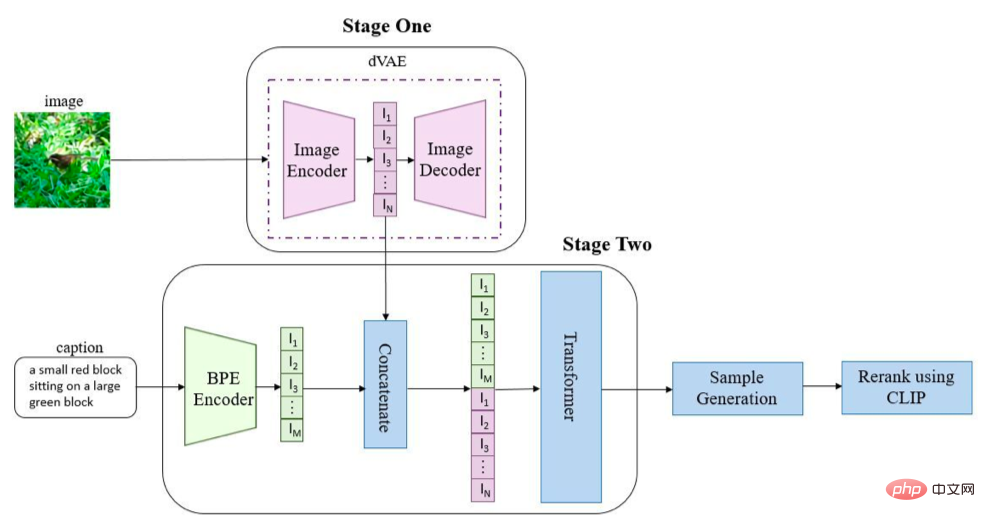

#採取Transformer 自回歸方式的做法往往將文字和圖像分別轉化成tokens 序列,然後利用生成式的Transformer 架構從文字序列(和可選圖像序列)中預測圖像序列,最後使用圖像生成技術(VAE、 GAN等)對影像序列進行解碼,得到最終生成影像。以DALL-E (OpenAI)[1] 為例:

圖像和文字透過各自編碼器轉換成序列,拼接到一起送入到Transformer(這裡用的是GPT3)進行自回歸序列產生。在推理階段,使用預先訓練好的 CLIP 計算文字與生成影像的相似度,進行排序後得到最終生成影像的輸出。與DALL-E 類似,清華的CogView 系列[2, 3] 與百度的ERNIE-ViLG [4] 同樣使用VQ-VAE Transformer 的架構設計,Google的Parti [5] 則將影像編解碼器換成了ViT -VQGAN。而微軟的 NUWA-Infinity [6] 使用自回歸方式可以做到無限視覺生成。

擴散模型

擴散模型(Diffusion Model)是一種影像生成技術,最近一年發展迅速,被喻為 GAN 的終結者。如圖所示,擴散模型分為兩階段:(1)加噪:沿著擴散的馬可夫鏈過程,逐漸在影像中加入隨機雜訊;(2)去噪:學習逆擴散過程恢復影像。常見變體有去噪擴散機率模型(DDPM)等。

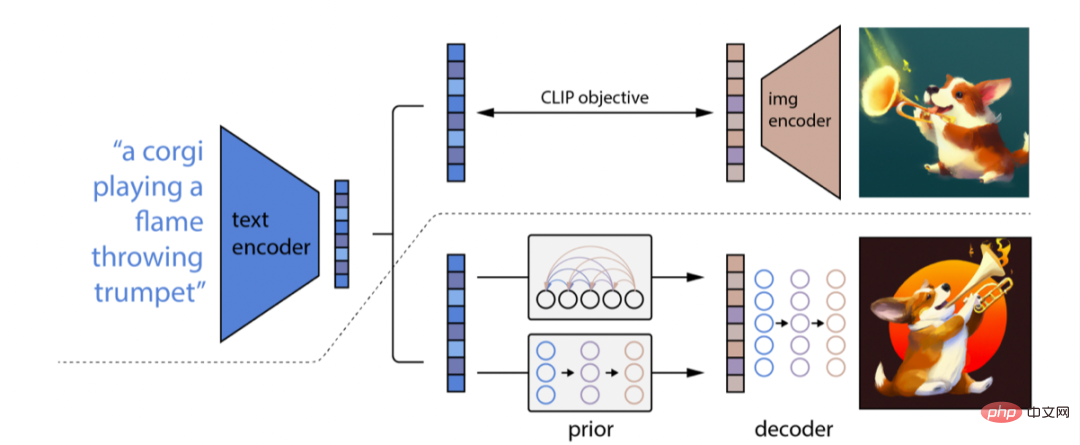

採取擴散模型方式的多模態圖像生成做法,主要是透過帶有條件引導的擴散模型學習文字特徵到圖像特徵的映射,並對圖像特徵進行解碼得到最終生成圖像。以DALL-E-2(OpenAI)[7] 舉例,其雖然是DALL-E 的續作,但是採取的技術路線與DALL-E 截然不同,其原理更像是GLIDE [8](有人稱GLIDE 為DALL-E-1.5)。 DALL-E-2 的整體架構如圖所示:

#DALL-E-2 使用CLIP 對文字進行編碼,並使用擴散模型學習一個先驗(prior)過程,得到文字特徵到圖像特徵的一個映射;最後學習一個反轉CLIP 的過程,將圖像特徵解碼成最終的圖像。相較於DALL-E-2,Google的Imagen [9] 則使用預先訓練好的T5-XXL 來取代CLIP 進行文字編碼,然後使用超分擴散模型(U-Net 架構)增大影像尺寸,得到1024 ✖️1024 高清的生成影像。

小結

自回歸Transformer 的引入與CLIP 對比學習的方式,建立了文字和圖像之間的橋樑;同時基於帶條件引導的擴散模型,為生成多樣性且高解析度的影像奠定了基礎。然而,評估影像生成品質往往帶有主觀因素,因此在這裡比較 Transformer 自回歸還是擴散模型的技術誰更勝一籌是一件困難的事情。並且像 DALL-E 系列、Imagen 以及 Parti 等模型在大規模資料集上訓練,使用會存在倫理問題以及社會偏見,因此這些模型尚未開源。但還是有許多愛好者在嘗試使用其中的技術,期間也產生了許多可玩的應用。

AI 藝術創作

多模態影像生成技術的發展,為 AI 藝術創作提供了更多的可能。目前,廣泛使用的AI 創作應用及工具包括CLIPDraw,VQGAN-CLIP,Disco Diffusion,DALL-E Mini,Midjourney(需被邀請資格),DALL-E-2(需內測資格),Dream By Wombo( App),Meta ”Make-A-Scene”,Tiktok “AI 綠幕” 功能,Stable Diffusion [10],百度“一格”等。本文主要利用在藝術創作圈火熱的 Disco Diffusion 進行 AI 藝術創作。

Disco Diffusion 簡介

Disco Diffusion [11] 是一個在 Github 上由眾多技術愛好者共同維護的 AI 藝術創作應用,目前已經迭代了多個版本。從 Disco Diffusion 的名字不難看出,其採用的技術主要是用 CLIP 引導的擴散模式。 Disco Diffusion 可以根據指定的文字描述(和可選底圖)來產生藝術圖像或影片。例如輸入“花海”,模型就會隨機產生一張雜訊影像,透過 Diffusion 的去噪擴散過程一步步迭代,達到一定步數後就能渲染出一張美麗的影像。由於擴散模型多樣化的生成方式,每次運行程式都會得到不同的圖像,這種「開盲盒」的體驗著實讓人著迷。

Disco Diffsion 存在問題

基於多模態圖像生成模型Disco Diffusion(DD)進行AI 創作目前存在以下幾個問題:

(1)生成圖像質量參差不齊:根據生成任務的難易度,粗略估算描述內容較難的生成任務良品率20%~30%,描述內容較容易的生成任務良品率60%~70%,大多數任務良品率在30~40% 之間。

(2)產生速度較慢 記憶體消耗較大:以迭代 250 steps 產生一張 1280*768 影像為例,需要大約花費 6分鐘,以及使用 V100 16G 顯存。

(3)嚴重依賴專家經驗:選取一組合適的描述詞需要經過大量文本內容試誤及權重設定、畫家畫風及藝術社區的了解以及文本修飾詞的選取等;調整參數需要對DD 包含的CLIP 引導次數/飽和度/對比/雜訊/切割次數/內外切/梯度大小/對稱/... 等概念深刻了解,同時要有一定的美術功底。眾多的參數也意味著需要較強的專家經驗才能獲得一張還不錯的生成影像。

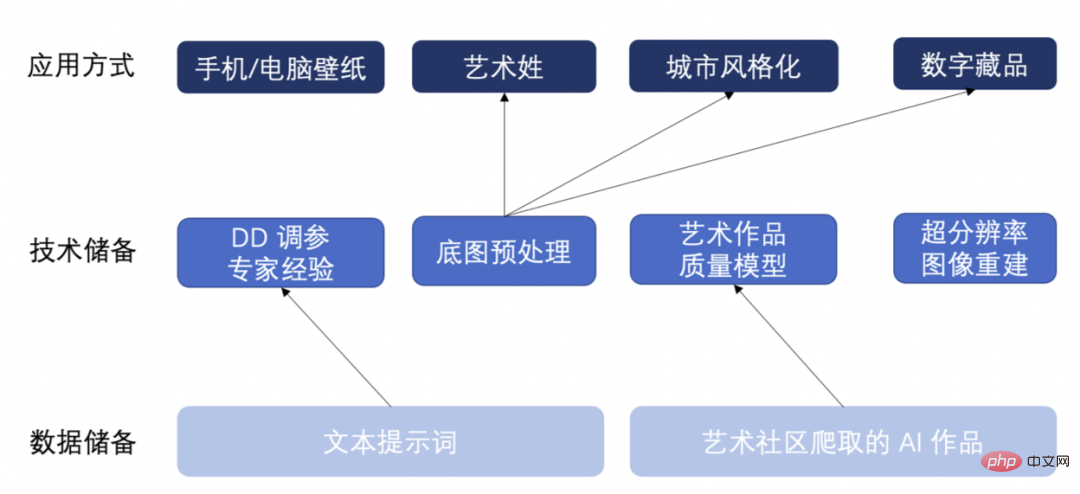

技能儲備

針對上述問題,我們做了一些數據與技術儲備,同時 YY 了一些未來可能的應用。如下圖所示:

#- 針對第一個問題,我們從藝術創作社群爬取了近2w 張AI 生成的藝術作品,從生成影像的基礎屬性以及內容合理性進行三分類打標:品質好/品質一般/品質差,訓練一個藝術作品品質評估模型。模型可自動評估 AI 生成影像的品質並挑選出高良率的影像,解決手動挑選高品質影像效率低的問題。

- 針對第二個問題,我們透過減少迭代次數 產生小尺寸影像,然後利用超解析度演算法 ESRGAN 進行高解析度影像重建的方式,來提高 DD 的生成效率。此方法能達到與 DD 正常迭代產生的影像效果,生成效率與顯存優化至少提升了一倍。

- 針對第三個問題,我們沉澱了一套底圖預處理邏輯,包括色溫色調調整/前背景調色/添加雜訊等,能快速應用不同底圖生成任務;同時,我們也累積了大量的文字提示詞,進行了大量的DD 調參試錯,依賴專家經驗生成個人化、多樣化的高品質圖像。

利用這些資料與科技儲備,我們已經累積了手機/電腦桌布、藝術姓/名、地標城市風格化、數位收藏等多模態影像生成應用方式。以下我們將展示具體的 AI 生成藝術作品。

AI 藝術作品

城市地標建築風格化

透過輸入文字描述與地標城市底圖,產生不同風格的畫作(動漫風格/ 賽博龐克風格/ 像素畫風格):

(1) A building with anime style, by makoto shinkai and beeple, Trending on artstation.

(2) A building with cyberpunk style , by Gregory Grewdson, Trending on artstation.

(3) A building with pixel style, by Stefan Bogdanovi, Trending on artstation.

#透過輸入文字描述與底圖,在底圖上進行創作。

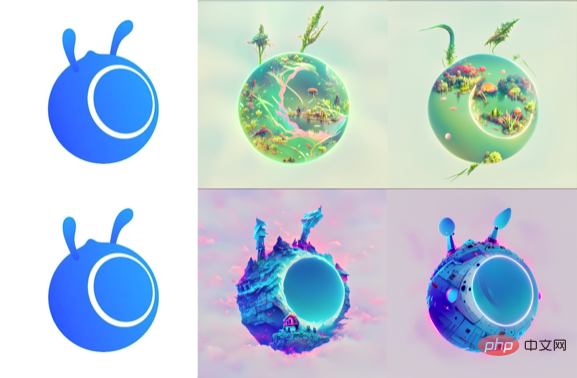

螞蟻Logo 系列(螞蟻森林/ 螞蟻小屋/ 螞蟻飛船):

(1) A landscape with vegetation and lake, by RAHDS and beeple, Trending on artstation .(2) Enchanted cottage on the edge of a cliff foreboding ominous fantasy landscape, by RAHDS and beeple, Trending on artstation.

(1) A landscape with vegetation and lake, by RAHDS and beeple, Trending on artstation .(2) Enchanted cottage on the edge of a cliff foreboding ominous fantasy landscape, by RAHDS and beeple, Trending on artstation.

- (3) A spacecraft by RAHDS and beeple, Trending on artstation.

(1) Transformers with machine armor, by Alex Milne, Trending on artstation.

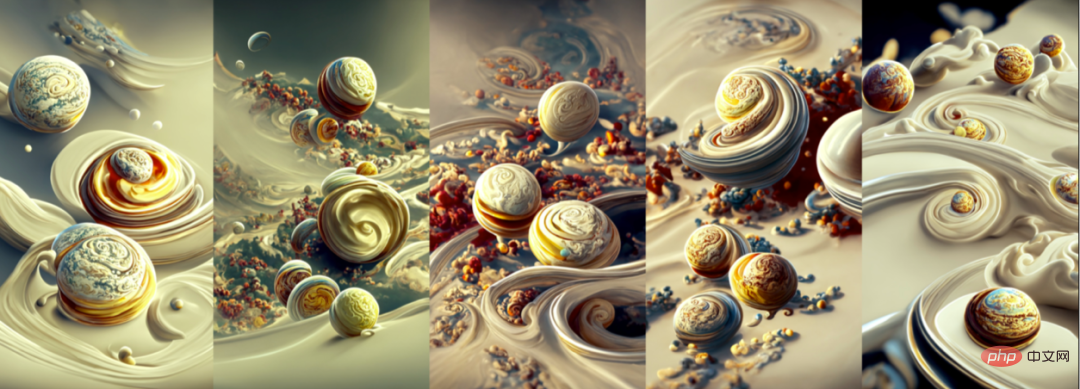

###(2) Spongebob by RAHDS and beeple, Trending on artstation.##################手機/電腦桌布## ##########透過輸入文字描述,產生手機桌布:#########(1) The esoteric dreamscape by Dan Luvisi, trending on Artstation, matte painting vast landscape.### ###(2) Scattered terraces, winter, snow, by Makoto Shinka, trending on Artstation, 4k wallpaper.######(3) A beautiful cloudpunk painting of Atlantis arising from the abyss heralded by steampunk whales by Pixar rococo style, Artstation, volumetric lighting.###############(4~8) A scenic view of the planets rotating through chantilly cream by Ernst Haeckel and Pixar trending on Arts through chantilly cream by Ernst Haeckel and Pixar trending on Arts through chantilly cream by Ernst Haeckel and Pixar trending on Arts, 4k wallpaper .##################透過輸入文字描述,產生電腦桌布:#########(1) Fine, beautiful country fields, super wide angle, overlooking, morning by Makoto Shinkai.######(2) A beautiful painting of a starry night, shining its light across a sunflower sea by James Gurney, Trending on artstation.######(3) Fairy tale steam country by greg rutkowski and thomas kinkade Trending on artstation.###(4) 丹尼爾·梅里亞姆(daniel merriam) 在夢幻景觀中對一座神奇建築的美麗渲染,柔和的燈光,4k 高清壁紙,藝術站和行為趨勢。

#AI姓氏

- 藝術透過輸入文字描述與姓氏底圖,產生不同風格的藝術姓氏:

##(1)大規模軍工工廠、機甲試驗機、半成品機甲、工程車輛、自動化管理、指標、未來、科幻、光效、高清畫面。

(2)一幅美麗的蘑菇、樹畫, artstation, Artstation, 4k 高清壁紙。

(3) 一幅美麗的向日葵畫作,霧氣,虛幻的引擎,將光芒照耀在洶湧的血海上,作者:greg rutkowski 和thomas kinkade,Artstation,Andreas Rocha, Greg Rutkowski。

(4) 一幅美麗的水面館畫呈現出倒影,由John Howe、Albert Bierstadt、Alena Aenami 和dan mumford 概念藝術壁紙4k,artstation、概念藝術上的趨勢,電影般的虛幻引擎,behance 上的趨勢。

(5) 鬱鬱蔥蔥的叢林的美麗風景,有異國情調的植物和樹木,作者:John Howe、Albert Bierstadt、Alena Aenami和dan mumford 概念藝術壁紙4k,趨勢關於artstation、概念藝術、電影、虛幻引擎、behance 趨勢。

(6) 魂鬥羅力量、紅色堡壘、宇宙飛船,作者:Ernst Haeckel 和皮克斯,壁紙高清4k,artstation 趨勢。

其他AI藝術創作應用

Stable Diffusion [10, 12]演出了比Disco Diffusion [11]更有效率且穩定的創作能力,特別是在「物」的刻畫上更加突出。下圖是作者利用穩定擴散,根據文本創作的AI繪畫作品:

##總結展望

本文主要介紹了近兩年來多模態影像生成技術及相關進展工作,並嘗試利用多模態影像生成進行多種AI藝術創作。接下來,我們還將探索多模態影像生成技術在消費級CPU上運作的可能性,以及結合業務為AI智能創作賦能,並嘗試更多如電影、動漫主題封面、遊戲、元宇宙內容創作等更多相關應用。

使用多模態圖像生成技術進行藝術創作只是AI自主生產內容(AIGC,AI生成內容)的一種應用方式。得益於目前海量資料與預訓練大模型的發展,人工智慧GC 能夠加速落地,為人類提供更多優質內容。或許,通用人工智慧又邁進了一步?如果你對本文涉及到的技術或應用感興趣,歡迎共創交流。

參考文獻

[1] Ramesh A, Pavlov M, Goh G, et al.零樣本文字到圖像生成[C]//機器學習國際會議。 PMLR,2021:8821-8831。

[2] 丁明,楊Z,洪W,等。 Cogview:透過 Transformer 掌握文字到圖像的生成[J].神經資訊處理系統進展, 2021, 34: 19822-19835.

[3] 丁明, 鄭文, 洪文, 等. CogView2:透過分層轉換器更快更好地產生文字到圖像[J]。 arXiv 預印本 arXiv:2204.14217, 2022.

[4] 張華,尹文,方 Y,等。 ERNIE-ViLG:雙向視覺-語言生成的統一生成預訓練[J]. arXiv 預印本 arXiv:2112.15283, 2021.

[5] Yu J, Xu Y, Koh J Y, et al.關鍵字: 內容豐富的文字到圖像生成, 縮放自迴歸模型arXiv 預印本 arXiv:2206.10789, 2022.

[6] 吳 C,梁 J,胡 X,等。 NUWA-Infinity:無限視覺合成的自回歸與自回歸生成[J]。 arXiv 預印本 arXiv:2207.09814, 2022.

[7] Ramesh A、Dhariwal P、Nichol A 等人。具有剪輯潛伏的分層文字條件影像生成[J]. arXiv 預印本 arXiv:2204.06125, 2022.

[8] Nichol A、Dhariwal P、Ramesh A 等人。 Glide:利用文字引導擴散模型實現真實感影像產生與編輯[J]. arXiv 預印本 arXiv:2112.10741, 2021.

[9] Saharia C、Chan W、Saxena S 等人。具有深度語言理解的真實感文本到圖像擴散模型[J]。 arXiv 預印本 arXiv:2205.11487, 2022.

[10] Rombach R、Blattmann A、Lorenz D 等人。使用潛在擴散模型進行高解析度影像合成[C]//IEEE/CVF 電腦視覺和模式識別會議論文集。 2022:10684-10695.

[11] Github:https://github.com/alembics/disco-diffusion

[12] Github:https://github.com/CompVis/stable-diffusion

以上是當 AI 邂逅繪畫藝術,能迸發出怎樣的火花?的詳細內容。更多資訊請關注PHP中文網其他相關文章!