無監督機器學習如何使工業自動化受益?

- PHPz轉載

- 2023-04-08 17:21:011755瀏覽

現代工業環境充滿了感測器和智慧組件,所有這些設備一起產生了豐富的數據。當今大多數工廠尚未深入開發的這些數據,為各種令人興奮的新應用提供了動力。事實上,據 IBM 稱,平均每個工廠每天都會產生 1TB 的生產數據。然而,只有大約 1% 的數據被轉化為可操作的見解。

機器學習 (ML) 是一項基礎技術,旨在利用這些資料並釋放大量價值。使用訓練數據,機器學習系統可以建立數學模型來教導一個系統在沒有明確指令的情況下執行特定任務。

ML 使用對資料起作用的演算法在很大程度上無需人工幹預即可做出決策。工業自動化領域最常見的機器學習形式是監督機器學習,它使用人類標記的大量歷史資料來訓練模型(即人類監督演算法的訓練)。

這對於軸承缺陷、潤滑故障或產品缺陷等眾所周知的問題非常有用。監督機器學習的缺點在於無法獲得足夠的歷史數據,標記過於耗時或昂貴,或者用戶不確定他們在數據中尋找的確切內容。這就是無監督機器學習發揮作用的時候。

無監督機器學習旨在使用擅長識別模式和找出資料異常的演算法對未標記的資料進行操作。正確應用的無監督機器學習服務於各種工業自動化用例,從狀態監測和效能測試到網路安全和資產管理。

監督學習vs.無監督學習

監督機器學習比無監督機器學習更容易執行。使用經過適當訓練的模型,它可以提供非常一致、可靠的結果。有監督的機器學習可能需要大量歷史資料--正如包含所有相關案例所需要的那樣,即,為了檢測產品缺陷,資料需要包含足夠數量的有缺陷產品案例。標記這些海量資料集可能既耗時又昂貴。此外,訓練模型是一門藝術。它需要大量數據,經過適當的整理,才能產生良好的結果。

如今,使用 AutoML 等工具對不同的 ML 演算法進行基準測試,這一過程得到了顯著簡化。同時,過度約束訓練過程可能會導致模型在訓練集上運作良好,但在實際資料上效果不佳。另一個關鍵缺點是監督機器學習在識別資料中的意外趨勢或發現新現象方面不是很有效。對於這些類型的應用程序,無監督機器學習可以提供更好的結果。

常見的無監督機器學習技術

與監督機器學習相比,無監督機器學習僅對未標記的輸入進行操作。它為數據探索提供了強大的工具,無需人工幫助即可發現未知模式和關聯。對未標記資料進行操作的能力可以節省時間和金錢,並使無監督機器學習能夠在生成輸入後儘快對資料進行操作。

不利的一面是,無監督機器學習比監督機器學習更複雜。它更昂貴,需要更高水平的專業知識,並且通常需要更多數據。它的輸出往往不如有監督的 ML 可靠,並且最終需要人工監督才能獲得最佳結果。

無監督機器學習技術的三種重要形式是聚類、異常檢測和資料降維。

聚類

顧名思義,聚類涉及分析資料集以識別資料之間的共享特徵並將類似的實例組合在一起。因為聚類是一種無監督的 ML 技術,所以演算法(而不是人類)決定了排序的標準。因此,聚類可以帶來令人驚訝的發現,並且是一種出色的資料探索工具。

舉一個簡單的例子:想像三個人被要求在一個生產部門對水果進行分類。一種可能按水果類型排序--柑橘、核果、熱帶水果等;另一種可能按顏色排序;而第三種可能按形狀排序。每種方法都突顯了一組不同的特徵。

聚類可以分為多種型別。最常見的是:

互斥聚類(Exclusive Clustering):一個資料實例被獨佔分配給一個叢集。

模糊或重疊聚類(Fuzzy Clustering):一個資料實例可以指派給多個叢集。例如,橘子既是柑橘類水果,也是熱帶水果。在對未標記資料進行操作的無監督 ML 演算法的情況下,可以分配資料區塊正確屬於 A 組與 B 組的機率。

層次聚類(Hierarchical clustering):此技術涉及建構聚類資料的分層結構,而不是一組聚類。橘子是柑橘類水果,但它們也包含在較大的球形水果組中,可以進一步被所有水果組吸收。

#讓我們來看一組最受歡迎的聚類演算法:

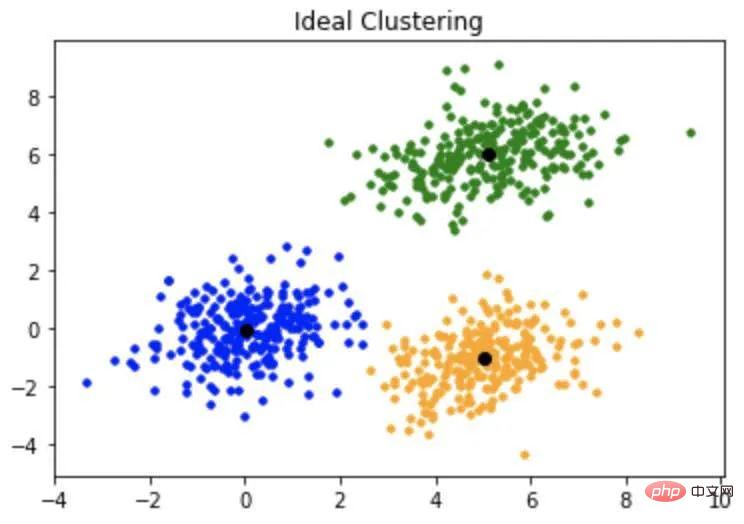

- K-平均值

K 平均值(K-means)演算法將資料分類到K 聚類中,其中K 的值由使用者預設。在製程開始時,演算法隨機分配 K 個資料點作為 K 個聚類的質心。接下來,它計算每個資料點與其聚集的質心之間的平均值。這會導致將數據訴諸集群。此時,演算法重新計算質心並重複均值計算。它重複計算質心和重新排序聚類的過程,直到它到達一個恆定的解(參見圖1)。

圖1:K-means 演算法將資料集分割成K 個集群,首先隨機選擇K 個資料點作為質心,然後在集群中隨機分配剩餘的實例。

K-means演算法簡單又有效率。它對於模式識別和資料探勘非常有用。不利的一面是,它需要一些資料集的高級知識來優化設定。它也受到異常值的不成比例的影響。

- K-中值

#K-中位數(K-median)演算法是K-means 的近親。它使用基本上相同的過程,只是它不是計算每個數據點的平均值,而是計算中位數。因此,該演算法對異常值不太敏感。

以下是一些聚類分析的常見用例:

- #聚類對於細分等用例非常有效。這通常與客戶分析相關聯。它還可以應用於資產類別,不僅用於分析產品品質和性能,還可用於識別可能影響產品性能和使用壽命的使用模式。這對於管理資產"車隊"的OEM公司很有幫助,例如智慧倉庫中的自動化移動機器人或用於檢查和資料收集的無人機。

- 它可以作為影像處理操作的一部分用於影像分割。

- 聚類分析也可用作預處理步驟,以協助為受監督的 ML 應用程式準備資料。

異常檢測

異常檢測對於從缺陷檢測到狀態監控再到網路安全的各種用例至關重要。這是無監督機器學習中的關鍵任務。在無監督機器學習中會使用多種異常檢測演算法,讓我們來看看兩個最受歡迎的:

- 隔離森林演算法

異常檢測的標準方法是建立一組正常值,然後對每個數據進行分析,看它是否偏離正常值以及偏離多少。在處理 ML 中使用的那種海量資料集時,這是一個非常耗時的過程。隔離森林(Isolation forest)演算法採用相反的方法。它將異常值定義為與資料集中的其他實例既不常見又非常不同。因此,它們更容易與其他實例上的其餘資料集隔離。

隔離森林演算法的記憶體需求最小,所需時間與資料集的大小呈線性關係。他們可以處理高維數據,即使它涉及不相關的屬性。

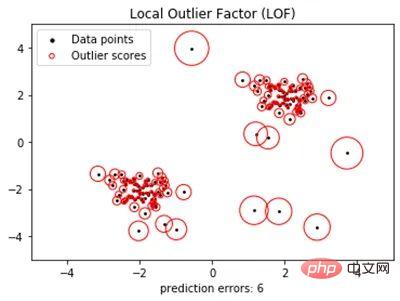

- 局部異常因子(LOF)

#僅透過與質心的距離來識別異常值的挑戰之一是,距離小集群短距離的數據點可能是異常值,而距離大集群看似很遠的點可能不是。 LOF 演算法就是為了做出這種區分而設計的。

LOF 將異常值定義為局部密度偏差遠大於其相鄰資料點的資料點(請參閱圖 2)。儘管與 K-means 一樣,它確實需要提前進行一些用戶設置,但它可能非常有效。當用作半監督演算法並僅在正常數據上進行訓練時,它也可以應用於新穎性檢測。

圖2:局部異常值因子(LOF) 使用每個資料點的局部密度偏差來計算異常分數,從而區分正常數據點和異常值。

以下是幾個異常檢測的用例:

- 預測性維護:大多數工業設備經久耐用,停機時間最短。因此,可以使用的歷史數據通常很有限。因為無監督 ML 即使在有限的資料集中也可以檢測到異常行為,它可以潛在地識別這些情況下的發展缺陷。在這裡,它也可用於車隊管理,提供缺陷預警,同時最大限度地減少需要審查的數據量。

- 品質保證/檢驗:操作不當的機器可能會生產不合格的產品。無監督機器學習可用於監控功能和流程以標記任何異常情況。與標準 QA 流程不同,它可以在沒有標籤和培訓的情況下做到這一點。

- 影像異常的識別:這在醫學影像中特別有用,可以識別危險的病理。

- 網路安全:網路安全的最大挑戰之一是威脅不斷變化。在這種情況下,透過無監督 ML 進行異常檢測可能非常有效。一種標準的安全技術是監控資料流。如果通常向其他元件發送命令的 PLC 突然開始接收來自非典型設備或 IP 位址的穩定命令流,這可能表示入侵。但是,如果惡意程式碼來自受信任的來源(或不良行為者欺騙受信任的來源)怎麼辦?無監督學習可以透過在接收命令的設備中尋找非典型行為來檢測不良行為者。

- 測試數據分析:測試在設計和生產中都起著至關重要的作用。所涉及的兩個最大挑戰是所涉及的數據量龐大,以及在不引入固有偏見的情況下分析數據的能力。無監督機器學習可以解決這兩個挑戰。當測試團隊甚至不確定他們在尋找什麼時,它在開發過程或生產故障排除中可能是一個特別的好處。

降維

機器學習是基於大量數據,而且通常數量非常巨大。可以篩選到十個到幾十個特徵的資料集是一回事。具有數千個特徵的資料集(它們肯定存在)可能是壓倒性的。因此,ML 的第一步可以是降維以將資料減少到最有意義的特徵。

用於降維、模式識別和資料探索的常用演算法是主成分分析 (PCA)。對該演算法的詳細討論超出了本文的範圍。可以說它可以幫助識別相互正交的資料子集,即它們可以從資料集中刪除而不影響主要分析。 PCA 有幾個有趣的用例:

- 資料預處理:談到機器學習,人們常說的理念是越多越好。也就是說,有時更多就是更多,特別是在無關/冗餘資料的情況下。在這些情況下,無監督機器學習可用於刪除不必要的特徵(資料維度),加快處理時間並改善結果。在視覺系統的情況下,無監督機器學習可用於降噪。

- 影像壓縮:PCA 非常擅長降低資料集的維數,同時保留有意義的資訊。這使得該演算法非常擅長影像壓縮。

- 模式辨識:上面討論的相同功能使 PCA 可用於臉部辨識和其他複雜影像辨識等任務。

無監督機器學習並不比監督機器學習更好或更差。對於正確的項目,它可能非常有效。也就是說,最好的經驗法則是保持簡單,因此通常僅在監督機器學習無法解決的問題上使用無監督機器學習。

思考以下是幾個問題,以確定哪種機器學習方式最適合您的專案:

- ##問題是什麼?

- 什麼是商業案例?量化的目標是什麼?該項目將多快帶來投資回報?這與監督學習或其他更傳統的解決方案相比如何?

- 有哪些類型的輸入資料可用?你有多少?它與您要回答的問題有關嗎?是否有已經產生標記資料的流程,例如,是否有識別有缺陷產品的 QA 流程?是否有記錄設備故障的維修資料庫?

- 它適合無監督機器學習嗎?

- 在開始專案之前做好功課並製定策略。

- 從小處著手,以較小的規模解決錯誤。

- 請確保解決方案是可擴展的,您應該不會希望最終陷入試點計畫的煉獄。

- 考慮與合作夥伴合作。所有類型的機器學習都需要專業知識。尋找合適的工具和合作夥伴來實現自動化。不要重新發明輪子。您可以付費在內部培養必要的技能,也可以將您的資源用於提供您最擅長的產品和服務,同時讓合作夥伴和生態系統處理繁重的工作。

在工業環境中收集的資料可能是寶貴的資源,但只有在適當利用的情況下。無監督機器學習可以成為分析資料集以提取可操作見解的強大工具。採用該技術可能具有挑戰性,但它可以在充滿挑戰的世界中提供顯著的競爭優勢。

以上是無監督機器學習如何使工業自動化受益?的詳細內容。更多資訊請關注PHP中文網其他相關文章!