在 OpenAI 發布 GPT-4 之後,一場有關「AI 取代人類勞動力」的討論正變得越來越激烈。該模型的強大能力及其可能帶來的潛在社會影響引發了許多人的擔憂,馬斯克、Bengio 等人甚至聯名寫了一封公開信,呼籲所有AI 機構暫停訓練比GPT-4 更強的AI 模型,為期至少6 個月。

但另一方面,對於 GPT-4 能力的質疑也是此起彼落。前幾天,圖靈獎得主 Yann LeCun 在一場辯論中直接指出,GPT 家族所採用的自回歸路線存在天然的缺陷,繼續往前走是沒有前途的。

同時,一些研究者、從業者也表示,GPT-4 可能並沒有OpenAI 所展示的那麼強大,尤其是在程式設計方面:它可能只是記住了之前的題目,OpenAI 用來測試此模型程式設計能力的題目可能早就存在於它的訓練集中,這違反了機器學習的基本規則。另外,也有人指出,看到 GPT-4 在各種考試中名列前茅就判定 AI 將取代部分職業的想法是不嚴謹的,畢竟這些考試和人類的實際工作還是有差距的。

近期的一篇部落格詳細地闡述了上述想法。

問題一:訓練資料污染

為了對 GPT-4 的程式設計能力進行基準測試,OpenAI 使用程式設計競賽網站 Codeforces 上的問題對其進行了評估。令人驚訝的是,GPT-4 解決了 10/10 的 2021 年前的問題和 0/10 的近期 easy 類問題。要知道,GPT-4 的訓練資料截止日期是 2021 年 9 月。這有力地表明該模型能夠從其訓練集中記住解決方案 —— 或至少部分記住它們,這足以讓它填補它不記得的東西。

圖片來源:https://twitter.com/cHHillee/status/1635790330854526981

#為了進一步證明這個假設,部落客Arvind Narayanan 和Sayash Kapoor 在2021 年不同時間的Codeforces 問題上對GPT-4 進行了測試,發現它可以解決9 月5 日之前的簡單類別的問題,無法解決9 月12 日之後的問題。

作者表示,事實上,他們可以明確地表明GPT-4 已經記住了訓練集中的問題:當把Codeforces 問題的標題加入prompt 中時,GPT-4 的回答會包含指向出現該問題的確切比賽的連結(並且輪數幾乎是正確的:它差了一個)。請注意,當時的 GPT-4 不能上網,所以記憶是唯一的解釋。

GPT-4 記住了訓練截止日期之前的 Codeforces 問題。

論文中的 Codeforces 結果並沒有受此影響,因為 OpenAI 使用的是最近的問題(果然,GPT-4 表現很差)。對於程式設計以外的基準,作者不知道有什麼乾淨的方法可以按時間段分開問題,所以他們認為 OpenAI 不太可能避免污染。但出於同樣的原因,他們也無法做實驗來測試性能在不同日期的變化。

不過,他們還是可以尋找一些提示性的跡象。記憶的另一個徵兆是:GPT 對問題的措詞高度敏感。 Melanie Mitchell 舉了一個 MBA 測試題的例子,她改變了這個例子的一些細節,這一改變騙不到人,但卻成功欺騙了(運行 GPT-3.5 的)ChatGPT。沿著這個思路做一個更詳細的實驗會很有價值。

由於 OpenAI 缺乏透明度,作者無法肯定地回答污染問題。但可以肯定的是,OpenAI 檢測污染的方法是膚淺和草率的:

我們使用子字串匹配來衡量我們的評估資料集和預訓練資料之間的交叉污染。評估和訓練資料都是透過移除所有的空格和符號來處理的,只保留字元(包括數字)。對於每個評估實例,我們隨機選擇三個 50 個字符的子字串(如果少於 50 個字符,則使用整個實例)。如果三個被抽中的評估子字串中的任何一個是被處理過的訓練例子的子串,那麼就可以辨識出一個匹配。這就產生了一個被污染的例子的清單。我們丟棄這些,並重新運行以獲得未受污染的分數。

這是一個脆弱的方法。如果一個測試問題出現在訓練集中,但名稱和數字被改變了,它就不會被發現。不那麼脆弱的方法是現成的,比如說嵌入距離。

如果 OpenAI 要使用基於距離的方法,多大程度的相似性才是太相似?這個問題沒有客觀的答案。因此,即使是像選擇題標準化測驗中的表現看似簡單的事情,也充滿了主觀的決定。

但我們可以透過詢問 OpenAI 試圖用這些考試來衡量什麼來明確一些東西。如果目標是預測語言模型在現實世界任務中的表現,那就有一個問題。從某種意義上說,任何兩個律師考試或醫學考試的問題都比現實世界中專業人士所面臨的兩個類似任務更相似,因為它們是從這樣一個受限的空間中提取的。因此,在訓練語料庫中加入任何考試問題,都有可能導致對模型在現實世界中的有用性的誇大估計。

從現實世界的有用性角度來闡述這個問題,突顯了另一個更深層的問題(問題二)。

問題二:專業考試不是比較人類和機器人能力的有效方法

記憶是一個光譜。即使一個語言模型在訓練集上沒有見過某個確切的問題,它也不可避免地看到了非常接近的例子,因為訓練語料庫的規模太大了。這意味著它可以用更淺顯的推理層次來逃避。因此,基準結果並沒有給我們證據,證明語言模型正在獲得人類考生所需的那種深入的推理技能,而這些考生隨後會在現實世界中應用這些技能。

在一些現實世界的任務中,淺層推理可能是足夠的,但並非總是如此。世界是不斷變化的,所以如果一個機器人被要求分析一項新技術或一個新的司法判決的法律後果,它就沒有什麼可藉鑑的。總之,正如 Emily Bender 所指出的,為人類設計的測試在應用於機器人時缺乏結構效度。

除此之外,專業考試,尤其是律師資格考試,過度強調學科知識,而對現實世界的技能強調不足,而這些技能在標準化的計算機管理方式下更難衡量。換句話說,這些考試不僅強調了錯誤的東西,而且過度強調了語言模型所擅長的東西。

在 AI 領域,基準被過度地用於比較不同的模型。這些基準因將多維評價壓縮成單一數字而飽受批評。當它們被用來比較人類和機器人時,得到的結果是錯誤的資訊。不幸的是,OpenAI 在對 GPT-4 的評估中選擇大量使用這些類型的測試,而且沒有充分嘗試解決污染問題。

有更好的方法來評估 AI 模型對職業的影響

人們在工作期間可以上網,但在標準化考試期間卻不能上網。因此,如果語言模型的表現能夠媲美可以上網的專業人士,這在某種程度上將能更好地檢驗它們的實際效能。

但這仍然是個錯誤的問題。與其用獨立的基準,我們或許更應該衡量語言模型能在多大程度上完成專業人員必須完成的所有現實任務。例如,在學術界,我們經常會遇到一些我們不熟悉的領域的論文,其中充滿了專業術語;如果 ChatGPT 能夠以一種更容易理解的方式準確地總結這樣的論文,那就很有用了。有些人甚至還測試過這些工具是否能做同儕審查。但即使是這個場景,你也很難確保用來測試的題目沒有包含在訓練集裡。

ChatGPT 可以取代專業人員的想法仍然很牽強。在 1950 年的普查中,270 個工作中僅有 1 個被自動化淘汰了,那就是電梯操作員。當下,我們需要評估的是那些利用人工智慧工具來幫助自己完成工作的專業人員。兩項早期的研究是有希望的:一項是 GitHub 用於程式設計的 copilot,另一項是 ChatGPT 的寫作協助。

在這個階段,我們更需要定性研究而不是定量研究,因為這些工具太新了,我們甚至不知道該問什麼正確的定量問題。例如,微軟的 Scott Guthrie 報告了一個醒目的數字:GitHub Copilot 用戶檢查的程式碼中有 40% 是人工智慧產生的,沒有經過修改。但任何程式設計師都會告訴你,很大一部分程式碼由模板和其他通常可以複製貼上的平凡邏輯組成,特別是在企業應用程式中。如果這就是 Copilot 自動化的部分,那麼生產力的提高將是微不足道的。

作者表示,明確地說,我們不是說 Copilot 沒有用,只是說如果沒有對專業人士如何使用人工智慧的定性理解,現有的衡量標準將是沒有意義的。此外,人工智慧輔助編碼的主要好處甚至可能不是生產力的提升。

結論

下圖總結了這篇文章,並解釋了我們為什麼要以及如何擺脫 OpenAI 報告的那種度量標準。

GPT-4 確實令人興奮,它可以透過多種方式解決專業人士的痛點,例如透過自動化,取代我們做簡單、低風險但費力的任務。目前,專注於實現這些好處並降低語言模型的許多風險可能是更好的做法。

以上是GPT-4壓根不會編程?有人讓它露餡了的詳細內容。更多資訊請關注PHP中文網其他相關文章!

一個提示可以繞過每個主要LLM的保障措施Apr 25, 2025 am 11:16 AM

一個提示可以繞過每個主要LLM的保障措施Apr 25, 2025 am 11:16 AM隱藏者的開創性研究暴露了領先的大語言模型(LLM)的關鍵脆弱性。 他們的發現揭示了一種普遍的旁路技術,稱為“政策木偶”,能夠規避幾乎所有主要LLMS

5個錯誤,大多數企業今年將犯有可持續性Apr 25, 2025 am 11:15 AM

5個錯誤,大多數企業今年將犯有可持續性Apr 25, 2025 am 11:15 AM對環境責任和減少廢物的推動正在從根本上改變企業的運作方式。 這種轉變會影響產品開發,製造過程,客戶關係,合作夥伴選擇以及採用新的

H20芯片禁令震撼中國人工智能公司,但長期以來一直在為影響Apr 25, 2025 am 11:12 AM

H20芯片禁令震撼中國人工智能公司,但長期以來一直在為影響Apr 25, 2025 am 11:12 AM最近對先進AI硬件的限制突出了AI優勢的地緣政治競爭不斷升級,從而揭示了中國對外國半導體技術的依賴。 2024年,中國進口了價值3850億美元的半導體

如果Openai購買Chrome,AI可能會統治瀏覽器戰爭Apr 25, 2025 am 11:11 AM

如果Openai購買Chrome,AI可能會統治瀏覽器戰爭Apr 25, 2025 am 11:11 AM從Google的Chrome剝奪了潛在的剝離,引發了科技行業中的激烈辯論。 OpenAI收購領先的瀏覽器,擁有65%的全球市場份額的前景提出了有關TH的未來的重大疑問

AI如何解決零售媒體的痛苦Apr 25, 2025 am 11:10 AM

AI如何解決零售媒體的痛苦Apr 25, 2025 am 11:10 AM儘管總體廣告增長超過了零售媒體的增長,但仍在放緩。 這個成熟階段提出了挑戰,包括生態系統破碎,成本上升,測量問題和整合複雜性。 但是,人工智能

'AI是我們,比我們更多'Apr 25, 2025 am 11:09 AM

'AI是我們,比我們更多'Apr 25, 2025 am 11:09 AM在一系列閃爍和惰性屏幕中,一個古老的無線電裂縫帶有靜態的裂紋。這堆易於破壞穩定的電子產品構成了“電子廢物之地”的核心,這是沉浸式展覽中的六個裝置之一,&qu&qu

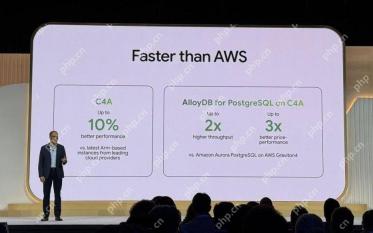

Google Cloud在下一個2025年對基礎架構變得更加認真Apr 25, 2025 am 11:08 AM

Google Cloud在下一個2025年對基礎架構變得更加認真Apr 25, 2025 am 11:08 AMGoogle Cloud的下一個2025:關注基礎架構,連通性和AI Google Cloud的下一個2025會議展示了許多進步,太多了,無法在此處詳細介紹。 有關特定公告的深入分析,請參閱我的文章

IR的秘密支持者透露,Arcana的550萬美元的AI電影管道說話,Arcana的AI Meme,Ai Meme的550萬美元。Apr 25, 2025 am 11:07 AM

IR的秘密支持者透露,Arcana的550萬美元的AI電影管道說話,Arcana的AI Meme,Ai Meme的550萬美元。Apr 25, 2025 am 11:07 AM本週在AI和XR中:一波AI驅動的創造力正在通過從音樂發電到電影製作的媒體和娛樂中席捲。 讓我們潛入頭條新聞。 AI生成的內容的增長影響:技術顧問Shelly Palme

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具