本篇文章為大家帶來了關於Python的相關知識,其中主要介紹了關於pytorch模型保存與加載中的一些問題實戰記錄,下面一起來看一下,希望對大家有幫助。

【相關推薦:Python3影片教學 】

一、torch中模型保存與載入的方式

1、模型參數和模型結構保存與載入

torch.save(model,path) torch.load(path)

2、只儲存模型的參數和載入-這種方式比較安全,但是比較稍微麻煩一點點

torch.save(model.state_dict(),path) model_state_dic = torch.load(path) model.load_state_dic(model_state_dic)

二、 torch中模型保存與載入出現的問題

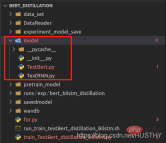

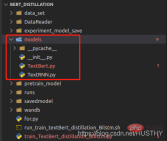

1、單卡模型下儲存模型結構、參數後載入出現的問題

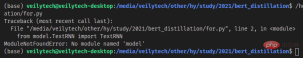

模型儲存的時候會把模型結構定義檔路徑記錄下來,載入的時候就會根據路徑解析它然後裝載參數;當把模型定義檔案路徑修改以後,使用torch.load(path)就會報錯。

#把model資料夾修改成models後,再載入就會報錯。

import torch from model.TextRNN import TextRNN load_model = torch.load('experiment_model_save/textRNN.bin') print('load_model',load_model)

這種保存完整模型結構與參數的方式,一定不要改變模型定義檔路徑。

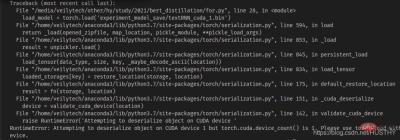

2、多卡機器單卡訓練模型保存後在單卡機器上載入會報錯

在多卡機器上有多張顯示卡0號開始,現在模型在n>= 1上的顯示卡訓練儲存後,拷貝在單卡機器上載入

import torch from model.TextRNN import TextRNN load_model = torch.load('experiment_model_save/textRNN_cuda_1.bin') print('load_model',load_model)

#會出現cuda device不符的問題-你儲存的模碼段小部件型是使用的cuda1,那麼採用torch.load()開啟的時候,會預設的去尋找cuda1,然後把模型載入到該裝置上。這時候可以直接使用map_location來解決,把模型載入到CPU上即可。

load_model = torch.load('experiment_model_save/textRNN_cuda_1.bin',map_location=torch.device('cpu'))

3、多卡訓練模型保存模型結構和參數後加載出現的問題

當用多GPU同時訓練模型之後,不管是採用模型結構和參數一起保存還是單獨保存模型參數,然後在單卡下載入都會出現問題

a、模型結構和參數一起保然後在載入

torch.distributed.init_process_group(backend='nccl')

模型訓練的時候採用上述多進程的方式,所以你在載入的時候也要聲明,不然就會報錯。

b、單獨保存模型參數

model = Transformer(num_encoder_layers=6,num_decoder_layers=6) state_dict = torch.load('train_model/clip/experiment.pt') model.load_state_dict(state_dict)

同樣會出現問題,不過這裡出現的問題是參數字典的key和模型定義的key不一樣

原因是多GPU訓練下,使用分散式訓練的時候會給模型一個包裝,程式碼如下:

model = torch.load('train_model/clip/Vtransformers_bert_6_layers_encoder_clip.bin') print(model) model.cuda(args.local_rank) 。。。。。。 model = nn.parallel.DistributedDataParallel(model,device_ids=[args.local_rank],find_unused_parameters=True) print('model',model)

包裝前的模型結構:

包裝後的模型

在外層多了DistributedDataParallel以及module,所以才會導致在單卡環境下載入模型權重的時候出現權重的keys不一致。

三、正確的保存模型和載入的方法

if gpu_count > 1:

torch.save(model.module.state_dict(),save_path)

else:

torch.save(model.state_dict(),save_path)

model = Transformer(num_encoder_layers=6,num_decoder_layers=6)

state_dict = torch.load(save_path)

model.load_state_dict(state_dict)這樣就是比較好的範式,載入不會出錯。

【相關推薦:Python3影片教學 】

以上是pytorch模型保存與載入中的一些問題實戰記錄的詳細內容。更多資訊請關注PHP中文網其他相關文章!

Python中的合併列表:選擇正確的方法May 14, 2025 am 12:11 AM

Python中的合併列表:選擇正確的方法May 14, 2025 am 12:11 AMTomergelistsinpython,YouCanusethe操作員,estextMethod,ListComprehension,Oritertools

如何在Python 3中加入兩個列表?May 14, 2025 am 12:09 AM

如何在Python 3中加入兩個列表?May 14, 2025 am 12:09 AM在Python3中,可以通過多種方法連接兩個列表:1)使用 運算符,適用於小列表,但對大列表效率低;2)使用extend方法,適用於大列表,內存效率高,但會修改原列表;3)使用*運算符,適用於合併多個列表,不修改原列表;4)使用itertools.chain,適用於大數據集,內存效率高。

Python串聯列表字符串May 14, 2025 am 12:08 AM

Python串聯列表字符串May 14, 2025 am 12:08 AM使用join()方法是Python中從列表連接字符串最有效的方法。 1)使用join()方法高效且易讀。 2)循環使用 運算符對大列表效率低。 3)列表推導式與join()結合適用於需要轉換的場景。 4)reduce()方法適用於其他類型歸約,但對字符串連接效率低。完整句子結束。

Python執行,那是什麼?May 14, 2025 am 12:06 AM

Python執行,那是什麼?May 14, 2025 am 12:06 AMpythonexecutionistheprocessoftransformingpypythoncodeintoExecutablestructions.1)InternterPreterReadSthecode,ConvertingTingitIntObyTecode,whepythonvirtualmachine(pvm)theglobalinterpreterpreterpreterpreterlock(gil)the thepythonvirtualmachine(pvm)

Python:關鍵功能是什麼May 14, 2025 am 12:02 AM

Python:關鍵功能是什麼May 14, 2025 am 12:02 AMPython的關鍵特性包括:1.語法簡潔易懂,適合初學者;2.動態類型系統,提高開發速度;3.豐富的標準庫,支持多種任務;4.強大的社區和生態系統,提供廣泛支持;5.解釋性,適合腳本和快速原型開發;6.多範式支持,適用於各種編程風格。

Python:編譯器還是解釋器?May 13, 2025 am 12:10 AM

Python:編譯器還是解釋器?May 13, 2025 am 12:10 AMPython是解釋型語言,但也包含編譯過程。 1)Python代碼先編譯成字節碼。 2)字節碼由Python虛擬機解釋執行。 3)這種混合機制使Python既靈活又高效,但執行速度不如完全編譯型語言。

python用於循環與循環時:何時使用哪個?May 13, 2025 am 12:07 AM

python用於循環與循環時:何時使用哪個?May 13, 2025 am 12:07 AMUseeAforloopWheniteratingOveraseQuenceOrforAspecificnumberoftimes; useAwhiLeLoopWhenconTinuingUntilAcIntiment.forloopsareIdealForkNownsences,而WhileLeleLeleLeleLeleLoopSituationSituationsItuationsItuationSuationSituationswithUndEtermentersitations。

Python循環:最常見的錯誤May 13, 2025 am 12:07 AM

Python循環:最常見的錯誤May 13, 2025 am 12:07 AMpythonloopscanleadtoerrorslikeinfiniteloops,modifyingListsDuringteritation,逐個偏置,零indexingissues,andnestedloopineflinefficiencies

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

SublimeText3漢化版

中文版,非常好用

Dreamweaver Mac版

視覺化網頁開發工具

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!