為什麼選擇用python當爬蟲

- 尚原創

- 2019-07-06 14:43:114007瀏覽

什麼是網路爬蟲?

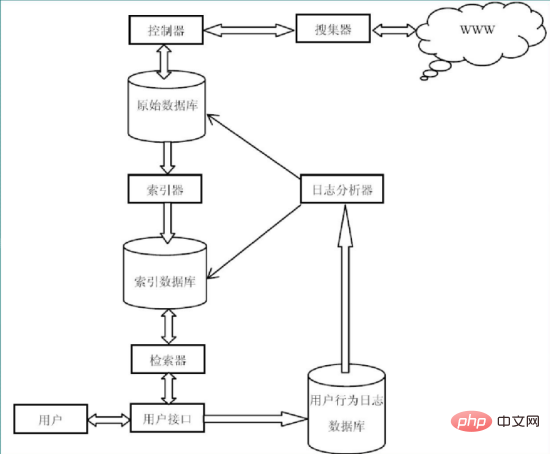

網路爬蟲是一個自動提取網頁的程序,它為搜尋引擎從萬維網上下載網頁,是搜尋引擎的重要組成。傳統爬蟲從一個或若干初始網頁的URL開始,獲得初始網頁上的URL,在抓取網頁的過程中,不斷從當前頁面上抽取新的URL放入隊列,直到滿足系統的一定停止條件

爬蟲有什麼用?

做為通用搜尋引擎網頁收集器。 (google,baidu)做垂直搜尋引擎.科學研究:線上人類行為,線上社群演化,人類動力學研究,計量社會學,複雜網絡,資料探勘,等領域的實證研究都需要大量數據,網路爬蟲是收集相關數據的利器。偷窺,hacking,發垃圾郵件…

爬蟲是搜尋引擎的第一步也是最容易的一步

用什麼語言寫爬蟲?

C,C 。高效率,快速,適合通用搜尋引擎做全網爬取。缺點,開發慢,寫起來又臭又長,例如:天網搜尋原始碼。腳本語言:Perl, Python, Java, Ruby。簡單,易學,良好的文字處理能方便網頁內容的細緻提取,但效率往往不高,適合對少量網站的聚焦爬取C#? (看似資訊管理的人比較喜歡的語言)

##選擇Python做爬蟲的原因:

跨平台,對Linux和windows都有不錯的支援。 科學計算,數值擬合:Numpy,Scipy視覺化:2d:Matplotlib(做圖很漂亮), 3d: Mayavi2 複雜網路:Networkx統計:與R語言介面:Rpy互動式終端機網站的快速開發一個簡單的Python爬蟲import urllib

import urllib.request

def loadPage(url,filename):

"""

作用:根据url发送请求,获取html数据;

:param url:

:return:

"""

request=urllib.request.Request(url)

html1= urllib.request.urlopen(request).read()

return html1.decode('utf-8')

def writePage(html,filename):

"""

作用将html写入本地

:param html: 服务器相应的文件内容

:return:

"""

with open(filename,'w') as f:

f.write(html)

print('-'*30)

def tiebaSpider(url,beginPage,endPage):

"""

作用贴吧爬虫调度器,负责处理每一个页面url;

:param url:

:param beginPage:

:param endPage:

:return:

"""

for page in range(beginPage,endPage+1):

pn=(page - 1)*50

fullurl=url+"&pn="+str(pn)

print(fullurl)

filename='第'+str(page)+'页.html'

html= loadPage(url,filename)

writePage(html,filename)

if __name__=="__main__":

kw=input('请输入你要需要爬取的贴吧名:')

beginPage=int(input('请输入起始页'))

endPage=int(input('请输入结束页'))

url='https://tieba.baidu.com/f?'

kw1={'kw':kw}

key = urllib.parse.urlencode(kw1)

fullurl=url+key

tiebaSpider(fullurl,beginPage,endPage)更多Python相關技術文章,請訪問Python教程欄位進行學習!

以上是為什麼選擇用python當爬蟲的詳細內容。更多資訊請關注PHP中文網其他相關文章!

陳述:

本文內容由網友自願投稿,版權歸原作者所有。本站不承擔相應的法律責任。如發現涉嫌抄襲或侵權的內容,請聯絡admin@php.cn

上一篇:python小課值嗎下一篇:python小課值嗎