透過網頁爬蟲中cookie自動取得及過期自動更新(詳細教學)

- 亚连原創

- 2018-06-01 10:02:097924瀏覽

這篇文章主要介紹了網頁爬蟲之cookie自動獲取及過期自動更新的實現方法,需要的朋友可以參考下

本文實現cookie的自動獲取,及cookie過期自動更新。

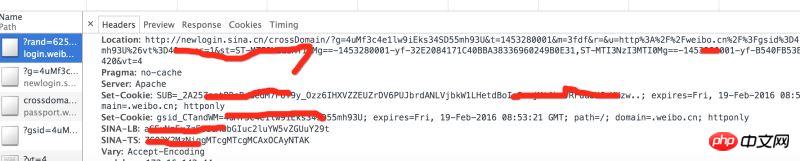

社群網站中的許多資訊都需要登入才能取得到,以微博為例,不登入帳號,只能看到大V的前十條微博。保持登入狀態,必須使用到Cookie。以登入www.weibo.cn 為例:

在chrome中輸入:http://login.weibo.cn/login/

實作步驟:

1,採用selenium自動登入取得cookie,儲存到檔案;2,讀取cookie,比較cookie的有效期,若過期則再次執行步驟1;3,在請求其他網頁時,填入cookie,實現登入狀態的維持。 1,線上取得cookie採用selenium PhantomJS 模擬瀏覽器登錄,取得cookie;cookies一般會有多個,逐一將cookie存入以.weibo後綴的文件。def get_cookie_from_network():

from selenium import webdriver

url_login = 'http://login.weibo.cn/login/'

driver = webdriver.PhantomJS()

driver.get(url_login)

driver.find_element_by_xpath('//input[@type="text"]').send_keys('your_weibo_accout') # 改成你的微博账号

driver.find_element_by_xpath('//input[@type="password"]').send_keys('your_weibo_password') # 改成你的微博密码

driver.find_element_by_xpath('//input[@type="submit"]').click() # 点击登录

# 获得 cookie信息

cookie_list = driver.get_cookies()

print cookie_list

cookie_dict = {}

for cookie in cookie_list:

#写入文件

f = open(cookie['name']+'.weibo','w')

pickle.dump(cookie, f)

f.close()

if cookie.has_key('name') and cookie.has_key('value'):

cookie_dict[cookie['name']] = cookie['value']

return cookie_dict2,從檔案中取得cookie從目前目錄遍歷以.weibo結尾的文件,即cookie檔。採用pickle解包成dict,比較expiry值與當前時間,若過期則回傳為空;def get_cookie_from_cache():

cookie_dict = {}

for parent, dirnames, filenames in os.walk('./'):

for filename in filenames:

if filename.endswith('.weibo'):

print filename

with open(self.dir_temp + filename, 'r') as f:

d = pickle.load(f)

if d.has_key('name') and d.has_key('value') and d.has_key('expiry'):

expiry_date = int(d['expiry'])

if expiry_date > (int)(time.time()):

cookie_dict[d['name']] = d['value']

else:

return {}

return cookie_dict3,若快取cookie過期,則再次從網路取得cookiedef get_cookie(): cookie_dict = get_cookie_from_cache() if not cookie_dict: cookie_dict = get_cookie_from_network() return cookie_dict4,帶cookie請求微博其他主頁

def get_weibo_list(self, user_id):

import requests

from bs4 import BeautifulSoup as bs

cookdic = get_cookie()

url = 'http://weibo.cn/stocknews88'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 6.1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/31.0.1650.57 Safari/537.36'}

timeout = 5

r = requests.get(url, headers=headers, cookies=cookdic,timeout=timeout)

soup = bs(r.text, 'lxml')

...

# 用BeautifulSoup 解析网页

...上面是我整理給大家的,希望今後會對大家有幫助。 相關文章:

vue2.0 computed 計算list循環後累加值的實例#

以上是透過網頁爬蟲中cookie自動取得及過期自動更新(詳細教學)的詳細內容。更多資訊請關注PHP中文網其他相關文章!

陳述:

本文內容由網友自願投稿,版權歸原作者所有。本站不承擔相應的法律責任。如發現涉嫌抄襲或侵權的內容,請聯絡admin@php.cn