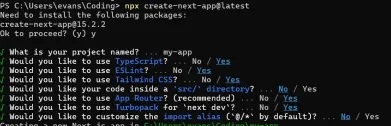

這次帶給大家如何使用nodeJs爬蟲,使用nodeJs爬蟲的注意事項有哪些,下面就是實戰案例,一起來看一下。

背景

最近打算把之前看過的nodeJs相關的內容在複習下,順便寫幾個爬蟲來打發無聊,在爬的過程中發現一些問題,記錄下以便備忘。

依賴

用到的是網路爛大街的cheerio函式庫來處理爬取的內容,使用superagent處理請求,log4js來記錄日誌。

日誌配置

話不多說,直接上程式碼:

const log4js = require('log4js');

log4js.configure({

appenders: {

cheese: {

type: 'dateFile',

filename: 'cheese.log',

pattern: '-yyyy-MM-dd.log',

// 包含模型

alwaysIncludePattern: true,

maxLogSize: 1024,

backups: 3 }

},

categories: { default: { appenders: ['cheese'], level: 'info' } }

});

const logger = log4js.getLogger('cheese');

logger.level = 'INFO';

module.exports = logger;

以上直接匯出一個logger對象,在業務文件裡直接呼叫logger .info()等函數加入日誌資訊就可以,會按天產生日誌。相關資訊網路上一堆。

爬取內容並處理

superagent.get(cityItemUrl).end((err, res) => {

if (err) {

return console.error(err);

}

const $ = cheerio.load(res.text);

// 解析当前页面,获取当前页面的城市链接地址

const cityInfoEle = $('.newslist1 li a');

cityInfoEle.each((idx, element) => {

const $element = $(element);

const sceneURL = $element.attr('href'); // 页面地址

const sceneName = $element.attr('title'); // 城市名称

if (!sceneName) {

return;

}

logger.info(`当前解析到的目的地是: ${sceneName}, 对应的地址为: ${sceneURL}`);

getDesInfos(sceneURL, sceneName); // 获取城市详细信息

ep.after('getDirInfoComplete', cityInfoEle.length, (dirInfos) => {

const content = JSON.parse(fs.readFileSync(path.join(dirname, './imgs.json')));

dirInfos.forEach((element) => {

logger.info(`本条数据为:${JSON.stringify(element)}`);

Object.assign(content, element);

});

fs.writeFileSync(path.join(dirname, './imgs.json'), JSON.stringify(content));

});

});

});

使用superagent請求頁面,請求成功後使用cheerio 來載入頁面內容,然後使用類似Jquery的匹配規則來尋找目的資源。

多個資源載入完成,使用eventproxy來代理事件,處理一次資源處罰一次事件,所有事件觸發完成後處理資料。

以上就是最基本的爬蟲了,接下來就是一些可能會出問題或需要特別注意的地方了。 。 。

讀寫本機檔案

建立資料夾

function mkdirSync(dirname) {

if (fs.existsSync(dirname)) {

return true;

}

if (mkdirSync(path.dirname(dirname))) {

fs.mkdirSync(dirname);

return true;

}

return false;

}

讀寫檔案

const content = JSON.parse(fs.readFileSync(path.join(dirname, './dir.json')));

dirInfos.forEach((element) => {

logger.info(`本条数据为:${JSON.stringify(element)}`);

Object.assign(content, element);

});

fs.writeFileSync(path.join(dirname, './dir.json'), JSON.stringify(content));

大量下載資源

下載資源可能包括圖片、音訊等等。

使用Bagpipe處理非同步並發 參考

const Bagpipe = require('bagpipe');

const bagpipe = new Bagpipe(10);

bagpipe.push(downloadImage, url, dstpath, (err, data) => {

if (err) {

console.log(err);

return;

}

console.log(`[${dstpath}]: ${data}`);

});

下載資源,使用stream來完成檔案寫入。

function downloadImage(src, dest, callback) {

request.head(src, (err, res, body) => {

if (src && src.indexOf('http') > -1 || src.indexOf('https') > -1) {

request(src).pipe(fs.createWriteStream(dest)).on('close', () => {

callback(null, dest);

});

}

});

}

編碼

有時候直接使用cheerio.load處理的網頁內容,寫入檔案後發現是編碼後的文字,可以透過

const $ = cheerio.load(buf, { decodeEntities: false });

來禁止編碼,

ps: encoding庫和iconv-lite未能實現將utf-8編碼的字元轉換為中文,可能是還對API不熟悉,稍後可以關注。

最後,附上一個符合所有dom標籤的正則

const reg = /<.>/g;</.>

相信看了本文案例你已經掌握了方法,更多精彩請關注php中文網其它相關文章!

推薦閱讀:

以上是如何使用nodeJs爬蟲的詳細內容。更多資訊請關注PHP中文網其他相關文章!

Python vs. JavaScript:社區,圖書館和資源Apr 15, 2025 am 12:16 AM

Python vs. JavaScript:社區,圖書館和資源Apr 15, 2025 am 12:16 AMPython和JavaScript在社區、庫和資源方面的對比各有優劣。 1)Python社區友好,適合初學者,但前端開發資源不如JavaScript豐富。 2)Python在數據科學和機器學習庫方面強大,JavaScript則在前端開發庫和框架上更勝一籌。 3)兩者的學習資源都豐富,但Python適合從官方文檔開始,JavaScript則以MDNWebDocs為佳。選擇應基於項目需求和個人興趣。

從C/C到JavaScript:所有工作方式Apr 14, 2025 am 12:05 AM

從C/C到JavaScript:所有工作方式Apr 14, 2025 am 12:05 AM從C/C 轉向JavaScript需要適應動態類型、垃圾回收和異步編程等特點。 1)C/C 是靜態類型語言,需手動管理內存,而JavaScript是動態類型,垃圾回收自動處理。 2)C/C 需編譯成機器碼,JavaScript則為解釋型語言。 3)JavaScript引入閉包、原型鍊和Promise等概念,增強了靈活性和異步編程能力。

JavaScript引擎:比較實施Apr 13, 2025 am 12:05 AM

JavaScript引擎:比較實施Apr 13, 2025 am 12:05 AM不同JavaScript引擎在解析和執行JavaScript代碼時,效果會有所不同,因為每個引擎的實現原理和優化策略各有差異。 1.詞法分析:將源碼轉換為詞法單元。 2.語法分析:生成抽象語法樹。 3.優化和編譯:通過JIT編譯器生成機器碼。 4.執行:運行機器碼。 V8引擎通過即時編譯和隱藏類優化,SpiderMonkey使用類型推斷系統,導致在相同代碼上的性能表現不同。

超越瀏覽器:現實世界中的JavaScriptApr 12, 2025 am 12:06 AM

超越瀏覽器:現實世界中的JavaScriptApr 12, 2025 am 12:06 AMJavaScript在現實世界中的應用包括服務器端編程、移動應用開發和物聯網控制:1.通過Node.js實現服務器端編程,適用於高並發請求處理。 2.通過ReactNative進行移動應用開發,支持跨平台部署。 3.通過Johnny-Five庫用於物聯網設備控制,適用於硬件交互。

使用Next.js(後端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:23 AM

使用Next.js(後端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:23 AM我使用您的日常技術工具構建了功能性的多租戶SaaS應用程序(一個Edtech應用程序),您可以做同樣的事情。 首先,什麼是多租戶SaaS應用程序? 多租戶SaaS應用程序可讓您從唱歌中為多個客戶提供服務

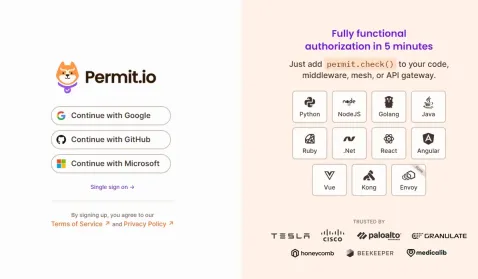

如何使用Next.js(前端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:22 AM

如何使用Next.js(前端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:22 AM本文展示了與許可證確保的後端的前端集成,並使用Next.js構建功能性Edtech SaaS應用程序。 前端獲取用戶權限以控制UI的可見性並確保API要求遵守角色庫

JavaScript:探索網絡語言的多功能性Apr 11, 2025 am 12:01 AM

JavaScript:探索網絡語言的多功能性Apr 11, 2025 am 12:01 AMJavaScript是現代Web開發的核心語言,因其多樣性和靈活性而廣泛應用。 1)前端開發:通過DOM操作和現代框架(如React、Vue.js、Angular)構建動態網頁和單頁面應用。 2)服務器端開發:Node.js利用非阻塞I/O模型處理高並發和實時應用。 3)移動和桌面應用開發:通過ReactNative和Electron實現跨平台開發,提高開發效率。

JavaScript的演變:當前的趨勢和未來前景Apr 10, 2025 am 09:33 AM

JavaScript的演變:當前的趨勢和未來前景Apr 10, 2025 am 09:33 AMJavaScript的最新趨勢包括TypeScript的崛起、現代框架和庫的流行以及WebAssembly的應用。未來前景涵蓋更強大的類型系統、服務器端JavaScript的發展、人工智能和機器學習的擴展以及物聯網和邊緣計算的潛力。

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

禪工作室 13.0.1

強大的PHP整合開發環境

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。