Java網路爬蟲在hadoop的實作方法介紹

- 黄舟原創

- 2017-09-26 09:14:543118瀏覽

下面小編就為大家帶來一篇hadoop中實作java網路爬蟲(範例講解)。小編覺得蠻不錯的,現在就分享給大家,也給大家做個參考。一起跟著小編過來看看吧

這篇網路爬蟲的實作就要聯絡上大數據了。在前兩篇java實作網路爬蟲和heritrix實作網路爬蟲的基礎上,這次是要完整的做一次資料的收集、資料上傳、資料分析、資料結果讀取、資料視覺化。

需要用到

Cygwin:一個在windows平台上運行的類別UNIX模擬環境,直接在網路上搜尋下載,並且安裝;

Hadoop :設定Hadoop環境,實作了一個分散式檔案系統(Hadoop Distributed File System),簡稱HDFS,用來將收集的資料直接上傳儲存到HDFS,然後用MapReduce分析;

Eclipse:寫程式碼,需要匯入hadoop的jar包,以可以建立MapReduce專案;

Jsoup:html的解析jar包,結合正規表示式能更好的解析網頁原始碼;

----- >

目錄:

#1、設定Cygwin

2、配置Hadoop黃靜

3、Eclipse開發環境建置

#4、網路資料爬取(jsoup)

# -------->

1、安裝設定Cygwin

從官方網站下載Cygwin 安裝文件,位址:https ://cygwin.com/install.html

下載運行後進入安裝介面。

安裝時直接從網路映像下載擴充包,至少需要選擇ssh和ssl支援包

安裝後進入cygwin控制台介面,

運行ssh-host- config指令,安裝SSH

輸入:no,yes,ntsec,no,no#注意:win7下需要改為yes,yes,ntsec,no,yes,輸入密碼並確認這個步驟完成後會在windows作業系統中設定好一個Cygwin sshd服務,啟動該服務即可。

然後要設定ssh免密碼登陸

重新執行cygwin。 執行ssh localhost,會要求使用密碼進行登陸。

使用ssh-keygen指令來產生一個ssh金鑰,一直回車結束即可。

重新進入系統後,透過ssh localhost就可以直接進入系統,不需要再輸入密碼了。

2、設定Hadoop環境

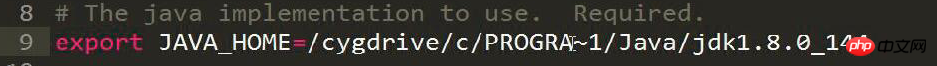

修改hadoop-env.sh文件,加入JDK安裝目錄的JAVA_HOME位置設定。

# The java implementation to use. Required. export JAVA_HOME=/cygdrive/c/Java/jdk1.7.0_67如圖注意:

Program Files縮寫為PROGRA~1

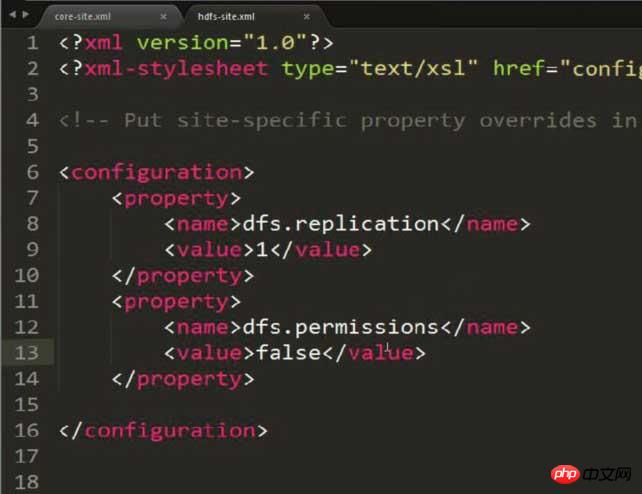

修改hdfs -site.xml,設定存放副本為1(因為配置的是偽分散式方式)

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> </configuration>

注意:此圖片多加了一個property ,內容就是解決可能出現的權限問題! ! !

可以在HDFS中透過指令動態對檔案或資料夾進行CRUD

可以在HDFS中透過指令動態對檔案或資料夾進行CRUD

注意有可能出現權限的問題,需要透過在hdfs-site.xml中配置以下內容來避免:

<property> <name>dfs.permissions</name> <value>false</value> </property>

修改mapred-site.xml,設定JobTracker運行的伺服器與連接埠號碼(由於目前就是運行在本機上,直接寫入localhost 即可,連接埠可以綁定任意空閒連接埠)##<configuration>

<property>

<name>mapred.job.tracker</name>

<value>localhost:9001</value>

</property>

</configuration>

設定core -site.xml,設定HDFS檔案系統所對應的伺服器與連接埠號碼(同樣就在目前主機)

#

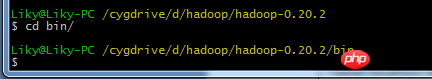

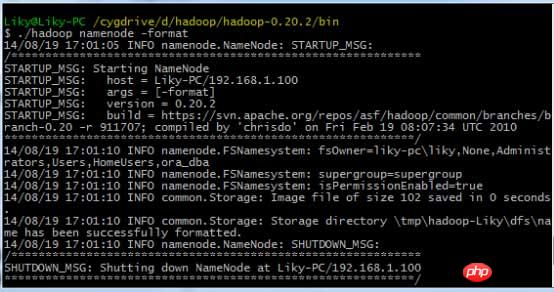

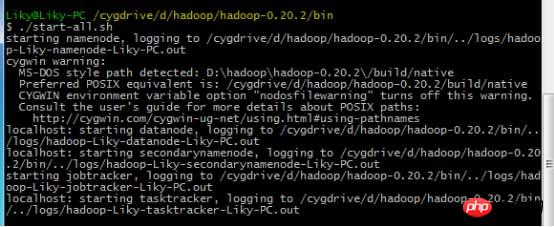

<configuration> <property> <name>fs.default.name</name> <value>hdfs://localhost:9000</value> </property> </configuration>配置以上內容後,在Cygwin中進入hadoop目錄 ###在bin目錄下,對HDFS檔案系統進行格式化(第一次使用前必須格式化),然後輸入啟動指令:####### ########################3、Eclipse開發環境建構###############這個在我寫的部落格大數據【二】HDFS部署及檔案讀寫(包含eclipse hadoop設定)中給出大致設定方法。不過此時需要完善一下。 #########將hadoop中的hadoop-eclipse-plugin.jar支援包拷貝到eclipse的plugin目錄下,為eclipse新增Hadoop支援。 ######啟動Eclipse後,切換到MapReduce介面。 ###

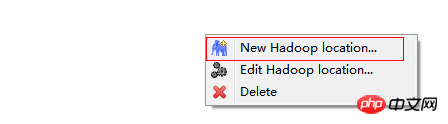

在windows工具选项选择showviews的others里面查找map/reduce locations。

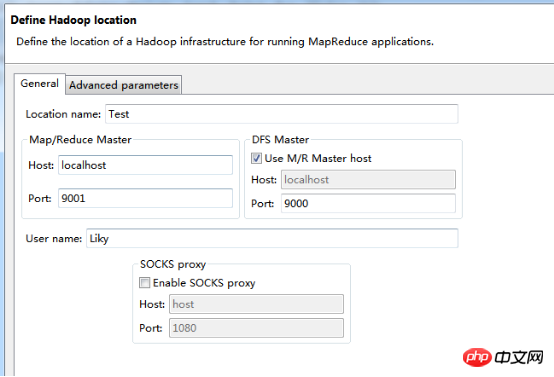

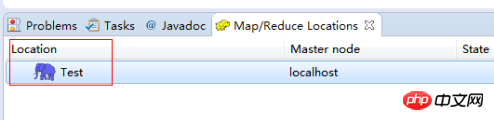

在Map/Reduce Locations窗口中建立一个Hadoop Location,以便与Hadoop进行关联。

注意:此处的两个端口应为你配置hadoop的时候设置的端口!!!

完成后会建立好一个Hadoop Location

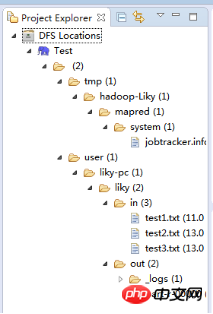

在左侧的DFS Location中,还可以看到HDFS中的各个目录

并且你可以在其目录下自由创建文件夹来存取数据。

下面你就可以创建mapreduce项目了,方法同正常创建一样。

4、网络数据爬取

现在我们通过编写一段程序,来将爬取的新闻内容的有效信息保存到HDFS中。

此时就有了两种网络爬虫的方法:

其一就是利用heritrix工具获取的数据;

其一就是java代码结合jsoup编写的网络爬虫。

方法一的信息保存到HDFS:

直接读取生成的本地文件,用jsoup解析html,此时需要将jsoup的jar包导入到项目中。

package org.liky.sina.save;

//这里用到了JSoup开发包,该包可以很简单的提取到HTML中的有效信息

import java.io.File;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements;

public class SinaNewsData {

private static Configuration conf = new Configuration();

private static FileSystem fs;

private static Path path;

private static int count = 0;

public static void main(String[] args) {

parseAllFile(new File(

"E:/heritrix-1.12.1/jobs/sina_news_job_02-20170814013255352/mirror/"));

}

public static void parseAllFile(File file) {

// 判断类型

if (file.isDirectory()) {

// 文件夹

File[] allFile = file.listFiles();

if (allFile != null) {

for (File f : allFile) {

parseAllFile(f);

}

}

} else {

// 文件

if (file.getName().endsWith(".html")

|| file.getName().endsWith(".shtml")) {

parseContent(file.getAbsolutePath());

}

}

}

public static void parseContent(String filePath) {

try {

//用jsoup的方法读取文件路径

Document doc = Jsoup.parse(new File(filePath), "utf-8");

//读取标题

String title = doc.title();

Elements descElem = doc.getElementsByAttributeValue("name",

"description");

Element descE = descElem.first();

// 读取内容

String content = descE.attr("content");

if (title != null && content != null) {

//通过Path来保存数据到HDFS中

path = new Path("hdfs://localhost:9000/input/"

+ System.currentTimeMillis() + ".txt");

fs = path.getFileSystem(conf);

// 建立输出流对象

FSDataOutputStream os = fs.create(path);

// 使用os完成输出

os.writeChars(title + "\r\n" + content);

os.close();

count++;

System.out.println("已经完成" + count + " 个!");

}

} catch (Exception e) {

e.printStackTrace();

}

}

}以上是Java網路爬蟲在hadoop的實作方法介紹的詳細內容。更多資訊請關注PHP中文網其他相關文章!