在學習機器學習演算法的過程中,我們經常需要資料來驗證演算法,調試參數。但是要找到一組十分合適某種特定演算法類型的資料樣本卻不那麼容易。還好numpy, scikit-learn都提供了隨機資料產生的功能,我們可以自己產生適合某一種模型的數據,用隨機資料來做清洗,歸一化,轉換,然後選擇模型與算法做擬合和預測。下面對scikit-learn和numpy產生資料樣本的方法做一個總結。

1. numpy隨機資料產生API

numpy比較適合用來生產一些簡單的抽樣資料。 API都在random類別中,常見的API有:

1) rand(d0, d1, ..., dn) 用來產生d0xd1x...dn維的陣列。陣列的值在[0,1]之間

例如:np.random.rand(3,2,2),輸出如下3x2x2的陣列

array([[[ 0.49042678, 0.60643763],

[ 0.18370487, 0.10836908]],

[[ 0.38269728, 0.66130293],

[ 0.5775944 , 0.52354981]],

[[ 0.71705929, 0.89453574],

[ 0.36245334, 0.37545211]]]) #2) randn((d0, d1, ..., dn), 也是用來產生d0xd1x...dn維的陣列。不過數組的值服從N(0,1)的標準常態分配。

例如:np.random.randn(3,2),輸出如下3x2的數組,這些值是N(0,1)的抽樣資料。 ,σ2)N(μ,σ2)的常態分佈,只需要在randn上每個產生的值x上做變換σx+μσx+μ即可,例如:

例如:2*np.random.randn(3,2) + 1,輸出如下3x2的數組,這些值是N(1,4)的抽樣資料。 low[, high, size]),產生隨機的大小為size的數據,size可以為

,為矩陣維數,或張量的維度。值位於半開區間 [low, high)。

例如:np.random.randint(3, size=[2,3,4])傳回維數維2x3x4的資料。取值範圍為最大值為3的整數。array([[-0.5889483 , -0.34054626],

[-2.03094528, -0.21205145],

[-0.20804811, -0.97289898]])再例如: np.random.randint(3, 6, size=[2,3]) 傳回維度為2x3的資料。取值範圍為[3,6).

array([[ 2.32910328, -0.677016 ],

[-0.09049511, 1.04687598],

[ 2.13493001, 3.30025852]])4) random_integers(low[, high, size]),和上面的randint類似,區別在與取值範圍是閉區間[low, high] 。

5) random_sample([size]), 傳回隨機的浮點數,在半開區間 [0.0, 1.0)。如果是其他區間[a,b),可以轉換(b - a) * random_sample([size]) + a

#例如: (5-2)*np.random.random_sample(3)+2傳回[2,5)之間的3個隨機數。

array([[[2, 1, 2, 1], [0, 1, 2, 1], [2, 1, 0, 2]], [[0, 1, 0, 0], [1, 1, 2, 1], [1, 0, 1, 2]]])

2. scikit-learn隨機資料產生API介紹

scikit-learn產生隨機資料的API都在datasets類別之中,和numpy比起來,可以用來產生適合特定機器學習模型的數據。常用的API有:

1) 用make_regression 產生迴歸模型的資料

2) 用make_hastie_10_2,make_classification或make_multilabel_classification產生分類模型資料

3) 聚用make_blobs類別模型資料

4) 用make_gaussian_quantiles產生分組多維度常態分佈的資料

3. scikit-learn隨機資料產生實例

#3.1 迴歸模型隨機資料

這裡我們使用make_regression產生迴歸模型資料。幾個關鍵參數有n_samples(產生樣本數), n_features(樣本特徵數),noise(樣本隨機雜訊)和coef(是否返回迴歸係數)。範例程式碼如下:

array([[4, 5, 3], [3, 4, 5]])

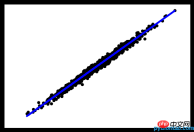

輸出的圖如下:

3.2 分類模型隨機資料 這裡我們用make_classification產生三元分類模型資料。幾個關鍵參數有n_samples(產生樣本數), n_features(樣本特徵數), n_redundant(冗餘特徵數)和n_classes(輸出的類別數),範例程式碼如下:

這裡我們用make_classification產生三元分類模型資料。幾個關鍵參數有n_samples(產生樣本數), n_features(樣本特徵數), n_redundant(冗餘特徵數)和n_classes(輸出的類別數),範例程式碼如下:

array([ 2.87037573, 4.33790491, 2.1662832 ])#輸出的圖如下:

這裡我們用make_blobs產生聚類模型資料。幾個關鍵參數有n_samples(產生樣本數), n_features(樣本特徵數),centers(簇中心的個數或自訂的簇中心)和cluster_std(簇資料方差,代表簇的聚合程度)。範例如下:

這裡我們用make_blobs產生聚類模型資料。幾個關鍵參數有n_samples(產生樣本數), n_features(樣本特徵數),centers(簇中心的個數或自訂的簇中心)和cluster_std(簇資料方差,代表簇的聚合程度)。範例如下:

import numpy as np import matplotlib.pyplot as plt %matplotlib inline from sklearn.datasets.samples_generator import make_regression # X为样本特征,y为样本输出, coef为回归系数,共1000个样本,每个样本1个特征 X, y, coef =make_regression(n_samples=1000, n_features=1,noise=10, coef=True) # 画图 plt.scatter(X, y, color='black') plt.plot(X, X*coef, color='blue', linewidth=3) plt.xticks(()) plt.yticks(()) plt.show()輸出的圖如下:

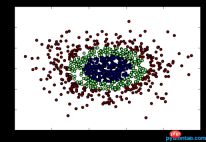

3.4 分组正态分布混合数据

我们用make_gaussian_quantiles生成分组多维正态分布的数据。几个关键参数有n_samples(生成样本数), n_features(正态分布的维数),mean(特征均值), cov(样本协方差的系数), n_classes(数据在正态分布中按分位数分配的组数)。 例子如下:

import numpy as np import matplotlib.pyplot as plt %matplotlib inline from sklearn.datasets import make_gaussian_quantiles #生成2维正态分布,生成的数据按分位数分成3组,1000个样本,2个样本特征均值为1和2,协方差系数为2 X1, Y1 = make_gaussian_quantiles(n_samples=1000, n_features=2, n_classes=3, mean=[1,2],cov=2) plt.scatter(X1[:, 0], X1[:, 1], marker='o', c=Y1)

输出图如下

以上就是生产随机数据的一个总结,希望可以帮到学习机器学习算法的朋友们。

以上是機器學習演算法的隨機資料產生方法介紹的詳細內容。更多資訊請關注PHP中文網其他相關文章!

列表和陣列之間的選擇如何影響涉及大型數據集的Python應用程序的整體性能?May 03, 2025 am 12:11 AM

列表和陣列之間的選擇如何影響涉及大型數據集的Python應用程序的整體性能?May 03, 2025 am 12:11 AMForhandlinglargedatasetsinPython,useNumPyarraysforbetterperformance.1)NumPyarraysarememory-efficientandfasterfornumericaloperations.2)Avoidunnecessarytypeconversions.3)Leveragevectorizationforreducedtimecomplexity.4)Managememoryusagewithefficientdata

說明如何將內存分配給Python中的列表與數組。May 03, 2025 am 12:10 AM

說明如何將內存分配給Python中的列表與數組。May 03, 2025 am 12:10 AMInpython,ListSusedynamicMemoryAllocationWithOver-Asalose,而alenumpyArraySallaySallocateFixedMemory.1)listssallocatemoremoremoremorythanneededinentientary上,respizeTized.2)numpyarsallaysallaysallocateAllocateAllocateAlcocateExactMemoryForements,OfferingPrediCtableSageButlessemageButlesseflextlessibility。

您如何在Python數組中指定元素的數據類型?May 03, 2025 am 12:06 AM

您如何在Python數組中指定元素的數據類型?May 03, 2025 am 12:06 AMInpython,YouCansspecthedatatAtatatPeyFelemereModeRernSpant.1)Usenpynernrump.1)Usenpynyp.dloatp.dloatp.ploatm64,formor professisconsiscontrolatatypes。

什麼是Numpy,為什麼對於Python中的數值計算很重要?May 03, 2025 am 12:03 AM

什麼是Numpy,為什麼對於Python中的數值計算很重要?May 03, 2025 am 12:03 AMNumPyisessentialfornumericalcomputinginPythonduetoitsspeed,memoryefficiency,andcomprehensivemathematicalfunctions.1)It'sfastbecauseitperformsoperationsinC.2)NumPyarraysaremorememory-efficientthanPythonlists.3)Itoffersawiderangeofmathematicaloperation

討論'連續內存分配”的概念及其對數組的重要性。May 03, 2025 am 12:01 AM

討論'連續內存分配”的概念及其對數組的重要性。May 03, 2025 am 12:01 AMContiguousmemoryallocationiscrucialforarraysbecauseitallowsforefficientandfastelementaccess.1)Itenablesconstanttimeaccess,O(1),duetodirectaddresscalculation.2)Itimprovescacheefficiencybyallowingmultipleelementfetchespercacheline.3)Itsimplifiesmemorym

您如何切成python列表?May 02, 2025 am 12:14 AM

您如何切成python列表?May 02, 2025 am 12:14 AMSlicingaPythonlistisdoneusingthesyntaxlist[start:stop:step].Here'showitworks:1)Startistheindexofthefirstelementtoinclude.2)Stopistheindexofthefirstelementtoexclude.3)Stepistheincrementbetweenelements.It'susefulforextractingportionsoflistsandcanuseneg

在Numpy陣列上可以執行哪些常見操作?May 02, 2025 am 12:09 AM

在Numpy陣列上可以執行哪些常見操作?May 02, 2025 am 12:09 AMnumpyallowsforvariousoperationsonArrays:1)basicarithmeticlikeaddition,減法,乘法和division; 2)evationAperationssuchasmatrixmultiplication; 3)element-wiseOperations wiseOperationswithOutexpliitloops; 4)

Python的數據分析中如何使用陣列?May 02, 2025 am 12:09 AM

Python的數據分析中如何使用陣列?May 02, 2025 am 12:09 AMArresinpython,尤其是Throughnumpyandpandas,weessentialFordataAnalysis,offeringSpeedAndeffied.1)NumpyArseNable efflaysenable efficefliceHandlingAtaSetSetSetSetSetSetSetSetSetSetSetsetSetSetSetSetsopplexoperationslikemovingaverages.2)

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

SublimeText3漢化版

中文版,非常好用

WebStorm Mac版

好用的JavaScript開發工具

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器