Google的Gemini 2.0型號正在徹底改變AI景觀,從而為聊天機器人和開發人員工具提供了重大升級。 我親自測試了Gemini 2.0 Flash,實驗性Gemini 2.0 Pro和預算友好的Gemini 2.0 Flash-Lite - 全部免費! 目錄的

表訪問Gemini 2.0 API

- Gemini 2.0 Flash:動手評論

- gemini 2.0 pro(實驗):深度潛水

- Gemini 2.0 Flash-lite:成本效益的性能

- Gemini 2.0閃存思維模式:增強的推理

- 選擇合適的模型

- 最終想法

- >

> >

步驟1:訪問此鏈接。

>選擇“獲取雙子座API鍵。” >

步驟3:單擊“創建API鍵”。

>

>

選擇現有的Google Cloud Project。

> >步驟5:

>步驟5:

gemini 2.0 Flash:動手評論

最初的實驗性,Gemini 2.0 Flash現在很容易獲得併集成到許多Google AI產品中。 我在Google AI Studio和Vertex AI中使用Gemini API的測試顯示,比其前身更快,更有效的模型。在缺乏Pro版本的高級推理的同時,它在快速響應和一般任務方面表現出色。 在此相關的博客文章中了解更多信息。

燃油速度:

非常適合實時應用程序。- >

- 未來的增強: Google承諾文本到語音和圖像生成功能。

- 輕鬆集成:可通過雙子座應用程序,Google AI Studio和Vertex AI訪問

- (代碼示例和輸出保持不變) >

gemini 2.0 pro(實驗):深水潛水

>通過Google AI Studio訪問了仍處於實驗階段的頂級模型。 Gemini 2.0 Pro是為複雜的推理和編碼而建立的,它超出了期望。 在此相關的博客文章中了解更多信息。 鑰匙要點: >

>

>

gemini 2.0閃存思維模式:增強推理 >

這種模式通過明確顯示AI的思維過程來改善問題解決。 在Gemini應用程序中可用,它將問題分解為較小的部分,提供結構化的推理方法。

清晰的解釋: 選擇正確的模型 最佳的雙子座2.0模型取決於您的特定需求: 最終想法 展示了對AI創新的堅定承諾。 每種模型都具有獨特的優勢,平衡速度,成本和推理功能。 自由訪問提供了一個很好的機會,可以探索這些尖端的AI解決方案。 未來的增強功能,例如文本到語音和圖像生成,都有更多的功能。 選擇取決於您的優先級:速度,智力或成本。 Google為每個提供了一個強大的選項。

(Gemini 2.0 Pro可在Google AI Studio和Vertex AI中提供實驗可用,以及Gemini高級用戶。

(代碼示例和輸出保持不變) > Gemini 2.0 Flash-Lite是Google的成本效益解決方案,平衡性能和負擔能力。 它具有1M令牌上下文窗口和多模式輸入支持,同時保持了先前的1.5閃存模型的速度。 在此相關的博客文章中了解更多信息。

> Gemini 2.0 Flash-Lite是Google的成本效益解決方案,平衡性能和負擔能力。 它具有1M令牌上下文窗口和多模式輸入支持,同時保持了先前的1.5閃存模型的速度。 在此相關的博客文章中了解更多信息。 預算友好型:

>

Model

Best For

Context Window

Availability

Gemini 2.0 Flash

High-volume, high-frequency tasks at scale

1M Tokens

Public

Gemini 2.0 Pro (Exp.)

Complex tasks, coding, deep reasoning

2M Tokens

Google AI Studio, Vertex AI

Gemini 2.0 Flash-Lite

Cost-sensitive applications, efficiency

1M Tokens

Public Preview

以上是我免費嘗試了所有最新的Gemini 2.0模型API!的詳細內容。更多資訊請關注PHP中文網其他相關文章!

7強大的AI提示每個項目經理現在需要掌握May 08, 2025 am 11:39 AM

7強大的AI提示每個項目經理現在需要掌握May 08, 2025 am 11:39 AM聊天機器人像Chatgpt這樣的聊天機器人舉例說明了生成的AI,為項目經理提供了功能強大的工具來簡化工作流程並確保項目按計劃和預算範圍內保持。 但是,在製作正確的提示時有效使用鉸鏈。 精確,細節

通過AI本身的有益協助,定義難以捉摸的AGI的含義不明的含義May 08, 2025 am 11:37 AM

通過AI本身的有益協助,定義難以捉摸的AGI的含義不明的含義May 08, 2025 am 11:37 AM定義人工智能(AGI)的挑戰是重大的。 AGI進步的主張通常缺乏明確的基準,其定義是針對預定的研究方向而定制的。本文探討了一種新穎的定義方法

IBM認為2025展示watsonx.data在生成AI中的作用May 08, 2025 am 11:32 AM

IBM認為2025展示watsonx.data在生成AI中的作用May 08, 2025 am 11:32 AMIBM WATSONX.DATA:簡化企業AI數據堆棧 IBM將WATSONX.DATA定位為企業的關鍵平台,旨在加速精確而可擴展的生成AI解決方案。 這是通過簡化投訴來實現的

人形機器人機器的崛起即將到來。May 08, 2025 am 11:29 AM

人形機器人機器的崛起即將到來。May 08, 2025 am 11:29 AM在AI和材料科學領域的突破所推動的機器人技術的快速進步已準備好迎來人類機器人的新時代。 多年來,工業自動化一直是主要重點,但是機器人的功能迅速exp

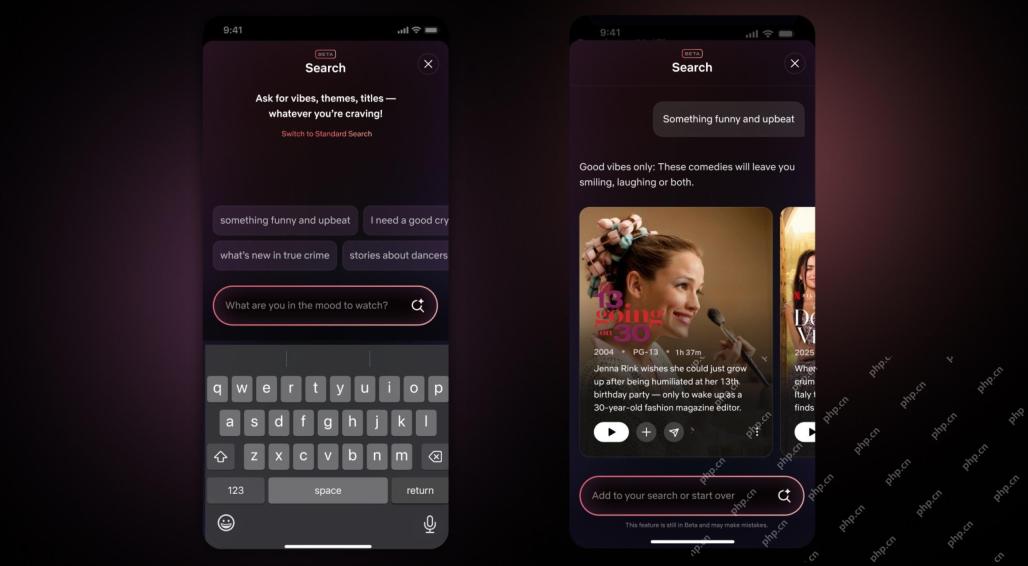

Netflix重新修改界面 - 首次亮相AI搜索工具和類似Tiktok的設計May 08, 2025 am 11:25 AM

Netflix重新修改界面 - 首次亮相AI搜索工具和類似Tiktok的設計May 08, 2025 am 11:25 AMNetflix 界面十年來最大更新:更智能、更個性化,擁抱多元內容 Netflix 週三宣布對其用戶界面進行十年來最大規模的改版,不僅外觀煥然一新,還增加了更多關於每個節目的信息,並引入了更智能的 AI 搜索工具,能夠理解模糊的概念(例如“氛圍”),以及更靈活的結構,以便更好地展示公司在新興的視頻遊戲、直播活動、體育賽事和其他新型內容方面的興趣。 為了緊跟潮流,新的移動端豎屏視頻組件將使粉絲更容易滾動瀏覽預告片和片段,觀看完整節目或與他人分享內容。這讓人聯想起無限滾動且非常成功的短視頻網站 Ti

在AGI之前很久:三個AI里程碑會挑戰您May 08, 2025 am 11:24 AM

在AGI之前很久:三個AI里程碑會挑戰您May 08, 2025 am 11:24 AM人工智能通用智能(AGI)的討論日益增多,促使許多人思考當人工智能超越人類智能時會發生什麼。這個時刻是近在咫尺還是遙遙無期,取決於你問誰,但我認為這並非我們應該關注的最重要的里程碑。哪些更早的人工智能里程碑會影響到每個人?哪些里程碑已經實現?以下是我認為已經發生的三件事。 人工智能超越人類弱點 在2022年的電影《社交困境》中,人文科技中心(Center for Humane Technology)的崔斯坦·哈里斯指出,人工智能已經超越了人類的弱點。這是什麼意思?這意味著人工智能已經能夠運用人類

Venkat Achanta在Transunion的平台轉型和AI野心May 08, 2025 am 11:23 AM

Venkat Achanta在Transunion的平台轉型和AI野心May 08, 2025 am 11:23 AMTransunion的首席技術官Ranganath Achanta在2021年末加入公司後加入公司以來,率先進行了重大的技術轉變。

當對AI的信任躍升時,生產力會隨之而來May 08, 2025 am 11:11 AM

當對AI的信任躍升時,生產力會隨之而來May 08, 2025 am 11:11 AM建立信任至關重要,對於成功採用業務的AI是至關重要的。 考慮到業務流程中的人類因素,這尤其如此。 像其他任何人一樣,員工對AI及其實施引起了人們的關注。 德勤研究人員是SC

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

SublimeText3 Linux新版

SublimeText3 Linux最新版

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

Atom編輯器mac版下載

最受歡迎的的開源編輯器