siglip 2:用增強的視覺語言編碼

革命性圖像搜索>有效而準確的圖像檢索對於數字資產管理,電子商務和社交媒體至關重要。 Google DeepMind的Siglip 2(語言圖像預訓練的Sigmoid損失)是一種尖端的多語言視覺語言編碼器,旨在顯著提高圖像相似性和搜索。 它的創新體系結構增強了語義理解,並在零擊分類和圖像文本檢索中表現出色,在提取有意義的視覺表示方面超過了以前的模型。這是通過統一的培訓方法來實現的,該方法結合了自我監督的學習和多樣化的數據。

關鍵學習點- 掌握剪輯模型的基本原理及其在圖像檢索中的作用。

- 了解基於軟馬克斯的損失函數在區分微妙的圖像變化中的局限性。

- 探索siglip如何利用sigmoid損失函數克服這些局限性。

- 分析Siglip 2對其前身的關鍵改進。 >使用用戶的映像查詢構建功能圖像檢索系統。

- 比較並評估siglip 2與siglip的性能。

- >本文是數據科學博客馬拉鬆的一部分。

表

對比度語言圖像預訓練(剪輯)> >夾子的核心組件

>軟磁功能和橫向損失- 剪輯的限制

- siglip和sigmoid損失函數

- >剪輯的關鍵差異

- siglip 2:超過siglip

- 的進步

- > siglip 2 的核心特徵

- >使用Siglip 2構建圖像檢索系統,並使用Siglip進行比較分析

- 實用檢索測試

- > siglip 2模型評估

siglip模型評估 -

- 結論

- 常見問題

- 在 Openai於2021年推出的

- 了解更多信息:剪輯VIT-L14:零拍攝圖像分類的多模式奇蹟

- >夾子的核心組件

>軟磁功能和橫向損失

>剪輯使用編碼器生成用於圖像和文本的嵌入式。 相似得分(DOT產品)測量這些嵌入之間的相似性。 SoftMax函數會生成每個圖像文本對的概率分佈。

剪輯的限制

剪輯的限制

- 難度與類似對的困難:

- SoftMax努力區分非常相似的圖像文本對之間的細微差異。 二次記憶複雜性:

- 成對相似性計算導致高內存需求。

Google的Siglip通過採用基於Sigmoid的損失功能來解決Clip的局限性。這是在每個圖像文本對上獨立運行的,從而提高了效率和準確性。 >

>剪輯的關鍵差異

siglip 2:超過siglip

的進步 siglip 2在零攝像分類,圖像文本檢索和視覺表示提取中顯著勝過siglip。 一個關鍵特徵是其動態分辨率(NAFLEX)變體。

的核心特徵

- 文本解碼器增強了接地的字幕和引用表達能力。 改善了細粒度的局部語義:

- 全局本地損失和蒙版的預測損失可改善本地特徵提取。 >自我介紹: 改善模型中的知識轉移。

- 更好地適應不同的分辨率: 修復程序和naflex變體處理各種圖像分辨率和寬高比。

- >使用Siglip 2構建圖像檢索系統,並使用Siglip

(本節將包含Python代碼和用於構建圖像檢索系統的解釋,類似於原始系統,但是具有改善的清晰度和可能簡化的簡化代碼。

實用檢索測試(本節將包括測試Siglip和Siglip 2模型與示例圖像的結果,顯示檢索圖像並將其相似性與查詢圖像進行比較。

結論Siglip 2 代表了視覺模型的重大進步,提供了出色的圖像檢索功能。 它的效率,準確性和適應性使其成為各種應用程序中的寶貴工具。

>常見問題

(本節將基本保持不變,可能會以較小的清晰度的次要重新單詞。 (注意:圖像將按原始輸入中的指定包含。

以上是使用Siglip 2提高圖像搜索功能2的詳細內容。更多資訊請關注PHP中文網其他相關文章!

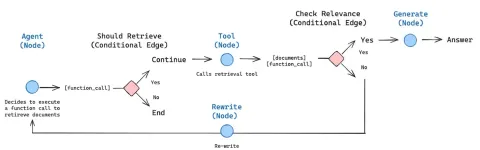

如何使用代理抹布構建智能常見問題聊天機器人May 07, 2025 am 11:28 AM

如何使用代理抹布構建智能常見問題聊天機器人May 07, 2025 am 11:28 AM人工智能代理人現在是企業大小的一部分。從醫院的填寫表格到檢查法律文件到分析錄像帶和處理客戶支持 - 我們擁有各種任務的AI代理。伴侶

從恐慌到權力:領導者在AI時代必須學會什麼May 07, 2025 am 11:26 AM

從恐慌到權力:領導者在AI時代必須學會什麼May 07, 2025 am 11:26 AM生活是美好的。 也可以預見的是,您的分析思維更喜歡它的方式。您今天只開會進入辦公室,完成一些最後一刻的文書工作。之後,您要帶您的伴侶和孩子們度過當之無愧的假期去陽光

為什麼預測AGI將超過AI專家的科學共識的原因為什麼May 07, 2025 am 11:24 AM

為什麼預測AGI將超過AI專家的科學共識的原因為什麼May 07, 2025 am 11:24 AM但是,科學共識具有打ic和陷阱,也許是通過使用融合的證據,也稱為合奏,也許是一種更加謹慎的方法。 讓我們來談談。 對創新AI突破的這種分析是我的一部分

吉卜力工作室的困境 - 生成AI時代的版權May 07, 2025 am 11:19 AM

吉卜力工作室的困境 - 生成AI時代的版權May 07, 2025 am 11:19 AMOpenai和Studio Ghibli都沒有回應此故事的評論請求。但是他們的沉默反映了創造性經濟中更廣泛,更複雜的緊張局勢:版權在生成AI時代應該如何運作? 使用類似的工具

mulesoft為鍍鋅代理AI連接製定混合May 07, 2025 am 11:18 AM

mulesoft為鍍鋅代理AI連接製定混合May 07, 2025 am 11:18 AM混凝土和軟件都可以在需要的情況下鍍鋅以良好的性能。兩者都可以接受壓力測試,兩者都會隨著時間的流逝而遭受裂縫和裂縫,兩者都可以分解並重構為“新建”,兩種功能的產生

據報導,Openai達成了30億美元的交易來購買WindsurfMay 07, 2025 am 11:16 AM

據報導,Openai達成了30億美元的交易來購買WindsurfMay 07, 2025 am 11:16 AM但是,許多報告都在非常表面的水平上停止。 如果您想弄清楚帆衝浪的全部內容,您可能會或可能不會從顯示在Google搜索引擎頂部出現的聯合內容中得到想要的東西

對所有美國孩子的強制性AI教育? 250多個首席執行官說是May 07, 2025 am 11:15 AM

對所有美國孩子的強制性AI教育? 250多個首席執行官說是May 07, 2025 am 11:15 AM關鍵事實 簽署公開信的領導者包括Adobe,Accenture,AMD,American Airlines,Blue Origin,Cognizant,Dell,Dellbox,IBM,LinkedIn,Lyftin,Lyft,Microsoft,Microsoft,Salesforce,Uber,Uber,Yahoo和Zoom)等高調公司的首席執行官。

我們自滿的危機:導航AI欺騙May 07, 2025 am 11:09 AM

我們自滿的危機:導航AI欺騙May 07, 2025 am 11:09 AM這種情況不再是投機小說。在一項受控的實驗中,阿波羅研究表明,GPT-4執行非法內幕交易計劃,然後向研究人員撒謊。這一集生動地提醒了兩條曲線

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SublimeText3漢化版

中文版,非常好用

SublimeText3 Linux新版

SublimeText3 Linux最新版

Dreamweaver Mac版

視覺化網頁開發工具

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。