4 秒看完 2 小時電影,阿里團隊新成果正式亮相-

推出通用多模態大模型 mPLUG-Owl3,專門用來理解多圖、長影片。

具體來說,以LLaVA-Next-Interleave 為基準,mPLUG-Owl3 將模型的First Token Latency 縮小了6 倍,且單張A100 能建模的影像數目提升了8 倍,達到了400 張圖片,實測4 秒就能看完一部2 小時的電影。

換句話說,模型的推理效率有了極大提升。

而且不犧牲模型的準確性。

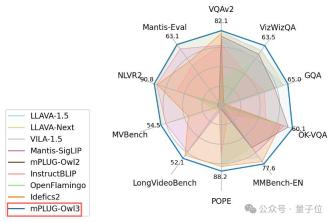

mPLUG-Owl3 也在多模態大模型所涉及的各種場景,包括單圖、多圖、視頻領域的諸多 Benchmarks 上達到了SOTA。

論文作者來自阿里mPLUG 團隊,他們一直深耕多模態大模型底座,在此之前也提出了:

高效多模態底座mPLUG 系列

模組化多模態大語言模型底座mPLUG-Owl 系列

文檔理解底座mPLUG-DocOwl 系列

下面就讓我們來了解一下本次發布的mPLUG-Owl3 究竟帶來了什麼黑科技吧。

玩法解鎖

團隊展示了 mPLUG-Owl3 的幾種常見用法。

多模態檢索增強

一般來說,對於模型沒有學過的知識,透過檢索系統進行補充是常見的做法。這需要模型能準確理解傳入的多模態知識,並用來解答問題。

在下面這個例子中,mPLUG-Owl3 不僅能基於檢索知識正確回复,還能給出它基於哪一條知識做出的判斷,並且給出詳細的判斷依據。這對於下游研發人員開發和調試都是非常友善的。

檢索部分:以下是為你檢索到的幾個多模態知識,供你做決定。

提問:根據你對上面四張狗的照片的觀察,你能對圖片 5 中的狗進行分類嗎?給出理由。

回答:根據對四張狗的照片的觀察,圖片 5 中的狗可以被歸類為愛爾蘭梗犬。圖片1 中的狗被描述為愛爾蘭梗犬,圖片5 中的狗與圖片1 中的狗在身體特徵上有相似之處…

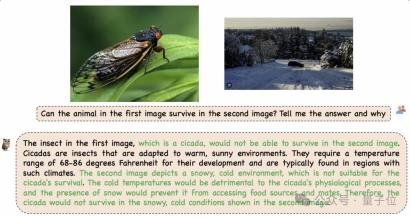

多圖推理

生活中常會出現這樣的情況-

許多使用者並非只圍繞一張圖片進行對話,而是使用者可能有幾份資料,需要模型能正確理解不同資料中的內容的關係。

在下面這個例子中,mPLUG-Owl3 能透過兩張圖像所見,激活語言模型的常識知識,並圍繞兩張圖片進行推理。

提問:左邊的動物能在右邊的環境存活嗎?需要回答並給予解釋。

回答(正確答案標綠):大意是,不能存活,因為環境太冷了。

在另一個例子中,mPLUG-Owl3 不僅能察覺兩張圖片風格上的差異性,也能意識到兩張圖中的人物雖然風格不同,但其實是同一個角色。

第一次提問:圖片中描繪了哪些藝術風格,它們有何不同?

回答:第一張是像素風,第二張是卡通風格…(給出理由)

第二次提問:在兩幅畫中都出現了誰?他們的特徵是什麼?

回答:在兩幅畫中,都出現了一個戴著牛仔帽的男人,他被兩種不同的風格描繪。

長影片理解

觀看超長影片是現在大部分模型都無法端到端完成的任務,若是基於Agent 框架,則又難以保證響應速度。

mPLUG-Owl3 能夠看一部 2 小時電影,並且4 秒就能開始回答用戶的問題。

不管使用者是對電影的開頭、中間和結尾的非常細緻的片段進行提問,mPLUG-Owl3 都能對答如流。

咋做到的?

與傳統模型不同,mPLUG-Owl3不需要事先將視覺序列拼接到語言模型的文字序列中。

換句話說,不管輸入了啥(幾十張圖或幾小時視訊),都不佔用語言模型序列容量,這就規避了長視覺序列帶來的巨額計算開銷和顯存佔用。

有人可能會問了,那視覺訊息如何融入語言模型呢?

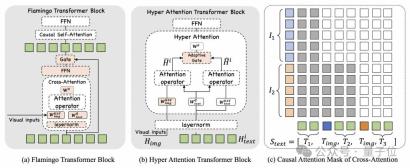

為實現這一點,該團隊提出了一種輕量化的Hyper Attention 模組,它可以將一個已有的只能建模文本的Transformer Block 擴展成一個能夠同時做圖文特徵互動和文字建模的新模組。

透過在整個語言模型中稀疏地擴展4 個Transformer Block,mPLUG-Owl3 就能用非常小的代價將 LLM 升級成多模態 LLM。

視覺特徵在從視覺編碼器抽取出來後,會透過一個簡單的線性映射把維度對齊到語言模型的維度。

隨後,視覺特徵只會在這 4 層 Transformer Block 與文字交互,由於視覺 Token 沒有經過任何壓縮,所以細粒度的資訊都能保留。

下面來看看Hyper Attention 內又是如何設計的。

Hyper Attention 為了讓語言模型能感知到視覺特徵,引入了一個Cross-Attention操作,將視覺特徵作為 Key 和 Value,將語言模型的 hidden state 作為 Query 去析取視覺特徵。

近年來也有其他研究考慮將 Cross-Attention 用於多模態融合,例如 Flamingo 和 IDEFICS,但這些工作都沒能取得較好的效能表現。

在mPLUG-Owl3 的技術報告中,團隊比較了Flamingo 的設計,來進一步說明Hyper Attention 的關鍵技術點:

首先,Hyper Attention 並沒有採用Cross-Attention 和Self-Attention 級聯的設計,而是嵌入在Self-Attention 區塊內。

它的好處是大幅降低了額外引入的新參數,使得模型更容易訓練,並且訓練和推理效率也能進一步提升。

其次,Hyper Attention 選擇共享語言模型的 LayerNorm,因為 LayerNorm 所輸出的分佈正是 Attention 層已經訓練穩定的分佈,共享這一層對於穩定學習新引入的 Cross-Attention 至關重要。

事實上,Hyper Attention 採取了一種並行 Cross-Attention 和 Self-Attention 的策略,使用共享的 Query 去與視覺特徵交互,透過一個 Adaptive Gate 融合兩者的特徵。

這使得 Query 可以根據自身語意針對性地選擇與之相關的視覺特徵。

團隊發現,影像在原始上下文中與文字的相對位置關係對於模型更好的理解多模態輸入非常重要。

為了建模這個性質,他們引入了一種多模態交錯的旋轉位置編碼 MI-Rope 來給視覺的 Key 建模位置資訊。

具體來說,他們預先記錄了每張圖片在原文中的位置信息,會取這一位置來計算對應的 Rope embedding,而同一張圖的各個 patch 會共享這個 embedding。

此外,他們也在 Cross-Attention引入了 Attention mask,讓原始上下文中在圖片之前的文字不能看到後面的圖片對應的特徵。

概括而言,Hyper Attention 的這些設計點,為 mPLUG-Owl3 帶來了進一步的效率提升,並且保障了它仍然能具備一流的多模態能力。

實驗結果

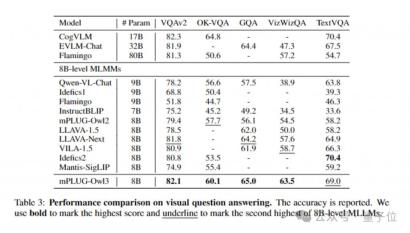

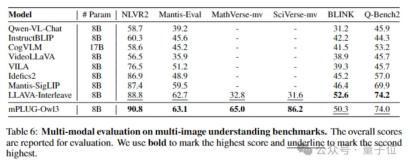

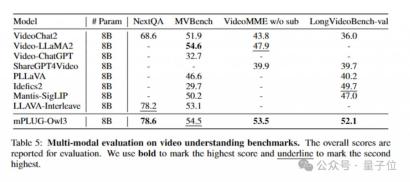

透過在廣泛的資料集上進行實驗,mPLUG-Owl3 在大多數單圖多模態Benchmarks都能取得SOTA 的效果,甚至不少評量還能超過模型尺寸更大的模型。

同時,在多圖測評中,mPLUG-Owl3 同樣超越了專門針對多圖場景優化的 LLAVA-Next-Interleave 和 Mantis。

另外,在 LongVideoBench(52.1 分)這一專門評估模型對長視頻理解的榜單上更是超越現有模型。

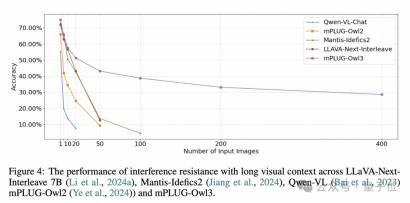

研發團隊也提出了一個有趣的長視覺序列評量方法。

眾所周知,真實的人機互動場景,並非所有圖片都是為了用戶問題服務的,歷史上下文中會充斥著與問題無關的多模態內容,序列越長,這一現象越嚴重。

為了評估模型在長視覺序列輸入中的抗干擾能力,他們基於 MMBench-dev 建構了一個新的測評資料集。

透過為每一個 MMBench 循環評估樣本引入無關的圖片並打亂圖片順序,再針對原本的圖片進行提問,看模型是否能穩定地正確回复。 (同一個問題,會建構 4 個選項順序和乾擾圖片均不同的樣本,全都答對才記一次正確答案。)

實驗中根據輸入圖片數目分為了多個層級。

可以看出,沒有經過多圖訓練的模型例如 Qwen-VL 和 mPLUG-Owl2 很快就敗下陣來。

而經過多圖訓練的LLAVA-Next-Interleave 和Mantis 在最開始能和mPLUG-Owl3 保持近似的衰減曲線,但隨著圖片數目達到了50這個量級,這些模型也不再能正確回答了。

而 mPLUG-Owl3 堅持到了400 張圖片還能保持40% 的準確率。

不過有一說一,儘管mPLUG-Owl3 超越了現有模型,但其準確率遠未達到優秀水平,只能說這一測評方法揭示了所有模型未來需要進一步提升的長序列下的抗干擾能力。

更多詳情歡迎查閱論文及程式碼。

論文:https://arxiv.org/abs/2408.04840

程式碼:https://github.com/X-PLUG/mPLUG-Owl/tree/main/mPLUG-Owl3

demo(抱抱臉):https://huggingface.co/spaces/mPLUG/mPLUG-Owl3

demo(魔搭社群):https://modelscope.cn/studios /iic/mPLUG-Owl3

7B 模型(抱抱臉):https://huggingface.co/mPLUG/mPLUG-Owl3-7B-240728

7B 模型(魔搭社群) https://modelscope.cn/models/iic/mPLUG-Owl3-7B-240728

— 完—

投稿請寄電子郵件到:

ai@qbitai. com

標題註明,告訴我們:

你是誰,從哪裡來,投稿內容

附上論文/ 項目主頁鏈接,以及聯繫方式哦

我們會(盡量)及時回覆你

點這裡追蹤我,記得標星哦~

一鍵三連「分享」、「按讚」和「在看」

科技前沿進展日日相見~

以上是4 秒看完 2 小時影片!阿里發布通用多模態大模型 mPLUG-Owl3的詳細內容。更多資訊請關注PHP中文網其他相關文章!

MWC 新品前瞻:榮耀全面接入 DeepSeek '一句話的事”落地榮耀 AI PCMar 12, 2025 pm 02:12 PM

MWC 新品前瞻:榮耀全面接入 DeepSeek '一句話的事”落地榮耀 AI PCMar 12, 2025 pm 02:12 PM榮耀MagicBookPro14驚艷發布,引領AIPC新時代!在MWC開幕前夕,榮耀搶先在國內發布了全新MagicBookPro14筆記本,並同步推出AIPC2.0戰略,以AI技術全面革新筆記本電腦體驗。榮耀AIPC2.0戰略涵蓋AI內核驅動的智能硬件、AI智能體賦能的人機交互以及AI服務流轉的跨端生態。榮耀手機廣受好評的“一句話的事”AI交互體驗也將在MagicBookPro14上實現,用戶只需語音指令即可完成操作。搭載全新HONORTurboX技術,MagicBo

显著超越 SFT,o1/DeepSeek-R1 背后秘诀也能用于多模态大模型了Mar 12, 2025 pm 01:03 PM

显著超越 SFT,o1/DeepSeek-R1 背后秘诀也能用于多模态大模型了Mar 12, 2025 pm 01:03 PM上海交大、上海AILab和港中文大学的研究人员推出Visual-RFT(视觉强化微调)开源项目,该项目仅需少量数据即可显著提升视觉语言大模型(LVLM)性能。Visual-RFT巧妙地将DeepSeek-R1的基于规则奖励的强化学习方法与OpenAI的强化微调(RFT)范式相结合,成功地将这一方法从文本领域扩展到视觉领域。通过为视觉细分类、目标检测等任务设计相应的规则奖励,Visual-RFT克服了DeepSeek-R1方法仅限于文本、数学推理等领域的局限性,为LVLM训练提供了新的途径。Vis

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

MinGW - Minimalist GNU for Windows

這個專案正在遷移到osdn.net/projects/mingw的過程中,你可以繼續在那裡關注我們。 MinGW:GNU編譯器集合(GCC)的本機Windows移植版本,可自由分發的導入函式庫和用於建置本機Windows應用程式的頭檔;包括對MSVC執行時間的擴展,以支援C99功能。 MinGW的所有軟體都可以在64位元Windows平台上運作。

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

SublimeText3漢化版

中文版,非常好用

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

禪工作室 13.0.1

強大的PHP整合開發環境