LeCun新作:分層世界模型,數據驅動的人型機器人控制

- PHPz原創

- 2024-06-13 11:37:171048瀏覽

有了大模型作為智慧上的加持,人型機器人已然成為新的風口。

科幻電影中「安能辨我不是人」的機器人似乎已經越來越近了。

不過,想像人類一樣思考與行動,對於機器人,特別是人型機器人來說,仍是個艱鉅的工程問題。

就拿簡單的學走路來說,利用強化學習來訓練可能會演變成下面這樣:

道理上沒有什麼問題(遵循獎勵機制),上樓梯的目標也達到了,除了過程比較抽象,跟大部分人類的行為模式可能不太一樣。

機器人之所以很難像人一樣「自然」行動,原因在於觀察和行動空間的高維度性質,以及雙足動物形態固有的不穩定性。

對此,LeCun參與的一項工作給出了基於數據驅動的全新解決方案。

論文網址:https://arxiv.org/pdf/2405.18418

專案介紹: https://nicklashansen.com/rlpuppeteer

先看療效:

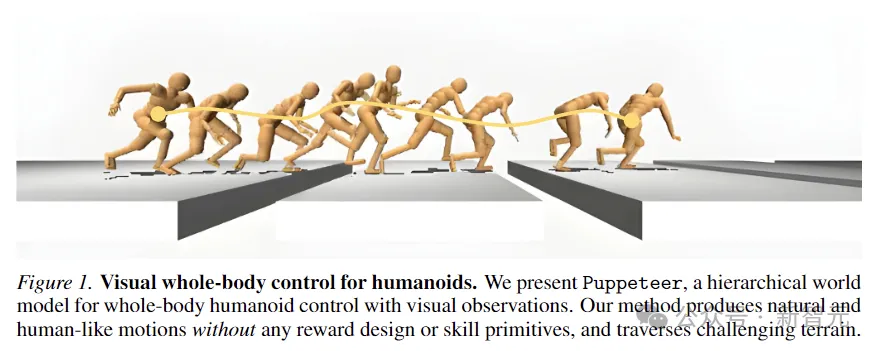

##對比右邊的效果,新的方法訓練出了更接近人類的行為,雖然有點「殭屍」的意味,但抽象度降低了不少,至少在大部分人類的能力範圍之內。

當然了,也有來搗亂的網友表示,「還是之前那個看著更有意思」。

在這項工作中,研究人員探索了基於強化學習的、高度數據驅動的、視覺全身人形控制方法,沒有任何簡化的假設、獎勵設計或技能原語。

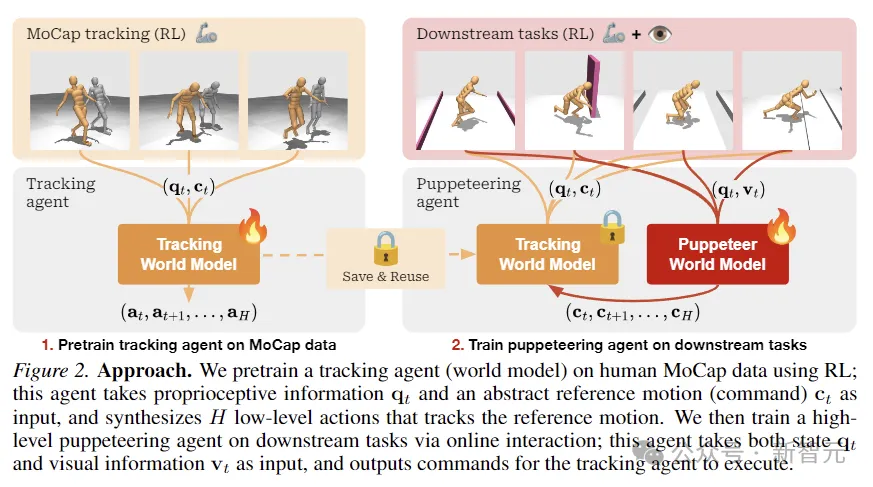

作者提出了一個分層世界模型,訓練進階和低階兩個智能體,高階智能體根據視覺觀察產生指令,供低階智能體執行。

開源程式碼:https://github.com/nicklashansen/puppeteer

這個模型被命名為Puppeteer,利用一個模擬的56-DoF人形機器人,在8個任務中產生了高性能的控制策略,同時合成了自然的類似人類的動作,並具有穿越挑戰性地形的能力。

在物理世界中學習訓練出通用的智能體,一直是AI領域研究的目標之一。

而人形機器人透過整合全身控制和感知,能夠執行各種任務,於是作為多功能平台脫穎而出。

不過要模仿咱們這種高級動物,代價還是很大的。

例如下圖中,人型機器人為了不踩坑,就需要準確地感知迎面而來的地板縫隙的位置和長度,同時仔細協調全身運動,使其有足夠的動量和範圍來跨越每個縫隙。

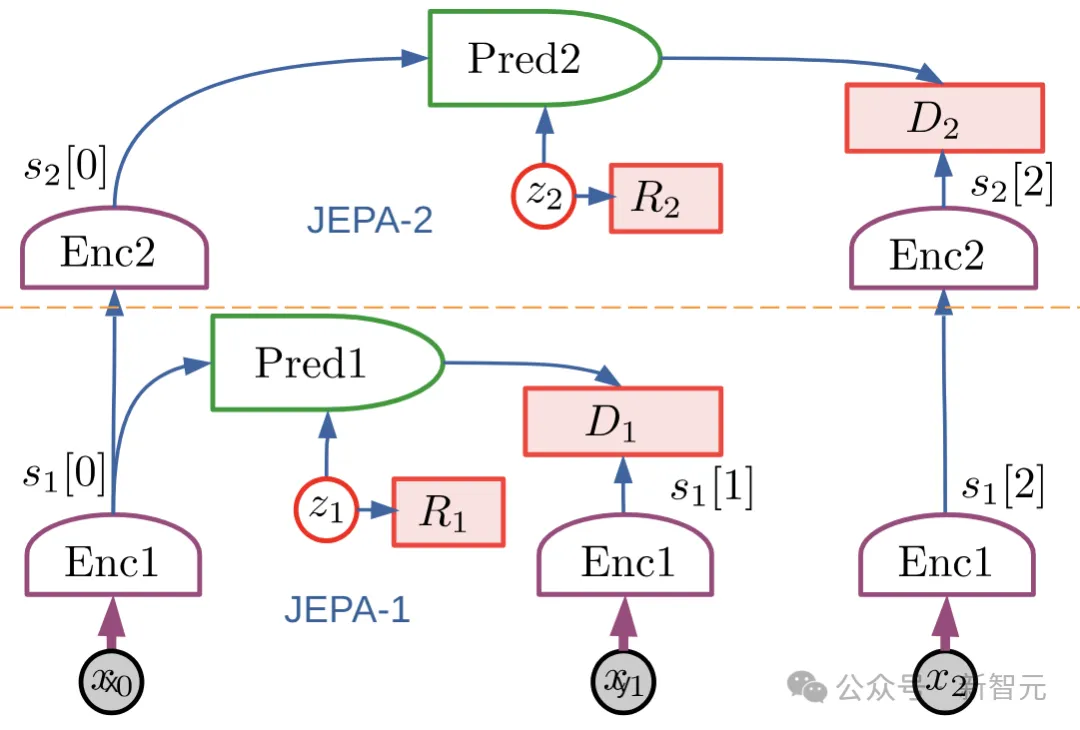

Puppeteer基於LeCun在2022年提出的分層JEPA世界模型,是一種資料驅動的RL方法。

#

#

它由兩個不同的智能體組成:一個負責感知和跟踪,通過關節級控制跟踪參考運動;另一個“視覺木偶”(puppeteer),通過合成低維參考運動來學習執行下游任務,為前者的追蹤提供支援。

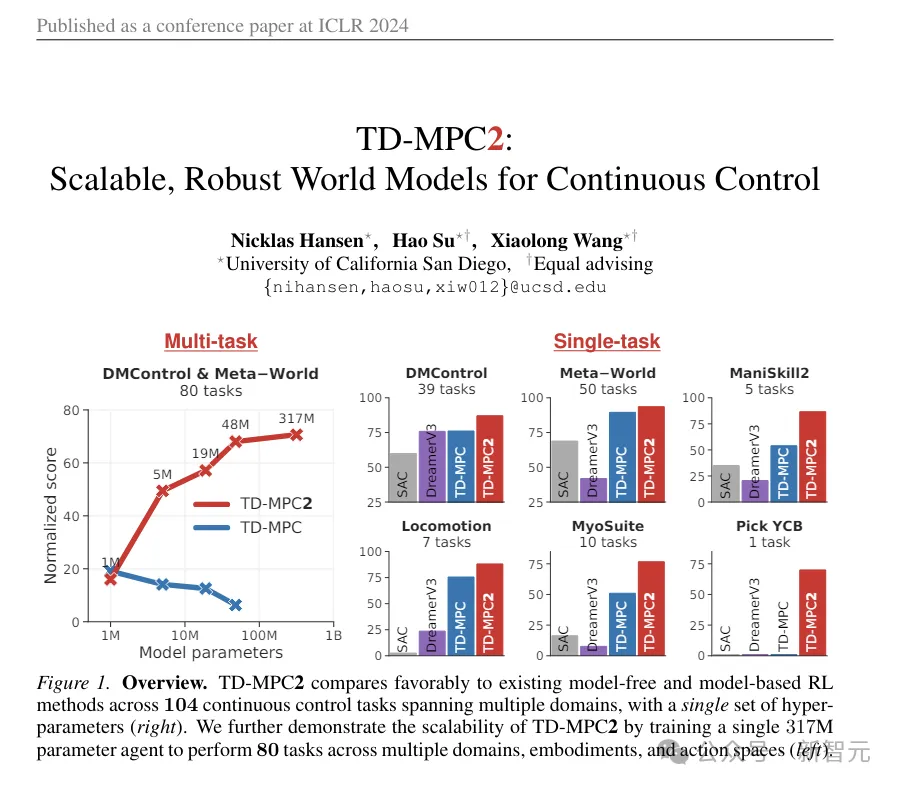

Puppeteer使用基於模型的RL演算法-TD-MPC2,在兩個不同的階段獨立訓練兩個智能體。

(ps:這個TD-MPC2就是文章開頭用來比較的那個動圖,別看有點抽象,那實際上是之前的SOTA,發表在今年的ICLR,一作同樣也是本文的一作。捕捉數據作為參考,將動作轉換為物理上可執行的動作。這個智能體可以保存起來,在所有下游任務中重複使用。

在第二階段,訓練一個木偶世界模型,該模型以視覺觀察為輸入,並根據指定的下游任務,整合另一個智能體提供的參考運動作為輸出。

在第二階段,訓練一個木偶世界模型,該模型以視覺觀察為輸入,並根據指定的下游任務,整合另一個智能體提供的參考運動作為輸出。

這個框架看上去大道至簡:兩個世界模型在演算法上是相同的,只是在輸入/輸出上不同,並且使用RL進行訓練,無需其他任何花里胡哨的東西。

與傳統的分層RL設定不同的是,「木偶」輸出的是末端執行器關節的幾何位置,而不是目標的嵌入。

這使得負責追蹤的智能體易於在任務之間共享和泛化,節省整體運算佔用的空間。

研究方法

研究人員將視覺全身人形控制,建模為馬可夫決策過程(MDP)控制的強化學習問題,過程以元組(S,A,T,R,γ,∆)為特徵,

其中S是狀態,A是動作,T是環境轉換函數, R是標量獎勵函數, γ是折扣因子,∆是終止條件。

如上圖所示,研究人員使用RL在人類MoCap資料上預先訓練追蹤智能體,用於取得本體感覺資訊和抽象參考運動輸入,並合成追蹤參考運動的低階動作。

然後透過線上互動,對負責下游任務的高階木偶智能體進行訓練,木偶接受狀態和視覺資訊輸入,並輸出指令供追蹤智能體執行。

然後透過線上互動,對負責下游任務的高階木偶智能體進行訓練,木偶接受狀態和視覺資訊輸入,並輸出指令供追蹤智能體執行。

TD-MPC2

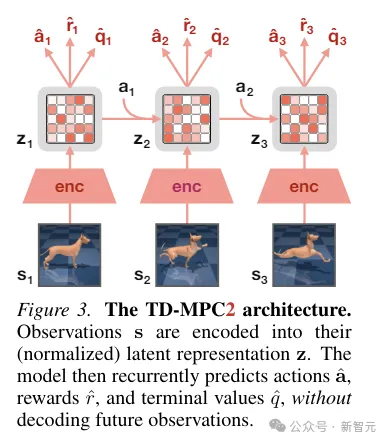

#TD-MPC2從環境互動學習一個潛在的無解碼器世界模型,並使用學習到的模型進行規劃。

世界模型的所有元件都是使用聯合嵌入預測、獎勵預測和時間差異損失的組合端對端學習的,而無需解碼原始觀察結果。

在推理過程中,TD-MPC2遵循模型預測控制(MPC)框架,使用模型預測路徑積分(MPPI)作為無導數(基於取樣)的最佳化器進行局部軌跡最佳化.

在推理過程中,TD-MPC2遵循模型預測控制(MPC)框架,使用模型預測路徑積分(MPPI)作為無導數(基於取樣)的最佳化器進行局部軌跡最佳化.

為了加快規劃速度,TD-MPC2也事先學習了一個無模型策略,用於預啟動取樣程序。

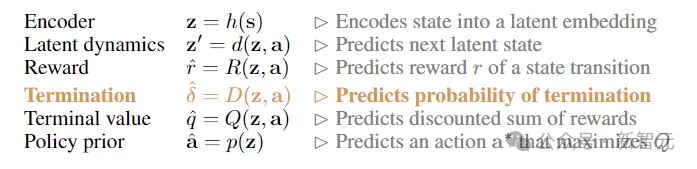

兩個智能體在演算法上是相同的,都由以下6個元件組成:

實驗

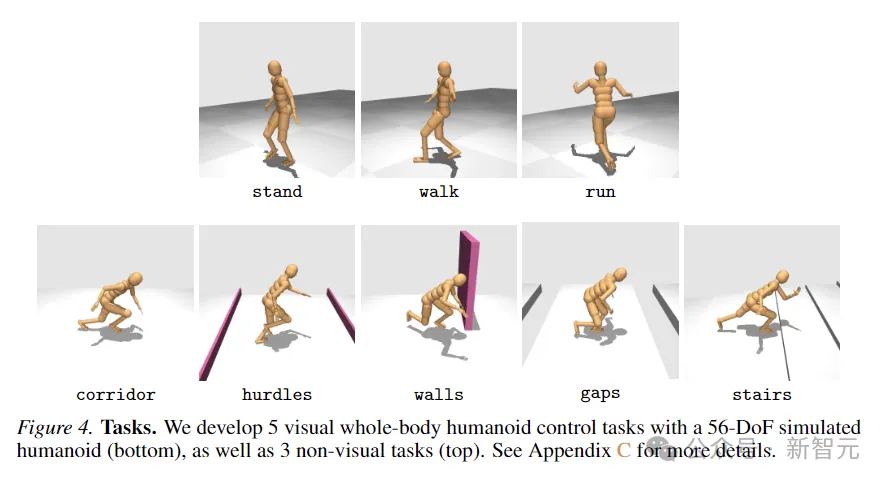

為了評估方法的有效性,研究人員提出了一種新的任務套件,使用模擬的56自由度人形機器人進行視覺全身控制,總共包含8個具有挑戰性的任務,用於對比的方法包括SAC、DreamerV3以及TD-MPC2。

為了評估方法的有效性,研究人員提出了一種新的任務套件,使用模擬的56自由度人形機器人進行視覺全身控制,總共包含8個具有挑戰性的任務,用於對比的方法包括SAC、DreamerV3以及TD-MPC2。

8個任務如下圖所示,包含5個視覺條件全身運動任務,以及另外3個沒有視覺輸入的任務。

任務的設計具有高度的隨機性,包括沿著走廊奔跑、跳過障礙物和縫隙、走上樓梯以及繞過牆壁。

5個視覺控制任務都使用與線性前進速度成正比的獎勵函數,而非視覺任務則獎勵任何方向的位移。

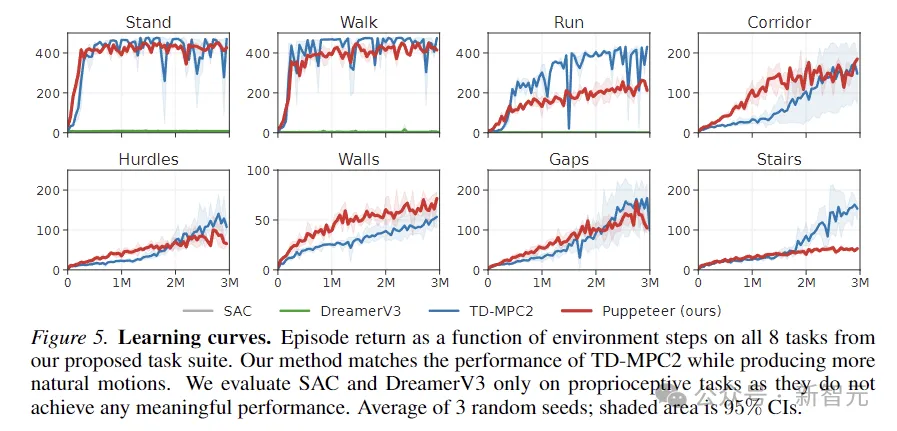

上圖繪製了學習曲線。結果表明,SAC和DreamerV3在這些任務上無法實現有意義的效能。

TD-MPC2在獎勵方面的表現與本文的方法相當,但會產生不自然的行為(請參閱下圖中的抽象動作)。

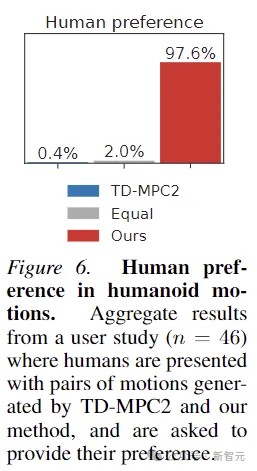

此外,為了證明Puppeteer產生的動作確實更「自然」,本文也進行了人類偏好的實驗,對46名參與者的測試表明,人類普遍喜歡本文方法產生的運動。

以上是LeCun新作:分層世界模型,數據驅動的人型機器人控制的詳細內容。更多資訊請關注PHP中文網其他相關文章!