在機器人學習方面,常用方法是收集針對特定機器人和任務的資料集,然後用其來訓練策略。但是,如果使用這種方法來從頭開始學習,每個任務都需要收集足夠數據,並且所得策略的泛化能力通常也不佳。

「原理上講,從其他機器人和任務收集的經驗能提供可能的解決方案,能讓模型看到多種多樣的機器人控制問題,而這些問題也許能提升機器人在下游任務上的泛化能力和性能。

#要讓機器人訓練一個統一的控制策略非常困難,其中包括涉及諸多難點,包括操作不同的機器人機體、感測器配置、動作空間、任務規範、環境和計算預算。為了實現這一目標,已經出現了一些「機器人基礎模型」相關研究成果;它們的做法是直接將機器人觀察映射成動作,然後透過零樣本本方案泛化至新領域或新機器人。這些模型通常被稱為「通才機器人策略(generalist robot policy)」,簡稱 GRP,這強調了機器人跨多種任務、環境和機器人系統執行低階視覺運動控制的能力。

GNM(General Navigation Model,通用導航模型)適用於多種不同的機器人導航場景,RoboCat 可針對任務目標操作不同的機器人機體,RT-X 能透過語言操作五種不同的機器人機體。儘管這些模型確實是重要進展,但它們也存在多方面的限制:它們的輸入觀察通常是預先定義的且通常很有限(例如單相機輸入視訊串流);它們難以有效微調至新領域;這些模型中最大型的版本都沒有提供人們使用(這一點很重要)。

近日,加州大學柏克萊分校、史丹佛大學、卡內基美隆大學和GoogleDeepMind的18位研究者組成的Octo Model Team發布了他們的開創性研究成果: Octo模型。該項目有效地克服了上述限制。

- 論文標題: Octo: An Open-Source Generalist Robot Policy

- 論文網址:https://arxiv.org/pdf/2405.12213

- 開源專案:https://octo-models. github.io/

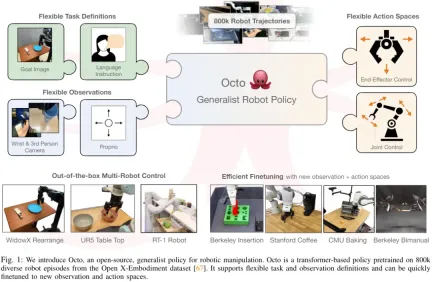

此模型的核心是Transformer 架構,其可將任意輸入token(根據觀察值和任務建立)對應成輸出token(然後編碼成動作),而且該架構可使用多樣化的機器人和任務資料集進行訓練。此策略無需額外訓練就能接受不同的相機配置,也能控制不同的機器人,還能透過語言指令或目標影像進行引導 ——— 所有這些只需透過改變輸入模型的 token 即可實現。

最重要的是,該模型還能適應感測器輸入、操作空間或機器人形態不同的新機器人配置,所需的只是採用適當的適配器(adapter)並使用一個小的目標領域資料集和少量計算預算進行微調。

不僅如此,Octo 還已經在迄今為止最大的機器人操控資料集上完成了預訓練—— 該資料集包含來自Open X-Embodiment 資料集的80 萬個機器人演示。 Octo 不僅是第一個可有效微調至新觀察和動作空間的 GRP,也是第一個完全開源(訓練工作流程、模型檢查點和資料)的通才機器人操控策略。該團隊也在論文中強調了其組合 Octo 各組件的獨特創新性。

#下面我們來看看Octo 這個開源的通才機器人策略是如何構建的。整體而言,Octo 的設計目標是讓其成為一個靈活且廣泛適用的通才機器人策略,可被大量不同的下游機器人應用和研究計畫使用。

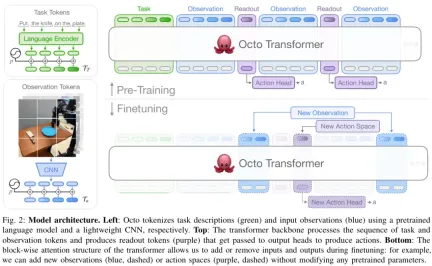

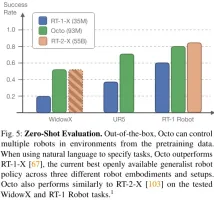

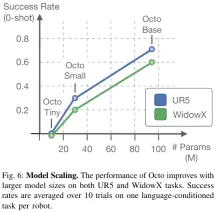

架構 Octo 的核心是基於 Transformer 的策略 π。其包含三個關鍵部分:輸入 token 化器、Transformer 骨幹網路和讀出頭。 如圖2 所示,其中輸入token 化器的作用是將語言指令、目標和觀察序列轉換成token,Transformer 骨幹會把這些token 處理成嵌入,讀出頭則是得出所需的輸出,即動作。 為了將任務定義(例如語言指令和目標圖像)與觀察(例如相機視訊串流)轉換成常用的已token 化的格式,該團隊針對不同模態使用了不同的token 化器: 對於語言輸入,先token 化,然後透過一個預先訓練的Transformer 將其處理成一個語言嵌入token 序列。具體而言,他們使用的模型是 t5-base (111M)。 對於影像觀察和目標,則是透過較淺的捲積堆疊來處理,然後再拆分成平展後圖塊構成的序列。 最後,透過在任務和觀察 token 中添加可學習的位置嵌入並按一定順序排列它們來建立 Transformer 的輸入序列。 #將輸入處理成一種統一化的 token 序列之後,就能交給 Transformer 處理了。這與先前的研究工作類似:基於觀察和動作系列來訓練基於 Transformer 的策略。 Octo 的注意力模式是逐塊遮罩式:觀察 token 只能依照因果關係關注來自同一或先前時間步驟的 token 以及任務 token。對應於不存在觀察的 token 會被完全遮蔽掉(例如沒有語言指令的資料集)。這種模組化設計很方便,可在微調階段中新增或移除觀察或任務。 除了這些輸入 token 模組,團隊還插入了已學習完成的讀出 token。讀出 token 會專注於其先前的觀察和任務 token,但不會被任何觀察或任務 token 關注。因此,讀出 token 只能讀取和處理內部嵌入,而無法影響內部嵌入。讀出 token 的作用類似於 BERT 中的 [CLS] token,充當截至目前的觀察序列的緊湊向量嵌入。針對讀出 token 的嵌入,會使用一個輕量的實現擴散過程的「動作頭」。這個動作頭會預測多個連續動作構成的一個「區塊(chunk)」。 這樣的設計可讓使用者在下游微調時向模型靈活地新增新的任務和觀察輸入或動作輸出頭。當在下游添加新的任務、觀察或損失函數時,可以在整體上保留Transformer 的預訓練權重,僅添加新的位置嵌入、一個新的輕量編碼器、或由於規範變化而必需的新頭的參數。這不同於先前的架構 —— 對於先前的架構,如果新增或移除影像輸入或改變任務規範,就需要重新初始化或重新訓練預訓練模型的大量組件。 要讓Octo 成為真正的「通才」模型,這種靈活性至關重要:由於我們不可能在預訓練階段覆蓋所有可能的機器人感測器和動作配置,因此,如果能在微調階段調整Octo 的輸入和輸出,讓其成為機器人社群的多功能工具。另外,先前使用標準 Transformer 骨幹或融合使用視覺編碼器與 MLP 輸出頭的模型設計固定了模型輸入的類型和順序。相較之下,切換 Octo 的觀察或任務並不需要對大部分模型進行重新初始化。 訓練資料 #該團隊從Open X-Embodiment 取用了包含25 個資料集的混合數據集。圖 3 給出了資料集的組成。 有關訓練目標和訓練硬體配置等更多細節請參閱原始論文。 模型檢查點和程式碼 #重點來了!團隊不僅發了 Octo 的論文,還完全開源了所有資源,其中包括: 該團隊也透過實驗對Octo 進行了實證分析,在多個維度上評估了其作為機器人基礎模型的效能: 圖 4 展示了評估 Octo 的 9 種任務。 直接使用Octo 控制多台機器人 該團隊比較了Octo、RT-1-X、RT-2-X 的零樣本操控能力,結果如圖5。 可以看到,Octo 的成功率比 RT-1-X(3500 萬參數)高 29%。而在 WidowX 和 RT-1 Robot 評估上,Octo 與 550 億參數的 RT-2-X 效能相當。 此外,RT-1-X 和 RT-2-X 僅支援語言指令,而 Octo 也支援以目標影像為條件。團隊還發現,在 WidowX 任務上,如果使用目標影像為條件,成功率比使用語言為條件高 25%。這可能是因為目標影像能提供更多有關任務完成的資訊。 Octo 能有效地使用資料來適應新領域 表1 給出了資料高效能微調的實驗結果。 可以看到,比起從頭開始訓練或使用預訓練的VC-1 權重進行預訓練,微調Octo 得到的結果更好。在 6 種評估設定上,Octo 相較於第二名基準的平均優勢為 52%! 並且不得不提的是:針對所有這些評估任務,微調Octo 時使用的配方和超參數全都一樣,由此可見該團隊找到了一個非常好的預設配置。 通才機器人策略訓練的設計決策 #上面的結果顯示Octo 確實能作為零樣本多機器人控制器,也能作為策略微調的初始化基礎。接下來,團隊分析了不同設計決策對 Octo 策略表現的影響。具體而言,他們關注的重點是以下幾個面向:模型架構、訓練資料、訓練目標、模型規模。為此,他們進行了消融研究。 表 2 給出了在模型架構、訓練資料和訓練目標的消融研究結果。 圖6 則展現了模型規模對零樣本成功率的影響,可以看出來更大的模型有更好的視覺場景感知能力。 整體而言,Octo 各元件的有效性都得到了證明。

任務和觀察token 化器

Transformer 骨幹和讀出頭

實驗

以上是適應多形態多任務,最強開源機器人學習系統「八爪魚」誕生的詳細內容。更多資訊請關注PHP中文網其他相關文章!

讓我們跳舞:結構化運動以微調我們的人類神經網Apr 27, 2025 am 11:09 AM

讓我們跳舞:結構化運動以微調我們的人類神經網Apr 27, 2025 am 11:09 AM科學家已經廣泛研究了人類和更簡單的神經網絡(如秀麗隱桿線蟲中的神經網絡),以了解其功能。 但是,出現了一個關鍵問題:我們如何使自己的神經網絡與新穎的AI一起有效地工作

新的Google洩漏揭示了雙子AI的訂閱更改Apr 27, 2025 am 11:08 AM

新的Google洩漏揭示了雙子AI的訂閱更改Apr 27, 2025 am 11:08 AMGoogle的雙子座高級:新的訂閱層即將到來 目前,訪問Gemini Advanced需要$ 19.99/月Google One AI高級計劃。 但是,Android Authority報告暗示了即將發生的變化。 最新的Google P中的代碼

數據分析加速度如何求解AI的隱藏瓶頸Apr 27, 2025 am 11:07 AM

數據分析加速度如何求解AI的隱藏瓶頸Apr 27, 2025 am 11:07 AM儘管圍繞高級AI功能炒作,但企業AI部署中潛伏的巨大挑戰:數據處理瓶頸。首席執行官慶祝AI的進步時,工程師努力應對緩慢的查詢時間,管道超載,一個

Markitdown MCP可以將任何文檔轉換為Markdowns!Apr 27, 2025 am 09:47 AM

Markitdown MCP可以將任何文檔轉換為Markdowns!Apr 27, 2025 am 09:47 AM處理文檔不再只是在您的AI項目中打開文件,而是將混亂變成清晰度。諸如PDF,PowerPoints和Word之類的文檔以各種形狀和大小淹沒了我們的工作流程。檢索結構化

如何使用Google ADK進行建築代理? - 分析VidhyaApr 27, 2025 am 09:42 AM

如何使用Google ADK進行建築代理? - 分析VidhyaApr 27, 2025 am 09:42 AM利用Google的代理開發套件(ADK)的力量創建具有現實世界功能的智能代理!該教程通過使用ADK來構建對話代理,並支持Gemini和GPT等各種語言模型。 w

在LLM上使用SLM進行有效解決問題-Analytics VidhyaApr 27, 2025 am 09:27 AM

在LLM上使用SLM進行有效解決問題-Analytics VidhyaApr 27, 2025 am 09:27 AM摘要: 小型語言模型 (SLM) 專為效率而設計。在資源匱乏、實時性和隱私敏感的環境中,它們比大型語言模型 (LLM) 更勝一籌。 最適合專注型任務,尤其是在領域特異性、控制性和可解釋性比通用知識或創造力更重要的情況下。 SLM 並非 LLMs 的替代品,但在精度、速度和成本效益至關重要時,它們是理想之選。 技術幫助我們用更少的資源取得更多成就。它一直是推動者,而非驅動者。從蒸汽機時代到互聯網泡沫時期,技術的威力在於它幫助我們解決問題的程度。人工智能 (AI) 以及最近的生成式 AI 也不例

如何將Google Gemini模型用於計算機視覺任務? - 分析VidhyaApr 27, 2025 am 09:26 AM

如何將Google Gemini模型用於計算機視覺任務? - 分析VidhyaApr 27, 2025 am 09:26 AM利用Google雙子座的力量用於計算機視覺:綜合指南 領先的AI聊天機器人Google Gemini擴展了其功能,超越了對話,以涵蓋強大的計算機視覺功能。 本指南詳細說明瞭如何利用

Gemini 2.0 Flash vs O4-Mini:Google可以比OpenAI更好嗎?Apr 27, 2025 am 09:20 AM

Gemini 2.0 Flash vs O4-Mini:Google可以比OpenAI更好嗎?Apr 27, 2025 am 09:20 AM2025年的AI景觀正在充滿活力,而Google的Gemini 2.0 Flash和Openai的O4-Mini的到來。 這些尖端的車型分開了幾週,具有可比的高級功能和令人印象深刻的基準分數。這個深入的比較

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。

記事本++7.3.1

好用且免費的程式碼編輯器

Atom編輯器mac版下載

最受歡迎的的開源編輯器