Peranti teknologi

Peranti teknologi AI

AI Beberapa baris kod menstabilkan UNet! Universiti Sun Yat-sen dan lain-lain mencadangkan model penyebaran ScaleLong: daripada mempersoalkan Penskalaan kepada menjadi Penskalaan

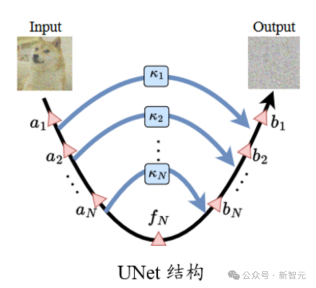

Beberapa baris kod menstabilkan UNet! Universiti Sun Yat-sen dan lain-lain mencadangkan model penyebaran ScaleLong: daripada mempersoalkan Penskalaan kepada menjadi PenskalaanDalam struktur UNet standard, pekali penskalaan  pada sambungan langkau panjang secara amnya ialah 1.

pada sambungan langkau panjang secara amnya ialah 1.

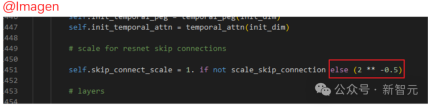

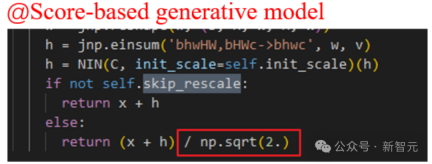

Walau bagaimanapun, dalam beberapa kerja model resapan yang terkenal, seperti Imagen, model generatif berasaskan Skor, dan SR3, dsb., semuanya telah ditetapkan  , dan mendapati tetapan sedemikian boleh mempercepatkan latihan resapan dengan berkesan model. . latihan model resapan.

, dan mendapati tetapan sedemikian boleh mempercepatkan latihan resapan dengan berkesan model. . latihan model resapan.

Pertama sekali, paparan empirikal seperti ini membuatkan kita tidak jelas tentang peranan yang dimainkan oleh tetapan ini?

Pertama sekali, paparan empirikal seperti ini membuatkan kita tidak jelas tentang peranan yang dimainkan oleh tetapan ini?

Adakah "status" sambungan langkau di lokasi berbeza adalah sama?

Pengarang mempunyai banyak tanda tanya tentang perkara ini...

Gambar

Gambar

Memahami Penskalaan

Secara amnya, berbanding dengan struktur Resep, UNS, bukan dalam Transform Tidak mendalam, ia kurang terdedah kepada masalah pengoptimuman seperti kecerunan lenyap yang biasa dalam struktur rangkaian saraf "dalam" lain.Selain itu, disebabkan keistimewaan struktur UNet, ciri cetek disambungkan ke lokasi dalam melalui sambungan langkau panjang, sekali gus mengelakkan masalah seperti kehilangan kecerunan.

Kemudian fikirkan sebaliknya, jika struktur sedemikian tidak diberi perhatian, adakah ia akan menyebabkan masalah seperti kecerunan yang berlebihan dan ayunan parameter (ciri) akibat kemas kini?

Kemudian fikirkan sebaliknya, jika struktur sedemikian tidak diberi perhatian, adakah ia akan menyebabkan masalah seperti kecerunan yang berlebihan dan ayunan parameter (ciri) akibat kemas kini?

Gambar

Dengan menggambarkan ciri dan parameter tugas model resapan semasa proses latihan, ia boleh didapati bahawa ketidakstabilan memang wujud.

Ketidakstabilan parameter (ciri) menjejaskan kecerunan, yang seterusnya menjejaskan kemas kini parameter. Akhirnya proses ini mempunyai risiko yang lebih besar untuk gangguan yang tidak diingini terhadap prestasi. Oleh itu, kita perlu mencari jalan untuk mengawal ketidakstabilan ini.

Seterusnya, untuk model resapan. Input UNet ialah imej yang bising Jika model diperlukan untuk meramalkan bunyi tambahan dengan tepat, ini memerlukan model mempunyai keteguhan yang kuat terhadap input terhadap gangguan tambahan.

Seterusnya, untuk model resapan. Input UNet ialah imej yang bising Jika model diperlukan untuk meramalkan bunyi tambahan dengan tepat, ini memerlukan model mempunyai keteguhan yang kuat terhadap input terhadap gangguan tambahan.

Kertas: https://arxiv.org/abs/2310.13545

Kod: https://github.com/sail-sg/ScaleLong Penyelidik menemui masalah di atas, yang boleh ditemui di Long sambungan langkau Penskalaan dilakukan pada sistem untuk mitigasi bersatu.

Daripada teorem 3.1, julat ayunan ciri lapisan tengah (lebar sempadan atas dan bawah) secara langsung berkaitan dengan jumlah kuasa dua pekali skala. Pekali skala yang sesuai membantu mengurangkan ketidakstabilan ciri.

Walau bagaimanapun, perlu diingatkan bahawa jika pekali penskalaan ditetapkan secara langsung kepada 0, renjatan sememangnya dapat dikurangkan secara optimum. (Kepala anjing manual)

Tetapi jika UNet merosot kepada situasi tanpa skip, masalah ketidakstabilan dapat diselesaikan, tetapi keupayaan perwakilan juga hilang. Ini adalah pertukaran antara kestabilan model dan keupayaan perwakilan.

Gambar

Gambar

Begitu juga, dari perspektif kecerunan parameter. Teorem 3.3 juga mendedahkan bahawa pekali skala mengawal magnitud kecerunan.

Gambar

Gambar

Selanjutnya, Teorem 3.4 juga mendedahkan bahawa penskalaan pada sambungan langkau panjang juga boleh menjejaskan sempadan atas model yang teguh kepada gangguan input dan meningkatkan kestabilan model resapan kepada gangguan input. .

Seterusnya, kami akan menganalisis jenis penskalaan yang boleh mempunyai prestasi yang lebih baik Lagipun, analisis di atas hanya dapat menunjukkan bahawa penskalaan adalah baik, tetapi ia tidak dapat menentukan penskalaan yang mana yang terbaik atau lebih baik.

Cara mudah ialah memperkenalkan modul yang boleh dipelajari untuk sambungan langkau panjang untuk menyesuaikan penskalaan secara adaptif Kaedah ini dipanggil Kaedah Penskalaan Boleh Belajar (LS). Kami menggunakan struktur yang serupa dengan SENet, iaitu seperti berikut (struktur U-ViT yang dipertimbangkan di sini adalah tersusun dengan sangat baik, seperti!)  gambar

gambar

Daripada hasil artikel ini, LS sememangnya boleh menstabilkan dengan cekap latihan model resapan! Selanjutnya, kami cuba menggambarkan pekali yang dipelajari dalam LS.

Seperti yang ditunjukkan dalam rajah di bawah, kita akan mendapati bahawa pekali ini menunjukkan aliran menurun eksponen (perhatikan bahawa sambungan langkau panjang pertama di sini merujuk kepada sambungan yang menghubungkan hujung pertama dan akhir UNet), dan pekali pertama hampir hampir kepada 1. Ini Fenomena ini juga menakjubkan!Gambar

Berdasarkan siri pemerhatian ini (sila rujuk kertas untuk butiran lanjut), kami seterusnya mencadangkan Kaedah Penskalaan Malar (CS), yang tidak memerlukan parameter yang boleh dipelajari:

Berdasarkan siri pemerhatian ini (sila rujuk kertas untuk butiran lanjut), kami seterusnya mencadangkan Kaedah Penskalaan Malar (CS), yang tidak memerlukan parameter yang boleh dipelajari:

CS tidak memerlukan parameter tambahan seperti operasi penskalaan asal menggunakan , jadi hampir tiada penggunaan pengiraan tambahan.

Walaupun CS tidak menunjukkan prestasi sebaik LS dalam latihan yang stabil pada kebanyakan masa, ia masih berbaloi untuk dicuba untuk strategi

Pelaksanaan CS dan LS di atas adalah sangat mudah dan hanya memerlukan beberapa baris kod. Untuk setiap struktur (hua) formula (li) dan setiap (hu) jenis (shao) struktur UNet, dimensi ciri mungkin perlu diselaraskan. (Kepala anjing manual +1)

Pelaksanaan CS dan LS di atas adalah sangat mudah dan hanya memerlukan beberapa baris kod. Untuk setiap struktur (hua) formula (li) dan setiap (hu) jenis (shao) struktur UNet, dimensi ciri mungkin perlu diselaraskan. (Kepala anjing manual +1)

Baru-baru ini, beberapa kerja susulan, seperti FreeU, SCEdit, dsb., juga telah mendedahkan kepentingan skala pada sambungan langkau Semua orang dialu-alukan untuk mencuba dan mempromosikannya.

Atas ialah kandungan terperinci Beberapa baris kod menstabilkan UNet! Universiti Sun Yat-sen dan lain-lain mencadangkan model penyebaran ScaleLong: daripada mempersoalkan Penskalaan kepada menjadi Penskalaan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Membaca Indeks AI 2025: Adakah AI rakan, musuh, atau juruterbang bersama?Apr 11, 2025 pm 12:13 PM

Membaca Indeks AI 2025: Adakah AI rakan, musuh, atau juruterbang bersama?Apr 11, 2025 pm 12:13 PMLaporan Indeks Perisikan Buatan 2025 yang dikeluarkan oleh Stanford University Institute for Manusia Berorientasikan Kecerdasan Buatan memberikan gambaran yang baik tentang revolusi kecerdasan buatan yang berterusan. Mari kita menafsirkannya dalam empat konsep mudah: kognisi (memahami apa yang sedang berlaku), penghargaan (melihat faedah), penerimaan (cabaran muka), dan tanggungjawab (cari tanggungjawab kita). Kognisi: Kecerdasan buatan di mana -mana dan berkembang pesat Kita perlu menyedari betapa cepatnya kecerdasan buatan sedang berkembang dan menyebarkan. Sistem kecerdasan buatan sentiasa bertambah baik, mencapai hasil yang sangat baik dalam ujian matematik dan pemikiran kompleks, dan hanya setahun yang lalu mereka gagal dalam ujian ini. Bayangkan AI menyelesaikan masalah pengekodan kompleks atau masalah saintifik peringkat siswazah-sejak tahun 2023

Bermula dengan Meta Llama 3.2 - Analytics VidhyaApr 11, 2025 pm 12:04 PM

Bermula dengan Meta Llama 3.2 - Analytics VidhyaApr 11, 2025 pm 12:04 PMMeta's Llama 3.2: Lompat ke hadapan dalam Multimodal dan Mobile AI META baru -baru ini melancarkan Llama 3.2, kemajuan yang ketara dalam AI yang memaparkan keupayaan penglihatan yang kuat dan model teks ringan yang dioptimumkan untuk peranti mudah alih. Membina kejayaan o

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagiApr 11, 2025 pm 12:01 PM

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagiApr 11, 2025 pm 12:01 PMLandskap AI minggu ini: Badai kemajuan, pertimbangan etika, dan perdebatan pengawalseliaan. Pemain utama seperti Openai, Google, Meta, dan Microsoft telah melepaskan kemas kini, dari model baru yang terobosan ke peralihan penting di LE

Kos manusia bercakap dengan mesin: Bolehkah chatbot benar -benar peduli?Apr 11, 2025 pm 12:00 PM

Kos manusia bercakap dengan mesin: Bolehkah chatbot benar -benar peduli?Apr 11, 2025 pm 12:00 PMIlusi yang menghiburkan sambungan: Adakah kita benar -benar berkembang dalam hubungan kita dengan AI? Soalan ini mencabar nada optimis Simposium MIT Media Lab "yang memajukan AI (AHA)". Manakala acara itu mempamerkan cutting-EDG

Memahami Perpustakaan Scipy di PythonApr 11, 2025 am 11:57 AM

Memahami Perpustakaan Scipy di PythonApr 11, 2025 am 11:57 AMPengenalan Bayangkan anda seorang saintis atau jurutera menangani masalah kompleks - persamaan pembezaan, cabaran pengoptimuman, atau analisis Fourier. Kemudahan penggunaan dan kemampuan grafik Python menarik, tetapi tugas -tugas ini menuntut alat yang berkuasa

3 Kaedah untuk menjalankan Llama 3.2 - Analytics VidhyaApr 11, 2025 am 11:56 AM

3 Kaedah untuk menjalankan Llama 3.2 - Analytics VidhyaApr 11, 2025 am 11:56 AMMeta's Llama 3.2: Powerhouse AI Multimodal Model multimodal terbaru Meta, Llama 3.2, mewakili kemajuan yang ketara dalam AI, yang membanggakan pemahaman bahasa yang dipertingkatkan, ketepatan yang lebih baik, dan keupayaan penjanaan teks yang unggul. Keupayaannya t

Mengotomatisasi Pemeriksaan Kualiti Data dengan DagsterApr 11, 2025 am 11:44 AM

Mengotomatisasi Pemeriksaan Kualiti Data dengan DagsterApr 11, 2025 am 11:44 AMJaminan Kualiti Data: Pemeriksaan Automatik dengan Dagster dan Harapan Hebat Mengekalkan kualiti data yang tinggi adalah penting untuk perniagaan yang didorong data. Apabila jumlah data dan sumber meningkat, kawalan kualiti manual menjadi tidak cekap dan terdedah kepada kesilapan.

Adakah kerangka utama mempunyai peranan dalam era AI?Apr 11, 2025 am 11:42 AM

Adakah kerangka utama mempunyai peranan dalam era AI?Apr 11, 2025 am 11:42 AMMain Frames: Wira Unsung Revolusi AI Walaupun pelayan cemerlang dalam aplikasi tujuan umum dan mengendalikan pelbagai pelanggan, kerangka utama dibina untuk tugas tinggi, misi kritikal. Sistem yang kuat ini sering dijumpai di Heavil

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

MinGW - GNU Minimalis untuk Windows

Projek ini dalam proses untuk dipindahkan ke osdn.net/projects/mingw, anda boleh terus mengikuti kami di sana. MinGW: Port Windows asli bagi GNU Compiler Collection (GCC), perpustakaan import yang boleh diedarkan secara bebas dan fail pengepala untuk membina aplikasi Windows asli termasuk sambungan kepada masa jalan MSVC untuk menyokong fungsi C99. Semua perisian MinGW boleh dijalankan pada platform Windows 64-bit.

PhpStorm versi Mac

Alat pembangunan bersepadu PHP profesional terkini (2018.2.1).

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

SublimeText3 versi Inggeris

Disyorkan: Versi Win, menyokong gesaan kod!

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa