Peranti teknologi

Peranti teknologi AI

AI Nvidia, Hugging Face dan ServiceNow mengeluarkan StarCoder2 LLM baharu untuk penjanaan kod

Nvidia, Hugging Face dan ServiceNow mengeluarkan StarCoder2 LLM baharu untuk penjanaan kodNvidia, Hugging Face dan ServiceNow mengeluarkan StarCoder2 LLM baharu untuk penjanaan kod

Kini tersedia dalam tiga saiz berbeza, model ini telah dilatih dalam lebih 600 bahasa pengaturcaraan, termasuk bahasa sumber rendah, untuk membantu perusahaan mempercepatkan pelbagai tugas berkaitan kod dalam aliran kerja pembangunan mereka, Ia dibangunkan di bawah ruang terbuka Projek BigCode, inisiatif bersama ServiceNow dan Huging Face untuk memastikan pembangunan bertanggungjawab dan penggunaan model bahasa kod besar, dan ia tersedia secara percuma di bawah lesen AI Bertanggungjawab terbuka.

Pelancaran StarCoder2 mengesahkan kuasa luar biasa yang boleh diperoleh daripada kerjasama saintifik terbuka dan amalan AI yang bertanggungjawab digabungkan dengan rantaian bekalan data yang beretika. Harm de Vries, ketua pasukan pembangunan StarCoder2 di ServiceNow dan ketua bersama BigCode, menegaskan dalam satu kenyataan bahawa model akses terbuka baharu bukan sahaja meningkatkan prestasi GenAI sebelumnya, tetapi juga meningkatkan produktiviti pembangun dan menjadikannya lebih mudah diakses faedah penjanaan kod AI, menjadikannya lebih mudah untuk perniagaan dalam apa jua saiz untuk merealisasikan potensi perniagaan penuh mereka.

StarCoder2: Tiga model untuk memenuhi tiga keperluan berbeza

Produk terbaharu BigCode bukan sahaja peningkatan StarCoder LLM, ia memperkenalkan tiga model saiz berbeza: 3B, 7B dan 15B, dan mengembangkan bahasa pengaturcaraan yang disokong Mencapai 619 spesies. Dalam produk generasi baharu, jumlah data latihan untuk model yang dipanggil Stack telah meningkat hampir tujuh kali ganda berbanding dengan yang sebelumnya. Ini bermakna BigCode sentiasa berkembang untuk menyediakan pembangun alat dan sumber yang lebih berkuasa dan komprehensif untuk membantu mereka berjaya dalam pelbagai tugas pengaturcaraan. Semangat dan sikap inovatif penambahbaikan berterusan ini telah menjadikan BigCode sebagai platform pilihan yang dipercayai dan dipercayai oleh pembangun, memberikan mereka peluang pembelajaran dan aplikasi yang lebih luas. Pembangunan BigCode menunjukkan pelaburan dan tumpuan yang berterusan dalam bidang teknologi dan pengaturcaraan, membawa kemungkinan dan peluang baharu kepada seluruh industri.

Komuniti BigCode menggunakan teknologi latihan generasi terkini untuk memastikan model dapat memahami dan menjana bahasa pengaturcaraan sumber rendah seperti COBOL, matematik dan kod sumber program. Pendekatan ini penting untuk membantu pengguna memperoleh pemahaman yang lebih baik tentang pelbagai bahasa pengaturcaraan dan perbincangan kod.

Model parameter 3 bilion telah dilatih menggunakan rangka kerja LLM Pantas ServiceNow, manakala model 7B dibangunkan berdasarkan rangka kerja Nantron Hugging Face. Kedua-dua model direka bentuk untuk menyediakan prestasi tinggi untuk penjanaan teks-ke-kod dan teks-ke-aliran kerja sambil memerlukan lebih sedikit sumber pengiraan.

Pada masa yang sama, model 15 bilion parameter terbesar telah dilatih dan dioptimumkan menggunakan rangka kerja asli awan NVIDIA Nemo hujung-ke-hujung dan perisian NVIDIA TensorRT-LLM.

Walaupun masih belum dapat dilihat bagaimana model ini berprestasi dalam senario pengekodan yang berbeza, syarikat mengambil perhatian bahawa model 3B terkecil berprestasi setanding dengan 15B StarCoder LLM yang asal.

Bergantung pada keperluan mereka, pasukan perusahaan boleh menggunakan mana-mana model ini dan memperhalusinya lagi berdasarkan data perusahaan untuk kes penggunaan yang berbeza, yang boleh menjadi sebarang tugas khas, daripada penjanaan kod sumber aplikasi, penjanaan aliran kerja dan ringkasan teks kepada kod penyiapan, ringkasan kod lanjutan dan perolehan coretan kod.

Syarikat menekankan bahawa model ini lebih meluas dan terlatih secara mendalam serta mampu memberikan ramalan yang lebih memahami konteks dan tepat. Model yang sangat terlatih ini dapat memahami dengan lebih baik konteks repositori. Akhirnya, usaha ini membuka jalan untuk mempercepatkan usaha pembangunan, membolehkan jurutera dan pembangun menumpukan lebih tenaga pada tugas yang lebih kritikal.

Jonathan Cohen, naib presiden penyelidikan gunaan di NVIDIA, berkata dalam satu kenyataan akhbar: "Oleh kerana setiap ekosistem perisian mempunyai bahasa pengaturcaraan proprietari, Code LLM boleh memacu kejayaan dalam kecekapan dan inovasi dalam setiap industri

"NVIDIA The partnership dengan ServiceNow dan Huging Face memperkenalkan model pembangunan yang selamat, bertanggungjawab dan menyokong akses yang lebih luas kepada GenAI yang bertanggungjawab, yang kami harap akan memberi manfaat kepada komuniti global," tambahnya.

Bagaimana untuk mula menggunakan StarCoder2?

Seperti yang dinyatakan sebelum ini, semua model dalam siri StarCoder2 disediakan di bawah lesen Open Rail-M dan boleh diakses dan digunakan tanpa royalti. Kod sokongan boleh didapati dalam repositori GitHub projek BigCode. Sebagai alternatif, pasukan juga boleh memuat turun dan menggunakan ketiga-tiga model Wajah Memeluk.

Sebenarnya, model 15B yang dilatih oleh NVIDIA juga akan tersedia pada Yayasan AI NVIDIA, membolehkan pembangun mencuba terus dari penyemak imbas mereka atau melalui titik akhir API.

Walaupun StarCoder bukanlah peserta pertama dalam bidang penjanaan kod dipacu AI, pelbagai pilihan yang dibawa oleh generasi terbaharu projek itu pastinya akan membolehkan perusahaan memanfaatkan LLMS dalam pembangunan aplikasi sambil turut menjimatkan pengiraan.

Pemain terkenal lain dalam ruang termasuk OpenAI, yang menawarkan Codex, yang menguasai perkhidmatan perintis persekutuan GitHub, dan Amazon, yang menawarkan alat CodeWhisper, serta persaingan sengit dari Replit dan Codenium, dengan Replit mempunyai beberapa pada Memeluk Face Codenium, model pengekodan AI kecil, baru-baru ini mengumpulkan $65 juta dalam pembiayaan Siri B pada penilaian $500 juta.

Atas ialah kandungan terperinci Nvidia, Hugging Face dan ServiceNow mengeluarkan StarCoder2 LLM baharu untuk penjanaan kod. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Pembangunan permainan AI memasuki era agentiknya dengan portal pemimpi UphealMay 02, 2025 am 11:17 AM

Pembangunan permainan AI memasuki era agentiknya dengan portal pemimpi UphealMay 02, 2025 am 11:17 AMPermainan Upheaval: Merevolusi Pembangunan Permainan Dengan Ejen AI Upheaval, sebuah studio pembangunan permainan yang terdiri daripada veteran dari gergasi industri seperti Blizzard dan Obsidian, bersedia untuk merevolusikan penciptaan permainan dengan platfor AI yang inovatif

Uber mahu menjadi kedai Robotaxi anda, adakah pembekal membiarkan mereka?May 02, 2025 am 11:16 AM

Uber mahu menjadi kedai Robotaxi anda, adakah pembekal membiarkan mereka?May 02, 2025 am 11:16 AMStrategi Robotaxi Uber: ekosistem perjalanan untuk kenderaan autonomi Pada persidangan Curbivore baru-baru ini, Uber's Richard Willder melancarkan strategi mereka untuk menjadi platform perjalanan untuk penyedia Robotaxi. Memanfaatkan kedudukan dominan mereka di

Ejen AI bermain permainan video akan mengubah robot masa depanMay 02, 2025 am 11:15 AM

Ejen AI bermain permainan video akan mengubah robot masa depanMay 02, 2025 am 11:15 AMPermainan video terbukti menjadi alasan ujian yang tidak ternilai untuk penyelidikan AI canggih, terutamanya dalam pembangunan agen autonomi dan robot dunia nyata, malah berpotensi menyumbang kepada pencarian kecerdasan umum buatan (AGI). A

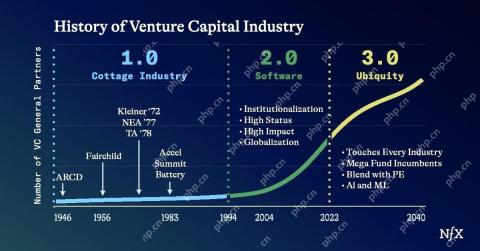

Kompleks Perindustrian Permulaan, VC 3.0, dan Manifesto James CurrierMay 02, 2025 am 11:14 AM

Kompleks Perindustrian Permulaan, VC 3.0, dan Manifesto James CurrierMay 02, 2025 am 11:14 AMKesan landskap modal teroka yang berkembang jelas dalam media, laporan kewangan, dan perbualan setiap hari. Walau bagaimanapun, akibat khusus untuk pelabur, permulaan, dan dana sering diabaikan. Venture Capital 3.0: Paradigma

Adobe mengemas kini Cloud Creative dan Firefly di Adobe Max London 2025May 02, 2025 am 11:13 AM

Adobe mengemas kini Cloud Creative dan Firefly di Adobe Max London 2025May 02, 2025 am 11:13 AMAdobe Max London 2025 menyampaikan kemas kini penting kepada Awan Kreatif dan Firefly, mencerminkan peralihan strategik ke arah aksesibiliti dan AI generatif. Analisis ini menggabungkan pandangan dari taklimat pra-peristiwa dengan kepimpinan Adobe. (Nota: Adob

Segala -galanya Meta diumumkan di LlamaconMay 02, 2025 am 11:12 AM

Segala -galanya Meta diumumkan di LlamaconMay 02, 2025 am 11:12 AMPengumuman Llamacon Meta mempamerkan strategi AI yang komprehensif yang direka untuk bersaing secara langsung dengan sistem AI yang tertutup seperti OpenAI, sementara pada masa yang sama mencipta aliran pendapatan baru untuk model sumber terbuka. Pendekatan beragam ini mensasarkan bo

Kontroversi pembuatan bir atas cadangan bahawa AI tidak lebih dari sekadar teknologi biasaMay 02, 2025 am 11:10 AM

Kontroversi pembuatan bir atas cadangan bahawa AI tidak lebih dari sekadar teknologi biasaMay 02, 2025 am 11:10 AMTerdapat perbezaan yang serius dalam bidang kecerdasan buatan pada kesimpulan ini. Ada yang menegaskan bahawa sudah tiba masanya untuk mendedahkan "pakaian baru Maharaja", sementara yang lain menentang idea bahawa kecerdasan buatan hanyalah teknologi biasa. Mari kita bincangkannya. Analisis terobosan AI yang inovatif ini adalah sebahagian daripada lajur Forbes yang berterusan yang meliputi kemajuan terkini dalam bidang AI, termasuk mengenal pasti dan menjelaskan pelbagai kerumitan AI yang berpengaruh (klik di sini untuk melihat pautan). Kecerdasan Buatan sebagai Teknologi Biasa Pertama, beberapa pengetahuan asas diperlukan untuk meletakkan asas untuk perbincangan penting ini. Pada masa ini terdapat banyak penyelidikan yang didedikasikan untuk terus membangunkan kecerdasan buatan. Matlamat keseluruhan adalah untuk mencapai kecerdasan umum buatan (AGI) dan juga kecerdasan super buatan (AS)

Model warga, mengapa nilai AI adalah ukuran perniagaan seterusnyaMay 02, 2025 am 11:09 AM

Model warga, mengapa nilai AI adalah ukuran perniagaan seterusnyaMay 02, 2025 am 11:09 AMKeberkesanan model AI syarikat kini merupakan penunjuk prestasi utama. Sejak ledakan AI, AI generatif telah digunakan untuk segala -galanya daripada menyusun jemputan ulang tahun untuk menulis kod perisian. Ini telah membawa kepada percambahan mod bahasa

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

VSCode Windows 64-bit Muat Turun

Editor IDE percuma dan berkuasa yang dilancarkan oleh Microsoft

Dreamweaver CS6

Alat pembangunan web visual

Dreamweaver Mac版

Alat pembangunan web visual

SublimeText3 Linux versi baharu

SublimeText3 Linux versi terkini