Peranti teknologi

Peranti teknologi AI

AI Analisis kaedah pembelajaran rangkaian saraf tiruan dalam pembelajaran mendalam

Analisis kaedah pembelajaran rangkaian saraf tiruan dalam pembelajaran mendalamAnalisis kaedah pembelajaran rangkaian saraf tiruan dalam pembelajaran mendalam

Pembelajaran mendalam ialah satu cabang pembelajaran mesin yang direka bentuk untuk mensimulasikan keupayaan otak dalam pemprosesan data. Ia menyelesaikan masalah dengan membina model rangkaian saraf tiruan yang membolehkan mesin belajar tanpa pengawasan. Pendekatan ini membolehkan mesin mengekstrak dan memahami corak dan ciri yang kompleks secara automatik. Melalui pembelajaran mendalam, mesin boleh belajar daripada sejumlah besar data dan memberikan ramalan dan keputusan yang sangat tepat. Ini telah membolehkan pembelajaran mendalam mencapai kejayaan besar dalam bidang seperti penglihatan komputer, pemprosesan bahasa semula jadi dan pengecaman pertuturan.

Untuk memahami fungsi rangkaian saraf, pertimbangkan penghantaran impuls dalam neuron. Selepas data diterima daripada terminal dendrit, ia ditimbang (didarab dengan w) dalam nukleus dan kemudian dihantar sepanjang akson dan disambungkan ke sel saraf yang lain. Akson (x) ialah keluaran daripada satu neuron dan menjadi input kepada neuron lain, sekali gus memastikan pemindahan maklumat antara saraf.

Untuk membuat model dan melatih pada komputer, kita perlu memahami algoritma operasi dan mendapatkan output dengan memasukkan arahan.

Di sini kami menyatakannya melalui matematik, seperti berikut:

Dalam rajah di atas, rangkaian neural 2 lapisan ditunjukkan, yang mengandungi lapisan tersembunyi 4 neuron dan lapisan keluaran yang mengandungi satu neuron. Perlu diingatkan bahawa bilangan lapisan input tidak menjejaskan operasi rangkaian saraf. Bilangan neuron dalam lapisan ini dan bilangan nilai input diwakili oleh parameter w dan b. Secara khusus, input kepada lapisan tersembunyi ialah x, dan input kepada lapisan keluaran ialah nilai a.

Tangen hiperbolik, ReLU, ReLU Bocor dan fungsi lain boleh menggantikan sigmoid sebagai fungsi pengaktifan yang boleh dibezakan dan digunakan dalam lapisan, dan pemberat dikemas kini melalui operasi terbitan dalam perambatan belakang.

Fungsi pengaktifan ReLU digunakan secara meluas dalam pembelajaran mendalam. Oleh kerana bahagian fungsi ReLU yang kurang daripada 0 tidak boleh dibezakan, mereka tidak belajar semasa latihan. Fungsi pengaktifan ReLU Bocor menyelesaikan masalah ini Ia boleh dibezakan dalam bahagian kurang daripada 0 dan akan belajar dalam apa jua keadaan. Ini menjadikan Leaky ReLU lebih berkesan daripada ReLU dalam beberapa senario.

Atas ialah kandungan terperinci Analisis kaedah pembelajaran rangkaian saraf tiruan dalam pembelajaran mendalam. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

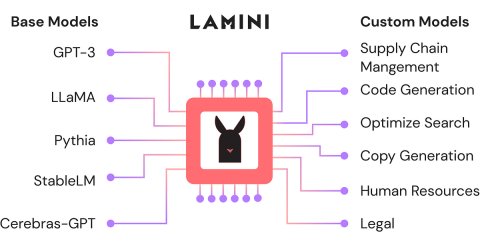

LLM sumber terbuka yang baik menggunakan Lamini-Analytics VidhyaApr 12, 2025 am 10:20 AM

LLM sumber terbuka yang baik menggunakan Lamini-Analytics VidhyaApr 12, 2025 am 10:20 AMBaru -baru ini, dengan peningkatan model bahasa yang besar dan AI, kami telah melihat kemajuan yang tidak terhitung dalam pemprosesan bahasa semulajadi. Model dalam domain seperti teks, kod, dan generasi imej/video telah mengarkibkan penalaran seperti manusia dan p

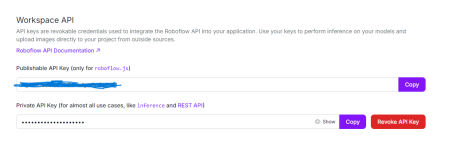

Pengesanan jantina dengan OpenCV dan Roboflow di Python - Analytics VidhyaApr 12, 2025 am 10:19 AM

Pengesanan jantina dengan OpenCV dan Roboflow di Python - Analytics VidhyaApr 12, 2025 am 10:19 AMPengenalan Pengesanan jantina dari imej muka adalah salah satu daripada banyak aplikasi menarik penglihatan komputer. Dalam projek ini, kami menggabungkan OpenCV untuk menghadapi lokasi dan API Roboflow untuk klasifikasi jantina, menjadikan

Apakah peranan AI generatif dalam memperibadikan kandungan iklan?Apr 12, 2025 am 10:18 AM

Apakah peranan AI generatif dalam memperibadikan kandungan iklan?Apr 12, 2025 am 10:18 AMPengenalan Dunia iklan telah berada di bawah evolusi sejak konsep sistem barter. Pengiklan telah menemui cara kreatif untuk membawa produk mereka ke perhatian kami. Pada zaman sekarang, pengguna mengharapkan Br

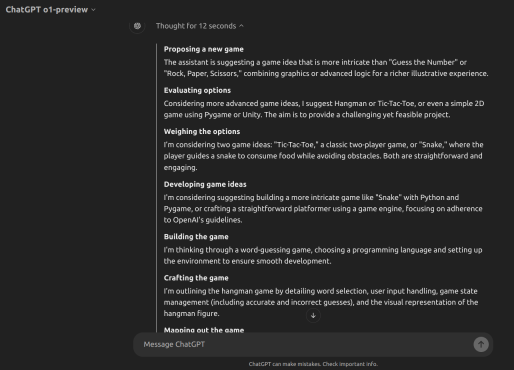

Openai ' s O1-Preview vs O1-Mini: Langkah ke hadapan ke AGIApr 12, 2025 am 10:04 AM

Openai ' s O1-Preview vs O1-Mini: Langkah ke hadapan ke AGIApr 12, 2025 am 10:04 AMPengenalan Pada 12 September, OpenAI mengeluarkan kemas kini bertajuk "Pembelajaran untuk Alasan dengan LLMS." Mereka memperkenalkan model O1, yang dilatih menggunakan pembelajaran tetulang untuk menangani tugas -tugas pemikiran yang kompleks. Apa yang menetapkan mod ini

Bagaimana untuk membina permainan dengan Openai O1? - Analytics VidhyaApr 12, 2025 am 10:03 AM

Bagaimana untuk membina permainan dengan Openai O1? - Analytics VidhyaApr 12, 2025 am 10:03 AMPengenalan Keluarga model Openai O1 secara signifikan memajukan kuasa penalaran dan prestasi ekonomi, terutamanya dalam sains, pengekodan, dan penyelesaian masalah. Matlamat Openai adalah untuk mencipta AI yang lebih maju, dan model O1

Alat ejen LLM yang popular untuk pengurusan pertanyaan pelangganApr 12, 2025 am 10:01 AM

Alat ejen LLM yang popular untuk pengurusan pertanyaan pelangganApr 12, 2025 am 10:01 AMPengenalan Hari ini, dunia pengurusan pertanyaan pelanggan bergerak pada kadar yang tidak pernah berlaku sebelum ini, dengan alat -alat baru membuat tajuk utama setiap hari. Ejen Model Bahasa Besar (LLM) adalah inovasi terkini dalam konteks ini, meningkatkan CU

Pelan Pelaksanaan AI Generatif 100 Hari untuk PerusahaanApr 12, 2025 am 09:56 AM

Pelan Pelaksanaan AI Generatif 100 Hari untuk PerusahaanApr 12, 2025 am 09:56 AMPengenalan Mengguna pakai AI generatif boleh menjadi perjalanan transformatif untuk mana -mana syarikat. Walau bagaimanapun, proses pelaksanaan GueLy sering boleh menjadi rumit dan mengelirukan. Rajendra Singh Pawar, Pengerusi dan Pengasas Bersama Niit Lim

Pixtral 12b vs qwen2-vl-72bApr 12, 2025 am 09:52 AM

Pixtral 12b vs qwen2-vl-72bApr 12, 2025 am 09:52 AMPengenalan Revolusi AI telah menimbulkan era kreativiti baru, di mana model teks-ke-imej telah mentakrifkan semula persimpangan seni, reka bentuk, dan teknologi. Pixtral 12b dan qwen2-vl-72b adalah dua pasukan perintis drivin

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Muat turun versi mac editor Atom

Editor sumber terbuka yang paling popular

SecLists

SecLists ialah rakan penguji keselamatan muktamad. Ia ialah koleksi pelbagai jenis senarai yang kerap digunakan semasa penilaian keselamatan, semuanya di satu tempat. SecLists membantu menjadikan ujian keselamatan lebih cekap dan produktif dengan menyediakan semua senarai yang mungkin diperlukan oleh penguji keselamatan dengan mudah. Jenis senarai termasuk nama pengguna, kata laluan, URL, muatan kabur, corak data sensitif, cangkerang web dan banyak lagi. Penguji hanya boleh menarik repositori ini ke mesin ujian baharu dan dia akan mempunyai akses kepada setiap jenis senarai yang dia perlukan.

DVWA

Damn Vulnerable Web App (DVWA) ialah aplikasi web PHP/MySQL yang sangat terdedah. Matlamat utamanya adalah untuk menjadi bantuan bagi profesional keselamatan untuk menguji kemahiran dan alatan mereka dalam persekitaran undang-undang, untuk membantu pembangun web lebih memahami proses mengamankan aplikasi web, dan untuk membantu guru/pelajar mengajar/belajar dalam persekitaran bilik darjah Aplikasi web keselamatan. Matlamat DVWA adalah untuk mempraktikkan beberapa kelemahan web yang paling biasa melalui antara muka yang mudah dan mudah, dengan pelbagai tahap kesukaran. Sila ambil perhatian bahawa perisian ini

SublimeText3 Linux versi baharu

SublimeText3 Linux versi terkini

EditPlus versi Cina retak

Saiz kecil, penyerlahan sintaks, tidak menyokong fungsi gesaan kod