Peranti teknologi

Peranti teknologi AI

AI Memahami pembelajaran mesin lawan: Pecahan menyeluruh serangan dan pertahanan

Memahami pembelajaran mesin lawan: Pecahan menyeluruh serangan dan pertahananMemahami pembelajaran mesin lawan: Pecahan menyeluruh serangan dan pertahanan

Serangan digital adalah salah satu ancaman yang semakin meningkat dalam era digital. Untuk memerangi ancaman ini, penyelidik telah mencadangkan teknologi pembelajaran mesin yang bertentangan. Matlamat teknik ini adalah untuk menipu model pembelajaran mesin dengan menggunakan data yang mengelirukan. Pembelajaran mesin adversarial melibatkan penjanaan dan pengesanan contoh lawan, yang merupakan input yang dibuat khusus untuk menipu pengelas. Dengan cara ini, penyerang boleh mengganggu output model dan juga membawa kepada keputusan yang mengelirukan. Penyelidikan dan pembangunan pembelajaran mesin adversarial adalah penting untuk melindungi keselamatan dalam era digital.

Apakah contoh musuh?

Contoh lawan ialah input kepada model pembelajaran mesin dengan sengaja mereka bentuk sampel ini untuk menyebabkan model tersalah klasifikasi. Contoh musuh ialah gangguan kecil pada input yang sah, dicapai dengan menambahkan perubahan halus pada input dan oleh itu sukar untuk dikesan. Contoh musuh ini kelihatan biasa, tetapi boleh menyebabkan model pembelajaran mesin sasaran tersalah klasifikasi.

Seterusnya, ialah teknik yang diketahui pada masa ini untuk menghasilkan contoh musuh.

Kaedah teknikal untuk menjana sampel lawan

1 BFGS memori terhad (L-BFGS)

Memori terhad BFGS (L-BFGS) adalah algoritma pengoptimuman bukan pengoptimuman berangka. jumlah gangguan yang ditambahkan pada imej.

Kelebihan: Menjana sampel lawan dengan berkesan.

Kelemahan: Ia adalah intensif dari segi pengiraan kerana ia merupakan kaedah pengoptimuman dengan kekangan kotak. Kaedah ini memakan masa dan tidak praktikal.

2. Kaedah Tanda Kecerunan Pantas (FGSM)

Kaedah berasaskan kecerunan yang mudah dan pantas digunakan untuk menjana contoh lawan untuk meminimumkan jumlah gangguan maksimum yang ditambahkan pada mana-mana piksel imej, mengakibatkan Salah Klasifikasi.

Kelebihan: Masa pengiraan yang agak cekap.

Keburukan: Gangguan ditambah pada setiap ciri.

3. Deepfool Attack

Teknik penjanaan sampel lawan yang tidak disasarkan ini bertujuan untuk meminimumkan jarak Euclidean antara sampel yang terganggu dan sampel asal. Sempadan keputusan antara kelas dianggarkan dan gangguan ditambah secara berulang.

Kelebihan: Menjana sampel lawan dengan berkesan, dengan kurang gangguan dan kadar salah klasifikasi yang lebih tinggi.

Kelemahan: Lebih intensif secara pengiraan daripada FGSM dan JSMA. Tambahan pula, contoh musuh mungkin tidak optimum.

4. Serangan Carlini & Wagner

C&W Teknik ini berdasarkan serangan L-BFGS, tetapi tanpa kekangan kotak dan fungsi objektif yang berbeza. Ini menjadikan kaedah ini lebih berkesan dalam menghasilkan contoh musuh; ia telah ditunjukkan untuk mengalahkan pertahanan terkini seperti latihan lawan.

Kelebihan: Sangat berkesan dalam menjana contoh musuh. Selain itu, ia boleh mengalahkan beberapa pertahanan musuh.

Kelemahan: Lebih banyak pengiraan daripada FGSM, JSMA dan Deepfool.

5. Generative Adversarial Networks (GAN)

Generative Adversarial Networks (GAN) telah digunakan untuk serangan musuh generatif, di mana dua rangkaian saraf bersaing antara satu sama lain. Satu bertindak sebagai penjana dan satu lagi bertindak sebagai diskriminasi. Kedua-dua rangkaian memainkan permainan jumlah sifar, dengan penjana cuba menjana sampel yang akan disalahklasifikasikan oleh diskriminator. Pada masa yang sama, diskriminasi cuba membezakan sampel sebenar daripada yang dicipta oleh penjana.

Kelebihan: Hasilkan sampel yang berbeza daripada yang digunakan dalam latihan.

Keburukan: Melatih rangkaian musuh generatif adalah intensif dari segi pengiraan dan boleh menjadi sangat tidak stabil.

6. Zero-Order Optimization Attack (ZOO)

Teknik ZOO membolehkan kecerunan pengelas dianggarkan tanpa akses kepada pengelas, menjadikannya ideal untuk serangan kotak hitam. Kaedah ini menganggarkan kecerunan dan hessian dengan menanyakan model sasaran dengan ciri individu yang diubah suai dan menggunakan kaedah Adam atau Newton untuk mengoptimumkan gangguan.

Kelebihan: Prestasi yang sama dengan serangan C&W. Tiada latihan model pengganti atau maklumat tentang pengelas diperlukan.

Kelemahan: Memerlukan sejumlah besar pertanyaan kepada pengelas sasaran.

Apakah itu serangan kotak putih dan kotak hitam musuh?

Serangan kotak putih ialah senario di mana penyerang mempunyai akses penuh kepada model sasaran, termasuk seni bina model dan parameternya. Serangan kotak hitam ialah senario di mana penyerang tidak mempunyai akses kepada model dan hanya boleh memerhatikan output model sasaran.

Serangan Musuh pada Sistem Kepintaran Buatan

Terdapat banyak serangan musuh berbeza yang boleh digunakan pada sistem pembelajaran mesin. Kebanyakan daripada mereka bekerja pada sistem pembelajaran mendalam dan model pembelajaran mesin tradisional seperti mesin vektor sokongan (SVM) dan regresi linear. Kebanyakan serangan musuh biasanya bertujuan untuk merendahkan prestasi pengelas pada tugas tertentu, pada asasnya untuk "menipu" algoritma pembelajaran mesin. Pembelajaran mesin adversarial ialah bidang yang mengkaji kelas serangan yang direka untuk merendahkan prestasi pengelas pada tugas tertentu. Jenis khusus serangan pembelajaran mesin musuh adalah seperti berikut:

1. Serangan keracunan

Penyerang menjejaskan data latihan atau labelnya, menyebabkan model berprestasi buruk semasa penggunaan. Oleh itu, keracunan pada asasnya adalah pencemaran musuh data latihan. Oleh kerana sistem ML boleh dilatih semula menggunakan data yang dikumpul semasa operasi, penyerang mungkin boleh meracuni data dengan menyuntik sampel berniat jahat semasa operasi, sekali gus merosakkan atau menjejaskan latihan semula.

2. Serangan Mengelak

Serangan melarikan diri adalah jenis serangan yang paling biasa dan paling diteliti. Penyerang memanipulasi data semasa penggunaan untuk menipu pengelas yang dilatih sebelum ini. Memandangkan ia dilaksanakan semasa fasa penggunaan, ia adalah jenis serangan yang paling praktikal dan paling biasa digunakan untuk senario pencerobohan dan perisian hasad. Penyerang sering cuba mengelak pengesanan dengan mengaburkan kandungan perisian hasad atau e-mel spam. Oleh itu, sampel diubah suai untuk mengelakkan pengesanan kerana ia diklasifikasikan sebagai sah tanpa menjejaskan data latihan secara langsung. Contoh pengelakan ialah serangan penipuan terhadap sistem pengesahan biometrik.

3. Pengekstrakan Model

Kecurian model atau pengekstrakan model melibatkan penyerang menyiasat sistem pembelajaran mesin kotak hitam untuk membina semula model atau mengekstrak data yang model itu dilatih. Ini amat penting apabila data latihan atau model itu sendiri adalah sensitif dan sulit. Sebagai contoh, serangan pengekstrakan model boleh digunakan untuk mencuri model ramalan pasaran saham, yang boleh dieksploitasi oleh musuh untuk keuntungan kewangan.

Atas ialah kandungan terperinci Memahami pembelajaran mesin lawan: Pecahan menyeluruh serangan dan pertahanan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

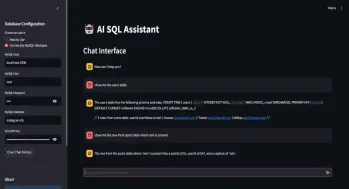

Pembantu SQL untuk Pertanyaan Auto-GenerateApr 12, 2025 am 09:13 AM

Pembantu SQL untuk Pertanyaan Auto-GenerateApr 12, 2025 am 09:13 AMPernahkah anda berharap anda hanya boleh bercakap dengan pangkalan data anda, bertanya soalan dalam bahasa biasa, dan dapatkan jawapan segera tanpa menulis pertanyaan SQL kompleks atau menyusun melalui spreadsheet? Dengan Toolkit SQL Langchain, Groq A

Membaca Indeks AI 2025: Adakah AI rakan, musuh, atau juruterbang bersama?Apr 11, 2025 pm 12:13 PM

Membaca Indeks AI 2025: Adakah AI rakan, musuh, atau juruterbang bersama?Apr 11, 2025 pm 12:13 PMLaporan Indeks Perisikan Buatan 2025 yang dikeluarkan oleh Stanford University Institute for Manusia Berorientasikan Kecerdasan Buatan memberikan gambaran yang baik tentang revolusi kecerdasan buatan yang berterusan. Mari kita menafsirkannya dalam empat konsep mudah: kognisi (memahami apa yang sedang berlaku), penghargaan (melihat faedah), penerimaan (cabaran muka), dan tanggungjawab (cari tanggungjawab kita). Kognisi: Kecerdasan buatan di mana -mana dan berkembang pesat Kita perlu menyedari betapa cepatnya kecerdasan buatan sedang berkembang dan menyebarkan. Sistem kecerdasan buatan sentiasa bertambah baik, mencapai hasil yang sangat baik dalam ujian matematik dan pemikiran kompleks, dan hanya setahun yang lalu mereka gagal dalam ujian ini. Bayangkan AI menyelesaikan masalah pengekodan kompleks atau masalah saintifik peringkat siswazah-sejak tahun 2023

Bermula dengan Meta Llama 3.2 - Analytics VidhyaApr 11, 2025 pm 12:04 PM

Bermula dengan Meta Llama 3.2 - Analytics VidhyaApr 11, 2025 pm 12:04 PMMeta's Llama 3.2: Lompat ke hadapan dalam Multimodal dan Mobile AI META baru -baru ini melancarkan Llama 3.2, kemajuan yang ketara dalam AI yang memaparkan keupayaan penglihatan yang kuat dan model teks ringan yang dioptimumkan untuk peranti mudah alih. Membina kejayaan o

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagiApr 11, 2025 pm 12:01 PM

AV Bytes: Meta ' s llama 3.2, Google's Gemini 1.5, dan banyak lagiApr 11, 2025 pm 12:01 PMLandskap AI minggu ini: Badai kemajuan, pertimbangan etika, dan perdebatan pengawalseliaan. Pemain utama seperti Openai, Google, Meta, dan Microsoft telah melepaskan kemas kini, dari model baru yang terobosan ke peralihan penting di LE

Kos manusia bercakap dengan mesin: Bolehkah chatbot benar -benar peduli?Apr 11, 2025 pm 12:00 PM

Kos manusia bercakap dengan mesin: Bolehkah chatbot benar -benar peduli?Apr 11, 2025 pm 12:00 PMIlusi yang menghiburkan sambungan: Adakah kita benar -benar berkembang dalam hubungan kita dengan AI? Soalan ini mencabar nada optimis Simposium MIT Media Lab "yang memajukan AI (AHA)". Manakala acara itu mempamerkan cutting-EDG

Memahami Perpustakaan Scipy di PythonApr 11, 2025 am 11:57 AM

Memahami Perpustakaan Scipy di PythonApr 11, 2025 am 11:57 AMPengenalan Bayangkan anda seorang saintis atau jurutera menangani masalah kompleks - persamaan pembezaan, cabaran pengoptimuman, atau analisis Fourier. Kemudahan penggunaan dan kemampuan grafik Python menarik, tetapi tugas -tugas ini menuntut alat yang berkuasa

3 Kaedah untuk menjalankan Llama 3.2 - Analytics VidhyaApr 11, 2025 am 11:56 AM

3 Kaedah untuk menjalankan Llama 3.2 - Analytics VidhyaApr 11, 2025 am 11:56 AMMeta's Llama 3.2: Powerhouse AI Multimodal Model multimodal terbaru Meta, Llama 3.2, mewakili kemajuan yang ketara dalam AI, yang membanggakan pemahaman bahasa yang dipertingkatkan, ketepatan yang lebih baik, dan keupayaan penjanaan teks yang unggul. Keupayaannya t

Mengotomatisasi Pemeriksaan Kualiti Data dengan DagsterApr 11, 2025 am 11:44 AM

Mengotomatisasi Pemeriksaan Kualiti Data dengan DagsterApr 11, 2025 am 11:44 AMJaminan Kualiti Data: Pemeriksaan Automatik dengan Dagster dan Harapan Hebat Mengekalkan kualiti data yang tinggi adalah penting untuk perniagaan yang didorong data. Apabila jumlah data dan sumber meningkat, kawalan kualiti manual menjadi tidak cekap dan terdedah kepada kesilapan.

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Muat turun versi mac editor Atom

Editor sumber terbuka yang paling popular

MantisBT

Mantis ialah alat pengesan kecacatan berasaskan web yang mudah digunakan yang direka untuk membantu dalam pengesanan kecacatan produk. Ia memerlukan PHP, MySQL dan pelayan web. Lihat perkhidmatan demo dan pengehosan kami.

ZendStudio 13.5.1 Mac

Persekitaran pembangunan bersepadu PHP yang berkuasa

EditPlus versi Cina retak

Saiz kecil, penyerlahan sintaks, tidak menyokong fungsi gesaan kod

SecLists

SecLists ialah rakan penguji keselamatan muktamad. Ia ialah koleksi pelbagai jenis senarai yang kerap digunakan semasa penilaian keselamatan, semuanya di satu tempat. SecLists membantu menjadikan ujian keselamatan lebih cekap dan produktif dengan menyediakan semua senarai yang mungkin diperlukan oleh penguji keselamatan dengan mudah. Jenis senarai termasuk nama pengguna, kata laluan, URL, muatan kabur, corak data sensitif, cangkerang web dan banyak lagi. Penguji hanya boleh menarik repositori ini ke mesin ujian baharu dan dia akan mempunyai akses kepada setiap jenis senarai yang dia perlukan.