Rumah >Peranti teknologi >AI >Penyelidikan sistem mendedahkan model besar yang sangat diperlukan untuk sistem pemanduan autonomi generasi akan datang

Penyelidikan sistem mendedahkan model besar yang sangat diperlukan untuk sistem pemanduan autonomi generasi akan datang

- PHPzke hadapan

- 2023-12-16 14:21:181523semak imbas

Dengan kemunculan model bahasa besar (LLM) dan model asas visual (VFM), diharapkan sistem kecerdasan buatan berbilang mod dengan model besar dapat melihat secara menyeluruh dunia sebenar dan membuat keputusan seperti manusia. Dalam beberapa bulan kebelakangan ini, LLM telah menarik perhatian meluas dalam bidang penyelidikan pemanduan autonomi. Walaupun potensi besar LLM, masih terdapat cabaran utama, peluang dan hala tuju penyelidikan masa depan dalam sistem pemanduan, yang pada masa ini tidak mempunyai penjelasan terperinci

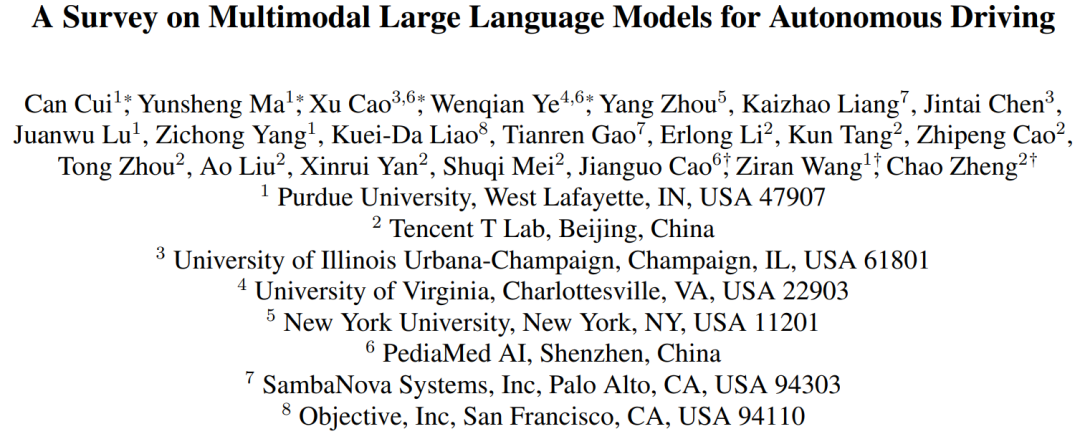

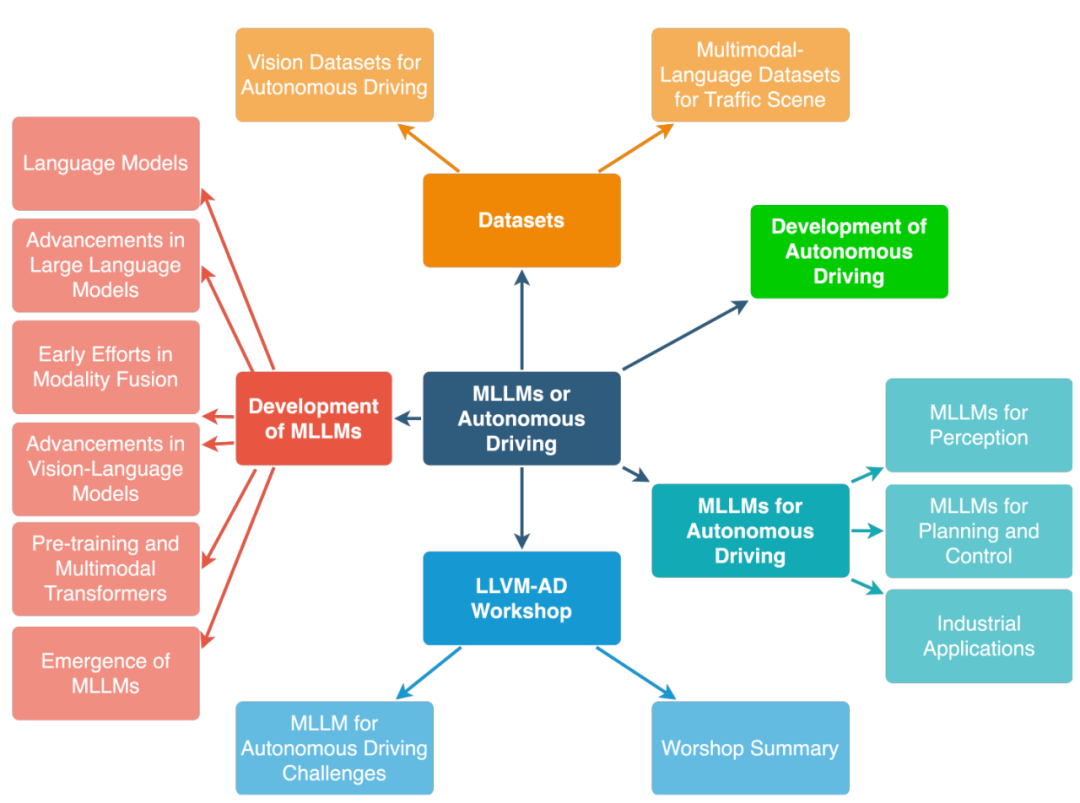

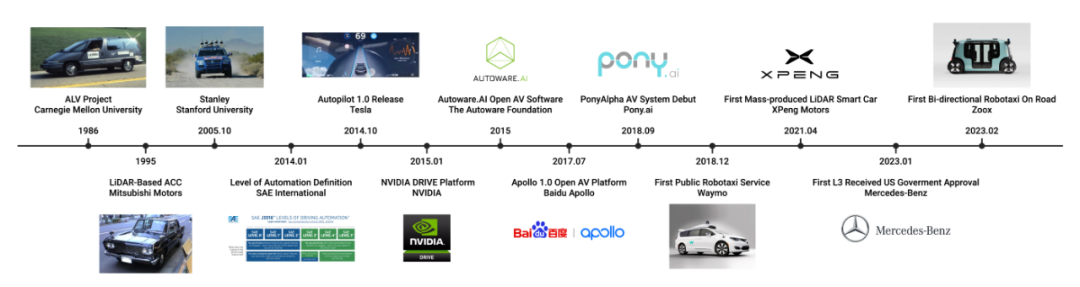

Dalam artikel ini, penyelidikan dari Tencent Maps, Purdue University, UIUC, University of Virginia Personnel dijalankan penyelidikan sistematik dalam bidang ini. Kajian ini mula-mula memperkenalkan latar belakang model bahasa besar multimodal (MLLM), kemajuan pembangunan model multimodal menggunakan LLM, dan tinjauan sejarah pemanduan autonomi. Kajian itu kemudiannya memberikan gambaran keseluruhan alat MLLM sedia ada untuk sistem pemanduan, trafik dan pemetaan, serta set data sedia ada. Kajian ini juga meringkaskan kerja berkaitan daripada Bengkel WACV Pertama mengenai Bahasa Besar dan Model Penglihatan untuk Pemanduan Autonomi (LLVM-AD), bengkel pertama mengaplikasikan LLM dalam pemanduan autonomi. Bagi menggalakkan lagi pembangunan bidang ini, kajian ini turut membincangkan cara mengaplikasikan MLLM dalam sistem pemanduan autonomi dan beberapa isu penting yang perlu diselesaikan oleh ahli akademik dan industri.

- Semak pautan: https://arxiv.org/abs/2311.12320

- Pautan bengkel: https://llhubm-io/.

- Pautan Github : https://github.com/IrohXu/Awesome-Multimodal-LLM-Autonomous-Driving

Review Structure

Review Structure

Model LargeMusic ini telah menarik perhatian ramai Model MLLM ini, Model LargeMultimodal ini model menggabungkan keupayaan inferens LLM dengan data imej, video dan audio, membolehkan data ini melaksanakan pelbagai tugas dengan lebih cekap melalui penjajaran berbilang modal, termasuk klasifikasi imej, menjajarkan teks dengan video yang sepadan dan pengesanan pertuturan. Di samping itu, beberapa kajian telah menunjukkan bahawa LLM boleh mengendalikan tugas-tugas mudah dalam bidang robotik Namun, pada masa ini dalam bidang pemanduan autonomi, integrasi MLLM berkembang secara perlahan Adakah terdapat potensi untuk menambah baik sistem pemanduan autonomi yang sedia ada, seperti GPT-4, PaLM-2 dan LLM seperti LLaMA-2 masih memerlukan penyelidikan dan penerokaan lanjut

Dalam ulasan ini, penyelidik percaya bahawa penyepaduan LLM ke dalam bidang pemanduan autonomi boleh membawa perubahan paradigma yang ketara, sekali gus meningkatkan persepsi pemanduan , perancangan gerakan, dan interaksi manusia-kenderaan dan kawalan gerakan untuk menyediakan pengguna dengan penyelesaian pengangkutan masa hadapan yang lebih mudah disesuaikan dan boleh dipercayai. Dari segi persepsi, LLM boleh menggunakan Pembelajaran Alat untuk memanggil API luaran untuk mengakses sumber maklumat masa nyata, seperti peta berketepatan tinggi, laporan trafik dan maklumat cuaca, supaya kenderaan dapat memahami persekitaran sekeliling dengan lebih lengkap. Kereta pandu sendiri boleh membuat alasan tentang laluan sesak melalui LLM dan mencadangkan laluan alternatif untuk meningkatkan kecekapan dan pemanduan selamat. Dari segi perancangan pergerakan dan interaksi manusia-kenderaan, LLM boleh mempromosikan komunikasi berpusatkan pengguna, membolehkan penumpang menyatakan keperluan dan pilihan mereka dalam bahasa seharian. Dari segi kawalan gerakan, LLM terlebih dahulu membolehkan parameter kawalan disesuaikan mengikut keutamaan pemandu, merealisasikan pengalaman pemanduan yang diperibadikan. Selain itu, LLM boleh memberikan ketelusan kepada pengguna dengan menerangkan setiap langkah proses kawalan gerakan. Semakan meramalkan bahawa pada kenderaan autonomi tahap SAE L4-L5 akan datang, penumpang boleh menggunakan bahasa, gerak isyarat dan juga mata untuk menyampaikan permintaan mereka, dengan MLLM menyediakan maklum balas dalam kereta dan pemanduan masa nyata melalui paparan visual bersepadu atau respons suara.模 The proses pembangunan model pemanduan autonomi dan bahasa besar berbilang mod

Dalam ulasan ini, penyelidik percaya bahawa penyepaduan LLM ke dalam bidang pemanduan autonomi boleh membawa perubahan paradigma yang ketara, sekali gus meningkatkan persepsi pemanduan , perancangan gerakan, dan interaksi manusia-kenderaan dan kawalan gerakan untuk menyediakan pengguna dengan penyelesaian pengangkutan masa hadapan yang lebih mudah disesuaikan dan boleh dipercayai. Dari segi persepsi, LLM boleh menggunakan Pembelajaran Alat untuk memanggil API luaran untuk mengakses sumber maklumat masa nyata, seperti peta berketepatan tinggi, laporan trafik dan maklumat cuaca, supaya kenderaan dapat memahami persekitaran sekeliling dengan lebih lengkap. Kereta pandu sendiri boleh membuat alasan tentang laluan sesak melalui LLM dan mencadangkan laluan alternatif untuk meningkatkan kecekapan dan pemanduan selamat. Dari segi perancangan pergerakan dan interaksi manusia-kenderaan, LLM boleh mempromosikan komunikasi berpusatkan pengguna, membolehkan penumpang menyatakan keperluan dan pilihan mereka dalam bahasa seharian. Dari segi kawalan gerakan, LLM terlebih dahulu membolehkan parameter kawalan disesuaikan mengikut keutamaan pemandu, merealisasikan pengalaman pemanduan yang diperibadikan. Selain itu, LLM boleh memberikan ketelusan kepada pengguna dengan menerangkan setiap langkah proses kawalan gerakan. Semakan meramalkan bahawa pada kenderaan autonomi tahap SAE L4-L5 akan datang, penumpang boleh menggunakan bahasa, gerak isyarat dan juga mata untuk menyampaikan permintaan mereka, dengan MLLM menyediakan maklum balas dalam kereta dan pemanduan masa nyata melalui paparan visual bersepadu atau respons suara.模 The proses pembangunan model pemanduan autonomi dan bahasa besar berbilang mod

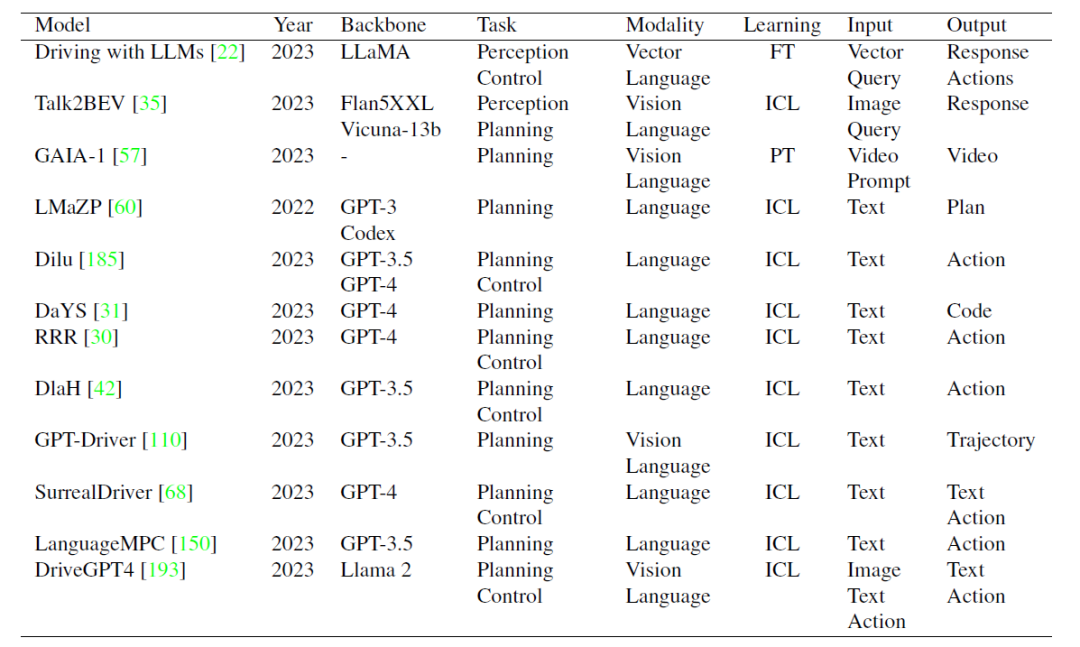

Ringkasan penyelidikan pemanduan autonomi MLLM: Rangka kerja LLM model semasa terutamanya merangkumi LLAMA dan LLAMA 2. GPT-4. , Flan5XXL, Vicuna-13b. FT, ICL dan PT merujuk kepada penalaan halus, pembelajaran kontekstual dan pra-latihan dalam jadual ini. Untuk pautan literatur, sila rujuk repo github: https://github.com/IrohXu/Awesome-Multimodal-LLM-Autonomous-Driving

Untuk membina jambatan antara pemanduan autonomi dan LLVM, penyelidik yang berkaitan menganjurkan Bengkel Pemanduan Autonomi Model Bahasa dan Penglihatan Besar (LLVM-AD) pertama di Persidangan Musim Sejuk IEEE/CVF 2024 mengenai Aplikasi Penglihatan Komputer (WACV). Bengkel ini bertujuan untuk meningkatkan kerjasama antara penyelidik akademik dan profesional industri untuk meneroka kemungkinan dan cabaran melaksanakan model bahasa berskala besar pelbagai mod dalam bidang pemanduan autonomi. LLVM-AD akan terus mempromosikan pembangunan set data pemahaman bahasa trafik sebenar sumber terbuka seterusnya

Bengkel Pemanduan Autonomi Model Penglihatan dan Bahasa Skala Besar WACV (LLVM-AD) yang pertama menerima sejumlah sembilan kertas kerja. Beberapa kertas kerja ini berkisar tentang model bahasa besar berbilang mod dalam pemanduan autonomi, memfokuskan pada penyepaduan LLM ke dalam interaksi kenderaan pengguna, perancangan gerakan dan kawalan kenderaan. Beberapa kertas kerja juga meneroka aplikasi baharu LLM untuk interaksi seperti manusia dan membuat keputusan dalam kenderaan autonomi. Contohnya, "Meniru Pemanduan Manusia" dan "Memandu Mengikut Bahasa" meneroka tafsiran dan penaakulan LLM dalam senario pemanduan yang kompleks, serta rangka kerja untuk meniru tingkah laku manusia. Selain itu, "Sistem autonomi berpusatkan manusia dan LLM" menekankan meletakkan pengguna di tengah-tengah mereka bentuk LLM dan menggunakan LLM untuk mentafsir arahan pengguna. Pendekatan ini mewakili anjakan penting ke arah sistem autonomi berpusatkan manusia. Selain LLM gabungan, bengkel ini juga merangkumi beberapa kaedah berasaskan pemprosesan data dan penglihatan tulen. Di samping itu, bengkel ini membentangkan kaedah pemprosesan dan penilaian data yang inovatif. Contohnya, NuScenes-MQA memperkenalkan skim anotasi baharu untuk set data pemanduan autonomi. Secara kolektif, kertas kerja ini menunjukkan kemajuan dalam menyepadukan model bahasa dan teknik lanjutan ke dalam pemanduan autonomi, membuka jalan untuk kenderaan autonomi yang lebih intuitif, cekap dan berpusatkan manusia

Untuk perkembangan masa hadapan, Kajian ini mencadangkan arahan penyelidikan berikut:

Kandungan yang perlu ditulis semula ialah: 1. Set data baharu untuk model bahasa besar berbilang mod dalam pemanduan autonomi

Walaupun model bahasa besar digunakan dalam bahasa Terdapat kejayaan dalam memahami perkara ini, tetapi cabaran kekal dalam menerapkannya kepada pemanduan autonomi. Ini kerana model ini perlu menyepadukan dan memahami input daripada modaliti yang berbeza, seperti imej panorama, awan titik 3D dan peta berketepatan tinggi. Had semasa dalam saiz dan kualiti data bermakna set data sedia ada tidak dapat menangani cabaran ini sepenuhnya. Tambahan pula, set data bahasa visual yang dianotasi daripada set data sumber terbuka awal seperti NuScenes mungkin tidak memberikan garis dasar yang kukuh untuk pemahaman bahasa visual dalam senario pemanduan. Oleh itu, terdapat keperluan mendesak untuk set data berskala besar baharu yang meliputi pelbagai trafik dan senario pemanduan untuk menampung masalah panjang (ketidakseimbangan) pengedaran set data sebelumnya untuk menguji dan meningkatkan prestasi model ini secara berkesan dalam aplikasi pemanduan autonomi.

2. Sokongan perkakasan diperlukan untuk model bahasa besar dalam pemanduan autonomi

Fungsi yang berbeza dalam kenderaan autonomi mempunyai keperluan perkakasan yang berbeza. Menggunakan LLM di dalam kenderaan untuk perancangan pemanduan atau penglibatan dalam kawalan kenderaan memerlukan pemprosesan masa nyata dan kependaman rendah untuk memastikan keselamatan, yang meningkatkan keperluan pengiraan dan menjejaskan penggunaan kuasa. Jika LLM digunakan dalam awan, lebar jalur untuk pertukaran data menjadi satu lagi faktor keselamatan kritikal. Sebaliknya, menggunakan LLM untuk perancangan navigasi atau menganalisis arahan yang tidak berkaitan dengan pemanduan (seperti main balik muzik dalam kereta) tidak memerlukan volum pertanyaan yang tinggi dan prestasi masa nyata, menjadikan perkhidmatan jauh sebagai pilihan yang berdaya maju. Pada masa hadapan, LLM dalam pemanduan autonomi boleh dimampatkan melalui penyulingan pengetahuan untuk mengurangkan keperluan pengiraan dan kependaman Masih terdapat banyak ruang untuk pembangunan di kawasan ini. . Lapisan peta semantik dalam peta HD adalah penting kerana ia menangkap makna dan maklumat kontekstual persekitaran fizikal. Untuk mengekod maklumat ini dengan berkesan ke dalam pemanduan autonomi generasi seterusnya yang dipacu oleh sistem anotasi automatik AI peta ketepatan tinggi Tencent, model baharu diperlukan untuk memetakan ciri berbilang mod ini ke dalam ruang bahasa. Tencent telah membangunkan sistem pelabelan automatik AI peta berketepatan tinggi THMA berdasarkan pembelajaran aktif, yang boleh menghasilkan dan melabelkan peta berketepatan tinggi pada skala ratusan ribu kilometer. Untuk menggalakkan pembangunan bidang ini, Tencent mencadangkan set data MAPLM berdasarkan THMA, yang mengandungi imej panorama, awan titik lidar 3D dan anotasi peta ketepatan tinggi berasaskan konteks, serta tanda aras soalan dan jawapan baharu MAPLM-QA

4. Model bahasa besar dalam interaksi manusia-kenderaan

Interaksi manusia dengan kenderaan dan memahami tingkah laku pemanduan manusia juga menimbulkan cabaran besar dalam pemanduan autonomi. Pemandu manusia sering bergantung pada isyarat bukan lisan, seperti memperlahankan kelajuan untuk mengalah atau menggunakan pergerakan badan untuk berkomunikasi dengan pemandu atau pejalan kaki lain. Isyarat bukan lisan ini memainkan peranan penting dalam komunikasi di jalan raya. Terdapat banyak kemalangan yang melibatkan sistem pandu sendiri pada masa lalu kerana kereta pandu sendiri sering berkelakuan dengan cara yang tidak disangka oleh pemandu lain. Pada masa hadapan, MLLM akan dapat menyepadukan maklumat kontekstual yang kaya daripada pelbagai sumber dan menganalisis pandangan, gerak isyarat dan gaya pemanduan pemandu untuk lebih memahami isyarat sosial ini dan membolehkan perancangan yang cekap. Dengan menganggar isyarat sosial pemandu lain, LLM boleh meningkatkan keupayaan membuat keputusan dan keselamatan keseluruhan kenderaan autonomi.

Pemandu Autonomi Diperibadikan

Apabila kenderaan autonomi berkembang, aspek penting ialah mempertimbangkan cara ia menyesuaikan diri dengan pilihan pemanduan individu pengguna. Terdapat konsensus yang semakin meningkat bahawa kereta pandu sendiri harus meniru gaya pemanduan pengguna mereka. Untuk mencapai matlamat ini, sistem pemanduan autonomi perlu mempelajari dan menyepadukan pilihan pengguna dalam pelbagai aspek, seperti navigasi, penyelenggaraan kenderaan dan hiburan. Keupayaan penalaan arahan LLM dan keupayaan pembelajaran kontekstual menjadikannya ideal untuk menyepadukan keutamaan pengguna dan memacu maklumat sejarah ke dalam kenderaan autonomi untuk memberikan pengalaman pemanduan yang diperibadikan.

Ringkasan

Selama bertahun-tahun, pemanduan autonomi telah menjadi tumpuan perhatian orang ramai dan menarik ramai pelabur teroka. Mengintegrasikan LLM ke dalam kenderaan autonomi memberikan cabaran unik, tetapi mengatasinya akan meningkatkan sistem autonomi sedia ada dengan ketara. Boleh diramalkan bahawa kokpit pintar yang disokong oleh LLM mempunyai keupayaan untuk memahami senario pemanduan dan pilihan pengguna, dan mewujudkan kepercayaan yang lebih mendalam antara kenderaan dan penumpang. Selain itu, sistem pemanduan autonomi yang menggunakan LLM akan lebih berupaya menangani dilema etika yang melibatkan penimbangan keselamatan pejalan kaki berbanding keselamatan penumpang kenderaan, mempromosikan proses membuat keputusan yang lebih berkemungkinan beretika dalam senario pemanduan yang kompleks. Artikel ini menyepadukan cerapan daripada ahli jawatankuasa bengkel LLVM-AD WACV 2024 dan bertujuan untuk memberi inspirasi kepada penyelidik untuk menyumbang kepada pembangunan kenderaan autonomi generasi akan datang yang dikuasakan oleh teknologi LLM.

Atas ialah kandungan terperinci Penyelidikan sistem mendedahkan model besar yang sangat diperlukan untuk sistem pemanduan autonomi generasi akan datang. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!