Peranti teknologi

Peranti teknologi AI

AI Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.

Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.Jika anda pernah berinteraksi dengan mana-mana bot AI perbualan, anda akan mengingati beberapa detik yang sangat mengecewakan. Sebagai contoh, perkara penting yang anda nyatakan dalam perbualan sehari sebelumnya telah dilupakan sepenuhnya oleh AI...

Ini kerana kebanyakan LLM semasa hanya boleh mengingati konteks terhad, sama seperti pelajar berdesak-desakan untuk peperiksaan , sedikit silang- peperiksaan akan "mendedahkan kebenaran."

Bukankah patut dicemburui jika pembantu AI boleh merujuk perbualan secara kontekstual dari beberapa minggu atau bulan lalu dalam sembang, atau jika anda boleh meminta pembantu AI untuk meringkaskan laporan yang sepanjang beribu-ribu halaman?

Untuk menjadikan LLM lebih mengingati dan mengingati lebih banyak kandungan, penyelidik telah bekerja keras. Baru-baru ini, penyelidik dari MIT, Meta AI, dan Carnegie Mellon University mencadangkan kaedah yang dipanggil "StreamingLLM" yang membolehkan model bahasa memproses teks tanpa henti dengan lancar

- Alamat kertas: https://arxiv.org /pdf/2309.17453.pdf

- Alamat projek: https://github.com/mit-han-lab/streaming-llm

StreamingLLM berfungsi dengan mengenal pasti dan menyimpan niat ” (perhatian tenggelam) yang menambat token awal untuk alasannya. Digabungkan dengan cache rolling token baru-baru ini, StreamingLLM mempercepatkan inferens sebanyak 22x tanpa mengorbankan sebarang ketepatan. Hanya dalam beberapa hari, projek itu telah memperoleh 2.5K bintang pada platform GitHub:

Secara khusus, StreamingLLM ialah model bahasa yang boleh mengingati dengan tepat skor permainan sebelumnya, a kontrak yang panjang, atau kandungan perbahasan. Sama seperti menaik taraf memori pembantu AI, ia boleh mengendalikan lebih banyak beban kerja yang berat dengan sempurna

Mari lihat butiran teknikal seterusnya.

Inovasi Kaedah

Secara amnya, LLM dihadkan oleh tingkap perhatian semasa pra-latihan. Walaupun terdapat banyak kerja sebelum ini untuk mengembangkan saiz tetingkap ini dan meningkatkan kecekapan latihan dan inferens, panjang jujukan LLM yang boleh diterima masih terhad, yang tidak mesra untuk penggunaan berterusan.

Dalam kertas kerja ini, penyelidik mula-mula memperkenalkan konsep aplikasi penstriman LLM dan menimbulkan persoalan: "Bolehkah LLM digunakan dengan input yang tidak terhingga tanpa mengorbankan kecekapan dan prestasi?"

Apabila menggunakan LLM pada panjang yang tidak terhingga aliran input, anda akan menghadapi dua cabaran utama:

1 Dalam peringkat penyahkodan, LLM berasaskan transformer akan menyimpan status Kunci dan Nilai (KV) bagi semua token sebelumnya, seperti yang ditunjukkan dalam Rajah 1 (Seperti yang ditunjukkan dalam. a), ini boleh membawa kepada penggunaan memori yang berlebihan dan meningkatkan kependaman penyahkodan

2 Model sedia ada mempunyai keupayaan ekstrapolasi panjang yang terhad, iaitu, apabila panjang jujukan melebihi tetingkap perhatian yang ditetapkan semasa pra-latihan, ia terlalu terhad. jam yang besar, prestasinya akan merosot.

Kaedah intuitif dipanggil Window Attention (Rajah 1 b) Kaedah ini hanya mengekalkan tetingkap gelongsor bersaiz tetap pada status KV token terkini Walaupun ia boleh memastikan penggunaan memori dan penyahkodan yang stabil kelajuan selepas cache diisi, tetapi apabila panjang jujukan melebihi saiz cache, atau malah hanya mengusir KV token pertama, model akan ranap. Kaedah lain ialah mengira semula tetingkap gelongsor (ditunjukkan dalam Rajah 1 c). Kaedah ini membina semula keadaan KV bagi token yang dijana Walaupun prestasinya berkuasa, ia memerlukan pengiraan perhatian sekunder dalam tetingkap hasilnya adalah lebih perlahan, yang tidak sesuai dalam aplikasi penstriman sebenar.

Dalam proses mengkaji kegagalan perhatian tetingkap, penyelidik menemui fenomena menarik: menurut Rajah 2, sejumlah besar skor perhatian diberikan kepada tag awal, tidak kira sama ada tag ini berkaitan dengan tugas pemodelan bahasa

Penyelidik memanggil token ini sebagai "kolam perhatian": walaupun ia tidak mempunyai makna semantik, ia menduduki sejumlah besar skor perhatian. Penyelidik mengaitkan fenomena ini kepada Softmax (yang memerlukan jumlah skor perhatian semua token konteks ialah 1 Walaupun pertanyaan semasa tidak mempunyai padanan yang kukuh antara banyak token sebelumnya, model masih perlu memindahkan perhatian yang tidak diingini ini). . Nilai ditetapkan di suatu tempat supaya jumlahnya menjadi 1. Sebab mengapa token awal menjadi "kolam" adalah intuitif: disebabkan oleh ciri-ciri pemodelan bahasa autoregresif, token awal kelihatan kepada hampir semua token berikutnya, yang menjadikannya lebih mudah untuk dilatih sebagai kumpulan perhatian.

Berdasarkan pandangan di atas, penyelidik mencadangkan StreamingLLM. Ini ialah rangka kerja yang mudah dan cekap yang membolehkan model perhatian yang dilatih dengan tingkap perhatian terhad untuk mengendalikan teks yang panjang tidak terhingga tanpa penalaan halus

StreamingLLM mengambil kesempatan daripada fakta bahawa kumpulan perhatian mempunyai nilai perhatian yang tinggi Malah, mengekalkan kumpulan perhatian ini boleh jadikan taburan skor perhatian hampir kepada taburan normal. Oleh itu, StreamingLLM hanya perlu mengekalkan nilai KV token pool perhatian (hanya 4 token awal sudah mencukupi) dan nilai KV tetingkap gelongsor untuk menambat pengiraan perhatian dan menstabilkan prestasi model.

Menggunakan StreamingLLM, termasuk Llama-2-[7,13,70] B, MPT-[7,30] B, Falcon-[7,40] B dan Pythia [2.9,6.9,12] B Model boleh mensimulasikan 4 juta token atau lebih dengan pasti.

Berbanding dengan mengira semula tetingkap gelongsor, StreamingLLM adalah 22.2 kali lebih pantas tanpa menjejaskan prestasi

Penilaian

Dalam eksperimen, seperti yang ditunjukkan dalam Rajah 3, perplexiti LL, untuk teks 3M setanding dengan garis dasar Oracle yang mengira semula tetingkap gelongsor. Pada masa yang sama, apabila panjang input melebihi tetingkap pra-latihan, perhatian yang padat gagal, dan apabila panjang input melebihi saiz cache, perhatian tetingkap akan tersekat, menyebabkan tag awal akan disingkirkan

Rajah 5 Selanjutnya Kebolehpercayaan StreamingLLM ditunjukkan dan ia boleh mengendalikan teks dengan saiz luar biasa, termasuk lebih daripada 4 juta token, meliputi pelbagai keluarga dan saiz model. Model ini termasuk Llama-2-[7,13,70] B, Falcon-[7,40] B, Pythia-[2.8,6.9,12] B dan MPT-[7,30] B

Seterusnya, penyelidik mengesahkan hipotesis "kolam perhatian" dan membuktikan bahawa model bahasa boleh dilatih terlebih dahulu dan hanya memerlukan satu token kumpulan perhatian semasa penggunaan penstriman. Khususnya, mereka mencadangkan menambah token boleh dipelajari tambahan pada permulaan semua sampel latihan sebagai kumpulan perhatian yang ditetapkan. Dengan pra-latihan model bahasa dengan 160 juta parameter dari awal, para penyelidik menunjukkan bahawa kaedah kami boleh mengekalkan prestasi model. Ini sangat berbeza dengan model bahasa semasa, yang memerlukan pengenalan semula berbilang token awal sebagai kumpulan perhatian untuk mencapai tahap prestasi yang sama.

Akhir sekali, penyelidik membandingkan kependaman penyahkodan dan penggunaan memori StreamingLLM dengan tetingkap gelongsor yang dikira semula dan mengujinya menggunakan model Llama-2-7B dan Llama-2-13B pada GPU NVIDIA A6000 tunggal. Menurut keputusan dalam Rajah 10, apabila saiz cache meningkat, kelajuan penyahkodan StreamingLLM meningkat secara linear, manakala kelewatan penyahkodan meningkat secara kuadratik. Eksperimen telah membuktikan bahawa StreamingLLM mencapai kelajuan yang mengagumkan, dengan kelajuan setiap token meningkat sehingga 22.2 kali ganda

Untuk butiran penyelidikan lanjut, sila rujuk kertas asal.

🎜Atas ialah kandungan terperinci Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

从VAE到扩散模型:一文解读以文生图新范式Apr 08, 2023 pm 08:41 PM

从VAE到扩散模型:一文解读以文生图新范式Apr 08, 2023 pm 08:41 PM1 前言在发布DALL·E的15个月后,OpenAI在今年春天带了续作DALL·E 2,以其更加惊艳的效果和丰富的可玩性迅速占领了各大AI社区的头条。近年来,随着生成对抗网络(GAN)、变分自编码器(VAE)、扩散模型(Diffusion models)的出现,深度学习已向世人展现其强大的图像生成能力;加上GPT-3、BERT等NLP模型的成功,人类正逐步打破文本和图像的信息界限。在DALL·E 2中,只需输入简单的文本(prompt),它就可以生成多张1024*1024的高清图像。这些图像甚至

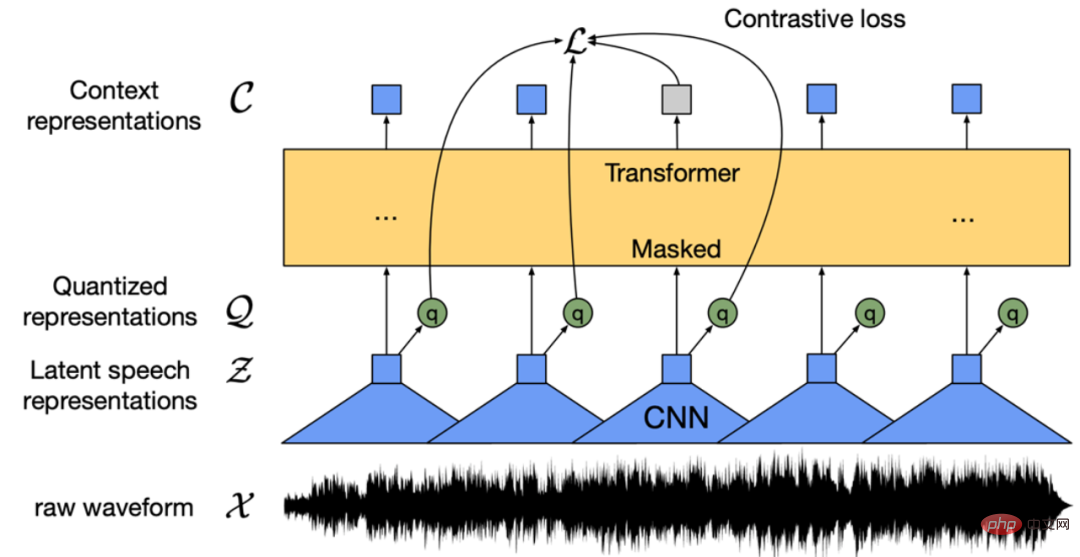

找不到中文语音预训练模型?中文版 Wav2vec 2.0和HuBERT来了Apr 08, 2023 pm 06:21 PM

找不到中文语音预训练模型?中文版 Wav2vec 2.0和HuBERT来了Apr 08, 2023 pm 06:21 PMWav2vec 2.0 [1],HuBERT [2] 和 WavLM [3] 等语音预训练模型,通过在多达上万小时的无标注语音数据(如 Libri-light )上的自监督学习,显著提升了自动语音识别(Automatic Speech Recognition, ASR),语音合成(Text-to-speech, TTS)和语音转换(Voice Conversation,VC)等语音下游任务的性能。然而这些模型都没有公开的中文版本,不便于应用在中文语音研究场景。 WenetSpeech [4] 是

普林斯顿陈丹琦:如何让「大模型」变小Apr 08, 2023 pm 04:01 PM

普林斯顿陈丹琦:如何让「大模型」变小Apr 08, 2023 pm 04:01 PM“Making large models smaller”这是很多语言模型研究人员的学术追求,针对大模型昂贵的环境和训练成本,陈丹琦在智源大会青源学术年会上做了题为“Making large models smaller”的特邀报告。报告中重点提及了基于记忆增强的TRIME算法和基于粗细粒度联合剪枝和逐层蒸馏的CofiPruning算法。前者能够在不改变模型结构的基础上兼顾语言模型困惑度和检索速度方面的优势;而后者可以在保证下游任务准确度的同时实现更快的处理速度,具有更小的模型结构。陈丹琦 普

解锁CNN和Transformer正确结合方法,字节跳动提出有效的下一代视觉TransformerApr 09, 2023 pm 02:01 PM

解锁CNN和Transformer正确结合方法,字节跳动提出有效的下一代视觉TransformerApr 09, 2023 pm 02:01 PM由于复杂的注意力机制和模型设计,大多数现有的视觉 Transformer(ViT)在现实的工业部署场景中不能像卷积神经网络(CNN)那样高效地执行。这就带来了一个问题:视觉神经网络能否像 CNN 一样快速推断并像 ViT 一样强大?近期一些工作试图设计 CNN-Transformer 混合架构来解决这个问题,但这些工作的整体性能远不能令人满意。基于此,来自字节跳动的研究者提出了一种能在现实工业场景中有效部署的下一代视觉 Transformer——Next-ViT。从延迟 / 准确性权衡的角度看,

Stable Diffusion XL 现已推出—有什么新功能,你知道吗?Apr 07, 2023 pm 11:21 PM

Stable Diffusion XL 现已推出—有什么新功能,你知道吗?Apr 07, 2023 pm 11:21 PM3月27号,Stability AI的创始人兼首席执行官Emad Mostaque在一条推文中宣布,Stable Diffusion XL 现已可用于公开测试。以下是一些事项:“XL”不是这个新的AI模型的官方名称。一旦发布稳定性AI公司的官方公告,名称将会更改。与先前版本相比,图像质量有所提高与先前版本相比,图像生成速度大大加快。示例图像让我们看看新旧AI模型在结果上的差异。Prompt: Luxury sports car with aerodynamic curves, shot in a

五年后AI所需算力超100万倍!十二家机构联合发表88页长文:「智能计算」是解药Apr 09, 2023 pm 07:01 PM

五年后AI所需算力超100万倍!十二家机构联合发表88页长文:「智能计算」是解药Apr 09, 2023 pm 07:01 PM人工智能就是一个「拼财力」的行业,如果没有高性能计算设备,别说开发基础模型,就连微调模型都做不到。但如果只靠拼硬件,单靠当前计算性能的发展速度,迟早有一天无法满足日益膨胀的需求,所以还需要配套的软件来协调统筹计算能力,这时候就需要用到「智能计算」技术。最近,来自之江实验室、中国工程院、国防科技大学、浙江大学等多达十二个国内外研究机构共同发表了一篇论文,首次对智能计算领域进行了全面的调研,涵盖了理论基础、智能与计算的技术融合、重要应用、挑战和未来前景。论文链接:https://spj.scien

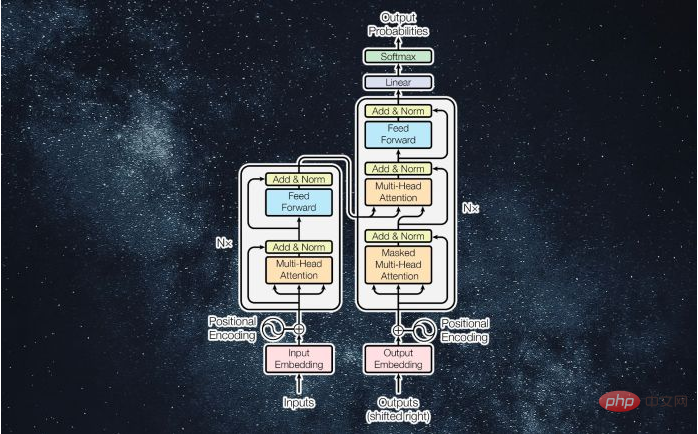

什么是Transformer机器学习模型?Apr 08, 2023 pm 06:31 PM

什么是Transformer机器学习模型?Apr 08, 2023 pm 06:31 PM译者 | 李睿审校 | 孙淑娟近年来, Transformer 机器学习模型已经成为深度学习和深度神经网络技术进步的主要亮点之一。它主要用于自然语言处理中的高级应用。谷歌正在使用它来增强其搜索引擎结果。OpenAI 使用 Transformer 创建了著名的 GPT-2和 GPT-3模型。自从2017年首次亮相以来,Transformer 架构不断发展并扩展到多种不同的变体,从语言任务扩展到其他领域。它们已被用于时间序列预测。它们是 DeepMind 的蛋白质结构预测模型 AlphaFold

AI模型告诉你,为啥巴西最可能在今年夺冠!曾精准预测前两届冠军Apr 09, 2023 pm 01:51 PM

AI模型告诉你,为啥巴西最可能在今年夺冠!曾精准预测前两届冠军Apr 09, 2023 pm 01:51 PM说起2010年南非世界杯的最大网红,一定非「章鱼保罗」莫属!这只位于德国海洋生物中心的神奇章鱼,不仅成功预测了德国队全部七场比赛的结果,还顺利地选出了最终的总冠军西班牙队。不幸的是,保罗已经永远地离开了我们,但它的「遗产」却在人们预测足球比赛结果的尝试中持续存在。在艾伦图灵研究所(The Alan Turing Institute),随着2022年卡塔尔世界杯的持续进行,三位研究员Nick Barlow、Jack Roberts和Ryan Chan决定用一种AI算法预测今年的冠军归属。预测模型图

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

MantisBT

Mantis ialah alat pengesan kecacatan berasaskan web yang mudah digunakan yang direka untuk membantu dalam pengesanan kecacatan produk. Ia memerlukan PHP, MySQL dan pelayan web. Lihat perkhidmatan demo dan pengehosan kami.

DVWA

Damn Vulnerable Web App (DVWA) ialah aplikasi web PHP/MySQL yang sangat terdedah. Matlamat utamanya adalah untuk menjadi bantuan bagi profesional keselamatan untuk menguji kemahiran dan alatan mereka dalam persekitaran undang-undang, untuk membantu pembangun web lebih memahami proses mengamankan aplikasi web, dan untuk membantu guru/pelajar mengajar/belajar dalam persekitaran bilik darjah Aplikasi web keselamatan. Matlamat DVWA adalah untuk mempraktikkan beberapa kelemahan web yang paling biasa melalui antara muka yang mudah dan mudah, dengan pelbagai tahap kesukaran. Sila ambil perhatian bahawa perisian ini

SublimeText3 versi Inggeris

Disyorkan: Versi Win, menyokong gesaan kod!

Penyesuai Pelayan SAP NetWeaver untuk Eclipse

Integrasikan Eclipse dengan pelayan aplikasi SAP NetWeaver.

Dreamweaver Mac版

Alat pembangunan web visual