Rumah >Peranti teknologi >AI >NVIDIA membangunkan penyelesaian sembang video 3D AI untuk panggilan persidangan jauh

NVIDIA membangunkan penyelesaian sembang video 3D AI untuk panggilan persidangan jauh

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-08-23 18:49:011770semak imbas

Sistem persidangan video pertama kali dikomersialkan lebih 50 tahun yang lalu, membolehkan orang ramai berkomunikasi secara audio-visual dengan rakan sekerja, rakan atau ahli keluarga beribu batu jauhnya. Matlamat utama persidangan video adalah untuk membolehkan komunikasi yang mendalam antara peserta jauh seolah-olah mereka semua berada di tempat yang sama

Sistem persidangan video 3D sedia ada, sambil menunjukkan potensi untuk menangkap hubungan mata dan isyarat bukan lisan lain, memerlukan peralatan pemerolehan 3D yang mahal

Dalam projek yang dipanggil "Persidangan Video 3D Pengantara AI", pasukan dari NVIDIA, University of California, San Diego dan University of North Carolina di Chapel Hill berjaya membangunkan sistem persidangan video 3D kos rendah yang berkeyakinan tinggi menggunakan Teknologi kecerdasan buatan AI kaedah Telepresence dan menyediakan fungsi baharu yang tidak boleh dicapai berdasarkan pengimbasan 3D

Selain itu, penyelesaian pasukan serasi dengan pelbagai paparan 3D sedia ada, termasuk paparan stereoskopik dan paparan medan cahaya

Bacaan lanjutan: Menggunakan AI untuk mengurangkan saiz, Google menunjukkan lelaran baharu projek panggilan medan cahaya Project Starline

Perlu diingat bahawa Google menggunakan kecerdasan buatan untuk meningkatkan projek panggilan medan cahaya Project Starline mereka. Ringkasnya, Project Starline ialah bilik sembang video 3D yang menggunakan teknologi medan cahaya untuk mewujudkan perasaan seolah-olah orang lain itu benar-benar duduk di hadapan anda. Alat komunikasi jauh yang inovatif ini menggabungkan kemajuan perkakasan dan perisian Google untuk menjadikan rakan, keluarga dan rakan sekerja lebih mengasyikkan apabila berkomunikasi dari jauh

Pasukan NVIDIA kembali dalam projek "Persidangan Video 3D Pengantara AI" mereka dan menunjukkan persediaan di SIGGRAPH dan menulis tentangnya

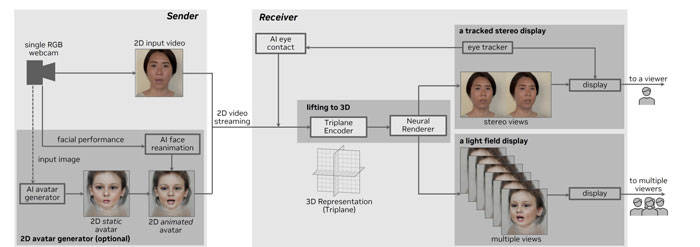

Sistem yang digambarkan termasuk pengirim untuk merakam dan menghantar video 2D daripada kamera web RGB tunggal dan penerima untuk menerima dan menukar video 2D kepada 3D dan mempersembahkan paparan 3D yang baru

Dengan menggunakan pendekatan satu pukulan, penyelidik boleh membuat kesimpulan dan menghasilkan perwakilan 3D yang realistik daripada satu imej yang tidak didedahkan dalam masa nyata dan menjana imej medan cahaya pada komputer riba NVIDIA RTX A5000. Menggunakan teknologi resolusi super AI segera, peserta boleh melihat imej diri 3D mereka dengan serta-merta. Dalam masa nyata, peserta boleh menonton apabila imej kamera web 2D diangkat ke paparan 3D stereoskopik dengan pengesanan kepala

Pengguna mempunyai pilihan untuk menggunakan modul Penjana Avatar 2D untuk menjana dan menyesuaikan Avatar 2D dipacu pengguna selain menggunakan gambar kamera web

Penyelidik telah membuat kemajuan penting dalam pengangkatan 3D dengan mencadangkan pengekod baharu berdasarkan Pengubah Penglihatan untuk menukar input 2D kepada perwakilan 3D tersirat triplanar yang cekap. Memandangkan satu imej RGB pengguna, kaedah ini dapat mencipta perwakilan 3D hadapan pengguna secara automatik dan memaparkannya dengan cekap dari sudut pandangan baharu melalui pemaparan 3D volumetrik

Penulisan semula ayat ini adalah seperti berikut: Pengekod triplanar bergantung sepenuhnya pada data sintetik yang dijana oleh EG3D pra-latihan untuk latihan, manakala modul pengangkatan 3D menggunakan prior yang dijana untuk memastikan paparan yang dijana adalah aspek konsisten berbilang paparan dan fotorealistik dan boleh digunakan kepada sesiapa sahaja dalam satu pukulan tanpa latihan khusus peribadi

Pasukan menggunakan kaedah saraf tercanggih untuk mencapai sentuhan mata dengan mensintesis pandangan mata yang diubah hala bagi gambar pengguna yang diberikan, menaik taraf imej 2D kepada imej 3D melalui pembetulan pandangan, seperti yang ditunjukkan dalam rajah

Sistem ini menyokong pelbagai paparan 3D di luar rak, termasuk paparan stereoskopik satu orang dan paparan medan cahaya berbilang orang

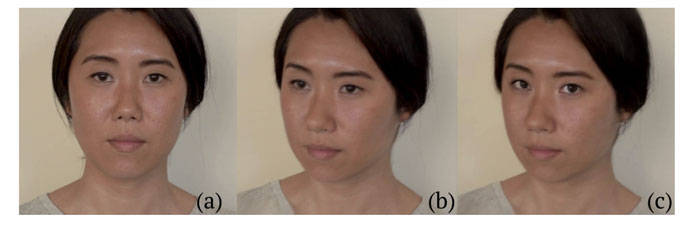

Gambar ini menunjukkan penggunaan monitor stereoskopik 3D 32 inci daripada Dimenco. Ia menggunakan teknologi penjejakan mata dan kanta untuk menghasilkan imej stereoskopik yang memaparkan kedudukan mata pengguna dengan tepat. A memberikan gambaran keseluruhan, manakala b dan c menunjukkan keupayaan sistem untuk merakam imej stereoskopik peserta pada perspektif yang betul. Sementara itu, d dan e menggambarkan bahawa diberikan satu imej RGB, kaedah ini boleh menjana kesan telepresence yang realistik

Selain itu, para penyelidik menggunakan monitor Looking Glass 32-inci untuk menilai sistem AI. Paparan boleh memaparkan kepala bercakap bersaiz hidup secara serentak, membolehkan berbilang orang melihatnya dengan jelas. Paparan medan cahaya ini memberikan demonstrasi teknologi yang jelas untuk khalayak umum dan mereka yang menunggu tunjuk cara

Seterusnya, orang yang menunggu dalam barisan boleh mencuba paparan tiga dimensi di gerai yang berbeza dan mengalami panggilan persidangan video 3D berpandukan kecerdasan buatan berbilang saluran

Bacaan lanjutan: Persidangan Video 3D Pengantara AI

Bacaan lanjutan: Potret 3D Langsung: Medan Sinaran Masa Nyata untuk Sintesis Paparan Potret Imej Tunggal

Terutama, pasukan mengoptimumkan pengekod dengan menggunakan NVIDIA TensorRT untuk mendayakan inferens masa nyata pada GPU Generasi NVIDIA A6000 Ada. Keseluruhan sistem berjalan dalam masa kurang daripada 100 milisaat, termasuk tangkapan, penstriman dan pemaparan

Atas ialah kandungan terperinci NVIDIA membangunkan penyelesaian sembang video 3D AI untuk panggilan persidangan jauh. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI