Rumah >Peranti teknologi >AI >Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai

Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai

- PHPzke hadapan

- 2023-06-27 16:26:56856semak imbas

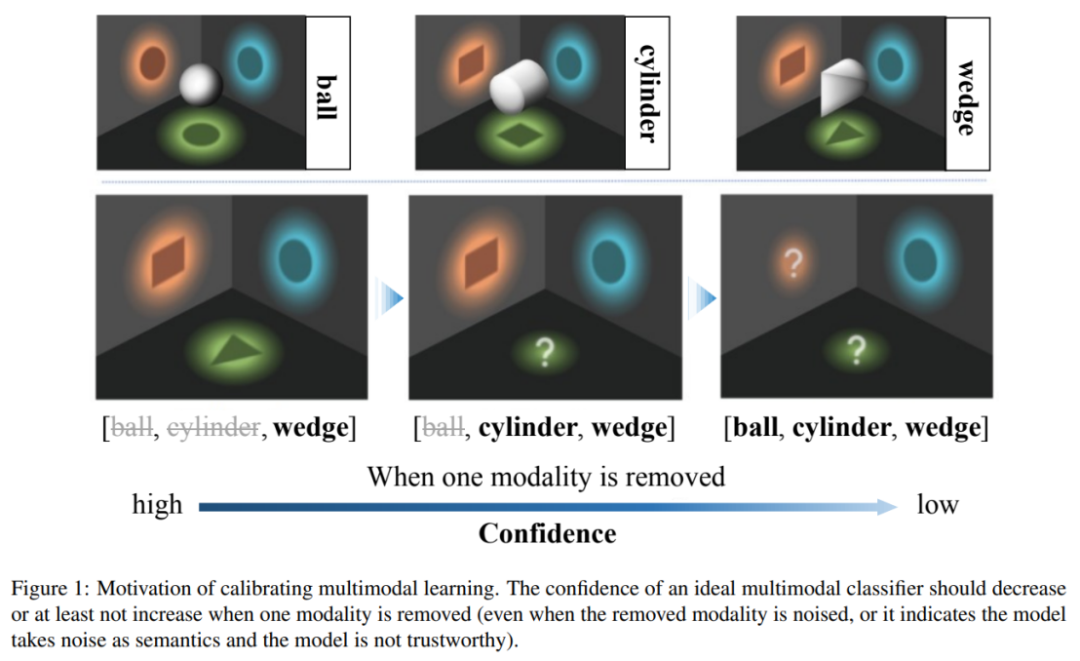

Pembelajaran mesin pelbagai mod telah mencapai kemajuan yang mengagumkan dalam pelbagai senario. Walau bagaimanapun, kebolehpercayaan model pembelajaran multimodal tidak mempunyai penyelidikan yang mendalam. "Maklumat ialah penghapusan ketidakpastian." Niat asal pembelajaran mesin pelbagai mod adalah konsisten dengan ini - modaliti tambahan boleh membuat ramalan lebih tepat dan boleh dipercayai. Walau bagaimanapun, kertas kerja "Calibrating Multimodal Learning" baru-baru ini diterbitkan dalam ICML2023 mendapati bahawa kaedah pembelajaran multimodal semasa melanggar andaian kebolehpercayaan ini, dan membuat analisis dan pembetulan terperinci.

Gambar

Gambar

- Paper Arxiv: https://arxiv.org/abs/2306.01265

- b.com/Q ingyangZhang/CML

Kaedah klasifikasi pelbagai mod semasa mempunyai keyakinan yang tidak boleh dipercayai, iaitu, apabila beberapa mod dialih keluar, model mungkin menghasilkan keyakinan yang lebih tinggi, yang melanggar teori maklumat "maklumat dihapuskan". prinsip asas. Untuk menangani masalah ini, artikel ini mencadangkan kaedah Pembelajaran Multimodal Kalibrasi. Kaedah ini boleh digunakan dalam paradigma pembelajaran pelbagai mod yang berbeza untuk meningkatkan rasional dan kredibiliti model pembelajaran pelbagai mod.

Kaedah klasifikasi pelbagai mod semasa mempunyai keyakinan yang tidak boleh dipercayai, iaitu, apabila beberapa mod dialih keluar, model mungkin menghasilkan keyakinan yang lebih tinggi, yang melanggar teori maklumat "maklumat dihapuskan". prinsip asas. Untuk menangani masalah ini, artikel ini mencadangkan kaedah Pembelajaran Multimodal Kalibrasi. Kaedah ini boleh digunakan dalam paradigma pembelajaran pelbagai mod yang berbeza untuk meningkatkan rasional dan kredibiliti model pembelajaran pelbagai mod.

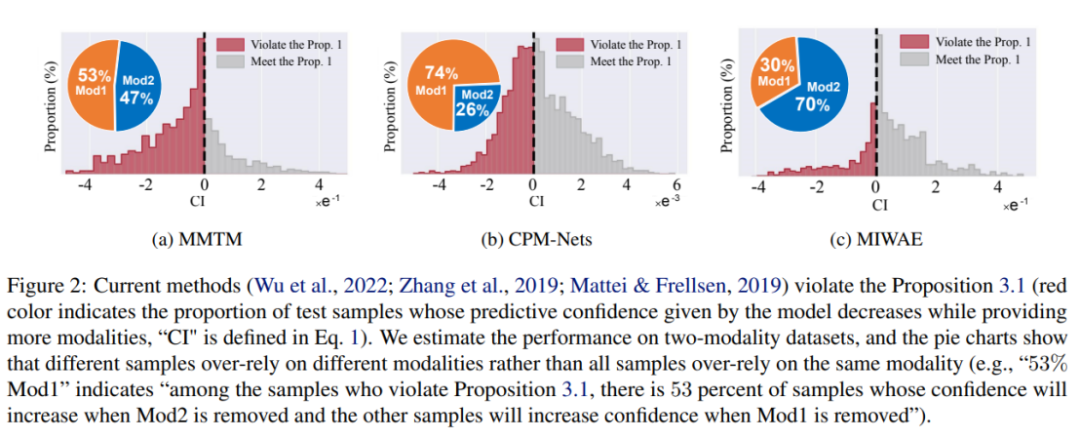

Pictures

Kerja ini menunjukkan bahawa kaedah pembelajaran pelbagai mod semasa mempunyai masalah keyakinan ramalan yang tidak boleh dipercayai, dan model pembelajaran mesin pelbagai mod sedia ada cenderung bergantung pada modaliti separa untuk menganggarkan keyakinan. Khususnya, kajian mendapati bahawa keyakinan anggaran model semasa meningkat apabila mod tertentu rosak. Untuk menyelesaikan masalah yang tidak munasabah ini, penulis mencadangkan prinsip pembelajaran pelbagai mod intuitif: apabila modaliti dialih keluar, keyakinan ramalan model tidak seharusnya meningkat. Walau bagaimanapun, model semasa cenderung untuk mempercayai dan dipengaruhi oleh subset modaliti, dan bukannya mempertimbangkan semua modaliti secara adil. Ini seterusnya menjejaskan kekukuhan model, iaitu model mudah terjejas apabila mod tertentu rosak.

Kerja ini menunjukkan bahawa kaedah pembelajaran pelbagai mod semasa mempunyai masalah keyakinan ramalan yang tidak boleh dipercayai, dan model pembelajaran mesin pelbagai mod sedia ada cenderung bergantung pada modaliti separa untuk menganggarkan keyakinan. Khususnya, kajian mendapati bahawa keyakinan anggaran model semasa meningkat apabila mod tertentu rosak. Untuk menyelesaikan masalah yang tidak munasabah ini, penulis mencadangkan prinsip pembelajaran pelbagai mod intuitif: apabila modaliti dialih keluar, keyakinan ramalan model tidak seharusnya meningkat. Walau bagaimanapun, model semasa cenderung untuk mempercayai dan dipengaruhi oleh subset modaliti, dan bukannya mempertimbangkan semua modaliti secara adil. Ini seterusnya menjejaskan kekukuhan model, iaitu model mudah terjejas apabila mod tertentu rosak.

Untuk menyelesaikan masalah di atas, beberapa kaedah pada masa ini menggunakan kaedah penentukuran ketidakpastian sedia ada, seperti Penskalaan Suhu atau kaedah pembelajaran Bayesian. Kaedah ini boleh membina anggaran keyakinan yang lebih tepat daripada kaedah latihan/inferens tradisional. Walau bagaimanapun, kaedah ini hanya sepadan dengan anggaran keyakinan hasil gabungan akhir dengan ketepatan, dan tidak mempertimbangkan secara eksplisit perhubungan antara jumlah maklumat modal dan keyakinan Oleh itu, ia tidak dapat meningkatkan kredibiliti model pembelajaran pelbagai mod.

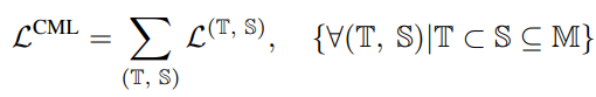

Pengarang mencadangkan teknik regularisasi baharu yang dipanggil "Calibrating Multimodal Learning (CML)". Teknik ini menguatkuasakan perhubungan padanan antara keyakinan ramalan model dan kandungan maklumat dengan menambahkan istilah penalti untuk mencapai konsistensi antara keyakinan ramalan dan kandungan maklumat. Teknik ini adalah berdasarkan intuisi semula jadi bahawa keyakinan ramalan harus berkurangan (sekurang-kurangnya tidak meningkat) apabila modaliti dialih keluar, yang sememangnya boleh meningkatkan penentukuran keyakinan. Secara khusus, istilah penyelarasan mudah dicadangkan untuk memaksa model mempelajari hubungan pesanan intuitif dengan menambahkan penalti kepada sampel tersebut yang keyakinan ramalannya meningkat apabila modaliti dialih keluar:

Pengarang mencadangkan teknik regularisasi baharu yang dipanggil "Calibrating Multimodal Learning (CML)". Teknik ini menguatkuasakan perhubungan padanan antara keyakinan ramalan model dan kandungan maklumat dengan menambahkan istilah penalti untuk mencapai konsistensi antara keyakinan ramalan dan kandungan maklumat. Teknik ini adalah berdasarkan intuisi semula jadi bahawa keyakinan ramalan harus berkurangan (sekurang-kurangnya tidak meningkat) apabila modaliti dialih keluar, yang sememangnya boleh meningkatkan penentukuran keyakinan. Secara khusus, istilah penyelarasan mudah dicadangkan untuk memaksa model mempelajari hubungan pesanan intuitif dengan menambahkan penalti kepada sampel tersebut yang keyakinan ramalannya meningkat apabila modaliti dialih keluar:

Kekangan di atas ialah a kerugian tetap, yang muncul sebagai penalti apabila maklumat modal dialih keluar dan keyakinan meningkat.

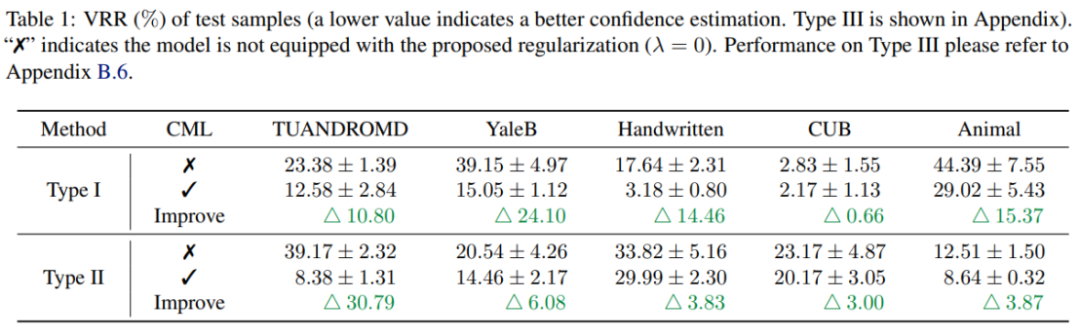

Hasil eksperimen menunjukkan bahawa penyelarasan CML boleh meningkatkan dengan ketara kebolehpercayaan keyakinan ramalan kaedah pembelajaran pelbagai mod sedia ada. Selain itu, CML boleh meningkatkan ketepatan klasifikasi dan meningkatkan keteguhan model.

Hasil eksperimen menunjukkan bahawa penyelarasan CML boleh meningkatkan dengan ketara kebolehpercayaan keyakinan ramalan kaedah pembelajaran pelbagai mod sedia ada. Selain itu, CML boleh meningkatkan ketepatan klasifikasi dan meningkatkan keteguhan model.

Pembelajaran mesin pelbagai mod telah mencapai kemajuan yang ketara dalam pelbagai senario, tetapi kebolehpercayaan model pembelajaran mesin pelbagai mod masih menjadi masalah yang perlu diselesaikan. Melalui kajian empirikal yang meluas, kertas kerja ini mendapati kaedah pengelasan multimodal semasa mempunyai masalah keyakinan ramalan yang tidak boleh dipercayai dan melanggar prinsip teori maklumat. Untuk menangani isu ini, penyelidik mencadangkan teknik penyusunan CML, yang boleh digunakan secara fleksibel pada model sedia ada dan meningkatkan prestasi dari segi penentukuran keyakinan, ketepatan klasifikasi dan keteguhan model. Adalah dipercayai bahawa teknologi baharu ini akan memainkan peranan penting dalam pembelajaran pelbagai mod pada masa hadapan dan meningkatkan kebolehpercayaan dan kepraktisan pembelajaran mesin.

Atas ialah kandungan terperinci Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI