Peranti teknologi

Peranti teknologi AI

AI Enam cara untuk membina chatbot AI dan model bahasa yang besar untuk meningkatkan keselamatan siber

Enam cara untuk membina chatbot AI dan model bahasa yang besar untuk meningkatkan keselamatan siberEnam cara untuk membina chatbot AI dan model bahasa yang besar untuk meningkatkan keselamatan siber

Chatbot AI Generatif dan model bahasa besar boleh menjadi pedang bermata dua dari perspektif risiko, tetapi jika digunakan dengan betul, mereka juga boleh meningkatkan keselamatan siber dengan cara utama.

Peningkatan mendadak ChatGPT yang dibangunkan oleh syarikat OpenAI merupakan salah satu berita terbesar tahun ini, dan potensi kesan chatbot AI generatif dan model bahasa besar terhadap keselamatan siber adalah bidang utama perbincangan. Terdapat banyak perbincangan tentang risiko keselamatan yang boleh ditimbulkan oleh teknologi baharu ini, daripada kebimbangan mengenai perkongsian maklumat perniagaan yang sensitif dengan algoritma pembelajaran kendiri lanjutan kepada pelakon berniat jahat yang menggunakannya untuk meningkatkan serangan dengan ketara.

Sesetengah negara, negeri dan perusahaan telah melarang penggunaan teknologi kecerdasan buatan generatif seperti ChatGPT atas alasan keselamatan, perlindungan dan privasi data. Jelas sekali, risiko keselamatan yang ditimbulkan oleh chatbot AI generatif dan model bahasa yang besar dan besar adalah besar. Walau bagaimanapun, terdapat banyak cara di mana chatbot AI generatif boleh meningkatkan keselamatan siber perusahaan, memberikan pasukan keselamatan rangsangan yang amat diperlukan dalam memerangi jenayah siber.

Berikut ialah 6 cara chatbot AI generatif dan model bahasa besar boleh meningkatkan keselamatan.

Pengimbasan dan Penapisan Kerentanan

Menurut laporan Cloud Security Alliance (CSA) yang meneroka kesan keselamatan siber model bahasa besar, kecerdasan buatan generatif Model pintar boleh digunakan untuk meningkatkan pengimbasan dan penapisan kelemahan keselamatan dengan ketara. Dalam kertas itu, Cloud Security Alliance (CSA) menunjukkan bahawa OpenAI's Codex API ialah pengimbas kerentanan yang berkesan untuk bahasa pengaturcaraan seperti C, C#, Java dan JavaScript. "Kami dapat meramalkan bahawa model bahasa yang besar, seperti yang terdapat dalam keluarga Codex, akan menjadi bahagian standard pengimbas kerentanan pada masa hadapan," tulis kertas itu. Sebagai contoh, pengimbas boleh dibangunkan untuk mengesan dan membenderakan corak kod yang tidak selamat dalam pelbagai bahasa, membantu pembangun menangani potensi kelemahan sebelum ia menjadi risiko keselamatan yang kritikal.

Bagi penapisan, model AI generatif boleh mentafsir dan menambah konteks berharga kepada pengecam ancaman yang mungkin terlepas oleh kakitangan keselamatan manusia. Sebagai contoh, pengecam teknikal TT1059.001 dalam rangka kerja MITRATT&CK mungkin dilaporkan tetapi akan menjadi asing bagi sesetengah profesional keselamatan siber dan oleh itu memerlukan penjelasan ringkas. ChatGPT boleh mengenal pasti kod dengan tepat sebagai pengecam MITRATT&CK dan memberikan penjelasan tentang isu khusus yang berkaitan dengannya, yang melibatkan penggunaan skrip PowerShell yang berniat jahat. Ia juga memperincikan sifat PowerShell dan potensi penggunaannya dalam serangan keselamatan siber, dan menyediakan contoh yang berkaitan.

Pada bulan Mei tahun ini, OXSecurity mengumumkan pelancaran OX-gpt, penyepaduan ChatGPT yang direka untuk membantu pembangun menyediakan cadangan pembetulan kod tersuai dan pembetulan kod potong-tampal, termasuk cara kod Dieksploitasi oleh penggodam, kemungkinan kesan serangan dan kemungkinan kerosakan kepada organisasi.

Tambah songsang, analisa API fail PE

Matt Fulmer, pengurus kejuruteraan perisikan rangkaian DeepInstinct, berkata berdasarkan kejuruteraan terbalik rangka kerja seperti IDA dan Ghidra , teknologi AI generatif/model bahasa besar (LLM) boleh digunakan untuk membantu membina peraturan dan membalikkan alat tambah popular. "Jika anda menjelaskan keperluan anda dan membandingkannya dengan serangan dan strategi serangan MITRE, anda boleh mengambil keputusan di luar talian dan menggunakannya dengan lebih baik sebagai pertahanan." menganalisis API boleh laku mudah alih (PE) dan memberitahu anda untuk kegunaannya, tambahnya. "Ini boleh mengurangkan masa yang diluangkan oleh penyelidik keselamatan untuk menyemak fail PE dan menganalisis komunikasi API dalam mereka." CSA, pembela keselamatan boleh meningkatkan kecekapan dan mempercepatkan masa tindak balas dengan memanfaatkan ChatGPT dan LLM lain untuk mencipta pertanyaan carian ancaman. Dengan menjana pertanyaan untuk alat penyelidikan dan pengesanan perisian hasad seperti YARA, ChatGPT membantu mengenal pasti dan mengurangkan potensi ancaman dengan cepat, membolehkan pembela menumpukan pada aspek kritikal usaha keselamatan siber mereka. Keupayaan ini telah terbukti tidak ternilai dalam mengekalkan postur keselamatan yang teguh dalam persekitaran ancaman yang berkembang. Peraturan boleh disesuaikan berdasarkan keperluan dan ancaman khusus yang ingin dikesan atau dipantau oleh organisasi dalam persekitarannya.

AI boleh meningkatkan keselamatan rantaian bekalan

Model AI Generatif boleh menangani rantaian bekalan dengan mengenal pasti potensi kelemahan dalam pembekal Risiko keselamatan. Pada April tahun ini, SecurityScorecard mengumumkan pelancaran platform penarafan keselamatan baharu yang mencapai matlamat ini dengan menyepadukan dengan sistem GPT-4 OpenAI dan carian global bahasa semula jadi. Menurut syarikat itu, pelanggan boleh bertanya soalan terbuka tentang ekosistem perniagaan mereka, termasuk butiran vendor, dan dengan cepat menerima jawapan untuk mendorong keputusan pengurusan risiko. Contohnya, "Cari 10 vendor saya yang dinilai paling rendah" atau "Tunjukkan vendor utama saya yang mana telah terjejas pada tahun lalu" - SecurityScorecard mendakwa soalan ini akan menghasilkan keputusan yang membolehkan pasukan membuat keputusan pengurusan risiko dengan cepat membuat keputusan.

Kesan teks AI yang dijana dalam serangan

Menurut CSA, model bahasa besar bukan sahaja menjana teks, tetapi juga berfungsi untuk mengesan dan menanda air teks yang dijana AI, yang mungkin menjadi ciri umum perisian perlindungan e-mel. CSA berkata bahawa mengenal pasti teks yang dijana AI dalam serangan boleh membantu mengesan e-mel pancingan data dan kod polimorfik, dan boleh diandaikan bahawa llm boleh mengesan pengirim alamat e-mel atipikal atau domain yang sepadan dengan mudah, sambil dapat memeriksa lapisan asas dalam teks. . Sama ada pautan itu membawa kepada tapak web berniat jahat yang diketahui.

Penjanaan dan penghantaran kod selamat

LLM seperti ChatGPT boleh digunakan untuk menjana dan menghantar kod keselamatan. CSA memetik contoh kempen pancingan data yang berjaya menyasarkan beberapa pekerja dalam syarikat, yang berpotensi mendedahkan kelayakan mereka. Walaupun diketahui pekerja mana yang membuka e-mel pancingan data, tidak jelas sama ada mereka secara tidak sengaja melaksanakan kod hasad yang direka untuk mencuri bukti kelayakan mereka.

Untuk menyiasat isu ini, anda boleh menggunakan pertanyaan carian lanjutan Microsoft365Defender untuk mencari 10 peristiwa log masuk terakhir yang dilakukan oleh penerima e-mel dalam masa 30 minit selepas menerima e-mel berniat jahat yang diketahui. Pertanyaan ini membantu mengenal pasti sebarang aktiviti log masuk yang mencurigakan yang mungkin berkaitan dengan bukti kelayakan yang terjejas. ”

Di sini, ChatGPT boleh menyediakan pertanyaan carian Microsoft365Defender untuk menyemak percubaan log masuk untuk akaun e-mel yang terjejas, yang boleh membantu menghalang penyerang daripada memasuki sistem dan menjelaskan sama ada pengguna memerlukan Tukar kata laluan contoh hebat untuk mengurangkan masa untuk bertindak semasa respons insiden rangkaian

Berdasarkan contoh yang sama, anda mungkin mengalami masalah yang sama dan mencari pertanyaan carian Microsoft365Defender , tetapi sistem anda tidak menggunakan bahasa pengaturcaraan KQL Daripada mencari contoh yang betul dalam bahasa yang anda inginkan, "Contoh ini menggambarkan. Model Codex asas ChatGPT boleh mengambil contoh kod sumber dan menjananya dalam bahasa pengaturcaraan lain. Ia juga memudahkan proses untuk pengguna akhir dengan menambahkan butiran utama dalam jawapan yang diberikannya dan metodologi di sebalik ciptaan baharu. ”

Menurut CSA, pembela keselamatan boleh meningkatkan kecekapan dan mempercepatkan masa tindak balas dengan memanfaatkan ChatGPT dan LLM lain untuk mencipta pertanyaan carian ancaman Dengan menyediakan alat penyelidikan dan pengesanan perisian hasad ( As YARA ) menjana pertanyaan, ChatGPT membantu dengan cepat mengenal pasti dan mengurangkan potensi ancaman, membolehkan pembela menumpukan pada aspek kritikal usaha keselamatan siber mereka ini terbukti penting untuk mengekalkan keselamatan yang teguh dalam persekitaran ancaman yang semakin berkembang Peraturan boleh disesuaikan dengan keperluan dan ancaman khusus yang ingin dikesan atau dipantau oleh organisasi dalam persekitarannya. Kecerdasan buatan boleh meningkatkan keselamatan rantaian bekalan

Model AI Generatif boleh menangani risiko keselamatan rantaian bekalan dengan mengenal pasti potensi kelemahan dalam pembekal tahun ini, SecurityScorecard mengumumkan pelancaran platform penarafan keselamatan baharu melalui GPT-4 dengan OpenAI Systems dan carian global bahasa semula jadi disepadukan untuk mencapai ini, menurut syarikat itu, membenarkan pelanggan bertanya soalan terbuka tentang ekosistem perniagaan mereka. termasuk butiran tentang vendor, dan terima jawapan dengan cepat untuk mendorong keputusan pengurusan risiko , "Cari 10 vendor saya yang dinilai paling rendah" atau "Tunjukkan vendor utama saya yang telah terjejas pada tahun lalu" - SecurityScorecard mendakwa soalan ini akan menghasilkan keputusan yang. membolehkan pasukan membuat keputusan pengurusan risiko yang cepat . Teks AI Dijana dalam Serangan Pengesanan Menurut CSA, model bahasa besar bukan sahaja menjana teks tetapi juga bekerja pada pengesanan dan penanda air teks yang dijana AI, yang boleh menjadi ciri umum perisian perlindungan e-mel, CSA berkata mengenal pasti teks yang dijana AI dalam serangan boleh membantu mengesan e-mel pancingan data dan kod polimorfik, dan boleh diandaikan bahawa llm boleh dengan mudah mengesan e-mel atipikal. Alamatkan pengirim atau domainnya yang sepadan, sambil dapat menyemak sama ada pautan asas dalam teks menghala ke tapak web berniat jahat yang diketahui LLM seperti. ChatGPT boleh digunakan untuk menjana dan menghantar kod keselamatan CSA memetik contoh kempen pancingan data yang berjaya menyasarkan beberapa pekerja dalam syarikat, yang berpotensi mendedahkan kelayakan mereka Walaupun diketahui pekerja yang membuka e-mel pancingan data, tidak jelas sama ada mereka secara tidak sengaja melaksanakan kod berniat jahat yang direka untuk mencuri bukti kelayakan mereka Untuk menyiasat isu ini, Microsoft 365 Defender Advanced boleh digunakan untuk mencari 10 peristiwa log masuk terakhir yang dilakukan oleh penerima e-mel dalam masa 30 minit selepas menerima e-mel berniat jahat ini membantu mengenal pasti sebarang aktiviti log masuk yang mencurigakan yang mungkin berkaitan dengan bukti kelayakan yang terjejas." Di sini, ChatGPT boleh menyediakan pertanyaan carian Microsoft365Defender untuk menyemak percubaan log masuk untuk akaun e-mel yang terjejas, yang boleh membantu menghalang penyerang daripada memasuki sistem dan menjelaskan sama ada pengguna perlu menukar kata laluan mereka. Ini adalah contoh yang bagus untuk mengurangkan masa untuk bertindak semasa tindak balas insiden siber.Berdasarkan contoh yang sama, anda mungkin menghadapi masalah yang sama dan mencari pertanyaan carian Microsoft365Defender, tetapi sistem anda tidak menggunakan bahasa pengaturcaraan KQL. Daripada mencari contoh yang betul dalam bahasa yang anda mahukan, anda boleh melakukan peralihan gaya bahasa pengaturcaraan.

" Contoh ini menggambarkan bagaimana model Codex asas ChatGPT boleh mengambil contoh kod sumber dan menjananya dalam bahasa pengaturcaraan lain. Ia juga melakukannya melalui jawapan yang diberikan dan kaedah di sebalik penciptaannya Menambah butiran penting memudahkan proses untuk pengguna akhir "Pemimpin mesti memastikan penggunaan chatbot AI generatif yang selamat, seperti dengan banyak teknologi moden," kata Chaim Mazal, ketua pegawai strategi di Gigamon, dari perspektif risiko, kecerdasan buatan dan bahasa yang besar model boleh menjadi pedang bermata dua, jadi pemimpin mesti memastikan bahawa pasukan mereka menggunakan produk ini dengan selamat dan boleh dipercayai. "Pasukan keselamatan dan undang-undang harus bekerjasama untuk mencari jalan terbaik ke hadapan bagi organisasi mereka untuk memanfaatkan keupayaan teknologi ini tanpa menjejaskan harta intelek atau keselamatan." data berstruktur ketinggalan zaman, jadi ia hanya boleh digunakan sebagai titik permulaan apabila menilai aplikasinya dalam keselamatan dan pertahanan, kata Mo. Sebagai contoh, jika ia digunakan untuk mana-mana faedah di atas, outputnya perlu berasas. Letakkan output di luar talian dan biarkan orang ramai menjadikannya lebih baik, lebih tepat dan lebih boleh diambil tindakan. ”

Dari masa ke masa, chatbots AI generatif/model bahasa besar akhirnya secara semula jadi akan meningkatkan keupayaan keselamatan dan pertahanan, tetapi menggunakan AI/model bahasa besar untuk membantu Daripada merosakkan postur keselamatan siber, ia akan akhirnya datang kepada komunikasi dan tindak balas dalaman "Model AI/bahasa besar boleh menjadi sebahagian daripada membolehkan pihak berkepentingan menangani isu keselamatan secara menyeluruh dengan cara yang lebih pantas dan berkesan," kata Mazal. Pemimpin mesti berkomunikasi bagaimana alat boleh dimanfaatkan untuk menyokong matlamat organisasi sambil mendidik mereka tentang potensi ancaman. ”

Joshua Kaiser, pengarah teknologi kecerdasan buatan dan Ketua Pegawai Eksekutif TovieAI, berkata chatbot kecerdasan buatan juga perlu dikemas kini dengan kerap untuk mengekalkan pertahanan yang berkesan terhadap ancaman, dan pengawasan manusia adalah penting untuk memastikan Adalah penting untuk model bahasa besar berfungsi dengan baik, katanya, “Selain itu, model bahasa besar perlu memahami senario untuk memberikan respons yang tepat dan menangkap sebarang isu keselamatan, dan harus diuji dan dinilai secara berkala untuk mengenal pasti potensi kelemahan atau kelemahan. ”

Atas ialah kandungan terperinci Enam cara untuk membina chatbot AI dan model bahasa yang besar untuk meningkatkan keselamatan siber. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

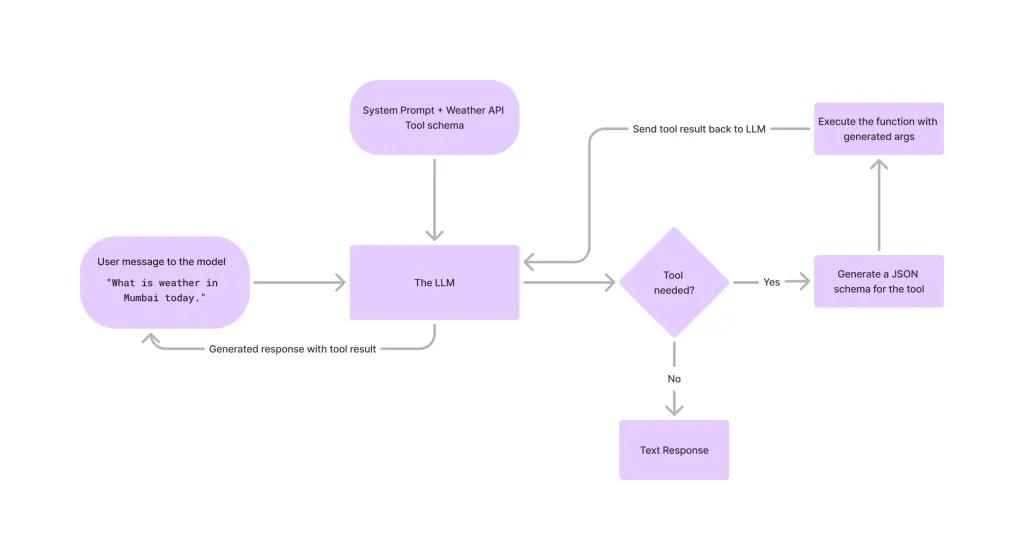

Alat panggilan di LLMSApr 14, 2025 am 11:28 AM

Alat panggilan di LLMSApr 14, 2025 am 11:28 AMModel bahasa yang besar (LLMS) telah melonjak populariti, dengan ciri-ciri alat yang secara dramatik memperluaskan keupayaan mereka di luar penjanaan teks mudah. Sekarang, LLMS dapat mengendalikan tugas automasi yang kompleks seperti penciptaan UI dinamik dan autonomi a

Bagaimana permainan ADHD, alat kesihatan & chatbots AI mengubah kesihatan globalApr 14, 2025 am 11:27 AM

Bagaimana permainan ADHD, alat kesihatan & chatbots AI mengubah kesihatan globalApr 14, 2025 am 11:27 AMBolehkah permainan video meringankan kebimbangan, membina fokus, atau menyokong kanak -kanak dengan ADHD? Memandangkan cabaran penjagaan kesihatan melonjak di seluruh dunia - terutamanya di kalangan belia - inovator beralih kepada alat yang tidak mungkin: permainan video. Sekarang salah satu hiburan terbesar di dunia Indus

Input PBB pada AI: Pemenang, Losers, dan PeluangApr 14, 2025 am 11:25 AM

Input PBB pada AI: Pemenang, Losers, dan PeluangApr 14, 2025 am 11:25 AM"Sejarah telah menunjukkan bahawa walaupun kemajuan teknologi memacu pertumbuhan ekonomi, ia tidak sendiri memastikan pengagihan pendapatan yang saksama atau menggalakkan pembangunan manusia yang inklusif," tulis Rebeca Grynspan, Setiausaha Agung Unctad, dalam Mukadimah.

Kemahiran rundingan pembelajaran melalui AI generatifApr 14, 2025 am 11:23 AM

Kemahiran rundingan pembelajaran melalui AI generatifApr 14, 2025 am 11:23 AMEasy-peasy, gunakan AI Generatif sebagai tutor rundingan dan rakan kongsi sparring anda. Mari kita bercakap mengenainya. Analisis terobosan AI yang inovatif ini adalah sebahagian daripada liputan lajur Forbes yang berterusan pada AI terkini, termasuk mengenal pasti dan menjelaskan

Ted mendedahkan dari Openai, Google, Meta Heads to Court, selfie dengan diri sayaApr 14, 2025 am 11:22 AM

Ted mendedahkan dari Openai, Google, Meta Heads to Court, selfie dengan diri sayaApr 14, 2025 am 11:22 AMPersidangan TED2025, yang diadakan di Vancouver, membungkus edisi ke -36 semalam, 11 April. Ia menampilkan 80 penceramah dari lebih daripada 60 negara, termasuk Sam Altman, Eric Schmidt, dan Palmer Luckey. Tema Ted, "Kemanusiaan Reimagined," telah disesuaikan dibuat

Joseph Stiglitz memberi amaran tentang ketidaksamaan yang menjulang di tengah -tengah kuasa monopoli AIApr 14, 2025 am 11:21 AM

Joseph Stiglitz memberi amaran tentang ketidaksamaan yang menjulang di tengah -tengah kuasa monopoli AIApr 14, 2025 am 11:21 AMJoseph Stiglitz adalah ahli ekonomi yang terkenal dan penerima Hadiah Nobel dalam Ekonomi pada tahun 2001. Stiglitz berpendapat bahawa AI dapat memburukkan lagi ketidaksamaan dan kuasa yang disatukan di tangan beberapa syarikat dominan, akhirnya menjejaskan ekonomi

Apakah pangkalan data graf?Apr 14, 2025 am 11:19 AM

Apakah pangkalan data graf?Apr 14, 2025 am 11:19 AMPangkalan Data Graf: Merevolusi Pengurusan Data Melalui Hubungan Apabila data berkembang dan ciri -cirinya berkembang di pelbagai bidang, pangkalan data grafik muncul sebagai penyelesaian transformatif untuk menguruskan data yang saling berkaitan. Tidak seperti tradisional

LLM Routing: Strategi, Teknik, dan Pelaksanaan PythonApr 14, 2025 am 11:14 AM

LLM Routing: Strategi, Teknik, dan Pelaksanaan PythonApr 14, 2025 am 11:14 AMRouting Model Besar (LLM): Mengoptimumkan Prestasi melalui Pengedaran Tugas Pintar Landskap LLM yang pesat berkembang membentangkan pelbagai model, masing -masing dengan kekuatan dan kelemahan yang unik. Beberapa cemerlang di Gen Kandungan Kreatif

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

SublimeText3 versi Inggeris

Disyorkan: Versi Win, menyokong gesaan kod!

Pelayar Peperiksaan Selamat

Pelayar Peperiksaan Selamat ialah persekitaran pelayar selamat untuk mengambil peperiksaan dalam talian dengan selamat. Perisian ini menukar mana-mana komputer menjadi stesen kerja yang selamat. Ia mengawal akses kepada mana-mana utiliti dan menghalang pelajar daripada menggunakan sumber yang tidak dibenarkan.

ZendStudio 13.5.1 Mac

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver Mac版

Alat pembangunan web visual

Dreamweaver CS6

Alat pembangunan web visual