Rumah >Operasi dan penyelenggaraan >Nginx >Bagaimana untuk menyediakan pelayan Nginx dan Tomcat untuk mencapai pengimbangan beban di bawah Debian

Bagaimana untuk menyediakan pelayan Nginx dan Tomcat untuk mencapai pengimbangan beban di bawah Debian

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-05-13 21:01:041464semak imbas

Konsep asas pengimbangan beban

Pengimbangan beban ialah teknologi rangkaian komputer yang digunakan untuk mengimbangi berbilang komputer (kelompok komputer), sambungan rangkaian, cpu, cakera Mengagihkan beban antara pemacu atau lain-lain sumber untuk mengoptimumkan penggunaan sumber, memaksimumkan daya pengeluaran, meminimumkan masa tindak balas dan mengelakkan beban berlebihan.

Menggunakan berbilang komponen pelayan dengan pengimbangan beban dan bukannya satu komponen boleh meningkatkan kebolehpercayaan melalui lebihan. Perkhidmatan pengimbangan beban biasanya dilakukan oleh perisian dan perkakasan khusus.

Salah satu aplikasi pengimbangan beban yang paling penting ialah menggunakan berbilang pelayan untuk menyediakan satu perkhidmatan Penyelesaian ini kadangkala dipanggil ladang pelayan. Biasanya, pengimbangan beban digunakan terutamanya dalam laman web, rangkaian sembang geganti internet yang besar, tapak web muat turun fail trafik tinggi, perkhidmatan nntp (protokol pemindahan berita rangkaian) dan perkhidmatan dns. Kini pengimbang beban juga mula menyokong perkhidmatan pangkalan data, dipanggil pengimbang beban pangkalan data.

Untuk perkhidmatan Internet, pengimbang beban biasanya merupakan program perisian yang mendengar pada port luaran pengguna Internet boleh mengakses perkhidmatan melalui port ini, dan perisian sebagai pengimbang beban akan memajukan permintaan pengguna pelayan intranet bahagian belakang, pelayan intranet mengembalikan respons yang diminta kepada pengimbang beban, dan pengimbang beban kemudian menghantar respons kepada pengguna Ini menyembunyikan struktur intranet daripada pengguna Internet dan menghalang pengguna daripada mengakses bahagian belakang secara terus (intranet). menjadikan pelayan lebih selamat dan menghalang serangan pada susunan rangkaian teras dan perkhidmatan yang dijalankan pada port lain.

Sesetengah pengimbang beban menyediakan ciri khas untuk mengendalikan keadaan ini apabila semua pelayan bahagian belakang gagal. Contohnya, memajukan permintaan kepada pengimbang beban sandaran, memaparkan mesej tentang gangguan perkhidmatan, dsb. Pengimbang beban membolehkan pasukan IT meningkatkan toleransi kesalahan dengan ketara. Ia secara automatik menyediakan sejumlah besar kapasiti untuk mengendalikan sebarang peningkatan atau penurunan trafik aplikasi.

0. Persediaan awal

Gunakan persekitaran debian. Pasang nginx (pemasangan lalai), projek web, pasang tomcat (pemasangan lalai), dsb.

1. Fail konfigurasi nginx.conf

# 定义nginx运行的用户 和 用户组 如果对应服务器暴露在外面的话建议使用权限较小的用户 防止被入侵

# user www www;

#nginx进程数, 建议设置为等于cpu总核心数

worker_processes 8;

#开启全局错误日志类型

error_log /var/log/nginx/error.log info;

#进程文件

pid /var/run/nginx.pid;

#一个nginx进程打开的最多文件描述数目 建议与ulimit -n一致

#如果面对高并发时 注意修改该值 ulimit -n 还有部分系统参数 而并非这个单独确定

worker_rlimit_nofile 65535;

events{

#使用epoll模型提高性能

use epoll;

#单个进程最大连接数

worker_connections 65535;

}

http{

#扩展名与文件类型映射表

include mime.types;

#默认类型

default_type application/octet-stream;

sendfile on;

tcp_nopush on;

tcp_nodelay on;

keepalive_timeout 65;

types_hash_max_size 2048;

#日志

access_log /var/log/nginx/access.log;

error_log /var/log/nginx/error.log;

#gzip 压缩传输

gzip on;

gzip_min_length 1k; #最小1k

gzip_buffers 16 64k;

gzip_http_version 1.1;

gzip_comp_level 6;

gzip_types text/plain application/x-javascript text/css application/xml application/javascript;

gzip_vary on;

#负载均衡组

#静态服务器组

upstream static.zh-jieli.com {

server 127.0.0.1:808 weight=1;

}

#动态服务器组

upstream zh-jieli.com {

server 127.0.0.1:8080;

#server 192.168.8.203:8080;

}

#配置代理参数

proxy_redirect off;

proxy_set_header host $host;

proxy_set_header x-real-ip $remote_addr;

proxy_set_header x-forwarded-for $proxy_add_x_forwarded_for;

client_max_body_size 10m;

client_body_buffer_size 128k;

proxy_connect_timeout 65;

proxy_send_timeout 65;

proxy_read_timeout 65;

proxy_buffer_size 4k;

proxy_buffers 4 32k;

proxy_busy_buffers_size 64k;

#缓存配置

proxy_cache_key '$host:$server_port$request_uri';

proxy_temp_file_write_size 64k;

proxy_temp_path /dev/shm/jielierp/proxy_temp_path;

proxy_cache_path /dev/shm/jielierp/proxy_cache_path levels=1:2 keys_zone=cache_one:200m inactive=5d max_size=1g;

proxy_ignore_headers x-accel-expires expires cache-control set-cookie;

server{

listen 80;

server_name erp.zh-jieli.com;

location / {

index index; #默认主页为 /index

#proxy_pass http://jieli;

}

location ~ .*\.(js|css|ico|png|jpg|eot|svg|ttf|woff) {

proxy_cache cache_one;

proxy_cache_valid 200 304 302 5d;

proxy_cache_valid any 5d;

proxy_cache_key '$host:$server_port$request_uri';

add_header x-cache '$upstream_cache_status from $host';

proxy_pass http:

//static.zh-jieli.com;

#所有静态文件直接读取硬盘

# root /var/lib/tomcat7/webapps/jielierp/web-inf ;

expires 30d; #缓存30天

}

#其他页面反向代理到tomcat容器

location ~ .*$ {

index index;

proxy_pass http:

//zh-jieli.com;

}

}

server{

listen 808;

server_name static;

location / {

}

location ~ .*\.(js|css|ico|png|jpg|eot|svg|ttf|woff) {

#所有静态文件直接读取硬盘

root /var/lib/tomcat7/webapps/jielierp/web-inf ;

expires 30d; #缓存30天

}

}

}Pada asasnya konfigurasikan fail ini untuk mencapai beban. Tetapi lebih menyusahkan untuk memahami pelbagai hubungan di dalam.

2. Penjelasan asas

Sekarang andaikan terdapat komputer 192.168.8.203, dengan tomcat digunakan padanya, dan terdapat perkhidmatan j2ee pada port 8080, melalui penyemak imbas Anda boleh menyemak imbas web seperti biasa. Sekarang terdapat masalah. Tomcat ialah bekas web yang agak komprehensif Pemprosesan halaman web statik haruslah intensif sumber, terutamanya halaman statik mesti dibaca dari cakera setiap kali dan kemudian dikembalikan. Ini akan menggunakan sumber tomcat dan boleh menjejaskan prestasi penghuraian halaman dinamik tersebut. Berpegang kepada falsafah Linux, prinsip bahawa perisian hanya melakukan satu perkara. Tomcat hanya perlu mengendalikan halaman dinamik jsp. Di sini kami menggunakan nginx yang telah kami pelajari sebelum ini untuk proksi terbalik. Langkah pertama ialah bertindak sebagai proksi untuk memisahkan halaman web dinamik dan statik. Ini sangat mudah.

worker_processes 8;

pid /var/run/nginx.pid;

worker_rlimit_nofile 65535;

events{

use epoll;

worker_connections 65535;

}

http{

include mime.types;

default_type application/octet-stream;

sendfile on;

tcp_nopush on;

tcp_nodelay on;

keepalive_timeout 65;

types_hash_max_size 2048;

proxy_redirect off;

proxy_set_header host $host;

proxy_set_header x-real-ip $remote_addr;

proxy_set_header x-forwarded-for $proxy_add_x_forwarded_for;

client_max_body_size 10m;

client_body_buffer_size 128k;

proxy_connect_timeout 65;

proxy_send_timeout 65;

proxy_read_timeout 65;

proxy_buffer_size 4k;

proxy_buffers 4 32k;

proxy_busy_buffers_size 64k;

server{

listen 80;

server_name xxx.com;

location / {

index index;

}

location ~ .*\.(js|css|ico|png|jpg|eot|svg|ttf|woff) {

proxy_pass http:

//192.168.8.203:8080;

expires 30d;

}

location ~ .*$ {

index index;

proxy_pass http:

//192.168.8.203:8080;

}

}

}

worker_processes 8;

pid /var/run/nginx.pid;

worker_rlimit_nofile 65535;

events{

use epoll;

worker_connections 65535;

}

http{

include mime.types;

default_type application/octet-stream;

sendfile on;

tcp_nopush on;

tcp_nodelay on;

keepalive_timeout 65;

types_hash_max_size 2048;

proxy_redirect off;

proxy_set_header host $host;

proxy_set_header x-real-ip $remote_addr;

proxy_set_header x-forwarded-for $proxy_add_x_forwarded_for;

client_max_body_size 10m;

client_body_buffer_size 128k;

proxy_connect_timeout 65;

proxy_send_timeout 65;

proxy_read_timeout 65;

proxy_buffer_size 4k;

proxy_buffers 4 32k;

proxy_busy_buffers_size 64k;

server{

listen 80;

server_name xxx.com;

location / {

index index;

}

location ~ .*\.(js|css|ico|png|jpg|eot|svg|ttf|woff) {

proxy_pass http:

//192.168.8.203:8080;

expires 30d;

}

location ~ .*$ {

index index;

proxy_pass http:

//192.168.8.203:8080;

}

}

}Ubah suai fail konfigurasi nginx /etc/nginx/nginx.conf. Terdapat fail konfigurasi secara lalai. Malah, kebanyakannya adalah serupa, kuncinya ialah tetapan segmen pelayan. Di sini saya menetapkan segmen pelayan seperti yang ditunjukkan di atas, dan hanya menyalin segmen lain. Penjelasan di bahagian pelayan adalah seperti berikut: Talian 35 mendengar port 80 mesin tempatan. Baris 37-39 mewakili halaman utama lalai Halaman utama lalai di sini ialah index.jsp, yang sepadan dengan indeks dalam projek saya. Di sini anda boleh menukarnya kepada

index index.jsp index.html index.htm index.php

Untuk butiran, sila rujuk artikel lain. Baris utama 40, ini adalah padanan biasa, terdapat banyak pengenalan di Internet. Ini sepadan dengan semua akhiran halaman web statik yang digunakan dalam projek saya. Baris 41 ialah alamat proksi. Di sini saya proksi ke dalam aplikasi web saya. tamat tempoh cache 30 hari ialah 30 hari Cache di sini sepadan dengan halaman hujung hadapan dan medan kawalan cache pengguna

Ungkapan biasa dalam baris 44 ialah. padanan Tiada halaman akhiran. Halaman jsp dalam projek saya tidak mempunyai akhiran. Ini boleh diubah suai mengikut keperluan. Juga proksi kepada 192.168.8.203:8080. Pada ketika ini anda mungkin bertanya, sial, apa gunanya ini? Sudah tentu tidak. Untuk hanya melaksanakan pemisahan statik dan dinamik, kami boleh mengubah suai baris 41 kepada

root /var/lib/tomcat7/webapps/jielierp/web-inf

untuk menunjukkan tiada proksi dan mendapatkannya terus daripada cakera setempat. Dengan menyemak log tomcat, anda boleh melihat bahawa halaman statik tidak diakses. Tetapi ada masalah lain. Fleksibiliti jenis ini tidak baik, dan ia tidak mesra kepada cache memori dan penempatan kelompok yang dibincangkan di bawah, jadi kaedah penulisan berikut digunakan. Tulis segmen pelayan lain.

server{

listen 808;

server_name static;

location / {

}

location ~ .*\.(js|css|ico|png|jpg|eot|svg|ttf|woff) {

#所有静态文件直接读取硬盘

root /var/lib/tomcat7/webapps/jielierp/web-inf ;

expires 30d; #缓存30天

}

}Kali ini, dengarkan port 808, dan kemudian ubah suai baris kod 41 di atas kepada proxy_pass http://192.168.8.203:808 Pada ketika ini, pemisahan dinamik dan statik dicapai. Jika terdapat berbilang pelayan, ubah suai IP yang sepadan. Jika anda mendapati bahawa anda tidak boleh menyambung, anda perlu menyemak firewall, kebenaran dan isu luaran lain Konfigurasi ini adalah seperti ini.

如果单纯这样的话,我们会发现页面直接传输过于占用带宽。对应web的优化,这里想到的是通过对页面进行gzip压缩,然后传到用户那里,再解压,这样可以有效的减少带宽。这里就会用到nginx 的gzip模块了。默认的nginx是集成有gzip模块的。只需在http段增加下面配置即可。

gzip on; gzip_min_length 1k; #最小1k gzip_buffers 16 64k; gzip_http_version 1.1; gzip_comp_level 6; gzip_types text/plain application/x-javascript text/css application/xml application/javascript; gzip_vary on;

给个首页看看效果

不要在意请求数不一样,那两个请求是谷歌插件来的。不用觉得我在骗你。

作为假使有很多人访问的网站来说,缓存肯定是很重要的东西了。一开始是想通过插件,让nginx和redis进行合成,然后nginx使用redis来缓存的,但是发现配置起来很麻烦,还要自己下载插件,重新编译nginx,比较麻烦,所以这里觉得用nginx自带的缓存也是不错的选择。虽然效率比不上redis,但是有还是比没有好。nginx默认的缓存是磁盘文件系统的缓存,而不是像redis那样的内存级别的缓存。一开始我以为nginx就只有这样。后来查了写资料,才知道是我太天真了,对linux不是很了解导致的。linux的一切皆文件。原来我们可以把文件缓存到内存对应的linux文件系统中。我说的可能比较难以理解,请自行搜索/dev/shm 这个文件目录。我们把文件缓存到这个文件目录里,其实就相当与内存的缓存了。只不过还是靠文件系统管理。所以比不上自定义格式的redis那样的内存缓存。

在http段进行基本配置

#缓存配置

proxy_cache_key '$host:$server_port$request_uri';

proxy_temp_file_write_size 64k;

proxy_temp_path /dev/shm/jielierp/proxy_temp_path;

proxy_cache_path /dev/shm/jielierp/proxy_cache_path levels=1:2 keys_zone=cache_one:200m inactive=5d max_size=1g;

proxy_ignore_headers x-accel-expires expires cache-control set-cookie;

location ~ .*\.(js|css|ico|png|jpg|eot|svg|ttf|woff) {

proxy_cache cache_one;

proxy_cache_valid 200 304 302 5d;

proxy_cache_valid any 5d;

proxy_cache_key '$host:$server_port$request_uri';

add_header x-cache '$upstream_cache_status from $host';

proxy_pass http:

//192.168.8.203:808;

expires 30d; #缓存30天

}经过这两个的配置就基本能实现了,这里说几个注意项,也是困扰我很久的问题。上面第一段代码第6行,proxy_ignore_headers 如果web项目中的html的head头里面指定

<meta http-equiv="pragma" content="no-cache"> <meta http-equiv="cache-control" content="no-cache"> <meta http-equiv="expires" content="0">

这些不缓存的话,就要加上proxy_ignore_headers的配置项了。还有一点就是/dev/shm下面的文件系统权限默认只给root用户,所以要chmod 777 -r /dev/shm 这样不是很安全的做法,如果实际上线可以给定某个用户组,关于用户组的设置是配置的第一行

user www www;

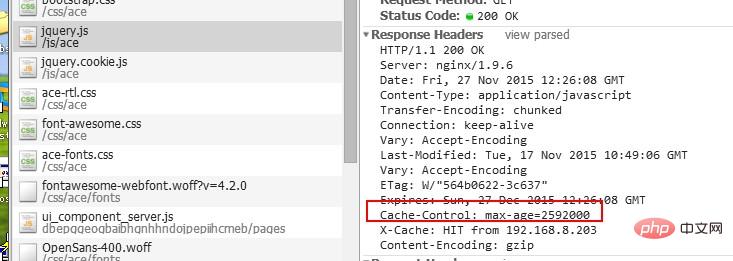

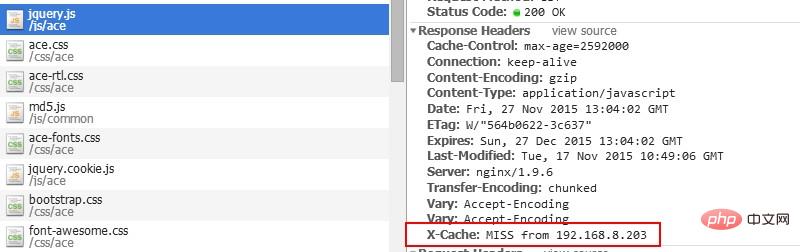

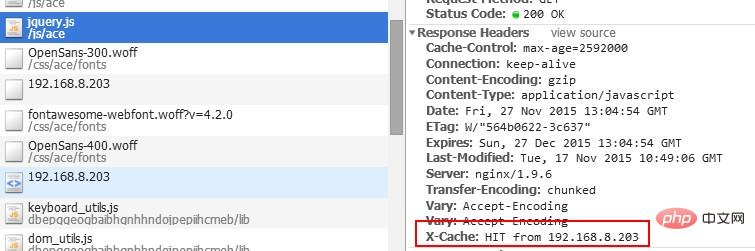

上面第二段代码的第6行是增加一个header字段方便查看是否击中缓存。

我们rm -rf /dev/shm/jielierp/proxy_* 下面的所有文件(注意这里如果是进行多次测试的话要nginx -s reload 重新读取配置或重启服务,因为你rm -rf只是删除了缓存文件,但是缓存的结构信息还在nginx进程里面,结构还在,如果不重启的话,是会出现访问不到的)

所以要记得重启哦。下面是运行效果

第一次访问

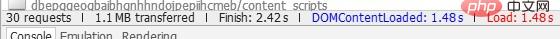

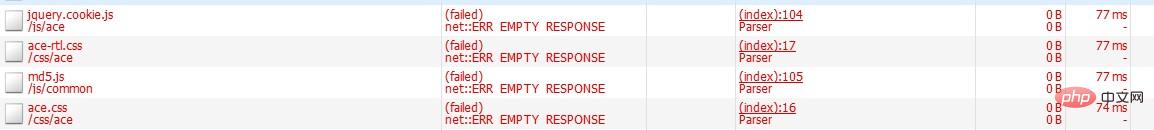

第二次访问,在浏览器中ctrl+shift+r 强制刷新

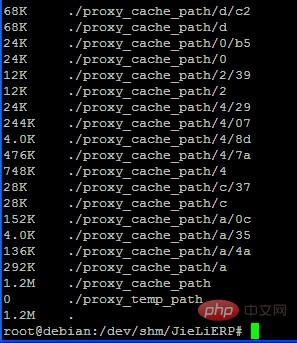

到这里就可以看到效果了。我们查看一下/dev/shm这个里面

到这里已经快结束了。最后也是比较关键的一个技术点,就是集群,集群,集群。这个就要用到upstream了,看到最开头的配置文件了吗,就是那个

#负载均衡组

#静态服务器组

upstream static {

server 127.0.0.1:808 weight=1;

server 192.168.8.203:808 weight=1;

}

#动态服务器组

upstream dynamic {

server 127.0.0.1:8080;

#server 192.168.8.203:8080;

}上面那个就是集群组了。upstream是关键字,static 和 dynamic是两个服务器集群组的名称。以第一个为例,server 127.0.0.1:808 是服务器地址,后面的weight=1 是权重。有多个就写多个。亲测试过,集群中的一个坏了,不影响系统运行。至于更多的轮询规则,可以参考网上更多的资料。这里不多说。至于怎么使用呢? proxy_pass http://192.168.8.203:808 改为 proxy_pass http://static; 这样即可实现均衡。

到这里就结束了。把上面各个部分根据自己需求配置起来就可以实现单机房负载均衡了。 上面这种做法有一个缺点就是在前面的那一台nginx如果当机,后面所以机器就失去了被访问的能力了,所以需要在前面实现多个nginx多机房的负载。关于这个就是另外一个话题了。目前还没有研究。以后有机会再说了。

上面动态服务器组如果是那种需要保存用户状态的话,会有问题,就是session问题,比如我在server1进行登录后,下一次动态服务器组进行轮询后可能分配到server2,就会造成要重新登录。治标的办法是,配置轮询规则,根据用户请求的ip进行hash,然后分配对应的服务器。具体配置如下:

upstream dynamic{

ip_hash;

server 127.0.0.1:8080;

server 192.168.0.203:8080;

}这样就可以实现一个用户对应一个服务器节点。这样就不会有重复登录的问题。另一种治本的办法是,利用缓存系统进行session的统一存储管理。

Atas ialah kandungan terperinci Bagaimana untuk menyediakan pelayan Nginx dan Tomcat untuk mencapai pengimbangan beban di bawah Debian. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!