Rumah >Peranti teknologi >AI >Pembelajaran mesin kuantum melangkaui kaedah kernel, rangka kerja bersatu untuk model pembelajaran kuantum

Pembelajaran mesin kuantum melangkaui kaedah kernel, rangka kerja bersatu untuk model pembelajaran kuantum

- PHPzke hadapan

- 2023-05-06 17:28:091262semak imbas

Algoritma pembelajaran mesin berdasarkan litar kuantum berparameter adalah calon utama untuk aplikasi jangka pendek pada komputer kuantum yang bising. Ke arah ini, pelbagai jenis model pembelajaran mesin kuantum telah diperkenalkan dan dikaji secara meluas. Walau bagaimanapun, pemahaman kami tentang cara model ini dibandingkan antara satu sama lain dan model klasik masih terhad.

Baru-baru ini, pasukan penyelidik dari Universiti Innsbruck, Austria, mengenal pasti rangka kerja membina yang menangkap semua model standard berdasarkan litar kuantum berparameter: model kuantum linear.

Penyelidik menunjukkan cara menggunakan alatan daripada teori maklumat kuantum untuk secara cekap memetakan litar muat naik semula data ke dalam gambaran yang lebih ringkas bagi model linear dalam ruang Hilbert kuantum. Tambahan pula, keperluan sumber yang berkaitan secara eksperimen bagi model ini dianalisis dari segi bilangan qubit dan jumlah data yang perlu dipelajari. Keputusan terkini berdasarkan pembelajaran mesin klasik menunjukkan bahawa model kuantum linear mesti menggunakan lebih banyak qubit daripada model muat naik semula data untuk menyelesaikan tugas pembelajaran tertentu, manakala kaedah kernel juga memerlukan lebih banyak titik data. Hasilnya memberikan pemahaman yang lebih komprehensif tentang model pembelajaran mesin kuantum, serta cerapan tentang keserasian model berbeza dengan kekangan NISQ.

Penyelidikan ini bertajuk "Pembelajaran mesin kuantum di luar kaedah kernel" dan diterbitkan dalam "Komunikasi Alam Semulajadi pada 31 Januari 2023 "superior .

Pautan kertas: https: //www.nature.com/articles/s41467-023-36159-y

Dalam era kuantum peringkat pertengahan (NISQ) yang bising semasa, ia telah dicadangkan Beberapa cara untuk membina algoritma kuantum berguna yang serasi dengan sedikit kekangan perkakasan. Kebanyakan kaedah ini melibatkan spesifikasi litar kuantum Ansatz, dioptimumkan dengan cara klasik untuk menyelesaikan tugas pengiraan tertentu. Selain penyelesai tandatangan kuantum variasi dan varian algoritma pengoptimuman anggaran kuantum dalam kimia, kaedah pembelajaran mesin berdasarkan litar kuantum berparameter tersebut merupakan salah satu aplikasi praktikal yang paling menjanjikan untuk menjana kelebihan kuantum.

Kaedah kernel ialah sejenis algoritma pengecaman corak. Tujuannya adalah untuk mencari dan mempelajari hubungan bersama dalam satu set data. Kaedah kernel ialah cara yang berkesan untuk menyelesaikan masalah analisis corak bukan linear. Idea terasnya ialah: pertama, benamkan data asal ke dalam ruang ciri berdimensi tinggi yang sesuai melalui beberapa pemetaan bukan linear kemudian, gunakan pelajar linear umum untuk analisis mod baharu dan pemprosesan di angkasa.

Kerja terdahulu telah mencapai kemajuan besar ke arah ini dengan mengeksploitasi hubungan antara beberapa model kuantum dan kaedah kernel pembelajaran mesin klasik. Banyak model kuantum sememangnya beroperasi dengan mengekod data dalam ruang Hilbert berdimensi tinggi dan memodelkan sifat data menggunakan hanya produk dalaman yang dinilai dalam ruang ciri ini. Ini juga cara kaedah nuklear berfungsi.

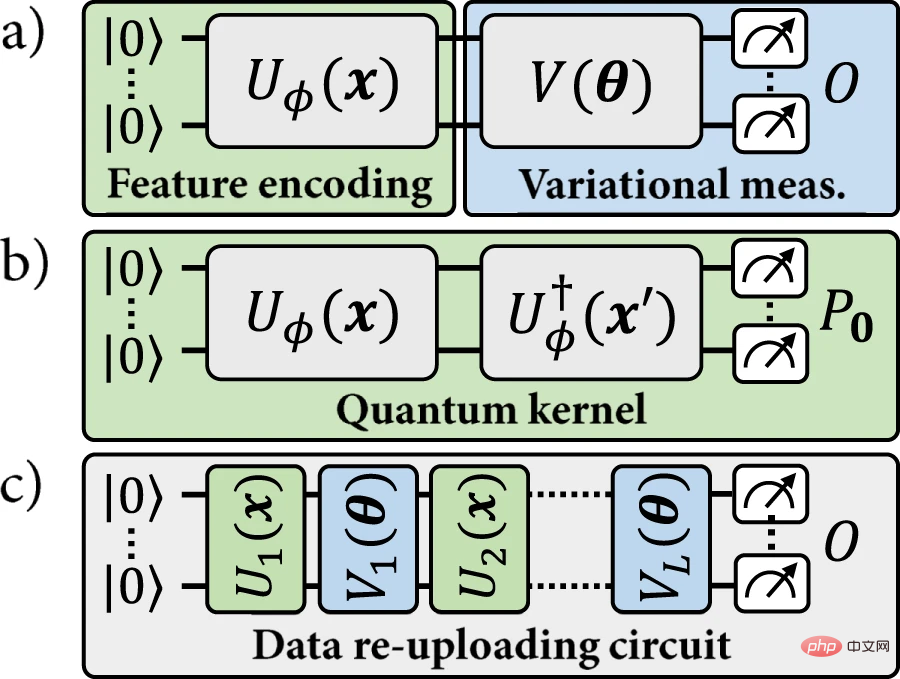

Berdasarkan persamaan ini, pengekodan kuantum yang diberikan boleh digunakan untuk mentakrifkan dua jenis model: (a) Model kuantum eksplisit, di mana titik data dikodkan mengikut pembolehubah yang menentukan labelnya Pengukuran dibuat pada pemerhatian yang berasingan; atau (b) model kernel tersirat, di mana produk dalaman berwajaran titik data yang dikodkan digunakan untuk menetapkan label. Dalam literatur pembelajaran mesin kuantum, banyak penekanan diberikan pada model tersirat.

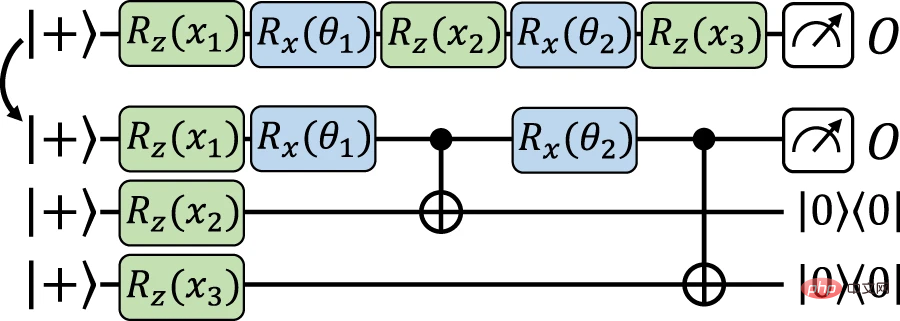

Rajah 1: Model pembelajaran mesin kuantum yang dikaji dalam kerja ini. (Sumber: Kertas)

Baru-baru ini, terdapat kemajuan dalam apa yang dipanggil model muat naik semula data. Model muat naik semula data boleh dilihat sebagai generalisasi model eksplisit. Walau bagaimanapun, generalisasi ini juga memecahkan korespondensi dengan model tersirat, kerana titik data x yang diberikan tidak lagi sepadan dengan titik pengekodan tetap ρ(x). Model muat naik semula data adalah lebih umum daripada model eksplisit dan ia tidak serasi dengan paradigma model kernel. Setakat ini, ia masih menjadi persoalan terbuka sama ada beberapa kelebihan boleh diperoleh daripada model muat naik semula data dengan jaminan kaedah kernel.

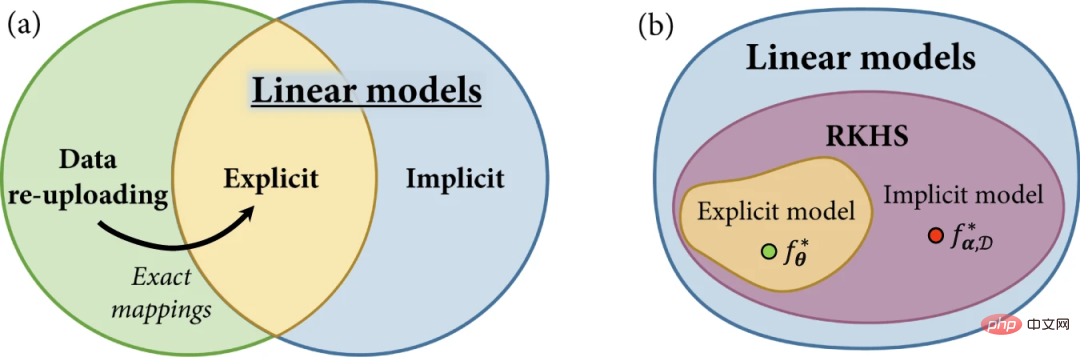

Dalam kerja ini, penyelidik memperkenalkan rangka kerja bersatu untuk model kuantum muat naik semula yang eksplisit, tersirat dan data.

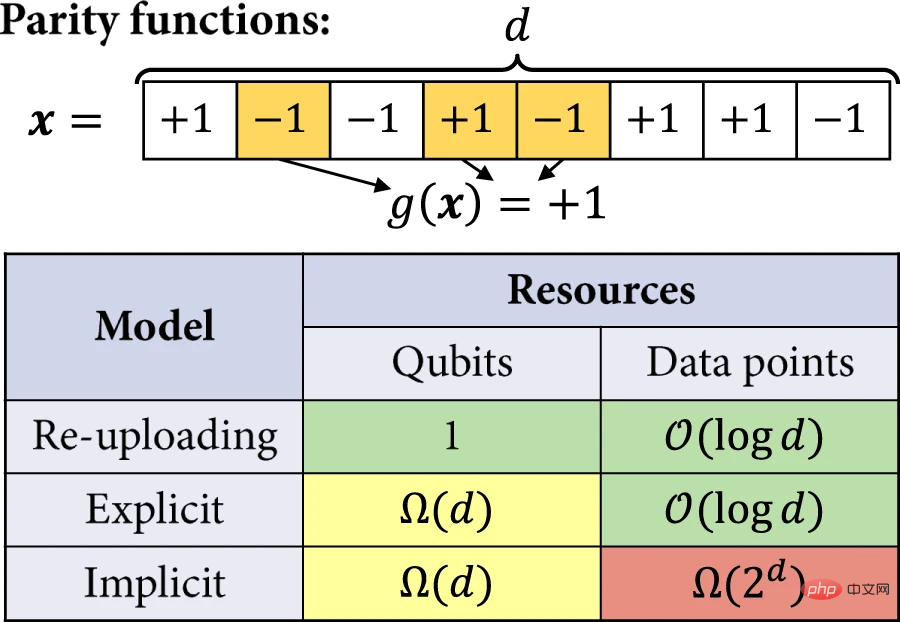

Rajah 2: Model keluarga dalam pembelajaran mesin kuantum. (Sumber: Kertas)

Rangka kerja bersatu untuk model pembelajaran kuantum

Mula-mula semak semula konsep model kuantum linear dan takrifkan model linear dari segi ciri kuantum ruang Terangkan model tersurat dan tersirat. Kemudian, model muat naik semula data dibentangkan dan ditunjukkan bahawa walaupun ditakrifkan sebagai generalisasi model eksplisit, ia juga boleh dilaksanakan oleh model linear dalam ruang Hilbert yang lebih besar.

Model Kuantum Linear

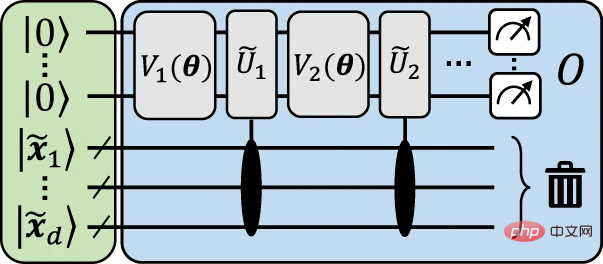

Rajah di bawah memberikan struktur ilustrasi untuk menggambarkan secara visual cara melaksanakan pemetaan daripada muat naik semula data kepada model eksplisit.

Rajah 3: Model eksplisit ilustrasi yang menghampiri litar muat naik semula data. (Sumber: kertas)

Idea umum di sebalik struktur ini adalah untuk mengekod data input x ke dalam qubit tambahan kepada ketepatan terhingga, yang kemudiannya boleh digunakan semula menggunakan Bebas Data unitaries digunakan untuk menganggarkan gerbang pengekodan data.

Kini beralih ke struktur utama, menghasilkan muat naik semula data dan pemetaan tepat antara model eksplisit. Di sini, bergantung pada idea yang serupa dengan struktur sebelumnya, data input dikodkan pada qubit tambahan, dan kemudian gerbang pengekodan dilaksanakan pada qubit yang berfungsi menggunakan operasi bebas data. Perbezaan di sini ialah menggunakan teleportasi gerbang, sejenis pengkomputeran kuantum berasaskan pengukuran, untuk melaksanakan gerbang pengekodan terus pada qubit tambahan dan teleportkannya kembali (melalui ukuran belitan) ke qubit yang berfungsi apabila diperlukan lebih tinggi.

Rajah 4: Menggunakan teleportasi berpagar untuk memuat naik semula model daripada data kepada model eksplisit yang setara Pemetaan yang tepat. (Sumber: kertas)

Penyelidik menunjukkan bahawa model kuantum linear boleh menerangkan bukan sahaja model eksplisit dan tersirat, tetapi juga litar muat naik semula data. Lebih khusus lagi, mana-mana kelas hipotesis model muat naik semula data boleh dipetakan kepada kelas model eksplisit yang setara, iaitu, model linear dengan keluarga terhad yang boleh diperhatikan.

Seterusnya, penyelidik menganalisis dengan lebih teliti kelebihan model muat naik semula data dan eksplisit berbanding model tersirat. Dalam contoh, kecekapan model kuantum dalam menyelesaikan tugas pembelajaran dikira dengan bilangan qubit dan saiz set latihan yang diperlukan untuk mencapai kerugian jangkaan bukan remeh. Tugas pembelajaran yang diminati ialah mempelajari fungsi ganjil dan genap.

Rajah 5: Belajar memisahkan. (Sumber: kertas)

Kelebihan kuantum melangkaui kaedah nuklear

Cabaran utama dalam pembelajaran mesin kuantum adalah untuk menunjukkan bahawa kaedah kuantum yang dibincangkan dalam Pembelajaran karya ini kelebihan berbanding kaedah klasik (standard) boleh dicapai.

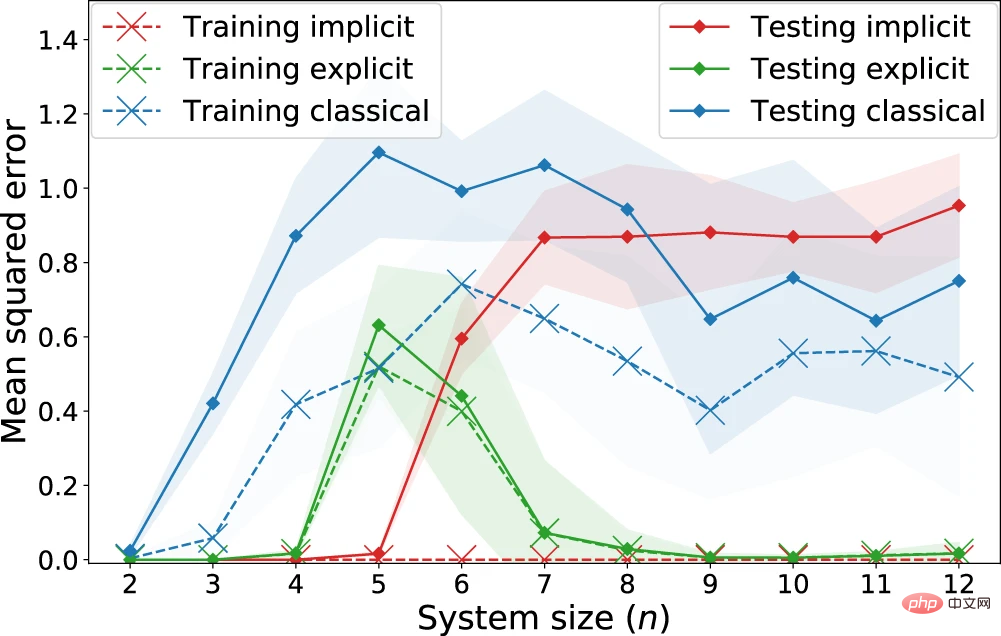

Dalam penyelidikan ini, Huang et al dari Google Quantum Artificial Intelligence ( ( Eksplisit. ) tugasan pembelajaran untuk penjanaan model kuantum. Sama seperti Huang et al., penyelidik melakukan tugas regresi menggunakan data input daripada set data fesyen-MNIST, di mana setiap contoh ialah imej skala kelabu 28x28.

Rajah 6: Model eksplisit, tersirat dan klasik pada tugas pembelajaran "penyesuaian kuantum" Kembali ke prestasi . (Sumber: kertas)

Diperhatikan: Model tersirat secara sistematik mencapai kerugian latihan yang lebih rendah daripada model eksplisit. Khususnya untuk kerugian tidak teratur, model tersirat mencapai kehilangan latihan sebanyak 0. Sebaliknya, mengenai kerugian ujian yang mewakili kerugian yang dijangkakan, terdapat pemisahan yang jelas bermula dari n = 7 qubit, di mana model klasik mula mempunyai prestasi kompetitif dengan model tersirat, manakala model eksplisit jelas mengatasi kedua-duanya. . Ini menunjukkan bahawa kehadiran kelebihan kuantum tidak seharusnya dinilai semata-mata dengan membandingkan model klasik dengan kaedah kernel kuantum, kerana model eksplisit (atau muat naik semula data) juga boleh menyembunyikan prestasi pembelajaran yang lebih baik.

Hasil ini memberi kami pemahaman yang lebih komprehensif tentang bidang pembelajaran mesin kuantum dan meluaskan pandangan kami tentang jenis model untuk mencapai kelebihan pembelajaran praktikal dalam mekanisme NISQ.

Para penyelidik percaya bahawa tugas pembelajaran untuk membuktikan kewujudan pemisahan pembelajaran eksponen antara model kuantum yang berbeza adalah berdasarkan fungsi ganjil dan genap, yang bukan kelas konseptual minat praktikal dalam mesin pembelajaran. Walau bagaimanapun, hasil sempadan bawah juga boleh diperluaskan kepada tugas pembelajaran lain dengan kelas konsep berdimensi besar (iaitu, terdiri daripada banyak fungsi ortogon).

Kaedah kernel kuantum semestinya memerlukan banyak titik data yang berskala secara linear dengan dimensi ini, dan seperti yang kami tunjukkan dalam keputusan kami, fleksibiliti litar muat naik semula data dan model eksplisit Ekspresi terhad keupayaan untuk menjimatkan banyak sumber. Meneroka bagaimana dan bila model ini boleh disesuaikan dengan tugasan pembelajaran mesin di tangan kekal sebagai hala tuju penyelidikan yang menarik.

Atas ialah kandungan terperinci Pembelajaran mesin kuantum melangkaui kaedah kernel, rangka kerja bersatu untuk model pembelajaran kuantum. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI