Rumah >Peranti teknologi >AI >Gunakan AI untuk memerangi pahlawan papan kekunci dan troll internet, dan melindungi nyawa mereka yang dibuli dalam talian

Gunakan AI untuk memerangi pahlawan papan kekunci dan troll internet, dan melindungi nyawa mereka yang dibuli dalam talian

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-05-06 16:55:091213semak imbas

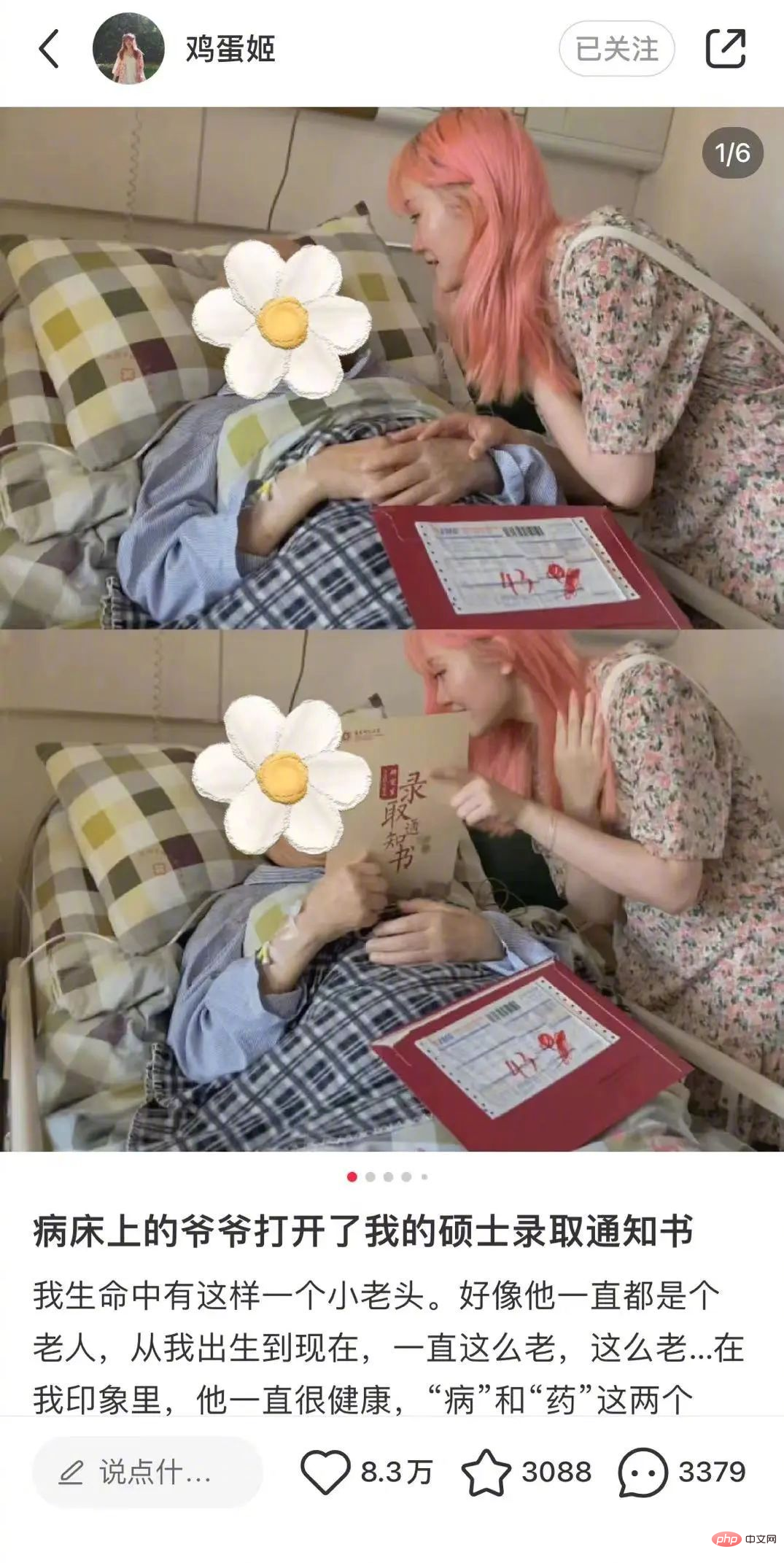

Seorang gadis yang dilahirkan pada tahun 1995 membunuh diri kerana dia menyiarkan catatan blog dalam talian.

Selepas siaran blog yang menyentuh hati ini, protagonis Zheng Linghua menemui banyak khabar angin dan penderaan.

Sesetengah orang mempersoalkan identitinya dan menyebarkan khabar angin bahawa dia adalah "pembantu bar" hanya kerana rambutnya berwarna merah jambu ada yang menyebarkan khabar angin bahawa dia adalah "cinta muda dan tua" dan " cha-flow" , seorang "pembohong" yang menyebarkan khabar angin bahawa dia mengambil kesempatan daripada penyakit datuknya untuk mencari wang.

Ini sangat tidak sedap dipandang. Walaupun banyak media menyangkal khabar angin itu, Zheng Linghua tidak menerima permohonan maaf Walaupun Zheng Linghua menggunakan senjata undang-undang untuk mempertahankan haknya, dia masih diganggu.

Akhirnya, Zheng Linghua mengalami kemurungan dan menamatkan hidupnya tidak lama dahulu.

Perkara sebegini sudah berkali-kali berlaku di Internet "kata-kata yang mengerikan" yang meresap ke dalam dunia online bukan sahaja membuat orang berasa jijik, malah boleh meragut nyawa orang juga istilah khas untuk tingkah laku ini - keganasan siber, atau singkatannya "keganasan siber".

Jadi hari ini, apabila AI sudah boleh berkomunikasi dengan manusia dengan lancar, adakah AI boleh memainkan peranan dalam mengenal pasti kekejaman siber?

Mengatasi dua kesukaran utama, kadar ketepatan mengenal pasti komen ganas dalam talian melebihi 90%

Walaupun kebanyakan platform Internet telah melancarkan beberapa pengiktirafan khas kaedah Sistem pertuturan, tetapi kebanyakan sistem ini hanya mengesan dan memadam kata kunci, yang jelas tidak cukup bijak Anda boleh memintas sekatan ini dengan sedikit perhatian.

Malah, untuk mengenal pasti kenyataan ganas dalam talian dengan tepat, dua perkara perlu dilakukan:

- Bagaimanakah cara mengenal pasti kenyataan ganas dalam talian dengan tepat berdasarkan konteks?

- Bagaimana untuk mengenal pasti komen ganas dalam talian dengan berkesan?

Perkara pertama yang perlu diberi perhatian ialah kandungan kenyataan keganasan siber, kerana kebanyakan surat dan mesej di Internet dibahagikan, dan keganasan siber sering berlaku dalam perbualan ia menjadi serius dan akhirnya membawa kepada akibat negatif.

Perkara kedua yang membimbangkan ialah kelajuan Lagipun, dalam persekitaran Internet, terdapat terlalu banyak data untuk diproses Jika pengesanan mengambil masa yang lama, maka sistem ini akan mempunyai tiada nilai praktikal dan tidak akan diterima pakai.

Sepasukan penyelidik di UK telah membangunkan model kecerdasan buatan baharu yang dipanggil BiCapsHate yang mengatasi hasil penyelidikan ini dua cabaran telah diterbitkan dalam makalah dalam "Transaksi IEEE pada Sistem Sosial Pengiraan" pada 19 Januari.

Model ini terdiri daripada lima lapisan rangkaian neural dalam, yang bermula dengan lapisan input, memproses teks input, dan kemudian ke Lapisan pembenaman membenamkan teks ke dalam perwakilan berangka, kemudian lapisan BiCaps mempelajari perwakilan konteks berurutan dan linguistik, lapisan padat menyediakan model untuk pengelasan akhir, dan akhirnya lapisan output mengeluarkan hasil.

Lapisan BiCaps ialah komponen yang paling penting dengan berkesan memperoleh maklumat kontekstual dalam arah yang berbeza sebelum dan selepas teks input melalui rangkaian kapsul. Jadikan model anda lebih bermaklumat terima kasih kepada banyak fungsi tambahan cetek dan mendalam yang ditala tangan (termasuk kamus Hatebase). Para penyelidik menjalankan eksperimen yang meluas pada lima set data penanda aras untuk menunjukkan keberkesanan model BiCapsHate yang dicadangkan. Keputusan keseluruhan menunjukkan bahawa BiCapsHate mengatasi kaedah terkini yang sedia ada, termasuk fBERT, HateBERT dan ToxicBERT.

Pada set data seimbang dan tidak seimbang, BiCapsHate masing-masing mencapai 94% dan 92% ketepatan skor-f.

Pantas dan boleh berjalan pada GPU

Tarique Anwar ialah pensyarah di Jabatan Sains Komputer di University of York, Beliau menyertai penyelidikan ini. Beliau menyatakan bahawa perdebatan dalam talian sering mengakibatkan komen trolling negatif, penuh kebencian dan kesat, yang tidak boleh dikawal oleh amalan penyederhanaan kandungan sedia ada di platform media sosial.

Beliau berkata: "Selain itu, ucapan kebencian dalam talian kadangkala mencerminkan persekitaran sebenar, membawa kepada jenayah dan keganasan, Tariq Anwar juga berkata bahawa ucapan kebencian dalam talian membawa kepada keganasan fizikal kejadian rusuhan.

Untuk membantu menyelesaikan masalah ini, pasukan Tariq Anwar memutuskan untuk membangunkan BiCapsHate, dan ia berkesan dengan sangat baik.

Seperti yang dinyatakan oleh Anwar, bahasa boleh menjadi samar-samar dalam beberapa kes, iaitu sesuatu perkataan boleh menjadi positif dalam satu konteks dan negatif dalam konteks lain. Model terdahulu tidak cukup baik dalam hal ini, seperti HateBERT, toxicBERT dan fBERT ini boleh menangkap konteks pada tahap tertentu, tetapi Tariq Anwar percaya bahawa "ini masih tidak cukup baik."

Satu lagi kelebihan BiCapsHate ialah keupayaan model untuk melakukan pengiraan menggunakan sumber perkakasan yang terhad. "[Model lain] memerlukan sumber perkakasan mewah seperti GPU, dan sistem canggih untuk pengkomputeran," jelas Tariq Anwar. "Sebaliknya, BiCapsHate... boleh dilaksanakan pada mesin CPU, walaupun anda hanya mempunyai 8GB RAM." dan diuji setakat ini , hanya direka untuk menganalisis pertuturan bahasa Inggeris, jadi ia perlu disesuaikan ke dalam bahasa lain. Ia juga kurang pandai melihat perkataan yang menyinggung dengan nada kebencian yang lembut atau halus daripada ucapan kebencian yang lebih sengit.

Para penyelidik berharap untuk meneroka cara seterusnya untuk menilai kesihatan mental pengguna yang meluahkan kebencian dalam talian. Jika seseorang bimbang bahawa orang itu tidak stabil dari segi mental dan mungkin ganas secara fizikal terhadap orang di dunia nyata, campur tangan awal boleh dipertimbangkan untuk mengurangkan kemungkinan perkara ini berlaku.

Atas ialah kandungan terperinci Gunakan AI untuk memerangi pahlawan papan kekunci dan troll internet, dan melindungi nyawa mereka yang dibuli dalam talian. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI