Mempraktikkan Penggunaan AI Bertanggungjawab: Empat Prinsip

Kecerdasan Buatan (AI) sedang mengubah setiap industri, dengan lebih daripada satu pertiga organisasi kini menghasilkan AI secara meluas atau secara terhad. Tetapi seperti mana-mana teknologi, AI datang dengan risiko ekonomi dan sosial yang ketara, seperti penyebaran berat sebelah tidak beretika, pencairan akauntabiliti dan pelanggaran privasi data.

Untuk mengelakkan risiko ini dan menggunakan AI secara bertanggungjawab, kedua-dua dasar kawal selia dan industri mempunyai tanggungjawab untuk membangunkan proses dan piawaian untuk pengamal dan pengguna yang bekerja di sekitar teknologi. Untuk tujuan itu, pasukan di Ethical AI dan ML Institute telah menyusun Prinsip AI Bertanggungjawab untuk memperkasakan pengamal untuk memastikan prinsip ini dibenamkan melalui reka bentuk ke dalam infrastruktur dan proses yang mengelilingi pengeluaran AI dan sistem pembelajaran mesin.

Artikel ini memecahkan empat daripada lapan prinsip: penilaian berat sebelah, kebolehjelasan, peningkatan buatan dan kebolehulangan.

Penilaian Bias

Model AI sememangnya berat sebelah dalam erti kata ia direka bentuk untuk menangani jawapan yang berkaitan secara berbeza. Itu kerana kecerdasan, pada terasnya, adalah keupayaan untuk mengenali dan bertindak mengikut corak yang kita lihat di dunia. Apabila membangunkan model AI, kami cuba meniru keupayaan tepat ini dan menggalakkan AI untuk menemui corak dalam data yang dimasukkan ke dalamnya dan membangunkan berat sebelah dengan sewajarnya. Sebagai contoh, model yang mengkaji data kimia protein akan mempunyai kecenderungan yang wujud terhadap protein yang strukturnya boleh dilipat dengan cara tertentu, dengan itu menemui protein mana yang berguna dalam kes penggunaan yang berkaitan dalam perubatan.

Oleh itu, kita harus berhati-hati apabila bersuara menentang kecenderungan AI. Apabila bercakap tentang topik berat sebelah dalam AI, kami biasanya merujuk kepada berat sebelah yang sebenarnya tidak diingini atau tidak munasabah, seperti berat sebelah berdasarkan ciri yang dilindungi seperti bangsa, jantina atau asal negara.

Tetapi mengapa model AI menghasilkan berat sebelah yang tidak beretika? Jawapannya bergantung pada data yang dimasukkan ke dalamnya. Model akhirnya akan mencerminkan bias yang terdapat dalam data latihan yang digunakan sebelum penggunaan, jadi jika data latihan tidak mewakili atau menggabungkan bias yang sedia ada, model yang terhasil akhirnya akan mencerminkannya. Seperti yang mereka katakan dalam sains komputer, "sampah masuk, sampah keluar."

Pasukan juga mesti mencipta satu set proses dan prosedur untuk mengenal pasti dengan betul sebarang berat sebelah yang tidak diingini di sekitar keberkesanan data latihan AI, latihan dan penilaian model itu sendiri, dan kitaran hayat operasi model itu sendiri . Jika anda menggunakan AI, contoh yang baik untuk dilihat ialah AI Etika dan rangka kerja AI Boleh Diterangkan Institut Pembelajaran Mesin, yang akan kami bincangkan dengan lebih terperinci seterusnya.

Kebolehtafsiran

Untuk memastikan model AI sesuai untuk tujuan, penyertaan pakar dalam bidang yang berkaitan juga penting. Orang ini boleh membantu pasukan memastikan model AI menggunakan metrik prestasi yang betul, bukan hanya statistik dan metrik prestasi terdorong ketepatan. Perlu ditekankan bahawa pakar domain termasuk bukan sahaja pakar teknikal, tetapi juga pakar dalam sains sosial dan kemanusiaan yang berkaitan dengan kes penggunaan.

Walau bagaimanapun, agar ia berguna, adalah penting juga untuk memastikan ramalan model boleh ditafsirkan oleh pakar domain yang berkaitan. Walau bagaimanapun, model AI lanjutan sering menggunakan teknik pembelajaran mendalam yang terkini, yang mungkin tidak hanya menjelaskan sebab ramalan tertentu dibuat.

Untuk mengatasi kesukaran ini, organisasi cenderung untuk mencapai kebolehtafsiran pembelajaran mesin dengan memanfaatkan pelbagai teknik dan alatan yang boleh digunakan untuk menguraikan ramalan model AI.

Selepas kebolehtafsiran datang pengoperasian model kecerdasan buatan. Inilah masanya untuk penyiasatan dan pemantauan oleh pihak berkepentingan yang berkaitan. Kitaran hayat model AI sedemikian hanya bermula selepas ia digunakan dengan betul untuk pengeluaran. Setelah siap dan berjalan, model hanya mengalami kemerosotan prestasi disebabkan oleh tekanan luaran, sama ada hanyutan konsep atau perubahan dalam persekitaran di mana model dijalankan.

Pembesaran Manusia

Apabila menggunakan AI, adalah penting untuk menilai dahulu keperluan semasa proses asal bukan automatik, termasuk menggariskan risiko hasil yang tidak diingini. Ini akan membolehkan pemahaman yang lebih mendalam tentang proses dan membantu mengenal pasti kawasan yang mungkin memerlukan campur tangan manusia untuk mengurangkan risiko.

Sebagai contoh, AI yang mengesyorkan pelan makan kepada atlet profesional mempunyai faktor risiko berimpak tinggi yang jauh lebih sedikit berbanding model AI yang mengautomasikan proses kelulusan pinjaman bahagian belakang untuk bank, yang menunjukkan keperluan untuk campur tangan manusia dalam yang pertama lebih kecil daripada yang kedua. Apabila pasukan mengenal pasti titik risiko yang berpotensi dalam aliran kerja AI, mereka boleh mempertimbangkan untuk melaksanakan proses semakan Gelung Manusia-Mesin (HITL).

HITL memastikan bahawa selepas proses diautomasikan, masih terdapat pelbagai titik sentuh di mana campur tangan manusia diperlukan untuk menyemak keputusan, menjadikannya lebih mudah untuk memberikan pembetulan atau membalikkan keputusan apabila perlu. Proses ini boleh termasuk sekumpulan pakar teknikal dan pakar industri (contohnya, penaja jamin untuk pinjaman bank, atau pakar pemakanan untuk perancangan makanan) untuk menilai keputusan yang dibuat oleh model AI dan memastikan bahawa mereka mematuhi amalan terbaik.

Kebolehulangan

Kebolehulangan ialah keupayaan pasukan untuk menjalankan algoritma berulang kali pada titik data dan mendapat hasil yang sama setiap kali. Ini adalah komponen teras AI yang bertanggungjawab, kerana ia penting untuk memastikan ramalan model sebelumnya diterbitkan semula apabila ditayangkan semula pada peringkat seterusnya.

Sememangnya, kebolehulangan sukar dicapai, terutamanya disebabkan oleh kesukaran yang wujud dalam sistem kecerdasan buatan. Ini kerana output model AI boleh berbeza-beza bergantung pada pelbagai situasi latar belakang, seperti:

- Kod yang digunakan untuk mengira gangguan AI

- Berat yang dipelajari daripada data yang digunakan

- Persekitaran, infrastruktur dan konfigurasi untuk menjalankan kod

- Input dan struktur input yang disediakan kepada model

Ini adalah isu yang rumit, terutamanya apabila model AI Apabila digunakan pada skala dan banyak alat dan rangka kerja lain perlu dipertimbangkan. Untuk melakukan ini, pasukan perlu membangunkan amalan yang mantap untuk membantu mengawal situasi di atas dan melaksanakan alat untuk membantu meningkatkan kebolehulangan.

Pengambilan Utama

Dengan prinsip peringkat tinggi di atas, industri boleh memastikan mereka mengikuti amalan terbaik untuk penggunaan AI yang bertanggungjawab. Mengguna pakai prinsip sedemikian adalah penting untuk memastikan AI mencapai potensi ekonomi sepenuhnya dan tidak melemahkan kumpulan yang terdedah, mengukuhkan berat sebelah tidak beretika, atau menjejaskan akauntabiliti. Sebaliknya, ia boleh menjadi teknologi yang boleh kita gunakan untuk memacu pertumbuhan, produktiviti, kecekapan, inovasi dan kebaikan yang lebih besar untuk semua.

Atas ialah kandungan terperinci Mempraktikkan Penggunaan AI Bertanggungjawab: Empat Prinsip. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Penyusunan Tahunan Terkini Teknik Kejuruteraan TerbaikApr 10, 2025 am 11:22 AM

Penyusunan Tahunan Terkini Teknik Kejuruteraan TerbaikApr 10, 2025 am 11:22 AMBagi anda yang mungkin baru dalam lajur saya, saya secara meluas meneroka kemajuan terkini di AI di seluruh papan, termasuk topik seperti yang terkandung AI, penaakulan AI, terobosan berteknologi tinggi di AI, kejuruteraan segera, latihan AI, Fielding of AI, AI Re Re,

Pelan Tindakan Benua AI Eropah: Gigafactories, Lab Data, dan Green AIApr 10, 2025 am 11:21 AM

Pelan Tindakan Benua AI Eropah: Gigafactories, Lab Data, dan Green AIApr 10, 2025 am 11:21 AMPelan Tindakan Benua AI yang bercita -cita tinggi Eropah bertujuan untuk mewujudkan EU sebagai pemimpin global dalam kecerdasan buatan. Unsur utama ialah penciptaan rangkaian AI Gigafactories, setiap perumahan sekitar 100,000 cip AI maju - empat kali kapasiti

Adakah cerita ejen Microsoft cukup untuk mencipta lebih banyak peminat?Apr 10, 2025 am 11:20 AM

Adakah cerita ejen Microsoft cukup untuk mencipta lebih banyak peminat?Apr 10, 2025 am 11:20 AMPendekatan Bersatu Microsoft ke Aplikasi Ejen AI: Kemenangan yang jelas untuk Perniagaan Pengumuman baru -baru ini Microsoft mengenai keupayaan ejen AI baru terkesan dengan persembahan yang jelas dan bersatu. Tidak seperti banyak pengumuman teknologi yang terjatuh di TE

Menjual Strategi AI kepada Pekerja: Manifesto CEO ShopifyApr 10, 2025 am 11:19 AM

Menjual Strategi AI kepada Pekerja: Manifesto CEO ShopifyApr 10, 2025 am 11:19 AMMemo CEO Shopify Tobi Lütke baru -baru ini dengan berani mengisytiharkan penguasaan AI sebagai harapan asas bagi setiap pekerja, menandakan peralihan budaya yang signifikan dalam syarikat. Ini bukan trend seketika; Ini adalah paradigma operasi baru yang disatukan ke p

IBM melancarkan kerangka utama Z17 dengan integrasi AI penuhApr 10, 2025 am 11:18 AM

IBM melancarkan kerangka utama Z17 dengan integrasi AI penuhApr 10, 2025 am 11:18 AMKerangka utama Z17 IBM: Mengintegrasikan AI untuk operasi perniagaan yang dipertingkatkan Bulan lalu, di ibu pejabat New York IBM, saya menerima pratonton keupayaan Z17. Membina kejayaan Z16 (dilancarkan pada tahun 2022 dan menunjukkan pendapatan yang berterusan berkembang

5 chatgpt meminta berhenti bergantung kepada orang lain dan mempercayai diri anda sepenuhnyaApr 10, 2025 am 11:17 AM

5 chatgpt meminta berhenti bergantung kepada orang lain dan mempercayai diri anda sepenuhnyaApr 10, 2025 am 11:17 AMBuka kunci keyakinan yang tidak dapat disangkal dan menghapuskan keperluan untuk pengesahan luaran! Lima chatgpt ini akan membimbing anda ke arah kepercayaan diri yang lengkap dan peralihan transformatif dalam persepsi diri. Cukup salin, tampal, dan sesuaikan dengan pendahuluan

AI berbahaya sama dengan fikiran andaApr 10, 2025 am 11:16 AM

AI berbahaya sama dengan fikiran andaApr 10, 2025 am 11:16 AMKajian baru -baru ini oleh Anthropic, sebuah syarikat keselamatan dan penyelidikan kecerdasan buatan, mula mendedahkan kebenaran tentang proses -proses yang kompleks ini, menunjukkan kerumitan yang mengganggu sama dengan domain kognitif kita sendiri. Kecerdasan semulajadi dan kecerdasan buatan mungkin lebih serupa daripada yang kita fikirkan. Mengintip di dalam: Kajian Interpretasi Antropik Penemuan baru dari penyelidikan yang dijalankan oleh antropik mewakili kemajuan yang signifikan dalam bidang interpretasi mekanistik, yang bertujuan untuk membalikkan pengkomputeran dalaman AI -bukan hanya memerhatikan apa yang AI lakukan, tetapi memahami bagaimana ia melakukannya di tahap neuron buatan. Bayangkan cuba memahami otak dengan melukis kebakaran neuron apabila seseorang melihat objek tertentu atau berfikir tentang idea tertentu. A

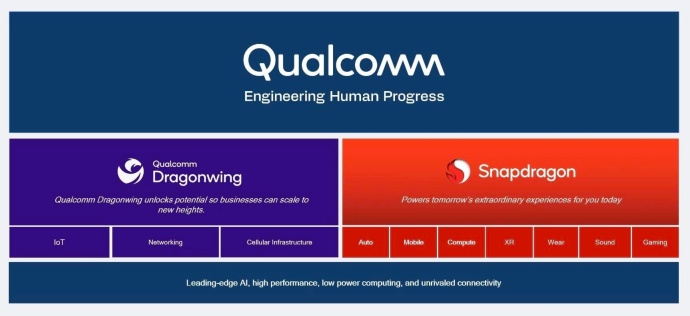

Dragonwing mempamerkan momentum kelebihan qualcommApr 10, 2025 am 11:14 AM

Dragonwing mempamerkan momentum kelebihan qualcommApr 10, 2025 am 11:14 AMDragonwing Qualcomm: Lonjakan Strategik ke Perusahaan dan Infrastruktur Qualcomm secara agresif memperluaskan jangkauannya di luar mudah alih, mensasarkan pasaran perusahaan dan infrastruktur di seluruh dunia dengan jenama Dragonwing yang baru. Ini bukan sekadar rebran

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

ZendStudio 13.5.1 Mac

Persekitaran pembangunan bersepadu PHP yang berkuasa

Muat turun versi mac editor Atom

Editor sumber terbuka yang paling popular

Pelayar Peperiksaan Selamat

Pelayar Peperiksaan Selamat ialah persekitaran pelayar selamat untuk mengambil peperiksaan dalam talian dengan selamat. Perisian ini menukar mana-mana komputer menjadi stesen kerja yang selamat. Ia mengawal akses kepada mana-mana utiliti dan menghalang pelajar daripada menggunakan sumber yang tidak dibenarkan.

SublimeText3 Linux versi baharu

SublimeText3 Linux versi terkini

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan