Rumah >Peranti teknologi >AI >ChatGPT meminta Nature menerbitkan dua artikel seminggu untuk membincangkan: Ia tidak dapat dielakkan untuk menggunakannya dalam kalangan akademik, dan sudah tiba masanya untuk menjelaskan spesifikasi penggunaan

ChatGPT meminta Nature menerbitkan dua artikel seminggu untuk membincangkan: Ia tidak dapat dielakkan untuk menggunakannya dalam kalangan akademik, dan sudah tiba masanya untuk menjelaskan spesifikasi penggunaan

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-18 21:07:011701semak imbas

Sementara gergasi teknologi berjuang untuk ChatGPT, kalangan akademik juga memberi perhatian yang semakin meningkat kepada ChatGPT.

Dalam masa seminggu, Nature menerbitkan dua artikel membincangkan ChatGPT dan AI generatif.

Lagipun, ChatGPT adalah orang pertama yang membuat gelombang dalam kalangan ulama telah menggunakannya untuk menulis abstrak dan menyemak kertas kerja.

Nature telah mengeluarkan larangan khas untuk ini: ChatGPT tidak boleh menjadi pengarang kertas itu. Sains secara langsung melarang penyerahan menggunakan ChatGPT untuk menjana teks.

Tetapi trend itu sudah ada.

Apa yang patut kita lakukan sekarang mungkin adalah untuk menjelaskan kepentingan ChatGPT kepada komuniti saintifik dan kedudukan yang sepatutnya didudukinya.

Seperti kata Alam:

AI Generatif dan teknologi di belakangnya berkembang dengan begitu pantas, dengan inovasi muncul setiap bulan. Cara penyelidik menggunakannya akan menentukan masa depan teknologi dan akademik.

CtGPT mengubah peraturan lingkungan akademik

Dalam artikel "ChatGPT: Lima Isu Penyelidikan Keutamaan", para penyelidik mencadangkan:

Ia adalah mustahil untuk menghalang ChatGPT daripada memasuki Dalam kalangan akademik, keutamaan utama adalah untuk mengkaji dan meneroka potensi kesannya.

Jika ChatGPT kemudiannya digunakan untuk mereka bentuk eksperimen, menjalankan semakan rakan sebaya, membantu dalam penerbitan dan membantu editor memutuskan sama ada untuk menerima artikel... Apakah isu yang perlu diberi perhatian dengan aplikasi ini? Apakah sempadan yang perlu diperjelaskan oleh manusia sekarang?

Pengkaji percaya terdapat 5 aspek yang perlu diutamakan dan dijelaskan sebabnya.

Tegaskan ulasan manusia

Ciri utama AI perbualan seperti ChatGPT ialah ketepatan kandungan jawapan tidak dapat dijamin. Lebih-lebih lagi, pembohongan yang dibuat adalah sangat semula jadi dan boleh mengelirukan orang dengan mudah.

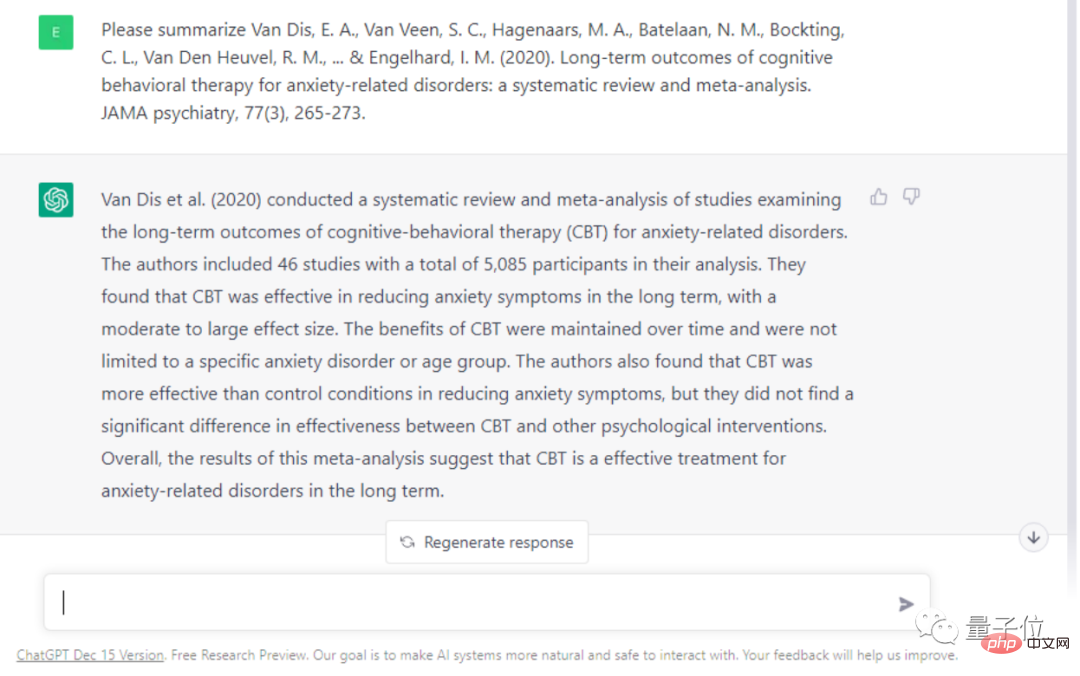

Sebagai contoh, penyelidik meminta ChatGPT meringkaskan kertas kerja sama ada terapi tingkah laku kognitif (CBT) berkesan dalam merawat gejala seperti kebimbangan.

Terdapat banyak kesilapan fakta dalam jawapan yang diberikan oleh ChatGPT. Sebagai contoh, ia mengatakan bahawa ulasan ini berdasarkan 46 kajian, tetapi sebenarnya 69, dan ia membesar-besarkan keberkesanan CBT.

Para penyelidik percaya bahawa jika sesetengah sarjana menggunakan ChatGPT untuk membantu penyelidikan, mereka mungkin terpedaya dengan maklumat yang salah. Malah boleh menyebabkan ulama menciplak karya orang lain tanpa disedari.

Oleh itu, penyelidik percaya bahawa manusia tidak boleh terlalu bergantung pada sistem automatik dalam proses menyemak kertas, dan manusia sendiri akhirnya mesti bertanggungjawab terhadap amalan saintifik.

Membangunkan peraturan akauntabiliti

Untuk menangani penyalahgunaan AI generatif, banyak alat pengenalan teks AI telah dilahirkan dengan mudah mereka boleh membezakan sama ada sekeping teks ditulis oleh manusia .

Walau bagaimanapun, penyelidik percaya bahawa "perlumbaan senjata" ini tidak perlu dilakukan adalah untuk membenarkan kalangan akademik dan penerbit menggunakan alatan AI dengan lebih terbuka dan telus.

Pengarang kertas hendaklah menunjukkan dengan jelas tugas yang dilakukan oleh AI, dan jurnal juga harus membuat pendedahan awam jika mereka menggunakan AI untuk semakan.

Terutamanya kini AI generatif telah mencetuskan perbincangan tentang isu paten Bagaimana hak cipta imej yang dihasilkan oleh AI harus dikira?

Jadi untuk masalah yang dijana oleh AI, hak cipta harus dimiliki oleh orang yang menyediakan data latihan untuk AI? Syarikat pengeluaran di sebalik AI? Atau seorang sarjana yang menggunakan AI untuk menulis artikel? Isu kepengarangan juga perlu ditakrifkan dengan teliti.

Melabur dalam LLM yang benar-benar terbuka

Pada masa ini, hampir semua AI perbualan lanjutan dibawa oleh gergasi teknologi.

Banyak tentang prinsip kerja algoritma di sebalik alatan AI masih tidak diketahui.

Ini juga telah menimbulkan kebimbangan daripada semua lapisan masyarakat, kerana tingkah laku monopoli gergasi secara serius melanggar prinsip keterbukaan dalam komuniti saintifik.

Ini akan mempengaruhi kalangan akademik untuk meneroka kelemahan dan prinsip asas AI perbualan, seterusnya menjejaskan kemajuan sains dan teknologi.

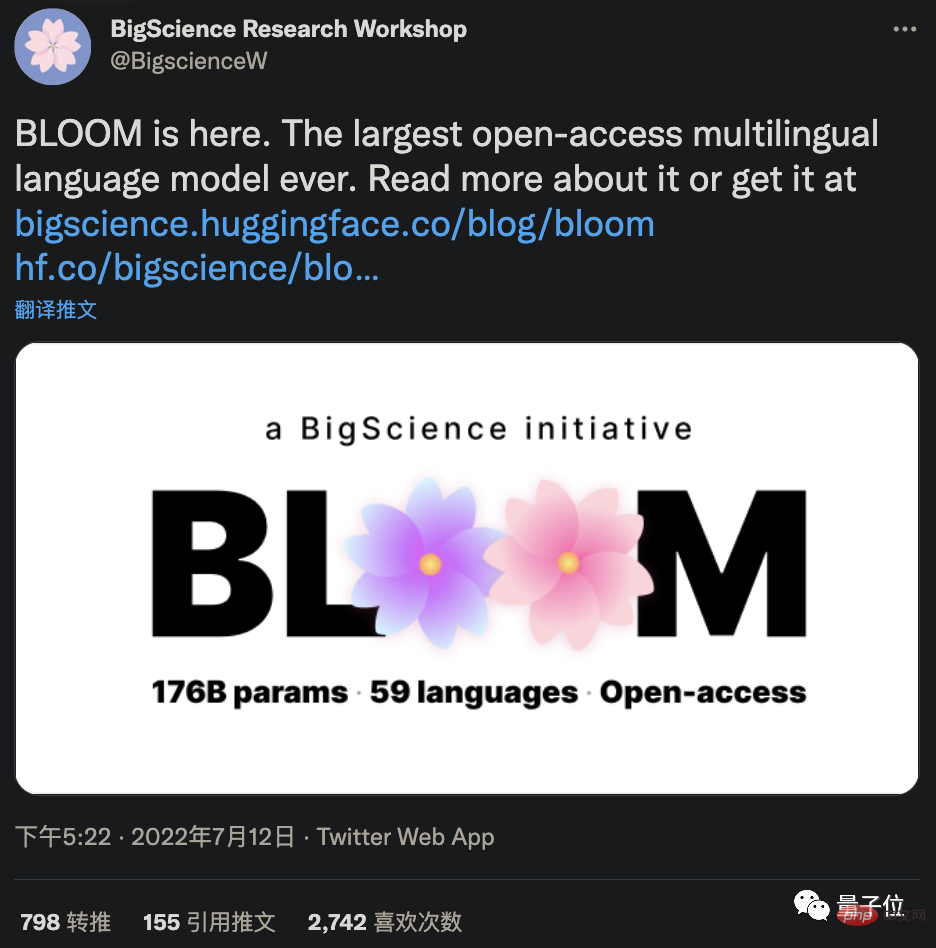

Untuk mengatasi kelegapan ini, penyelidik percaya bahawa pembangunan dan aplikasi algoritma AI sumber terbuka harus diutamakan pada masa ini. Sebagai contoh, model besar sumber terbuka BLOOM telah dimulakan bersama oleh 1,000 saintis dan boleh menandingi GPT-3 dari segi prestasi.

Harapilah kelebihan AI

Walaupun banyak aspek yang perlu dihadkan, tidak dapat dinafikan bahawa AI sememangnya boleh meningkatkan kecekapan bulatan akademik.

Sebagai contoh, AI boleh mengendalikan beberapa kerja semakan dengan cepat, dan sarjana boleh lebih menumpukan pada percubaan itu sendiri, dan hasilnya boleh diterbitkan dengan lebih pantas, sekali gus mendorong seluruh kalangan akademik untuk bergerak lebih pantas.

Walaupun dalam beberapa tugas kreatif, penyelidik percaya bahawa AI juga boleh berguna.

Sebuah kertas penting pada tahun 1991 mencadangkan bahawa "perkongsian pintar" yang terbentuk antara manusia dan AI boleh mengatasi kecerdasan dan kebolehan manusia sahaja.

Hubungan ini boleh mempercepatkan inovasi ke tahap yang tidak dapat dibayangkan. Tetapi persoalannya, sejauh mana automasi ini boleh pergi? Sejauh mana anda perlu pergi?

Oleh itu, penyelidik juga menyeru para sarjana, termasuk ahli etika, untuk membincangkan sempadan AI hari ini dalam penjanaan kandungan pengetahuan dan keaslian manusia mungkin masih diperlukan untuk penyelidikan yang inovatif.

Mulakan perbahasan besar

Memandangkan kesan semasa LLM, penyelidik percaya bahawa komuniti akademik harus segera menganjurkan perbahasan besar.

Mereka menyeru setiap kumpulan penyelidik untuk segera mengadakan mesyuarat kumpulan untuk berbincang dan mencuba ChatGPT sendiri. Guru universiti harus mengambil inisiatif untuk membincangkan penggunaan dan isu etika ChatGPT dengan pelajar.

Pada peringkat awal apabila peraturan belum jelas, adalah penting bagi ketua pasukan penyelidik untuk menyeru semua orang untuk menggunakan ChatGPT dengan lebih terbuka dan telus serta mula membentuk beberapa peraturan. Dan semua penyelidik harus diingatkan untuk bertanggungjawab ke atas kerja mereka sendiri, sama ada ia dihasilkan oleh ChatGPT atau tidak.

Selanjutnya, penyelidik percaya bahawa forum antarabangsa perlu diadakan segera untuk membincangkan penyelidikan dan penggunaan LLM.

Ahli hendaklah termasuk saintis dari pelbagai bidang, syarikat teknologi, pelabur institusi penyelidikan, akademi saintifik, penerbit, NGO dan pakar undang-undang dan privasi.

Alam Semula Jadi: Maksud ChatGPT dan AIGC kepada sains

Teruja dan bimbang, ini mungkin perasaan ramai penyelidik tentang ChatGPT.

Sehingga kini, ChatGPT telah menjadi pembantu digital untuk ramai sarjana.

Ahli biologi pengiraan Casey Greene dan yang lain menggunakan ChatGPT untuk menyemak kertas kerja. Dalam masa 5 minit, AI boleh menyemak manuskrip dan juga mencari masalah di bahagian rujukan.

Hafsteinn Einarsson, seorang sarjana dari Iceland, menggunakan ChatGPT hampir setiap hari untuk membantunya membuat PPT dan menyemak kerja rumah pelajar.

Juga ahli neurobiologi Almira Osmanovic Thunström percaya bahawa model bahasa yang besar boleh digunakan untuk membantu sarjana menulis permohonan geran, dan saintis boleh menjimatkan lebih banyak masa.

Walau bagaimanapun, Nature membuat ringkasan cemerlang tentang output ChatGPT:

Lancar tetapi tidak tepat.

Anda mesti tahu bahawa kelemahan utama ChatGPT ialah kandungan yang dihasilkannya mungkin tidak benar dan tepat, yang akan menjejaskan penggunaannya dalam kalangan akademik.

Bolehkah ia diselesaikan?

Mulai sekarang, jawapannya agak mengelirukan.

Pesaing OpenAI, Anthroic mendakwa telah menyelesaikan beberapa masalah dengan ChatGPT, tetapi mereka tidak menerima temu bual dengan Nature.

Meta telah mengeluarkan model bahasa besar yang dipanggil Galactica, yang dibuat daripada 48 juta kertas kerja dan karya akademik. Ia mendakwa mahir menjana kandungan akademik dan pemahaman yang lebih baik tentang masalah penyelidikan. Bagaimanapun, demonya tidak lagi dibuka (kod masih tersedia) kerana pengguna mendapati ia bersifat perkauman semasa digunakan.

Malah ChatGPT, yang telah dilatih untuk "berkelakuan baik", mungkin sengaja dibimbing untuk mengeluarkan kenyataan berbahaya.

Kaedah OpenAI untuk menjadikan ChatGPT lebih jinak juga sangat mudah dan kasar Ia adalah untuk mencari banyak tenaga kerja manual untuk memberi anotasi kepada korpus ini jenis eksploitasi.

Tetapi dalam apa jua keadaan, ChatGPT dan AI generatif telah membuka pintu baharu kepada imaginasi manusia.

Ahli perubatan Eric Topol berkata bahawa dia berharap pada masa hadapan akan ada kecerdasan buatan termasuk LLM yang boleh menyemak silang teks dan imej dalam kesusasteraan akademik untuk membantu manusia mendiagnosis kanser dan memahami penyakit. Sudah tentu, semua ini mesti diawasi oleh pakar.

Beliau berkata, saya benar-benar tidak menjangkakan kita akan melihat trend sebegitu pada awal tahun 2023.

Dan ini hanyalah permulaan.

Pautan rujukan:

[1]https://www.php.cn/link/492284833481ed2fd377c50abdedf9f1

[2]https://www.php.cn/link/04f19115dfa286fb61ab634a2717ed37

Atas ialah kandungan terperinci ChatGPT meminta Nature menerbitkan dua artikel seminggu untuk membincangkan: Ia tidak dapat dielakkan untuk menggunakannya dalam kalangan akademik, dan sudah tiba masanya untuk menjelaskan spesifikasi penggunaan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI