Rumah >Peranti teknologi >AI >Kebisingan Gaussian dalam pembelajaran mendalam: mengapa dan cara menggunakannya

Kebisingan Gaussian dalam pembelajaran mendalam: mengapa dan cara menggunakannya

- WBOYke hadapan

- 2023-04-17 16:22:032167semak imbas

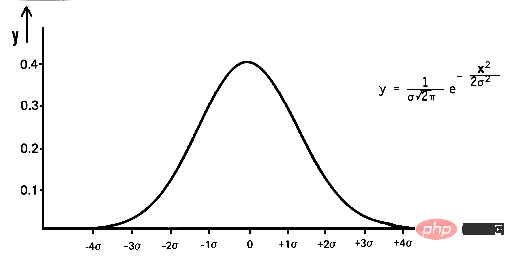

Secara matematik, hingar Gaussian ialah sejenis hingar yang dihasilkan dengan menambahkan nilai rawak taburan normal dengan min sifar dan sisihan piawai (σ) kepada data input. Taburan normal, juga dikenali sebagai taburan Gaussian, ialah taburan kebarangkalian berterusan yang ditakrifkan oleh fungsi ketumpatan kebarangkalian (PDF):

pdf(x) = (1 / (σ * sqrt(2 * π))) * e^(- (x — μ)² / (2 * σ²))

Di mana x ialah pembolehubah rawak, μ ialah min, dan σ ialah sisihan piawai.

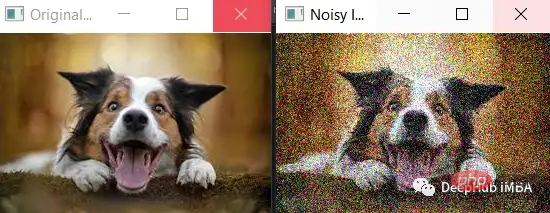

Dengan menjana nilai rawak dengan taburan normal dan menambahkannya pada data input. Sebagai contoh, jika anda menambah hingar Gaussian pada imej, anda boleh mewakili imej sebagai matriks dua dimensi nilai piksel, kemudian gunakan perpustakaan numpy np.random.randn(rows,cols) untuk menjana nilai rawak dengan taburan normal dan tambahkannya pada imej dalam nilai piksel. Ini menghasilkan imej baharu dengan bunyi Gaussian ditambahkan padanya.

Bunyi Gaussian, juga dikenali sebagai hingar putih, ialah sejenis hingar rawak yang mematuhi taburan normal. Dalam pembelajaran mendalam, hingar Gaussian sering ditambahkan pada data input semasa latihan untuk meningkatkan keteguhan dan keupayaan generalisasi model. Ini dipanggil penambahan data. Dengan menambahkan hingar pada data input, model terpaksa mempelajari ciri yang teguh kepada perubahan kecil dalam input, yang boleh membantunya berprestasi lebih baik pada data baharu yang tidak kelihatan. Bunyi Gaussian juga boleh ditambah pada berat rangkaian saraf semasa latihan untuk meningkatkan prestasinya, teknik yang dipanggil keciciran.

Mari kita mulakan dengan contoh mudah:

Sisihan piawai hingar (noise_std) ditetapkan kepada nilai yang lebih besar iaitu 50, yang akan menyebabkan lebih banyak hingar ditambahkan pada imej . Dapat dilihat bunyi bising lebih jelas dan ciri-ciri imej asal kurang jelas.

Perlu diambil perhatian bahawa apabila menambah lebih banyak hingar, anda perlu memastikan bahawa hingar tidak melebihi julat nilai piksel yang sah (iaitu antara 0 dan 255). Dalam contoh ini, fungsi np.clip() digunakan untuk memastikan bahawa nilai piksel imej bising berada dalam julat yang sah.

Walaupun lebih banyak bunyi bising mungkin memudahkan untuk melihat perbezaan antara imej asal dan bunyi bising, ia juga mungkin menyukarkan model untuk mempelajari ciri berguna daripada data dan boleh menyebabkan pemasangan berlebihan atau kurang kemas . Oleh itu, sebaiknya mulakan dengan sedikit bunyi dan kemudian tingkatkan bunyi secara beransur-ansur sambil memantau prestasi model.

import cv2

import numpy as np

# Load the image

image = cv2.imread('dog.jpg')

# Add Gaussian noise to the image

noise_std = 50

noise = np.random.randn(*image.shape) * noise_std

noisy_image = np.clip(image + noise, 0, 255).astype(np.uint8)

# Display the original and noisy images

cv2.imshow('Original Image', image)

cv2.imshow('Noisy Image', noisy_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

Beberapa contoh cara bunyi Gaussian boleh digunakan dalam pembelajaran mendalam.

- Pembesaran Data: Penggunaan biasa bunyi Gaussian dalam pembelajaran mendalam ialah menambahkannya pada data input semasa latihan. Sebagai contoh, hingar Gaussian boleh ditambah sebelum setiap imej disalurkan melalui model. Ini akan memaksa model untuk mempelajari ciri yang teguh kepada perubahan kecil dalam input, yang boleh mewakili kesan atau sedikit ketiadaan dalam imej. Jadi model lebih berkemungkinan untuk mengenal pasti imej dengan betul walaupun imej itu berbeza sedikit daripada data latihan.

- Keciciran: Satu lagi penggunaan bunyi Gaussian dalam pembelajaran mendalam ialah menambahkannya pada berat rangkaian saraf semasa latihan. Ini dipanggil Dropout. Semasa latihan, keciciran secara rawak menetapkan beberapa pemberat dalam rangkaian kepada sifar dengan kebarangkalian tertentu (cth. 0.5). Ini memaksa rangkaian untuk mempelajari pelbagai perwakilan berlebihan data, menjadikan model lebih teguh dan kurang terdedah kepada pemasangan berlebihan.

- Penyaturan: Menambah hingar Gaussian pada parameter model juga boleh dianggap sebagai teknik penaturan. Ia memaksa model untuk mempunyai nilai berat yang lebih kecil, yang seterusnya menjadikan model lebih umum dan kurang terdedah kepada overfitting.

- Latihan lawan: Contoh lawan ialah input yang direka khusus untuk memperdaya model Dalam latihan lawan, model dilatih tentang contoh yang dipertingkatkan dengan gangguan kecil yang disasarkan, seperti bunyi Gaussian. Ini menjadikan model lebih teguh kepada contoh lawan.

- Pembelajaran separa penyeliaan: Bunyi Gaussian boleh ditambah pada data input semasa latihan untuk meningkatkan prestasi model separa penyeliaan. Ini boleh membantu model menggunakan data berlabel terhad dengan lebih baik dan mempelajari lebih banyak ciri umum.

- Pembelajaran pemindahan: hingar Gaussian boleh ditambah pada data input semasa penalaan halus untuk meningkatkan prestasi model pembelajaran pemindahan. Ini boleh membantu model menyesuaikan diri dengan lebih baik kepada tugasan baharu dan membuat generalisasi yang lebih baik kepada data yang tidak kelihatan.

- Rangkaian Adversarial Generatif (GAN): Bunyi Gaussian boleh ditambah pada input penjana untuk meningkatkan kepelbagaian sampel yang dijana.

- Pembelajaran mendalam Bayesian: Bunyi Gaussian boleh ditambah pada pemberat model semasa latihan untuk menjadikannya lebih teguh untuk memasang lampau dan meningkatkan keupayaan generalisasi model.

- Pembelajaran pengukuhan: Semasa proses latihan, hingar Gaussian boleh ditambah pada input atau ruang tindakan ejen untuk menjadikannya lebih mantap kepada perubahan persekitaran dan meningkatkan keupayaan generalisasi ejen.

Dalam semua contoh di atas, hingar Gaussian ditambah pada input atau pemberat secara terkawal dengan min tertentu dan sisihan piawai. Matlamatnya adalah untuk meningkatkan prestasi dan keteguhan model tanpa menyukarkan model untuk belajar daripada data.

Di sini kami menerangkan cara menambah hingar Gaussian pada data input semasa latihan sebelum menghantarnya kepada model menggunakan Python dan Keras:

from keras.preprocessing.image import ImageDataGenerator # Define the data generator datagen = ImageDataGenerator( featurewise_center=False,# set input mean to 0 over the dataset samplewise_center=False,# set each sample mean to 0 featurewise_std_normalization=False,# divide inputs by std of the dataset samplewise_std_normalization=False,# divide each input by its std zca_whitening=False,# apply ZCA whitening rotation_range=0,# randomly rotate images in the range (degrees, 0 to 180) width_shift_range=0.1,# randomly shift images horizontally (fraction of total width) height_shift_range=0.1,# randomly shift images vertically (fraction of total height) horizontal_flip=False,# randomly flip images vertical_flip=False,# randomly flip images noise_std=0.5# add gaussian noise to the data with std of 0.5 ) # Use the generator to transform the data during training model.fit_generator(datagen.flow(x_train, y_train, batch_size=32), steps_per_epoch=len(x_train) / 32, epochs=epochs)

Keras 的 ImageDataGenerator 类用于定义一个数据生成器,该数据生成器将指定的数据增强技术应用于输入数据。 我们将 noise_std 设置为 0.5,这意味着标准偏差为 0.5 的高斯噪声将添加到输入数据中。 然后在调用 model.fit_generator 期间使用生成器在训练期间将数据扩充应用于输入数据。

至于Dropout,可以使用Keras中的Dropout层,设置dropout的rate,如果设置rate为0.5,那么dropout层会drop掉50%的权重。 以下是如何向模型添加 dropout 层的示例:

from keras.layers import Dropout model = Sequential() model.add(Dense(64, input_dim=64, activation='relu')) model.add(Dropout(0.5)) model.add(Dense(64, activation='relu')) model.add(Dense(10, activation='softmax'))

需要注意的是,标准差、Dropout的实际值将取决于具体问题和数据的特征。使用不同的值进行试验并监视模型的性能通常是一个好主意。

下面我们介绍使用Keras 在训练期间将高斯噪声添加到输入数据和权重。为了向输入数据添加噪声,我们可以使用 numpy 库生成随机噪声并将其添加到输入数据中。 这是如何执行此操作的示例:

import numpy as np # Generate some random input data x_train = np.random.rand(1000, 64) y_train = np.random.rand(1000, 10) # Add Gaussian noise to the input data noise_std = 0.5 x_train_noisy = x_train + noise_std * np.random.randn(*x_train.shape) # Train the model model.fit(x_train_noisy, y_train, epochs=10)

我们输入数据 x_train 是形状为 (1000, 64) 的二维数组,噪声是使用 np.random.randn(*x_train.shape) 生成的,它将返回具有相同形状的正态分布均值为 0,标准差为 1的随机值数组。然后将生成的噪声与噪声的标准差 (0.5) 相乘,并将其添加到输入数据中,从而将其添加到输入数据中。

为了给权重添加噪声,我们可以使用 Keras 中的 Dropout 层,它会在训练过程中随机丢弃一些权重。 高斯噪声是深度学习中广泛使用的技术,在图像分类训练时可以在图像中加入高斯噪声,提高图像分类模型的鲁棒性。 这在训练数据有限或具有很大可变性时特别有用,因为模型被迫学习对输入中的小变化具有鲁棒性的特征。

以下是如何在训练期间向图像添加高斯噪声以提高图像分类模型的鲁棒性的示例:

from keras.preprocessing.image import ImageDataGenerator # Define the data generator datagen = ImageDataGenerator( featurewise_center=False,# set input mean to 0 over the dataset samplewise_center=False,# set each sample mean to 0 featurewise_std_normalization=False,# divide inputs by std of the dataset samplewise_std_normalization=False,# divide each input by its std zca_whitening=False,# apply ZCA whitening rotation_range=0,# randomly rotate images in the range (degrees, 0 to 180) width_shift_range=0,# randomly shift images horizontally (fraction of total width) height_shift_range=0,# randomly shift images vertically (fraction of total height) horizontal_flip=False,# randomly flip images vertical_flip=False,# randomly flip images noise_std=0.5# add gaussian noise to the data with std of 0.5 ) # Use the generator to transform the data during training model.fit_generator(datagen.flow(x_train, y_train, batch_size=32), steps_per_epoch=len(x_train) / 32, epochs=epochs)

目标检测:在目标检测模型的训练过程中,可以将高斯噪声添加到输入数据中,以使其对图像中的微小变化(例如光照条件、遮挡和摄像机角度)更加鲁棒。

def add_noise(image, std): """Add Gaussian noise to an image.""" noise = np.random.randn(*image.shape) * std return np.clip(image + noise, 0, 1) # Add noise to the training images x_train_noisy = np.array([add_noise(img, 0.1) for img in x_train]) # Train the model model.fit(x_train_noisy, y_train, epochs=10)

语音识别:在训练过程中,可以在音频数据中加入高斯噪声,这可以帮助模型更好地处理音频信号中的背景噪声和其他干扰,提高语音识别模型的鲁棒性。

def add_noise(audio, std): """Add Gaussian noise to an audio signal.""" noise = np.random.randn(*audio.shape) * std return audio + noise # Add noise to the training audio x_train_noisy = np.array([add_noise(audio, 0.1) for audio in x_train]) # Train the model model.fit(x_train_noisy, y_train, epochs=10)

生成模型:在 GAN、Generative Pre-training Transformer (GPT) 和 VAE 等生成模型中,可以在训练期间将高斯噪声添加到输入数据中,以提高模型生成新的、看不见的数据的能力。

# Generate random noise noise = np.random.randn(batch_size, 100) # Generate fake images fake_images = generator.predict(noise) # Add Gaussian noise to the fake images fake_images_noisy = fake_images + 0.1 * np.random.randn(*fake_images.shape) # Train the discriminator discriminator.train_on_batch(fake_images_noisy, np.zeros((batch_size, 1)))

在这个例子中,生成器被训练为基于随机噪声作为输入生成新的图像,并且在生成的图像传递给鉴别器之前,将高斯噪声添加到生成的图像中。这提高了生成器生成新的、看不见的数据的能力。

对抗训练:在对抗训练时,可以在输入数据中加入高斯噪声,使模型对对抗样本更加鲁棒。

下面的对抗训练使用快速梯度符号法(FGSM)生成对抗样本,高斯噪声为 在训练期间将它们传递给模型之前添加到对抗性示例中。 这提高了模型对对抗性示例的鲁棒性。

# Generate adversarial examples x_adv = fgsm(model, x_train, y_train, eps=0.01) # Add Gaussian noise to the adversarial examples noise_std = 0.05 x_adv_noisy = x_adv + noise_std * np.random.randn(*x_adv.shape) # Train the model model.fit(x_adv_noisy, y_train, epochs=10)

去噪:可以将高斯噪声添加到图像或信号中,模型的目标是学习去除噪声并恢复原始信号。下面的例子中输入图像“x_train”首先用标准的高斯噪声破坏 0.1 的偏差,然后将损坏的图像通过去噪自动编码器以重建原始图像。 自动编码器学习去除噪声并恢复原始信号。

# Add Gaussian noise to the images noise_std = 0.1 x_train_noisy = x_train + noise_std * np.random.randn(*x_train.shape) # Define the denoising autoencoder input_img = Input(shape=(28, 28, 1)) x = Conv2D(32, (3, 3), activation='relu', padding='same')(input_img) x = MaxPooling2D((2, 2), padding='same')(x) x = Conv2D(32, (3, 3), activation='relu', padding='same')(x) encoded = MaxPooling2D((2, 2), padding='same')(x) # at this point the representation is (7, 7, 32) x = Conv2D(32, (3, 3), activation='relu', padding='same')(encoded) x = UpSampling2D((2, 2))(x) x = Conv2D(32, (3, 3), activation='relu', padding='same')(x) x = UpSampling2D((2, 2))(x) decoded = Conv2D(1, (3, 3), activation='sigmoid', padding='same')(x) autoencoder = Model(input_img, decoded) autoencoder.compile(optimizer='adam', loss='binary

异常检测:高斯噪声可以添加到正常数据中,模型的目标是学习将添加的噪声作为异常检测。

# Add Gaussian noise to the normal data noise_std = 0.1 x_train_noisy = x_train + noise_std * np.random.randn(*x_train.shape) # Concatenate the normal and the noisy data x_train_concat = np.concatenate((x_train, x_train_noisy)) y_train_concat = np.concatenate((np.zeros(x_train.shape[0]), np.ones(x_train_noisy.shape[0]))) # Train the anomaly detection model model.fit(x_train_concat, y_train_concat, epochs=10)

稳健优化:在优化过程中,可以将高斯噪声添加到模型的参数中,使其对参数中的小扰动更加稳健。

Define the loss function def loss_fn(params): model.set_weights(params) return model.evaluate(x_test, y_test, batch_size=32)[0] # Define the optimizer optimizer = optimizers.Adam(1e-3) # Define the step function def step_fn(params): with tf.GradientTape() as tape: loss = loss_fn(params) grads = tape.gradient(loss, params) optimizer.apply_gradients(zip(grads, params)) return params + noise_std * np.random.randn(*params.shape) # Optimize the model params = model.get_weights()

高斯噪声是深度学习中用于为输入数据或权重添加随机性的一种技术。 它是一种通过将均值为零且标准差 (σ) 正态分布的随机值添加到输入数据中而生成的随机噪声。 向数据中添加噪声的目的是使模型对输入中的小变化更健壮,并且能够更好地处理看不见的数据。 高斯噪声可用于广泛的应用,例如图像分类、对象检测、语音识别、生成模型和稳健优化。

Atas ialah kandungan terperinci Kebisingan Gaussian dalam pembelajaran mendalam: mengapa dan cara menggunakannya. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI