Rumah >Peranti teknologi >AI >Kerja baharu guru pembelajaran pengukuhan Sergey Levine: Tiga model besar mengajar robot mengenali cara mereka

Kerja baharu guru pembelajaran pengukuhan Sergey Levine: Tiga model besar mengajar robot mengenali cara mereka

- WBOYke hadapan

- 2023-04-12 23:55:091485semak imbas

Robot dengan model terbina dalam yang besar telah belajar mengikuti arahan bahasa untuk mencapai tujuannya tanpa melihat peta ini datang dari kerja baru penguatkuasaan pembelajaran Sergey Levine.

Memandangkan destinasi, betapa sukarnya untuk mencapainya dengan lancar tanpa trek navigasi?

Tugas ini juga sangat mencabar bagi manusia yang tidak mempunyai hala tuju. Tetapi dalam kajian baru-baru ini, beberapa ahli akademik "mengajar" robot menggunakan hanya tiga model pra-latihan.

Kita semua tahu bahawa salah satu cabaran teras pembelajaran robot adalah untuk membolehkan robot melaksanakan pelbagai tugas mengikut arahan manusia peringkat tinggi. Ini memerlukan robot yang boleh memahami arahan manusia dan dilengkapi dengan sejumlah besar tindakan berbeza untuk melaksanakan arahan ini di dunia nyata.

Untuk arahan mengikut tugasan dalam navigasi, kerja sebelumnya tertumpu terutamanya pada pembelajaran daripada trajektori yang dianotasi dengan arahan teks. Ini mungkin membolehkan pemahaman arahan teks, tetapi kos anotasi data telah menghalang penggunaan meluas teknik ini. Sebaliknya, kerja baru-baru ini telah menunjukkan bahawa latihan penyeliaan sendiri bagi dasar bermatlamat boleh mempelajari navigasi yang mantap. Kaedah ini adalah berdasarkan set data yang besar dan tidak berlabel, dengan pelabelan semula post hoc untuk melatih pengawal berasaskan penglihatan. Kaedah ini boleh berskala, umum dan teguh, tetapi selalunya memerlukan penggunaan mekanisme spesifikasi sasaran berasaskan lokasi atau imej yang menyusahkan.

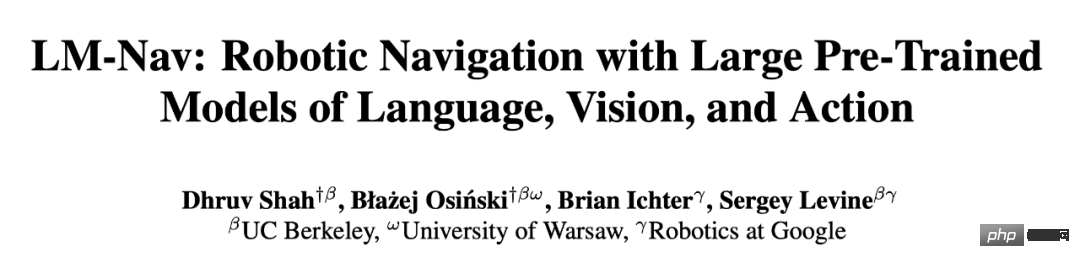

Dalam kertas kerja terbaharu, penyelidik dari UC Berkeley, Google dan institusi lain menyasarkan untuk menggabungkan kelebihan kedua-dua kaedah ini untuk menjadikan sistem penyeliaan sendiri untuk navigasi robot terpakai pada data navigasi tanpa sebarang anotasi pengguna , memanfaatkan keupayaan model pra-latihan untuk melaksanakan arahan bahasa semula jadi. Penyelidik menggunakan model ini untuk membina "antara muka" yang menyampaikan tugas kepada robot. Sistem ini memanfaatkan keupayaan generalisasi bahasa pra-latihan dan model bahasa penglihatan untuk membolehkan sistem robotik menerima arahan peringkat tinggi yang kompleks.

- Pautan kertas: https://arxiv.org/pdf/2207.04429.pdf

- Pautan kod: https://github.com/blazejosinski/lm_nav

Para penyelidik memerhatikan bahawa adalah mungkin untuk memanfaatkan model pra-latihan di luar rak yang dilatih pada korpora visual yang besar dan set data bahasa ( Korpora ini tersedia secara meluas dan menunjukkan keupayaan generalisasi sifar pukulan) untuk mencipta antara muka yang membolehkan penjejakan arahan khusus. Untuk mencapai matlamat ini, para penyelidik menggabungkan kelebihan model pra-latihan agnostik robot penglihatan dan bahasa serta model navigasi pra-terlatih. Secara khusus, mereka menggunakan model navigasi visual (VNM:ViNG) untuk mencipta output visual robot ke dalam "peta mental" topologi persekitaran. Memandangkan arahan teks bentuk bebas, model bahasa besar yang telah dilatih (LLM: GPT-3) digunakan untuk menyahkod arahan ke dalam satu siri titik ciri bentuk teks. Kemudian, model bahasa visual (VLM: CLIP) digunakan untuk mewujudkan titik ciri teks ini dalam peta topologi dengan membuat kesimpulan kemungkinan bersama titik ciri dan nod. Algoritma carian baharu kemudiannya digunakan untuk memaksimumkan fungsi objektif kebarangkalian dan mencari laluan arahan robot, yang kemudiannya dilaksanakan oleh VNM. Sumbangan utama penyelidikan adalah kaedah navigasi di bawah model berskala besar (LM Nav), sistem penjejakan arahan khusus. Ia menggabungkan tiga model pra-latihan bebas yang besar - model kawalan robot yang diselia sendiri yang memanfaatkan pemerhatian visual dan tindakan fizikal (VNM), model bahasa visual yang meletakkan imej dalam teks tetapi tanpa persekitaran pelaksanaan konkrit (VLM), dan besar. model bahasa yang menghuraikan dan menterjemah teks tetapi tidak mempunyai asas visual atau deria terkandung (LLM) untuk membolehkan penjejakan arahan pandangan panjang dalam persekitaran dunia sebenar yang kompleks. Buat pertama kalinya, penyelidik mencetuskan idea untuk menggabungkan model penglihatan dan bahasa yang telah dilatih dengan pengawal bersyarat sasaran untuk memperoleh laluan arahan yang boleh diambil tindakan dalam persekitaran sasaran tanpa sebarang penalaan halus. Terutama sekali, ketiga-tiga model dilatih pada set data berskala besar, mempunyai fungsi objektif yang diselia sendiri dan digunakan di luar kotak tanpa penalaan halus - latihan LM Nav tidak memerlukan anotasi manusia bagi data navigasi robot.

Eksperimen menunjukkan bahawa LM Nav berjaya mengikut arahan bahasa semula jadi dalam persekitaran baharu sambil menggunakan perintah berbutir halus untuk menghilangkan kekaburan laluan semasa navigasi pinggir bandar yang kompleks sejauh 100 meter.

Gambaran keseluruhan model LM-Nav

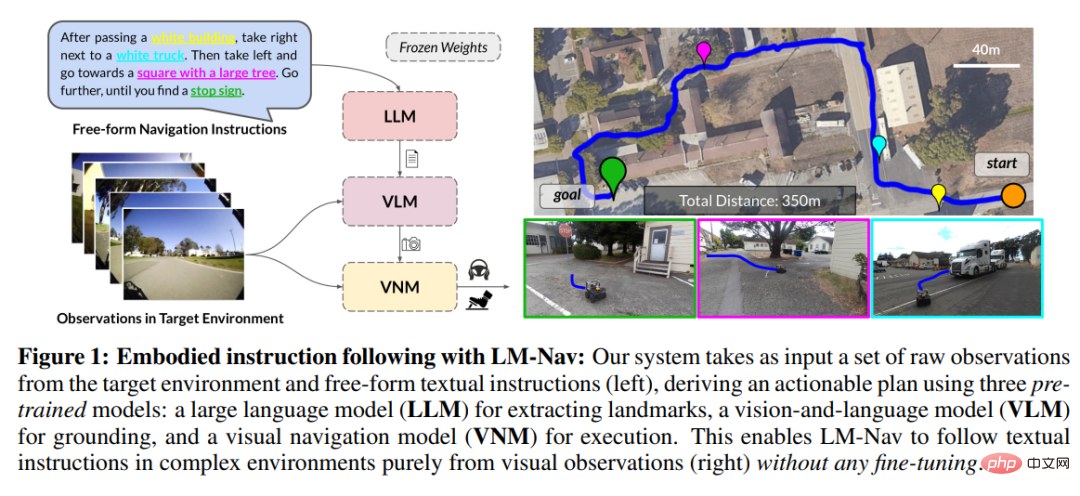

Jadi, bagaimanakah penyelidik menggunakan imej dan model bahasa yang telah dilatih untuk menyediakan antara muka teks untuk model navigasi visual?

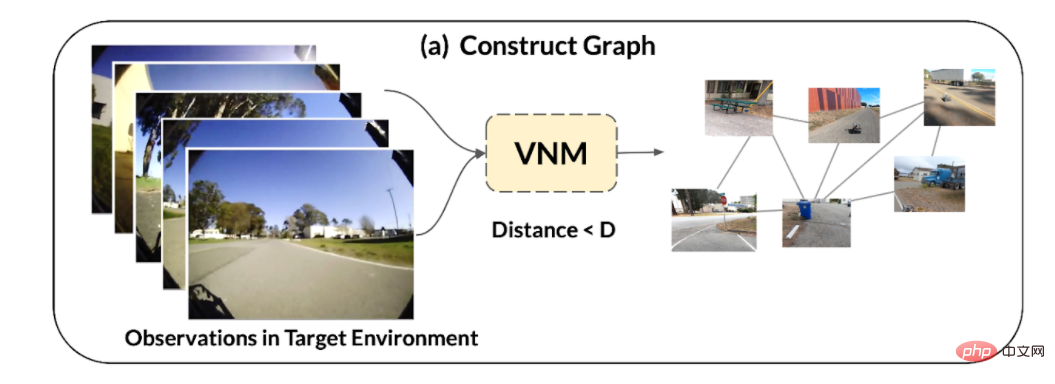

1. Memandangkan satu set pemerhatian dalam persekitaran sasaran, menggunakan fungsi jarak bersyarat sasaran, iaitu model navigasi visual (VNM) bahagian, membuat kesimpulan keterkaitan antara mereka, dan membina peta topologi ketersambungan dalam persekitaran.

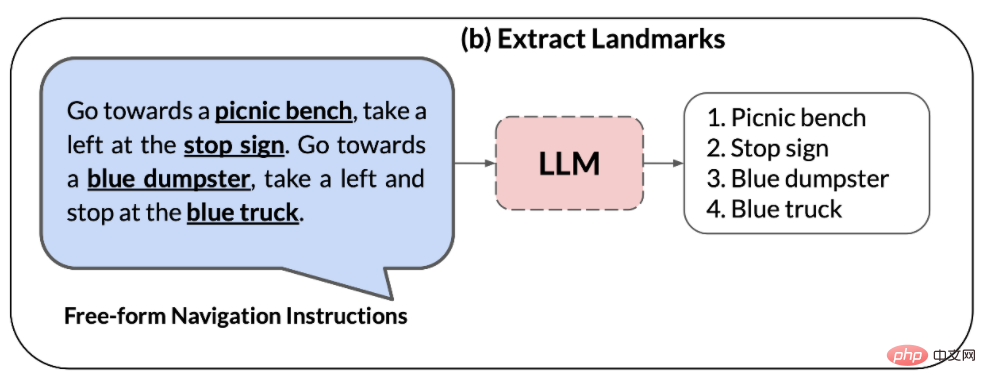

2. Model bahasa besar (LLM) digunakan untuk menghuraikan arahan bahasa semula jadi kepada satu siri titik ciri, titik Ciri ini boleh berfungsi sebagai submatlamat perantaraan untuk navigasi.

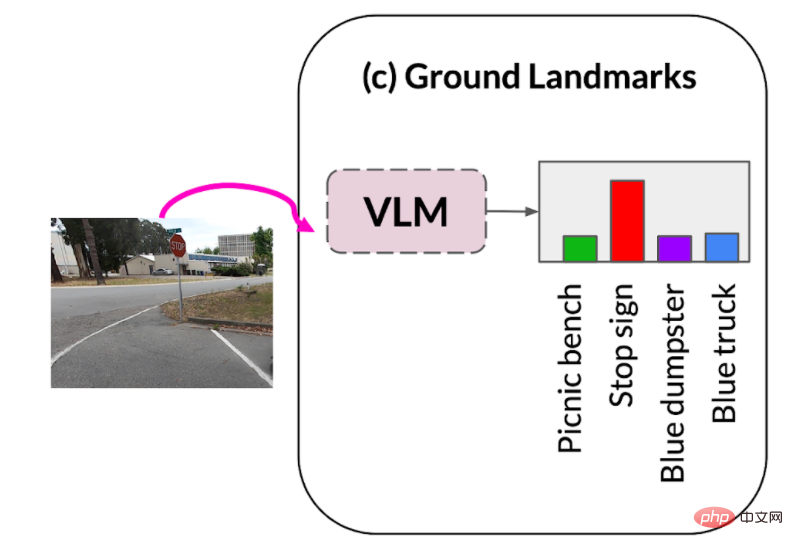

3. Model Visual-Bahasa (VLM) digunakan untuk membina pemerhatian visual berdasarkan frasa titik ciri. Model bahasa visual membuat kesimpulan taburan kebarangkalian bersama ke atas perihalan dan imej titik ciri (membentuk nod dalam graf di atas).

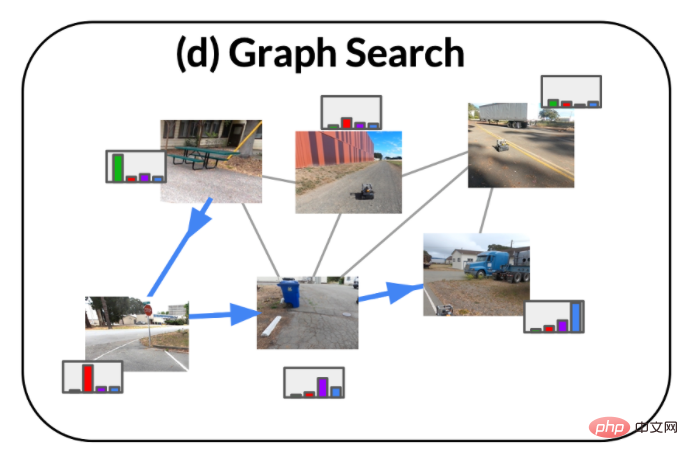

4 Menggunakan taburan kebarangkalian VLM dan kesambungan graf yang disimpulkan oleh VNM, menggunakan algoritma carian baru , mendapatkan semula laluan arahan optimum dalam persekitaran, yang (i) memenuhi arahan asal dan (ii) ialah laluan terpendek dalam graf yang boleh mencapai matlamat.

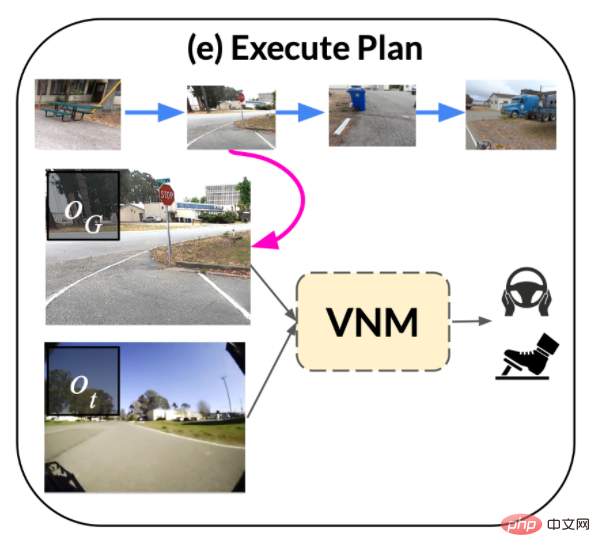

5. Kemudian, laluan arahan dilaksanakan oleh dasar keadaan sasaran, yang merupakan sebahagian daripada VNM.

Hasil eksperimen

Penilaian kualitatif

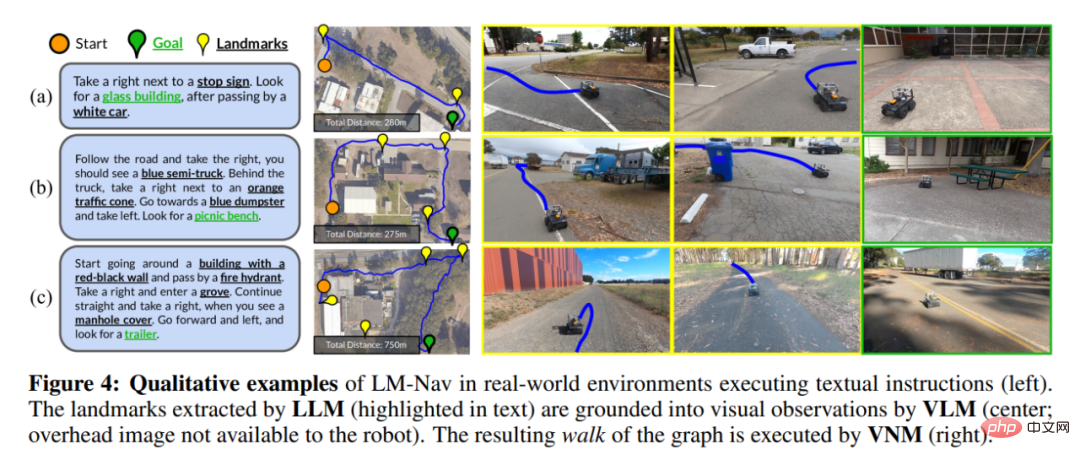

Rajah 4 menunjukkan beberapa contoh laluan yang diambil oleh robot . (Perhatikan bahawa robot tidak boleh mendapatkan imej di atas kepala dan kedudukan spatial titik ciri, dan apa yang dipaparkan hanyalah kesan visual).

Dalam Rajah 4(a), LM-Nav berjaya mengesan titik ciri mudah daripada laluan sebelumnya dan mencari laluan menuju ke laluan pendek. Walaupun terdapat berbilang titik ciri tempat letak kereta dalam persekitaran, fungsi objektif dalam Persamaan 3 membolehkan robot memilih titik ciri tempat letak kereta yang betul dalam konteks, dengan itu meminimumkan jarak perjalanan keseluruhan.

Rajah 4(b) menyerlahkan keupayaan LM-Nav untuk menghuraikan laluan tertentu dengan berbilang titik ciri—walaupun sampai terus ke titik ciri terakhir ialah laluan terpendek apabila mengabaikan laluan arahan, robot masih laluan A yang melawati semua titik ciri dalam susunan yang betul boleh didapati.

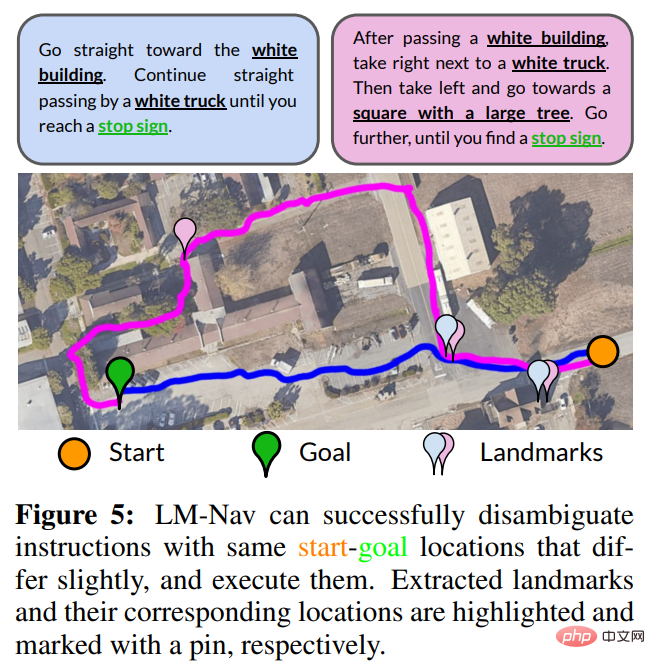

Gunakan arahan untuk nyahkekaburan. Memandangkan matlamat LM Nav adalah untuk mengikut arahan, bukan sekadar mencapai matlamat akhir, arahan yang berbeza mungkin menghasilkan laluan yang berbeza. Rajah 5 menunjukkan contoh yang mengubah suai arahan boleh menyahkekaburan berbilang laluan ke matlamat. Untuk gesaan yang lebih pendek (biru), LM Nav lebih suka laluan yang lebih terus. Apabila menentukan laluan yang lebih halus (magenta), LM Nav mengambil laluan alternatif melalui set titik ciri yang berbeza.

Situasi di mana titik ciri tiada. Walaupun LM-Nav boleh menghuraikan titik ciri secara berkesan dalam arahan, mencarinya pada graf dan mencari laluan ke matlamat, proses ini bergantung pada andaian bahawa titik ciri (i) wujud dalam persekitaran sebenar, dan (ii) boleh diiktiraf oleh VLM. Rajah 4(c) menunjukkan situasi di mana laluan boleh laku gagal melawat salah satu titik ciri—pili api—dan mengambil laluan di sekitar bahagian atas bangunan dan bukannya bahagian bawah. Kes kegagalan ini disebabkan oleh ketidakupayaan VLM untuk mengesan pili bomba daripada pemerhatian robot.

Dalam menilai secara bebas keberkesanan VLM dalam mendapatkan titik ciri, para penyelidik mendapati bahawa walaupun ia adalah model luar biasa terbaik untuk jenis tugasan ini, CLIP tidak dapat mendapatkan sebilangan kecil titik ciri "keras" , termasuk pili bomba dan pembancuh simen. Tetapi dalam banyak situasi dunia sebenar, robot masih boleh berjaya mencari jalan untuk melawati titik ciri yang tinggal.

Penilaian Kuantitatif

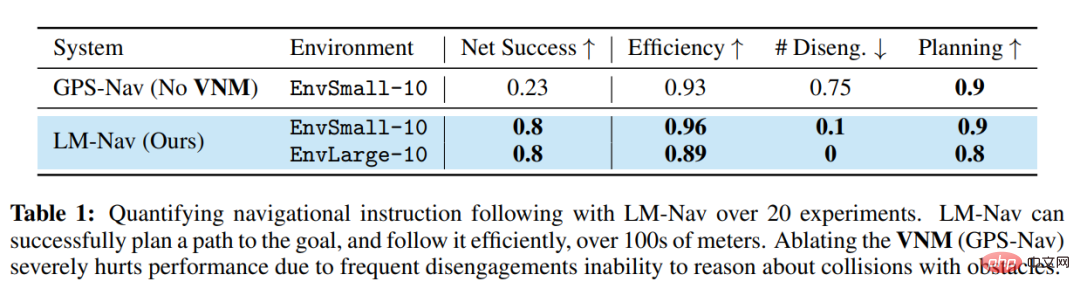

Jadual 1 meringkaskan prestasi kuantitatif sistem dalam 20 arahan. Dalam 85% eksperimen, LM-Nav dapat mengikut arahan secara konsisten tanpa perlanggaran atau detasmen (purata satu campur tangan setiap 6.4 kilometer perjalanan). Berbanding dengan garis dasar tanpa model navigasi, LM-Nav secara konsisten menunjukkan prestasi yang lebih baik dalam melaksanakan laluan sasaran yang cekap dan bebas perlanggaran. Dalam semua percubaan yang tidak berjaya, kegagalan boleh dikaitkan dengan keupayaan yang tidak mencukupi dalam fasa perancangan—ketidakupayaan algoritma carian untuk mengesan titik ciri "keras" tertentu secara intuitif dalam graf—mengakibatkan pelaksanaan arahan yang tidak lengkap. Siasatan ke atas mod kegagalan ini mendedahkan bahawa bahagian sistem yang paling kritikal ialah keupayaan VLM untuk mengesan titik ciri yang tidak dikenali, seperti pili bomba, dan pemandangan di bawah keadaan pencahayaan yang mencabar, seperti imej yang kurang terdedah.

Atas ialah kandungan terperinci Kerja baharu guru pembelajaran pengukuhan Sergey Levine: Tiga model besar mengajar robot mengenali cara mereka. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI