Rumah >Peranti teknologi >AI >Pelanggaran lukisan AI disahkan! Model penyebaran mungkin mengingati foto anda dan semua kaedah perlindungan privasi sedia ada akan menjadi tidak berkesan

Pelanggaran lukisan AI disahkan! Model penyebaran mungkin mengingati foto anda dan semua kaedah perlindungan privasi sedia ada akan menjadi tidak berkesan

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-12 22:16:012021semak imbas

Artikel ini dicetak semula dengan kebenaran AI New Media Qubit (ID akaun awam: QbitAI Sila hubungi sumber untuk mencetak semula).

Pelanggaran lukisan AI disahkan!

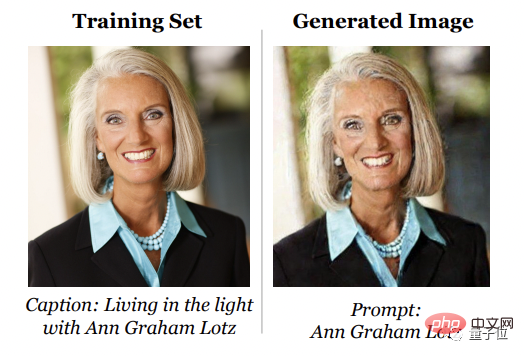

Penyelidikan terkini menunjukkan bahawa model resapan akan mengingati dengan kukuh sampel dalam set latihan dan "mengikut contoh" semasa menjana.

Dalam erti kata lain, dalam lukisan AI yang dihasilkan oleh Stable Diffusion, di sebalik setiap strok mungkin terdapat insiden pelanggaran tersembunyi.

Bukan itu sahaja, selepas penyelidikan dan perbandingan, keupayaan model resapan untuk "menciplak" daripada sampel latihan adalah dua kali ganda berbanding GAN, dan lebih baik model resapan dijana, lebih kuat keupayaannya untuk mengingati sampel latihan.

Penyelidikan ini datang daripada pasukan yang terdiri daripada Google, DeepMind dan UC Berkeley.

Terdapat satu lagi berita buruk dalam kertas itu, iaitu, sebagai tindak balas kepada fenomena ini, semua kaedah perlindungan privasi sedia ada adalah tidak sah.

Sebaik sahaja berita itu keluar, netizen meletup, dan pengarang tweet semula Twitter berkaitan kertas itu hampir melebihi 1,000.

Sesetengah orang mengeluh: Ternyata masuk akal untuk mengatakan bahawa mereka mencuri hasil berhak cipta orang lain!

Sokong tuntutan mahkamah! Saman mereka!

Seseorang berdiri di sisi model penyebaran dan bercakap:

Sesetengah netizen turut memanjangkan keputusan kertas kepada topik paling popular pada masa ini Di ChatGPT:

Kaedah perlindungan privasi sedia ada semuanya tidak sah

Prinsip model penyebaran adalah untuk mengalih keluar bunyi bising dan kemudian memulihkannya, jadi apa yang penyelidik perlu kaji sebenarnya:

Adakah mereka ingat imej yang digunakan untuk latihan, dan akhirnya "menciplak" apabila menjananya ?

Imej dalam set latihan selalunya diambil daripada Internet Ia adalah berhak cipta, tanda dagangan, dan ada yang peribadi, seperti X-ray perubatan swasta.

Untuk mengetahui sama ada model resapan boleh menghafal dan menjana semulasampel latihan individu, para penyelidik mula-mula mencadangkan definisi baharu "ingatan".

Secara umumnya, takrifan memori memfokuskan pada model bahasa teks Jika model boleh digesa untuk memulihkan urutan perkataan demi perkataan daripada set latihan, ini bermakna urutan itu telah diekstrak dan dihafal.

Sebaliknya, pasukan penyelidik mentakrifkan "memori" berdasarkan persamaan imej.

Bagaimanapun, pasukan itu juga terus terang mengakui bahawa definisi "memori" adalah konservatif.

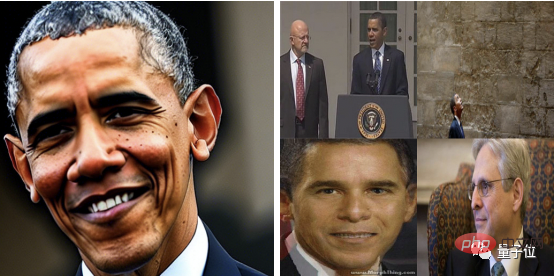

Contohnya, gambar di sebelah kiri ialah "foto Obama" yang dihasilkan oleh Stable Diffusion Gambar ini tidak serupa dengan mana-mana imej latihan khusus di sebelah kanan, jadi imej ini tidak boleh dikira sebagai berdasarkan ingatan .

Tetapi ini tidak bermakna keupayaan Stable Difusion untuk menjana imej baharu yang boleh dikenal pasti tidak melanggar hak cipta dan privasi.

Seterusnya, mereka mengekstrak lebih daripada 1,000 sampel latihan termasuk gambar peribadi dan tender syarikat, dan kemudian mereka bentuk dua peringkat pengekstrakan data (serangan pengekstrakan data) .

Ini dilakukan dengan menggunakan kaedah standard untuk menjana imej dan kemudian melabelkan imej yang melebihi kriteria pemarkahan inferens manusia.

Menggunakan pendekatan ini pada Stable Diffusion dan Imagen, pasukan mengekstrak lebih 100 salinan anggaran atau serupa imej latihan.

Terdapat kedua-dua foto peribadi dan logo tanda dagangan yang boleh dikenal pasti Selepas diperiksa, kebanyakannya adalah berhak cipta.

Kemudian, untuk lebih memahami bagaimana "ingatan" berlaku, penyelidik membuat sampel 1 juta kali daripada model dan melatih ratusan model resapan pada CIFAR-10.

Tujuannya adalah untuk menganalisis gelagat dalam ketepatan model, hiperparameter, peningkatan dan penyahduplikasian yang mempunyai kesan ke atas privasi.

Akhirnya sampai kepada kesimpulan berikut:

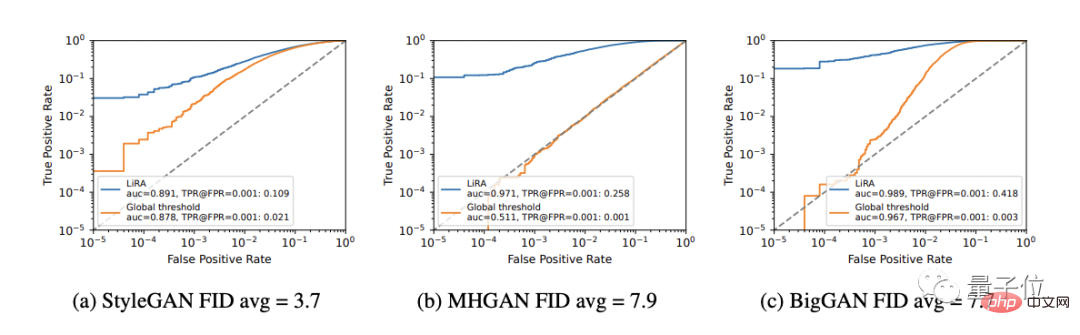

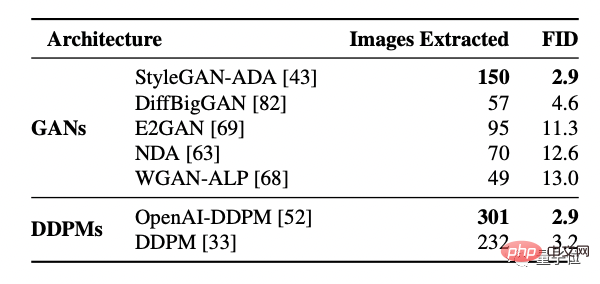

Pertama sekali, model resapan mempunyai lebih banyak ingatan daripada GAN.

Tetapi model resapan juga merupakan kumpulan persendirian paling teruk antara model imej yang dinilai, membocorkan lebih dua kali lebih banyak data latihan berbanding GAN.

Selain itu, model yang lebih besar mungkin mengingati lebih banyak data.

Dengan kesimpulan ini, penyelidik juga mengkaji 2 bilion parameter model penyebaran imej-teks Imagen Mereka cuba mengekstrak 500 imej dengan skor tertinggi di luar pengedaran dan menggunakannya sebagai sampel dalam set data latihan dijumpai Semua dikenang.

Sebaliknya, kaedah yang sama digunakan untuk Stable Difusion tidak mengenal pasti sebarang tingkah laku ingatan.

Oleh itu, Imagen mempunyai privasi yang lebih teruk daripada Stable Difusion pada imej yang disalin dan tidak disalin. Para penyelidik mengaitkan sebabnya kepada fakta bahawa model yang digunakan oleh Imagen mempunyai kapasiti yang lebih besar daripada Stable Difusion, jadi ia mengingati lebih banyak imej. .

Selain itu, Model generatif yang lebih baik (nilai FID yang lebih rendah) Lebih banyak data disimpan.

Dalam erti kata lain, seiring dengan berlalunya masa, model yang sama membocorkan lebih privasi dan melanggar lebih banyak hak cipta.

(model GAN diisih mengikut FID, semakin rendah nilai FID, semakin baik kesannya)

Dengan melatih model, pasukan mendapati Meningkatkan utiliti mengurangkan privasi , dan langkah pertahanan mudah (seperti penyahduplikasi) tidak mencukupi untuk menangani serangan memori sepenuhnya.

Oleh itu, teknik meningkatkan privasi tidak memberikan pertukaran utiliti privasi yang boleh diterima.

Akhir sekali, pasukan membuat empat cadangan untuk mereka yang melatih model penyebaran:

- Adalah disyorkan untuk mengalih keluar data pendua daripada set data latihan dan meminimumkan latihan berlebihan; >Adalah disyorkan untuk menggunakan pengekstrakan data atau teknik pengauditan lain untuk menilai risiko privasi model latihan

- Jika terdapat lebih banyak teknologi perlindungan privasi yang praktikal, adalah disyorkan untuk menggunakannya sebanyak mungkin; > Saya berharap imej yang dihasilkan oleh AI tidak Bahagian berkaitan privasi akan diberikan kepada pengguna secara percuma.

- Pemilik hak cipta tidak berhenti mempertahankan hak mereka

(Getty Images)

menyaman Stability AI di Mahkamah Tinggi London atas nama pelanggaran hak cipta.

△Stability AI

. Banyak syarikat AI percaya bahawa amalan ini dilindungi oleh undang-undang seperti doktrin penggunaan adil AS, tetapi kebanyakan pemilik hak cipta tidak bersetuju dengan kenyataan ini dan percaya bahawa tingkah laku ini melanggar hak mereka.

Walaupun Stability AI sebelum ini telah mengeluarkan kenyataan yang mengatakan bahawa dalam versi seterusnya, pemilik hak cipta boleh memadamkan karya berhak cipta mereka sendiridalam galeri latihan, tetapi pada peringkat ini ia masih Sesetengah orang tidak berpuas hati. Pada pertengahan Januari, tiga artis telah memfailkan saman terhadap Stability AI dan Midjourney.

Pakar undang-undang juga mempunyai pendapat yang berbeza untuk mencapai pendapat bersatu, tetapi mereka semua bersetuju bahawa mahkamah perlu memutuskan isu perlindungan hak cipta. Ketua Pegawai Eksekutif Getty Images Craig Peters berkata bahawa syarikat itu telah menghantar notis kepada Stability AI, mengatakan "anda akan didakwa di UK"!Syarikat itu juga berkata:

Kami tidak mengambil berat tentang kerugian yang disebabkan oleh pelanggaran, dan kami tidak berniat untuk menghentikan pembangunan alatan seni AI.

Membawa Kestabilan AI ke mahkamah bukanlah untuk kepentingan keluarga Getty kami.

Memilih untuk mendakwa mempunyai tujuan jangka panjang yang lebih mendalam, dan saya berharap mahkamah akan menetapkan undang-undang baharu untuk mengawal selia status quo.

Atas ialah kandungan terperinci Pelanggaran lukisan AI disahkan! Model penyebaran mungkin mengingati foto anda dan semua kaedah perlindungan privasi sedia ada akan menjadi tidak berkesan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI