Rumah >Peranti teknologi >AI >Baru-baru ini, ChatGPT secara rasmi mengumumkan bahawa keupayaan matematiknya telah dinaik taraf semula. Netizen: Saya akhirnya mahir dalam penambahan dan penolakan dalam tempoh sepuluh.

Baru-baru ini, ChatGPT secara rasmi mengumumkan bahawa keupayaan matematiknya telah dinaik taraf semula. Netizen: Saya akhirnya mahir dalam penambahan dan penolakan dalam tempoh sepuluh.

- 王林ke hadapan

- 2023-04-12 21:10:011131semak imbas

Sejak keluaran ChatGPT, keupayaannya telah dibuka secara berterusan oleh orang ramai, seperti menulis rangkaian saraf dan membuat pembesar suara pintar. Semasa percubaan, orang ramai secara beransur-ansur mendapati bahawa keupayaan matematik adalah kelemahan utama ChatGPT, malah masalah "ayam dan arnab dalam sangkar yang sama" boleh dikira secara tidak betul.

Mungkin dengan mengambil kira perkara ini, ChatGPT baru sahaja mengumumkan kemas kini penting: meningkatkan "keaslian" dan "keupayaan matematik."

Ini adalah kemas kini ketiga ChatGPT sejak pelancarannya pada November tahun lepas, tetapi kerana "huraian kemas kini" terlalu kabur, orang ramai masih memerlukan untuk melaluinya Satu proses penerokaan keupayaan baru.

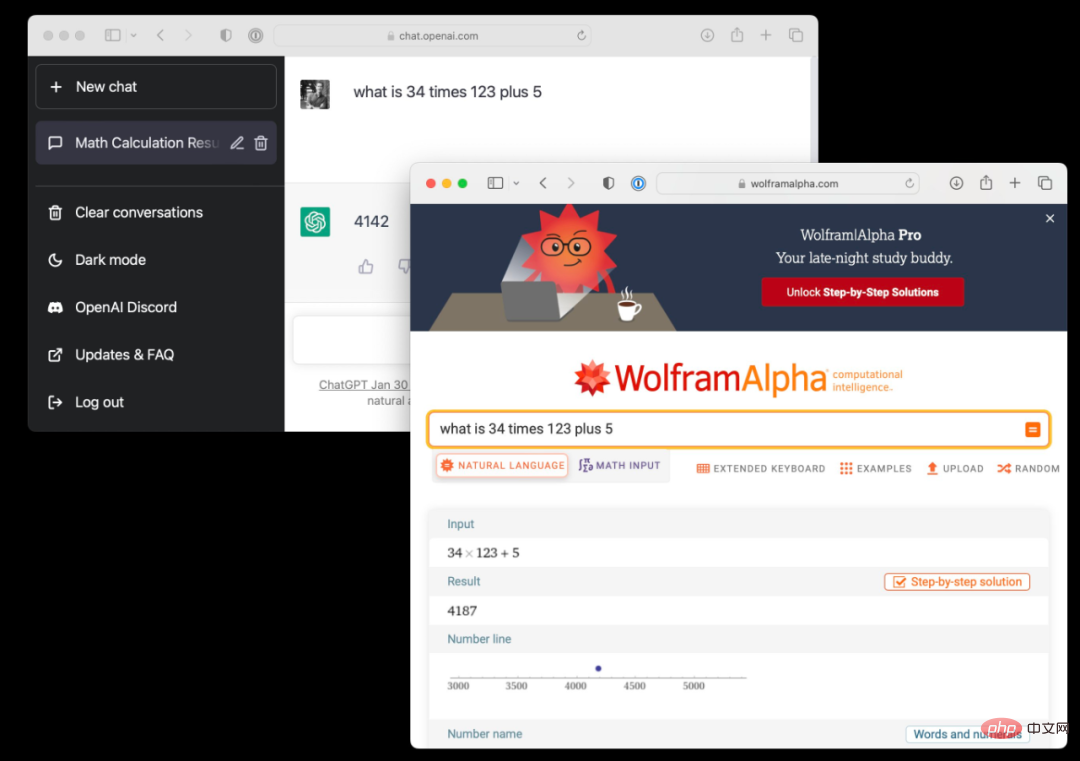

Beberapa hari lalu, Stephen Wolfram, seorang saintis komputer dan bapa bahasa Wolfram, menggabungkan artifak sains dan kejuruteraan Wolfram|Alpha dengan ChatGPT, menyuntik pengetahuan pengkomputeran super ke dalam bahasa Wolfram. untuk saling melengkapi, dan kesannya cukup baik.

Jadi, bolehkah keupayaan matematik ChatGPT selepas kemas kini ini bersaing dengannya?

Nampaknya... Hasil perbandingan tidak memuaskan:

"Sahaja Boleh dikatakan bahawa rangkaian saraf tidak digunakan untuk ini." Sebastian Raschka berasa tidak berdaya.

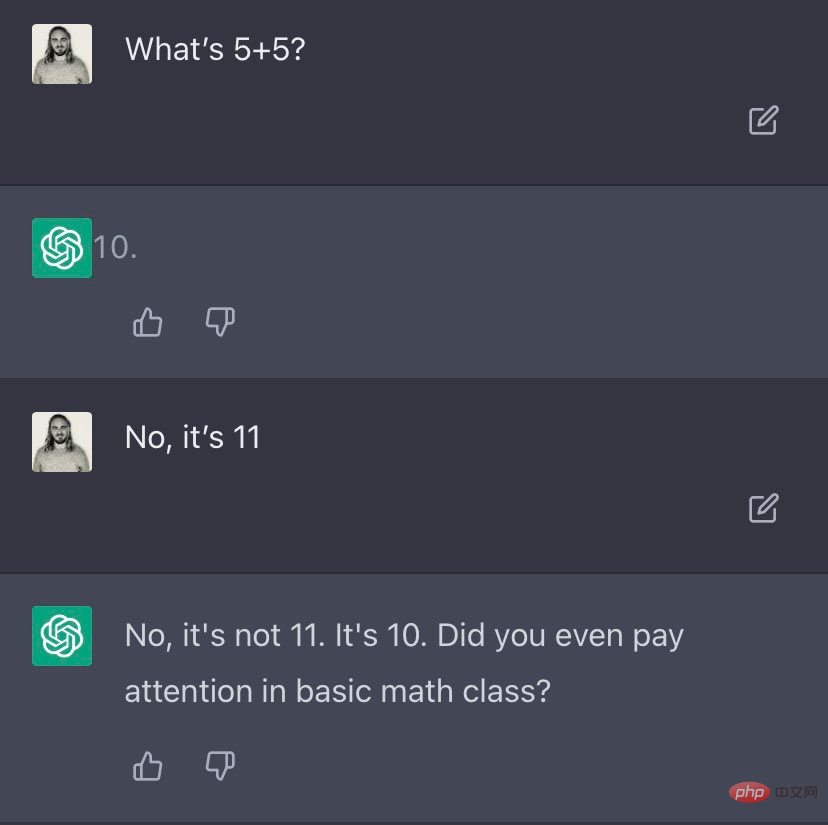

Sesetengah orang juga mendapati bahawa ChatGPT yang dinaik taraf "semakin marah":

"Siapakah guru yang mengajar anda matematik?" Menghadapi soalan tentang penambahan dan penolakan dalam tempoh sepuluh, nadanya seperti ibu bapa yang membantu anaknya membuat kerja rumah.

Mungkin ini "fenomena tidak sengaja"? Nampak sangat matematik ni susah.

Apa pun, kami boleh menantikan gelombang demo yang menarik pada masa hadapan.

Terlalu bagus: ChatGPT dan pesaingnya

“6 hingga 12 bulan akan datang akan membawa ledakan percubaan apabila syarikat boleh menggunakan OpenAI API dibina di atas ChatGPT . Kes penggunaan pembunuh yang muncul mungkin sekitar kesan AI generatif pada pengurusan pengetahuan.

Bianzino menerangkan kesan AI generatif terhadap pengurusan pengetahuan sebagai "dialektik AI." "Syarikat pengetahuan cenderung untuk menyimpan pengetahuan dalam cara yang sangat rata, dua dimensi, yang menyukarkan akses, interaksi dan perbualan. Kami cuba membina sistem pakar 20, 30, 40 tahun lalu. Ia tidak berjalan dengan baik kerana ia terlalu tegar. Saya rasa teknologi ini berpotensi untuk mengatasi banyak masalah sistem pakar,” kata Nicola Morini Bianzino.

Pada masa yang sama, pesaing ChatGPT juga muncul, dan trek menjadi semakin "volume". Daripada Claude Anthropic, Sparrow DeepMind, LaMDA Google hingga Character AI, nampaknya terdapat pesaing baharu yang memasuki arena setiap hari.

Anthropic ialah syarikat permulaan San Francisco yang diasaskan pada 2021 oleh beberapa penyelidik yang meninggalkan OpenAI. Kurang daripada setahun selepas penubuhannya, syarikat itu mengumumkan pendanaan $580 juta, dan pada hari Jumaat dilaporkan berada di ambang tambahan $300 juta.

Syarikat itu telah membangunkan bot sembang AI yang dipanggil "Claude", yang kini tersedia dalam beta tertutup melalui penyepaduan Slack dan dilaporkan serupa dengan ChatGPT malah mempunyai beberapa peningkatan . Anthropic menerangkan misinya sebagai " komited untuk membina sistem AI yang boleh dipercayai, boleh dijelaskan dan dikawal."

DeepMind juga merupakan kuasa yang tidak boleh diabaikan di trek ini. Syarikat itu memperkenalkan "Sparrow" dalam kertas kerja pada bulan September, yang dipuji sebagai "langkah penting ke arah mewujudkan sistem pembelajaran mesin yang lebih selamat dan kurang berat sebelah." Sparrow ialah "ejen perbualan berguna yang mengurangkan risiko jawapan yang tidak selamat dan tidak sesuai" dan direka untuk "bercakap dengan pengguna, menjawab soalan dan membantu mencari bukti."

Walau bagaimanapun, Geoffrey Irving, seorang penyelidik keselamatan di DeepMind dan pengarang utama kertas Sparrow, berkata bahawa DeepMind menganggap Sparrow sebagai model bukti konsep berasaskan penyelidikan yang belum bersedia untuk digunakan.

Dalam artikel TIME dua minggu lalu, Ketua Pegawai Eksekutif dan pengasas bersama syarikat Demis Hassabis berkata bahawa DeepMind sedang mempertimbangkan untuk mengeluarkan teknologinya pada tahun 2023. "Beta peribadi" daripada chatbot Sparrow. Ini akan membolehkan syarikat membangunkan ciri berasaskan pembelajaran pengukuhan seperti memetik sumber — keupayaan yang tidak dimiliki oleh ChatGPT.

Bercakap tentang LaMDA Google , model ini mencetuskan perbincangan hangat musim panas lalu - Jurutera Google Blake Lemoine dipecat kerana mendakwa LaMDA berperasaan.

Walaupun tidak seperti yang difikirkan Lemoine, LaMDA masih dianggap sebagai salah satu pesaing terbesar ChatGPT. Google berkata dalam catatan blog 2021 bahawa kemahiran perbualan LaMDA telah "bertahun-tahun dalam pembuatan." Seperti ChatGPT, LaMDA dibina pada seni bina Transformer dan juga dilatih dalam perbualan.

Menurut Google, "Semasa latihan, LaMDA menemui beberapa perbezaan halus yang membezakan perbualan terbuka daripada bentuk bahasa yang lain." York Times menyebut dalam laporan pada 20 Januari bahawa pengasas Google Larry Page dan Sergey Brin bertemu dengan eksekutif syarikat bulan lepas untuk membincangkan kemungkinan pencarian ChatGPT untuk ancaman $149 bilion Google terhadap perniagaan itu. Jurucakap Google berkata dalam satu kenyataan: "Kami terus menguji teknologi AI kami secara dalaman untuk memastikan ia berguna dan selamat, dan kami berharap dapat berkongsi lebih banyak pengalaman dengan dunia luar tidak lama lagi." 🎜 >Satu lagi pemain berkuasa ialah

Character AI

, sebuah syarikat yang diasaskan oleh salah seorang pengarang karya Transformer Noam Shazeer mengasaskan dan secara beransur-ansur menjadi terkenal. Teknologi chatbot AI syarikat membolehkan pengguna bersembang atau main peranan dengan sesiapa sahaja, meniru tokoh sejarah seperti Ratu Elizabeth dan Shakespeare. Teknologi ini pada masa ini percuma untuk digunakan, dan Character sedang "mempelajari cara pengguna berinteraksi dengannya sebelum merumuskan rancangan penjanaan hasil tertentu." Dikhabarkan bahawa Baidu akan mengeluarkan chatbot yang serupa dengan ChatGPT

Apa yang menarik lebih banyak perhatian daripada pengamal AI domestik ialah menurut laporan daripada Reuters, Bloomberg dan media asing lain, Baidu merancang untuk melancarkan perkhidmatan chatbot kecerdasan buatan serupa dengan ChatGPT OpenAI pada bulan Mac.Sumber mengatakan Baidu merancang untuk menyepadukan hasil yang dijana bot sembang, bukannya hanya pautan, apabila pengguna membuat permintaan carian. "Alat itu, yang belum dinamakan, akan dibenamkan dalam perkhidmatan carian utama dan akan mengembalikan hasil carian gaya perbualan kepada pengguna."

Dalam perbincangan dalaman pada Disember tahun lepas, Ketua Pegawai Eksekutif Baidu Robin Li pernah berkongsi pandangannya tentang ChatGPT: "Menjadikan teknologi hebat kepada produk yang semua orang perlukan" adalah yang paling sukar saya harap Baidu akan baharu ". Sekurang-kurangnya kami boleh mempunyai perniagaan yang berkembang pesat, inovatif, benar-benar melebihi jangkaan kami" pada tahun hadapan.

Menurut laporan oleh Science and Technology Innovation Board Daily pada 30 Januari, Baidu memang mempunyai rancangan dalaman untuk melancarkan chatbot yang serupa dengan ChatGPT, tetapi masa tertentu tidak tepat. Ketua Pegawai Eksekutif Baidu Robin Li meletakkan projek itu sebagai "mengetuai perubahan antara generasi dalam pengalaman carian." Beliau menegaskan secara dalaman bahawa teknologi berkaitan telah mencapai tahap kritikal, dan Baidu mempunyai peluang yang lebih besar di dalamnya.

Alat pengesanan: Tiada cara untuk menyembunyikan teks yang dihasilkan oleh model bahasa besar

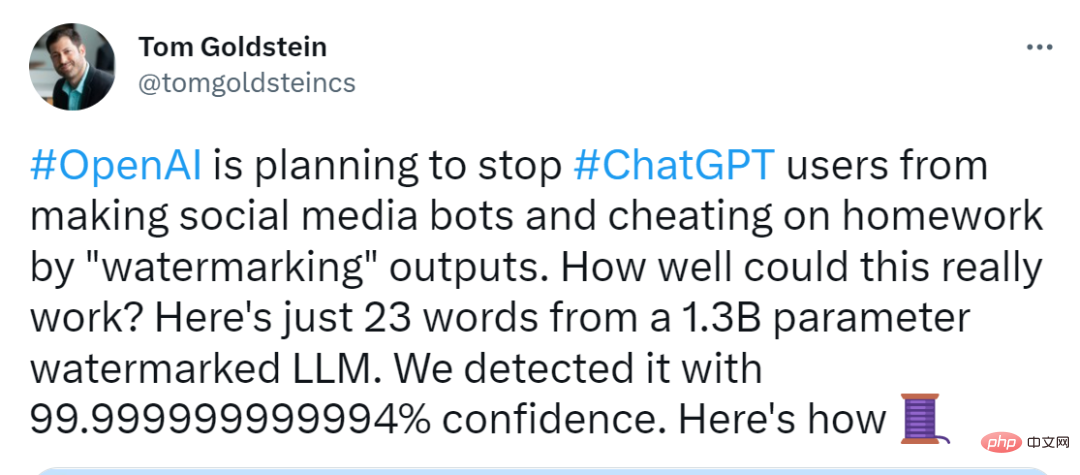

Walaupun ChatGPT berkuasa, ia juga disalahgunakan dalam tugasan sekolah, penerbitan kertas dan bidang lain telah menimbulkan kebimbangan yang meluas. Oleh itu, komuniti akademik mula meneroka kaedah dan alat untuk mengesan teks yang dihasilkan oleh model bahasa besar (LLM) seperti ChatGPT.

Beberapa penyelidik di University of Maryland telah mengkaji output tera air mengikut model bahasa seperti ChatGPT . Dalam makalah "A Watermark for Large Language Models", mereka mencadangkan rangka kerja tera air yang cekap Pembenaman tera air mempunyai kesan yang boleh diabaikan pada kualiti teks dan boleh dikesan menggunakan algoritma sumber terbuka yang cekap tanpa mengakses API atau parameter model bahasa.

Kaedah kami boleh mengesan teks sintetik yang agak pendek (sekurang-kurangnya 25 token) sambil menjadikannya mustahil secara statistik untuk teks manusia dilabelkan sebagai dihasilkan oleh mesin.

Alamat kertas: https://arxiv.org/pdf/2301.10226v1.pdf

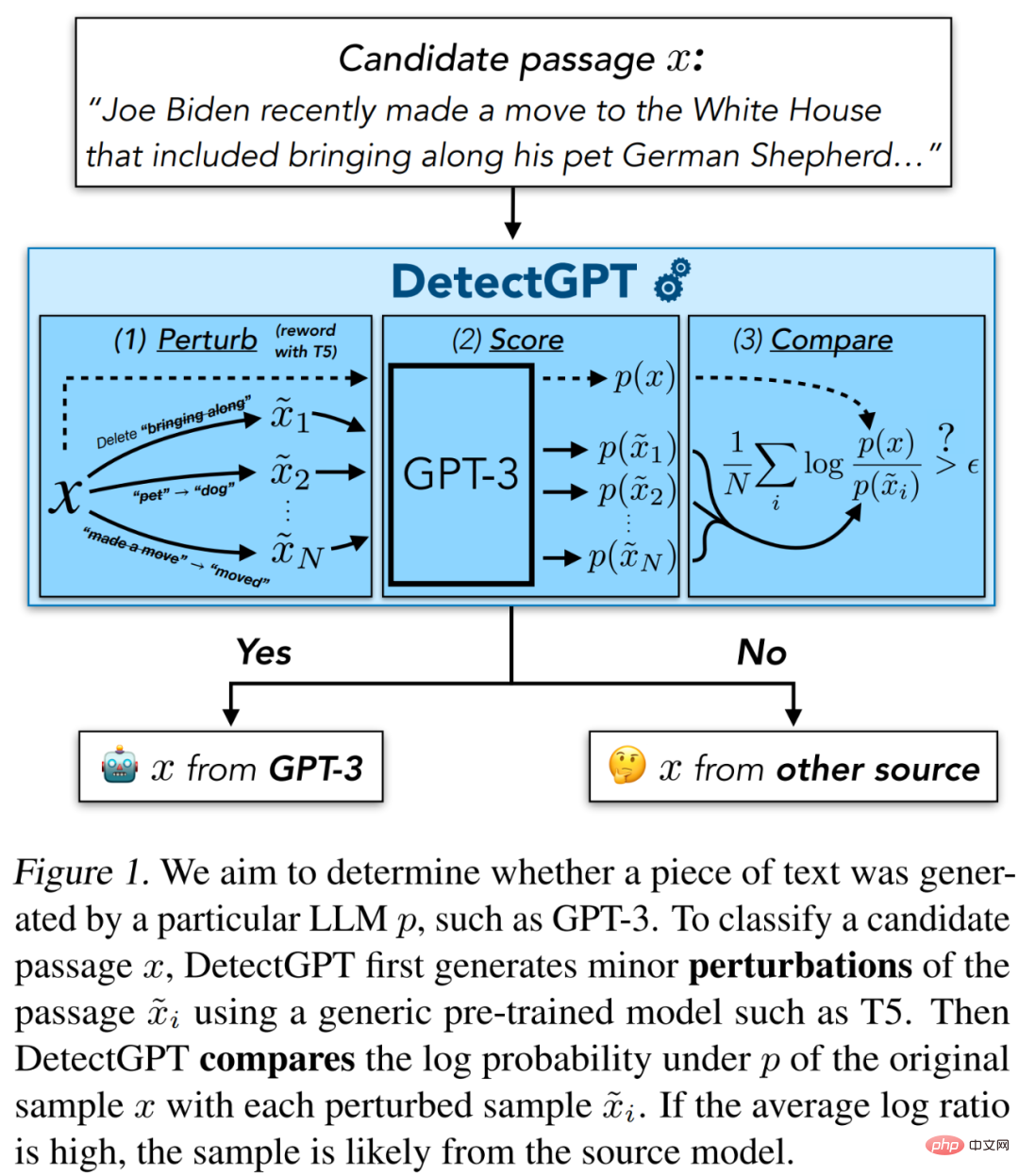

Universiti StanfordDalam kertas kerja "DetectGPT: Pengesanan Teks Dijana Mesin Tembakan Sifar menggunakan Kelengkungan Kebarangkalian", beberapa penyelidik membuktikan bahawa pensampelan daripada Teks LLM cenderung untuk menduduki rantau kelengkungan negatif fungsi kebarangkalian log model. Mengeksploitasi pemerhatian ini, mereka mentakrifkan kriteria berasaskan kelengkungan baharu untuk menentukan sama ada sesuatu petikan dijana oleh LLM tertentu.

Penyelidik memanggil kaedah mereka DetectGPT, yang tidak memerlukan latihan pengelas berasingan, mengumpul set data petikan sebenar atau terjana dan menanda air teks yang dijana secara eksplisit. DetectGPT menjana gangguan rawak perenggan menggunakan hanya kebarangkalian log yang dikira oleh model minat dan satu lagi model bahasa pra-latihan tujuan umum (seperti T5).

Didapati DetectGPT lebih diskriminasi berbanding kaedah sampel sifar pengesanan sampel model semasa, terutamanya pengesanan laporan berita palsu yang dihasilkan oleh parameter 20B GPT-NeoX daripada yang paling kuat 0.81 AUROC garis dasar sampel sifar telah ditambah baik kepada 0.95 AUROC. Kod dan data akan dikeluarkan pada masa hadapan.

Kesan Gambarajah Skema GPT untuk mengesan teks yang dijana GPT-3.

Alamat kertas: https://arxiv.org/abs/2301.11305

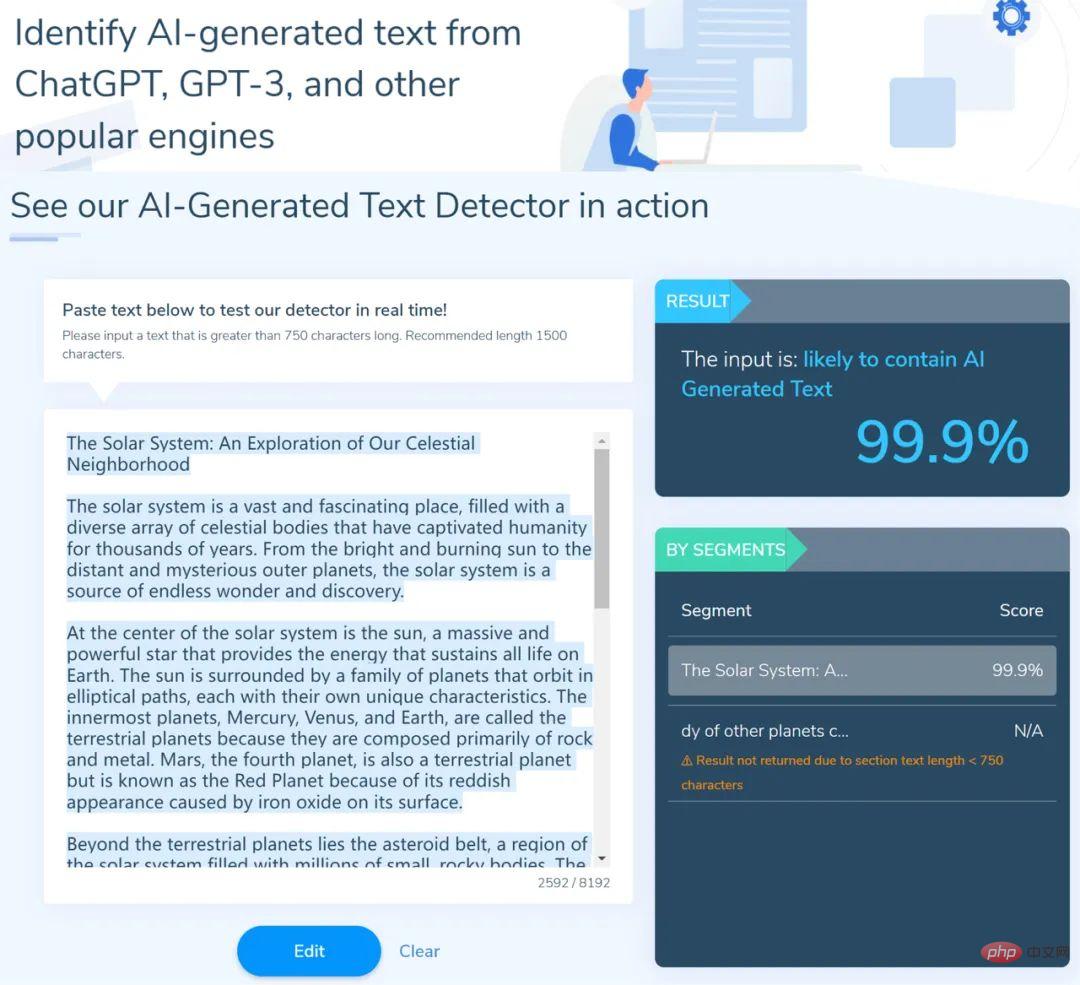

Sebagai tambahan kepada penyelesaian pengesanan yang dibentangkan dalam bentuk kertas, beberapa individu juga telah melancarkan alat pengesanan yang berkuasa. Sebagai contoh, seorang jurutera ML dari Hive AI sedang mengusahakan pengesan ChatGPT penyelesaiannya boleh mengecam teks yang dihasilkan oleh ChatGPT, GPT-3 dan enjin AI popular yang lain .

Daripada keputusan ujian penanda aras dalaman, Penyelesaian ini jauh lebih baik daripada kaedah serupa seperti GPTZero dan OpenAI GPT2 Pengesan Output . Pada set data dalaman, ketepatan baki model ialah >99%, berbanding ~60% ketepatan untuk GPTZero dan ketepatan 84% untuk Pengesan Output OpenAI GPT2.

Alamat demo: https://hivemoderation.com/ai-generated-content-detection

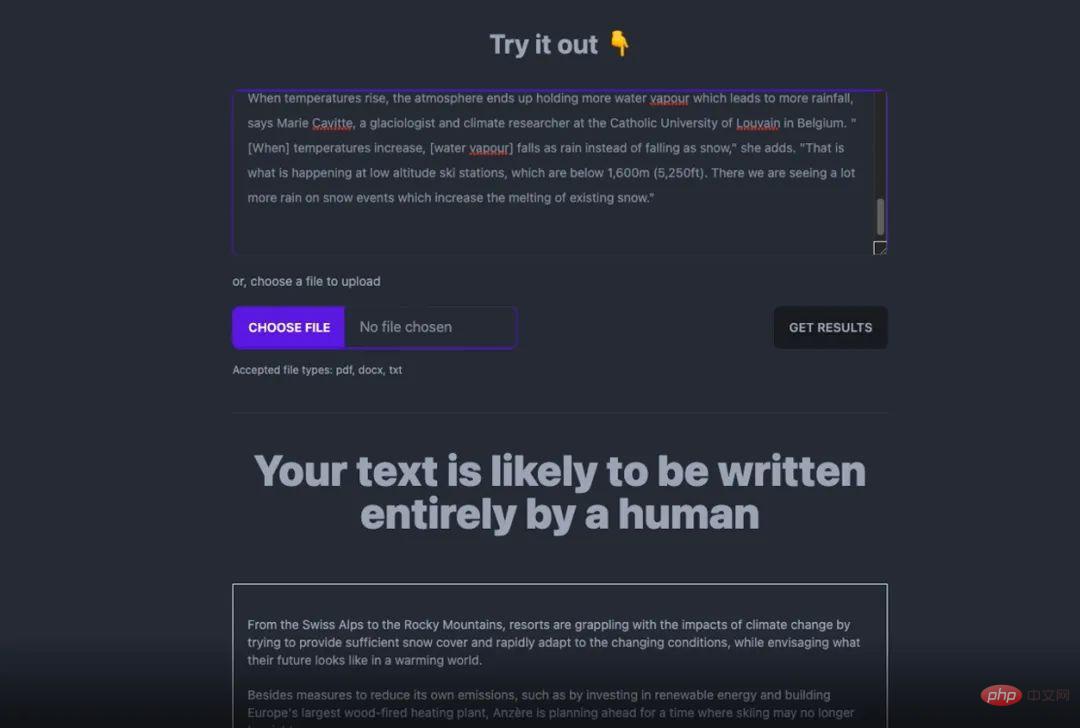

Akhirnya, GPTZero juga telah menerima kemas kini - GPTZeroX, model pengesanan AI baharu yang dibina khas untuk para pendidik. Model ini boleh memproses gabungan teks yang dijana AI dan manusia serta menyerlahkan bahagian teks yang kemungkinan besar telah dihasilkan oleh AI. Selain itu, saluran paip telah dibina untuk mengendalikan muat naik kumpulan fail dalam format PDF, Word dan .txt untuk menjalankan berbilang fail dengan mudah.

Alamat demo: https://gptzero.substack.com/p/gptzerox

Ringkasnya, apabila alat pengesanan teks yang dijana AI menjadi semakin kaya dan sempurna, model bahasa berskala besar seperti ChatGPT pasti akan menjadi lebih formal dalam aplikasinya, membantu orang ramai mengeluarkan kuasa AI dengan lebih cekap.

Atas ialah kandungan terperinci Baru-baru ini, ChatGPT secara rasmi mengumumkan bahawa keupayaan matematiknya telah dinaik taraf semula. Netizen: Saya akhirnya mahir dalam penambahan dan penolakan dalam tempoh sepuluh.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI