Rumah >Peranti teknologi >AI >Pada hari pertama 2023, sila semak ringkasan akhir tahun ChatGPT!

Pada hari pertama 2023, sila semak ringkasan akhir tahun ChatGPT!

- PHPzke hadapan

- 2023-04-12 18:31:041056semak imbas

Kemunculan ChatGPT mungkin merupakan penemuan AI yang paling menarik perhatian pada separuh kedua 2022, walaupun ia mungkin bukan yang paling teknikal.

Tidak lama dahulu, pada NeurIPS 2022 yang diadakan di New Orleans, khabar angin tentang GPT-4 tidak berkesudahan Pada masa yang sama, OpenAI juga menjadi tumpuan tumpuan media.

OpenAI mengumumkan model baharu dalam siri GPT-3 model bahasa berskala besar AI: text-davinci-003, iaitu "GPT-3.5" siri" bahagian yang boleh meningkatkan prestasi dengan memproses arahan yang lebih kompleks dan menghasilkan kandungan yang lebih berkualiti dan lebih panjang.

Model baharu dibina di atas InstructGPT dan menggunakan pembelajaran pengukuhan dengan maklum balas manusia untuk menjadikan model bahasa lebih serasi dengan manusia Arahan lebih diselaraskan.

DaVinci-003 ialah pembelajaran pengukuhan sebenar dengan model maklum balas manusia (RLHF) yang telah terbukti berjaya dalam demonstrasi manusia dan sampel model skor tinggi Gunakan diawasi penalaan halus untuk meningkatkan kualiti penjanaan. "

Sebagai bahagian lain daripada "siri GPT-3.5", OpenAI mengeluarkan demonstrasi awal ChatGPT. Syarikat itu mendakwa model perbualan interaktif ini, Bukan sahaja bolehkah anda menjawab sejumlah besar soalan susulan, tetapi anda juga boleh mengakui kesilapan, mencabar premis yang salah dan menolak permintaan yang tidak sesuai.

OpenAI menyatakan dalam blog bahawa keluaran penyelidikan ChatGPT ialah “OpenAI secara berulang menggunakan AI yang semakin selamat dan berguna dalam sistem. Ia mengambil banyak pengajaran daripada penggunaan model terdahulu seperti GPT-3 dan Codex, menghasilkan pengurangan ketara dalam hasil keluaran yang berbahaya dan tidak realistik apabila memanfaatkan Pembelajaran Pengukuhan dengan Maklum Balas Manusia 🎜>

Selain itu, ChatGPT menekankan semasa latihan bahawa ia adalah model pembelajaran mesin Ini mungkin untuk mengelakkan persoalan "sama ada AI sedar" yang disebabkan oleh pertikaian Google's chatbot LaMDA tidak lama dahulu.

Sudah tentu, ChatGPT juga mempunyai had.

Dalam catatan blog, OpenAI memperincikan batasannya, termasuk kadangkala jawapan mungkin terdengar munasabah tetapi sebenarnya tidak betul atau fakta yang tidak masuk akal.

"Menyelesaikan masalah ini sangat mencabar kerana (1) pada masa ini tiada jaminan sumber yang boleh dipercayai semasa latihan pembelajaran pengukuhan; (2) ) melatih model dengan lebih berhati-hati dan menolak soalan yang mungkin dijawab dengan betul; (3) latihan yang diselia boleh mengelirukan model kerana jawapan yang ideal bergantung pada apa yang diketahui oleh model, bukan apa yang diketahui oleh manusia 》

Open AI mengatakan bahawa ChatGPT "kadangkala bertindak balas terhadap arahan berbahaya atau menunjukkan tingkah laku berat sebelah. Kami menggunakan API untuk memberi amaran atau menyekat jenis kandungan tidak selamat tertentu, tetapi Jangkakan beberapa negatif dan positif palsu pada masa ini. Kami sangat berminat untuk mengumpul maklum balas pengguna untuk membantu kerja berterusan kami untuk menambah baik model ini."

Walaupun ChatGPT mungkin masih mempunyai banyak masalah yang memerlukan penambahbaikan, kami tidak dapat menafikan bahawa sebelum debut GPT-4, ChatGPT masih berada di puncak besar semasa. -model aliran bahasa.

Namun, baru-baru ini dalam komuniti, terdapat model baharu yang telah mencetuskan semangat semua orang untuk berbincang. Perkara yang paling penting ialah ia adalah sumber terbuka.

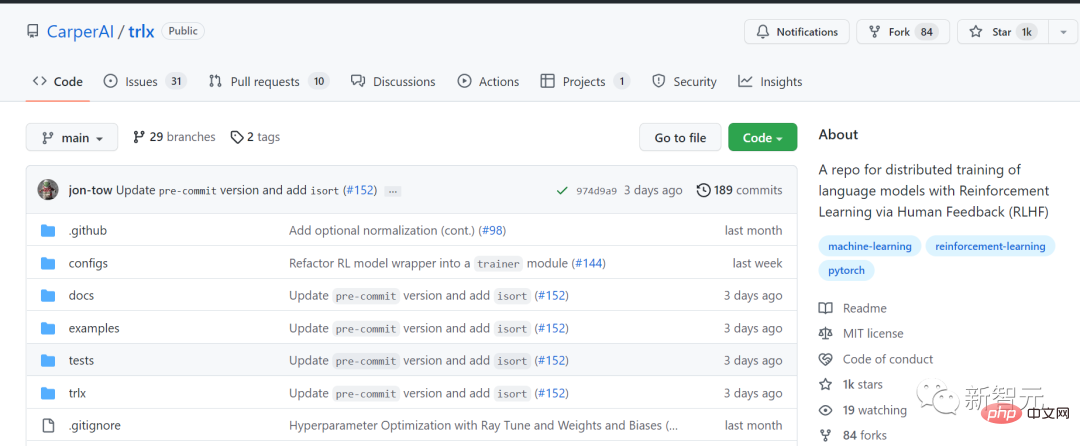

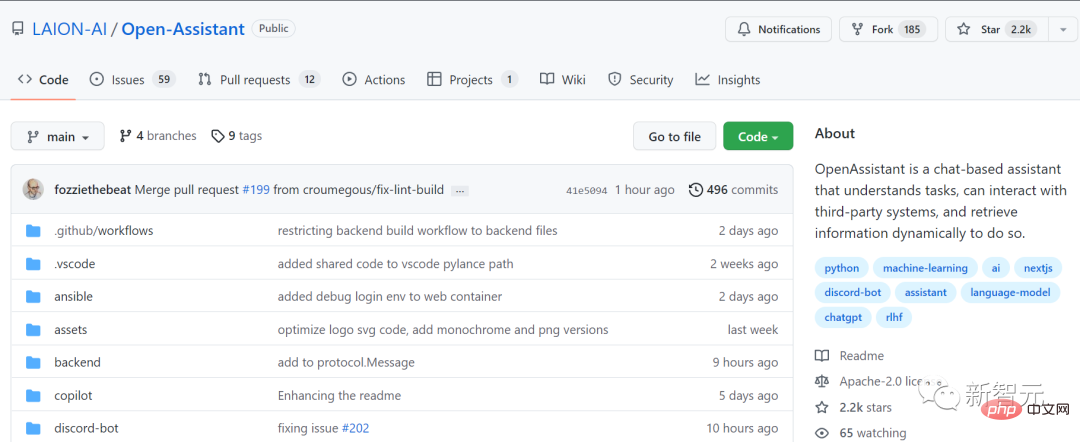

Minggu ini, Philip Wang, pembangun yang bertanggungjawab untuk sistem AI sumber tertutup kejuruteraan songsang termasuk Make-A-Video Meta, mengeluarkan PaLM + RLHF, yang merupakan penjanaan teks model yang berkelakuan serupa dengan ChatGPT. Alamat kod: https://github.com/lucidrains/PaLM-rlhf-pytorch Sistem ini menggabungkan model bahasa berskala besar Google PaLM dan pembelajaran pengukuhan dengan teknologi maklum balas manusia (RLHF) untuk mencipta sistem yang boleh menyelesaikan hampir semua tugas dalam ChatGPT, termasuk mendraf e-mel dan mencadangkan kod komputer. Sejak dikeluarkan, ChatGPT telah diiktiraf kerana keupayaannya menjana tinggi -takrifan teks seperti manusia , dan keupayaannya untuk menjawab soalan pengguna dengan cara perbualan, telah melanda dunia teknologi. Walaupun ini merupakan kemajuan besar pada peringkat awal pembangunan chatbot, ramai peminat dalam bidang kecerdasan buatan telah menyatakan kebimbangan tentang sifat tertutup ChatGPT. Sehingga hari ini, model ChatGPT kekal proprietari, bermakna kod asasnya tidak boleh dilihat oleh orang ramai. Hanya OpenAI yang benar-benar tahu cara ia berfungsi dan data yang diprosesnya. Kekurangan ketelusan ini boleh membawa akibat yang meluas dan boleh menjejaskan kepercayaan pengguna dalam jangka panjang. Ramai pembangun tidak sabar-sabar untuk membina alternatif sumber terbuka, dan kini, ia akhirnya di sini. PaLM+RLHF dibina khusus untuk bahasa Python dan boleh dilaksanakan untuk PyTorch. Pembangun boleh melatih PaLM semudah pengubah autoregresif dan kemudian menggunakan maklum balas manusia untuk melatih model ganjaran. Seperti ChatGPT, PaLM + RLHF pada asasnya ialah alat statistik untuk meramal perkataan. Apabila diberi sejumlah besar contoh daripada data latihan—seperti siaran daripada Reddit, artikel berita dan e-buku—PaLM+RLHF mengetahui kemungkinan sesuatu perkataan itu akan berlaku berdasarkan corak seperti konteks semantik teks sekeliling. Sudah tentu, masih terdapat jurang yang besar antara ideal dan realiti. PaLM + RLHF nampak sempurna, tetapi terdapat juga pelbagai masalah. Masalah terbesar ialah orang masih belum boleh menggunakannya. Untuk melancarkan PaLM + RLHF, pengguna perlu menyusun gigabait teks yang diperoleh daripada pelbagai sumber seperti blog, media sosial, artikel berita, e-buku, dsb. . Data ini disalurkan kepada model PaLm yang diperhalusi, yang menjana beberapa respons. Sebagai contoh, jika anda bertanya kepada model "Apakah pengetahuan asas ekonomi?", PaLm akan memberikan jawapan seperti "Ekonomi ialah sains sosial yang mengkaji...". Selepas itu, pembangun akan meminta orang ramai untuk menilai jawapan yang dijana oleh model daripada yang terbaik kepada yang paling teruk dan mencipta model ganjaran. Akhir sekali, kedudukan digunakan untuk melatih "model ganjaran", yang mengambil respons model asal dan menyusunnya mengikut keutamaan, menapis jawapan terbaik untuk gesaan yang diberikan. Walau bagaimanapun, ini adalah proses yang mahal. Mengumpul data latihan dan melatih model itu sendiri bukanlah murah. PaLM mempunyai 540 bilion parameter, yang merupakan bahagian model bahasa yang dipelajari daripada data latihan. Kajian 2020 menunjukkan bahawa membangunkan model penjanaan teks dengan hanya 1.5 bilion parameter akan menelan belanja sehingga $1.6 juta. Pada Julai tahun ini, untuk melatih model sumber terbuka Bloom dengan 176 bilion parameter, penyelidik Hugging Face menghabiskan masa tiga bulan dan menggunakan 384 NVIDIA A100 GPU. Setiap A100 berharga beribu-ribu dolar, yang bukan kos yang mampu dimiliki oleh mana-mana pengguna biasa. Tambahan pula, walaupun selepas latihan model selesai, menjalankan model bersaiz PaLM + RLHF bukanlah perkara remeh. Bloom mempunyai PC khusus dengan lapan GPU A100, dan GPT-3 generasi teks OpenAI (dengan kira-kira 175 bilion parameter) berharga kira-kira $87,000 setahun untuk dijalankan. Meningkatkan aliran kerja pembangunan yang diperlukan juga boleh menjadi satu cabaran, penyelidik AI Sebastian Raschka menyatakan dalam artikel tentang PaLM + RLHF. "Walaupun seseorang memberi anda 500 GPU untuk melatih model ini, anda masih perlu berurusan dengan infrastruktur dan mempunyai rangka kerja perisian yang boleh mengendalikannya," katanya. "Walaupun ini boleh dilaksanakan, pada masa ini ia memerlukan banyak usaha." Kos yang tinggi dan skala besar kedua-duanya menunjukkan bahawa PaLM + RLHF pada masa ini tidak mempunyai keupayaan untuk menggantikan ChatGPT tanpa syarikat atau individu yang dibiayai dengan baik yang mengambil masalah untuk melatih model tersebut. Setakat ini, tiada tarikh keluaran tepat untuk PaLM + RLHF. Sebagai rujukan, ia mengambil masa tiga bulan untuk melatih Bloom. Sebagai perbandingan, PaLM + RLHF dengan 540 bilion parameter mungkin perlu menunggu 6-8 bulan untuk menghasilkan versi yang bermakna. Berita baiknya ialah setakat ini kami mempunyai tiga pemain yang diketahui bekerja pada alternatif sumber terbuka ini kepada ChatGPT: CarperAI merancang untuk bekerjasama dengan EleutherAI dan syarikat pemula Skala AI dan Wajah Pelukan untuk mengeluarkan model AI yang sedia untuk dijalankan, seperti ChatGPT dilatih dengan maklum balas manusia. Alamat kod: https://github.com/CarperAI/trlx LAION, organisasi bukan untung yang menyediakan set data awal untuk Stable Diffusion, juga menerajui projek untuk mereplikasi ChatGPT menggunakan teknologi pembelajaran mesin terkini. Alamat kod: https://github.com/LAION-AI/Open-Assistant LAION bertujuan untuk mencipta "pembantu masa depan" yang bukan sahaja boleh menulis e-mel dan surat lamaran, tetapi juga "melakukan kerja bermakna, menggunakan API, menyelidik maklumat secara dinamik, dsb." Ia berada di peringkat awal, tetapi projek dengan sumber berkaitan telah disiarkan secara langsung di GitHub beberapa minggu yang lalu. "4chan" dalam model ini ialah forum tanpa nama dalam talian Amerika Kerana identiti netizen adalah tanpa nama, ramai orang tidak gentar dan menyatakan pelbagai pendapat politik. Teguran yang tidak betul. Kilcher secara rasmi menggunakan siaran di 4chan untuk melatih model, dan hasilnya boleh diramal. Serupa dengan nada umum forum, jawapan GPT-4chan dipenuhi dengan perkauman, seksisme dan anti-Semitisme. Bukan itu sahaja, Kilcher juga menyiarkan model asasnya ke Hugging Face untuk dimuat turun oleh orang lain. Walau bagaimanapun, di bawah kecaman ramai penyelidik AI, pegawai dengan cepat menyekat akses netizen kepada model tersebut. Sementara kami menantikan kemunculan lebih banyak model bahasa sumber terbuka, yang boleh kami lakukan sekarang ialah menunggu. Sudah tentu, idea yang baik juga untuk terus menggunakan ChatGPT secara percuma. Perlu diambil perhatian bahawa OpenAI masih jauh ke hadapan dalam pembangunan sebelum mana-mana versi sumber terbuka dilancarkan secara rasmi. Pada tahun 2023, GPT-4 sudah pasti adalah perkara yang dinantikan oleh peminat AI di seluruh dunia. Kebanyakan gergasi AI telah membuat ramalan mereka sendiri mengenainya adalah baik atau buruk, tetapi seperti yang dikatakan oleh COO OpenAI Sam Altman: "Penyiapan kecerdasan buatan am akan lebih cepat daripada yang dibayangkan oleh kebanyakan orang. , dan ia mengubah semua yang kebanyakan orang bayangkan."

Kuasa PaLm + RLHF

Adakah ia sangat sempurna?

Sumber terbuka ChatGPT seterusnya

Atas ialah kandungan terperinci Pada hari pertama 2023, sila semak ringkasan akhir tahun ChatGPT!. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI