Rumah >Peranti teknologi >AI >Tanpa latihan hiliran, Tip-Adapter sangat meningkatkan ketepatan klasifikasi imej CLIP

Tanpa latihan hiliran, Tip-Adapter sangat meningkatkan ketepatan klasifikasi imej CLIP

- 王林ke hadapan

- 2023-04-12 15:25:261425semak imbas

- Pautan kertas: https://arxiv.org/pdf/2207.09519.pdf

- Pautan kod: https://github.com/gaopengcuhk/Tip-Adapter

1. Latar Belakang Penyelidikan

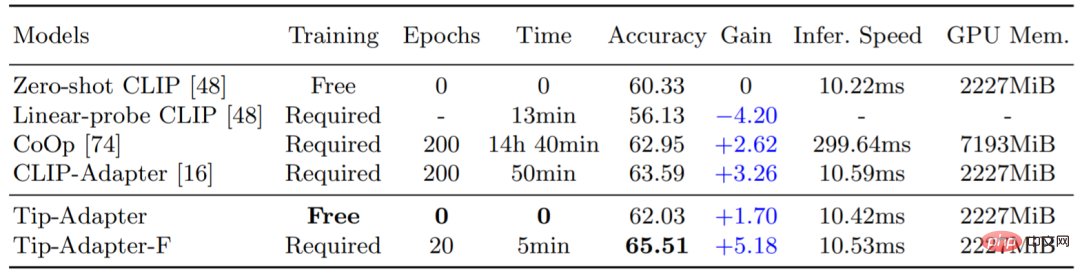

Model Pra-latihan Bahasa Imej Kontras (CLIP) baru-baru ini telah menunjukkan keupayaan pemindahan domain visual yang kukuh dan boleh melakukan pengecaman imej sifar tangkapan pada set data hiliran baharu. Untuk meningkatkan lagi prestasi migrasi CLIP, kaedah sedia ada menggunakan tetapan beberapa tangkapan, seperti CoOp dan CLIP-Adapter, yang menyediakan sejumlah kecil data latihan untuk set data hiliran, membolehkan CLIP membuat keputusan dengan lebih baik untuk senario visual yang berbeza . Walau bagaimanapun, langkah latihan tambahan ini akan membawa overhed sumber masa dan ruang yang banyak, yang pada tahap tertentu menjejaskan keupayaan pemindahan pengetahuan pantas yang wujud CLIP. Oleh itu, kami mencadangkan Penyesuai Petua, kaedah pengelasan imej beberapa tangkapan yang tidak memerlukan latihan hiliran tambahan dan boleh meningkatkan ketepatan CLIP dengan banyak. Berdasarkan ini, kami telah mencadangkan penyelesaian yang boleh mencapai prestasi terkini dengan hanya sedikit penalaan halus: Tip-Adapter-F, mencapai kompromi terbaik antara kecekapan dan prestasi. Seperti yang ditunjukkan dalam Jadual 1 di bawah, Tip-Adapter tidak memerlukan sebarang masa latihan, yang boleh meningkatkan CLIP dalam set data ImageNet sebanyak +1.7% ketepatan (Ketepatan), manakala Tip-Adapter-F hanya memerlukan satu persepuluh daripada masa latihan daripada penyelesaian sebelumnya (Epochs, Time), prestasi klasifikasi sedia ada yang terbaik boleh dicapai.

Jadual 1: Perbandingan ketepatan klasifikasi imej 16 tangkapan dan masa latihan skema berbeza pada dataset ImageNet

2. Kaedah Penyelidikan

1.Penyesuai Petua

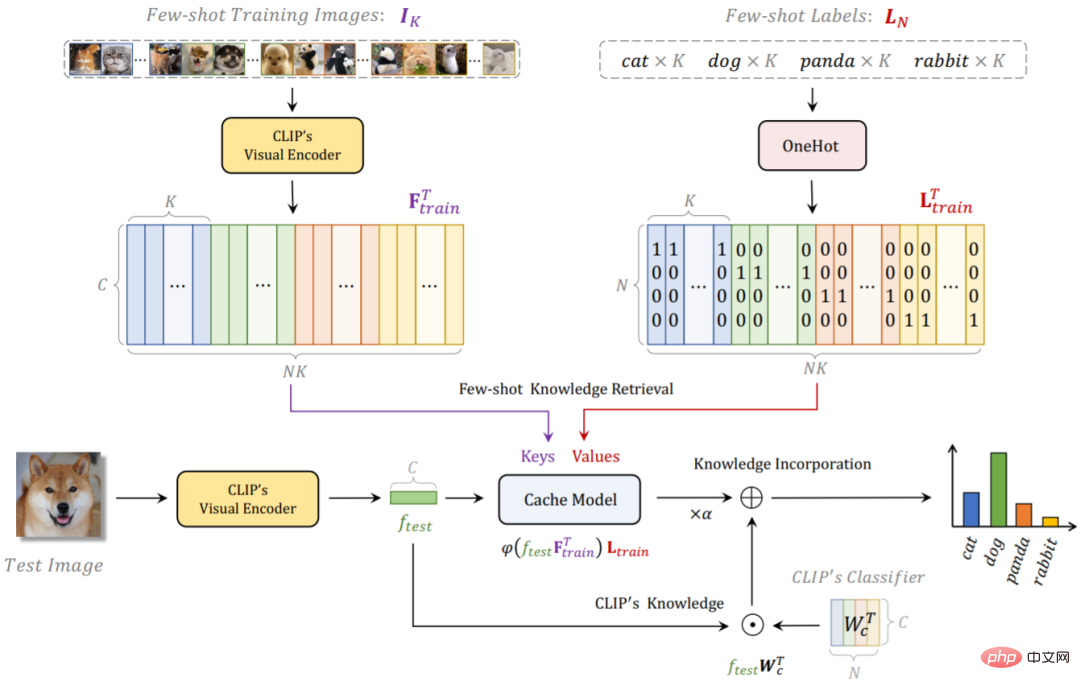

Struktur rangkaian keseluruhan Penyesuai Petua ditunjukkan dalam Rajah 1 di bawah Untuk set data dan label latihan beberapa pukulan, kami gunakan CLIP menggunakan penyelesaian bukan latihan untuk membina model cache (Model Cache), yang menyimpan pengetahuan klasifikasi daripada data latihan hiliran semasa ujian, Penyesuai Petua menambah ramalan Model Cache dan ramalan CLIP asal secara linear; memperoleh keputusan pengelasan akhir yang lebih kukuh.

Secara terperinci, kami menggunakan pengekod visual pra-latihan CLIP (Pengekod Visual) untuk mengekstrak ciri semua imej dalam set latihan beberapa tangkapan sebagai Kunci Model Cache; Tukar tag imej yang sepadan ke dalam bentuk pengekodan satu panas sebagai Nilai Model Cache. Kaedah pembinaan Model Cache Nilai Kunci ini tidak memerlukan sebarang overhed latihan kerana ia menggunakan Pengekod Visual yang telah terlatih dan memandangkan set latihan beberapa tangkapan hanya mengandungi sebilangan kecil imej untuk setiap kategori (1 hingga 16 tangkapan), Model Cache juga tidak menggunakan overhed memori grafik tambahan Rujuk kepada penunjuk GPU dalam Jadual 1.

Untuk imej ujian, kami akan menggunakan Pengekod Visual CLIP terlebih dahulu untuk mendapatkan ciri-cirinya, dan kemudian merawat ciri tersebut sebagai Model Pertanyaan kepada Cache untuk mendapatkan semula Pengetahuan data beberapa tangkapan hiliran. Memandangkan Kekunci juga diekstrak oleh Pengekod Visual CLIP, ia mempunyai asal yang sama dengan ciri imej ujian Query Kami boleh mengira secara langsung persamaan kosinus antara mereka untuk mendapatkan matriks bersebelahan Key-Query ini boleh dianggap sebagai setiap Berat yang sepadan kepada Nilai. Oleh itu, kita boleh mengira jumlah wajaran Nilai untuk mendapatkan ramalan pengelasan untuk imej ujian ini yang diperoleh dengan mendapatkan Model Cache. Selain itu, kami juga boleh mendapatkan ramalan tangkapan sifar CLIP dengan memadankan ciri imej ujian dengan ciri teks Pengekod Tekstual CLIP. Dengan menimbang jumlah kedua-duanya secara linear, kami memperoleh ramalan pengelasan akhir, yang mengandungi kedua-dua pengetahuan kontrastif bahasa imej yang telah dilatih oleh CLIP dan pengetahuan beberapa pukulan set data hiliran baharu, supaya ia boleh mencapai ramalan yang lebih tepat. Ketepatan klasifikasi imej yang kuat.

Berdasarkan struktur rangkaian Petua-Penyesuai, kami boleh menukar bahagian Kunci dalam Model Cache kepada parameter pembelajaran, yang boleh dikemas kini melalui latihan Penyelesaian ini ialah Penyesuai Petua - F. Dengan bantuan Model Cache yang telah dibina, Tip-Adapter-F hanya memerlukan satu persepuluh daripada pusingan latihan dan masa CLIP-Adapter sedia ada untuk mencapai prestasi yang lebih tinggi, seperti yang ditunjukkan dalam Jadual 1.

Rajah 1: Carta aliran rangkaian Penyesuai Petua dan Penyesuai Petua-F

2. Perbezaan dan sambungan antara Penyesuai Petua dan penyelesaian sedia ada

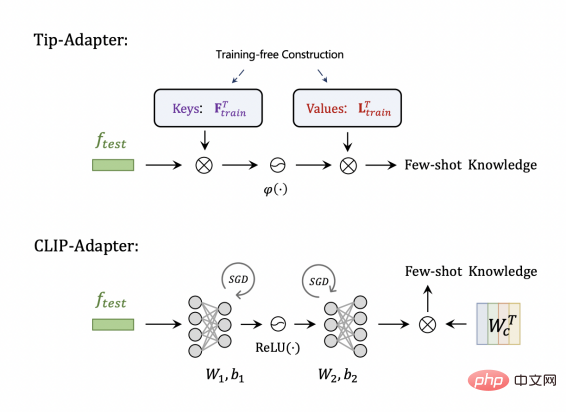

Membandingkan Penyesuai CLIP, seperti yang ditunjukkan dalam Rajah 2, Penyesuai Petua menyimpan Kunci dan Nilai Sebenarnya , mereka masing-masing boleh sepadan dengan dua lapisan linear struktur penyesuai dalam CLIP-Adapter, kecuali yang pertama tidak memerlukan latihan untuk membina, manakala yang kedua dimulakan secara rawak dan kemudian memerlukan latihan untuk mempelajari parameter terbaik.

Rajah 2: Tip-Adapter berbanding CLIP-Adapter

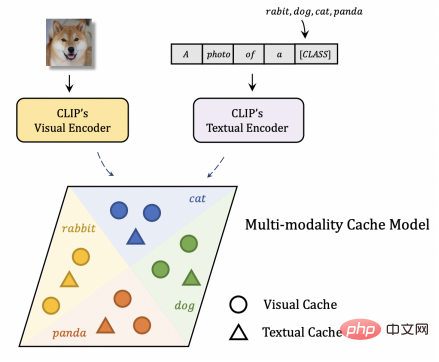

Berbanding dengan penyelesaian sedia ada lain untuk membina Model Cache, seperti yang ditunjukkan dalam Rajah 3, Model Cache bagi Tip-Adapter boleh dianggap sebagai Cache bahasa visual berbilang mod. Kerana ciri-ciri yang dikeluarkan oleh Pengekod Tekstual CLIP boleh dianggap sebagai Nilai-Kekunci teks, yang setara dengan menguji ciri imej sebagai Pertanyaan, masing-masing mendapatkan pengetahuan dalam Cache visual dan teks Berbanding dengan penyelesaian sedia ada yang hanya mengandungi Cache visual, Tip-Adapter boleh menggunakan pengetahuan pelbagai mod untuk mendapatkan prestasi pengecaman yang lebih kukuh.

Rajah 3: Petua Penyesuai berbanding penyelesaian lain untuk membina Model Cache

Tiga. Keputusan percubaan

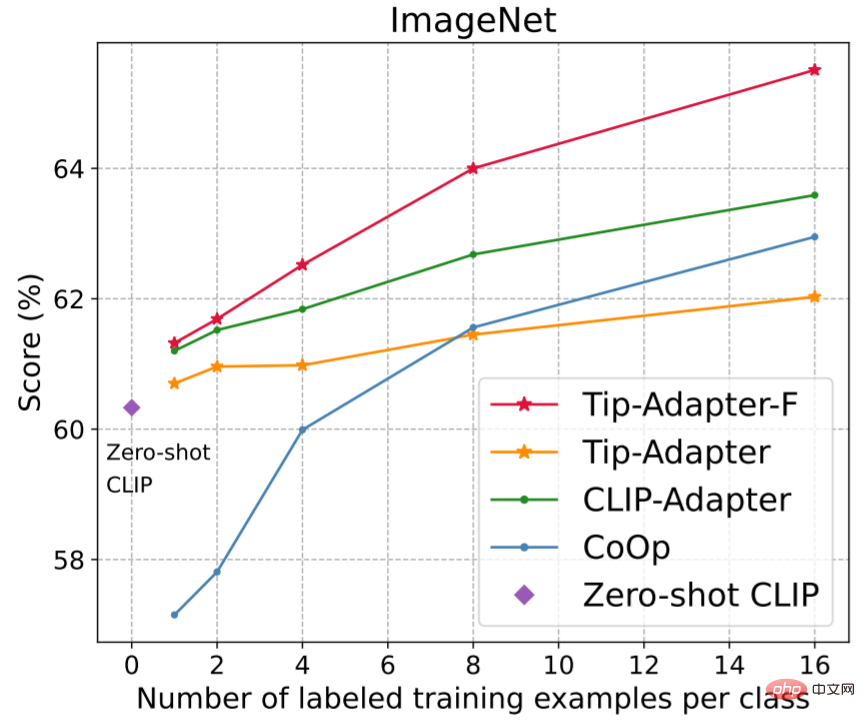

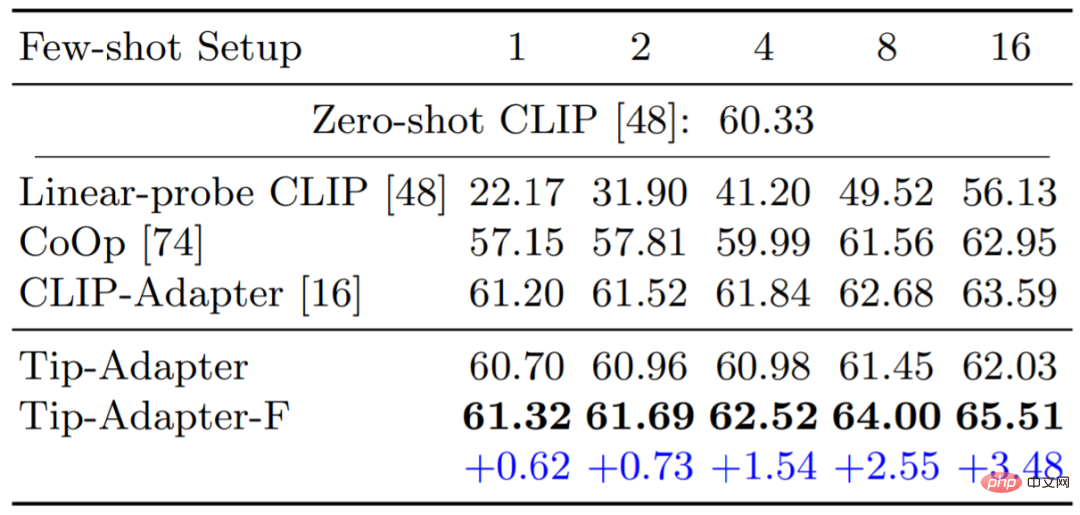

1 Ketepatan pengelasan dalam ImageNet

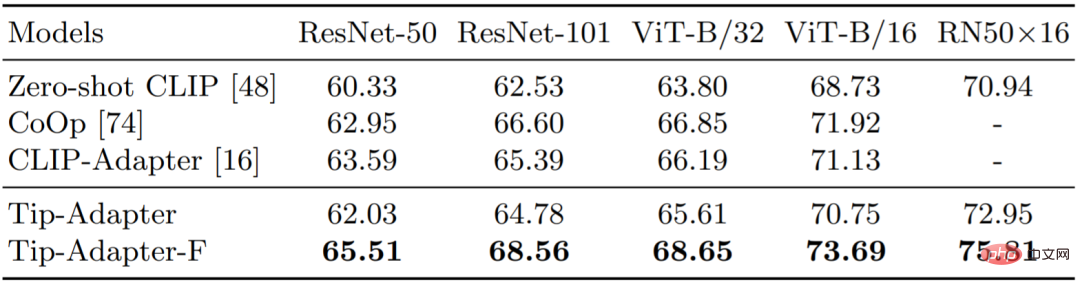

Rajah 4 dan Jadual 2 membandingkan Tip-Adapter, Tip-Adapter-F dan penyelesaian sedia ada dalam 1 dan 2 , 4, 8, dan 16 tangkapan untuk ketepatan klasifikasi imej beberapa tangkapan; Jadual 3 membandingkan ketepatan Pengekod Visual menggunakan CLIP berbeza pada dataset ImageNet 16 tangkapan. Dapat dilihat bahawa kedua-dua penyelesaian kami mencapai prestasi cemerlang dengan overhed sumber yang sangat sedikit.

Rajah 4 dan Jadual 2: 1~16- kaedah berbeza pada dataset ImageNet Perbandingan ketepatan pengelasan imej tangkapan

Jadual 5: Perbandingan ImageNet 16-shot ketepatan pengelasan imej Pengekod Visual dengan CLIP yang berbeza

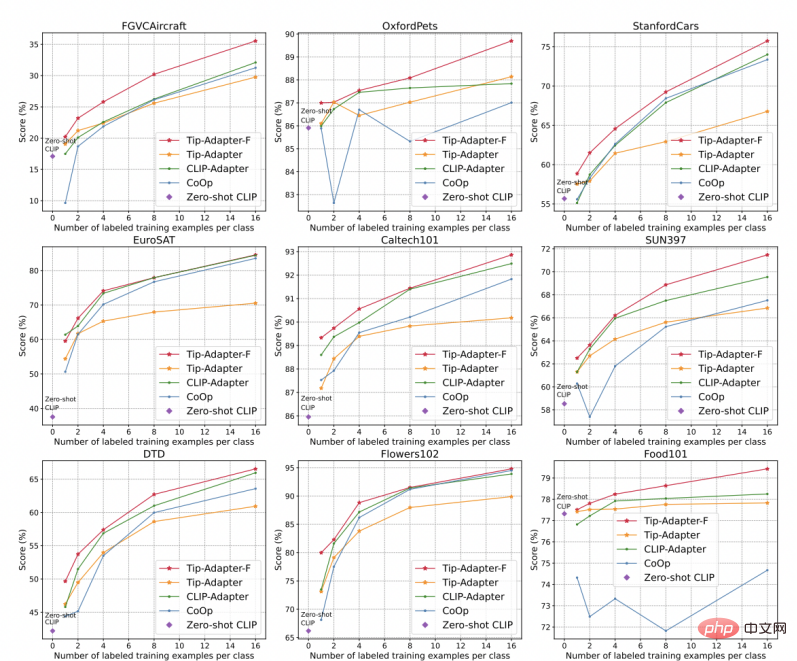

2 Dalam 10 set data pengelasan imej yang lain

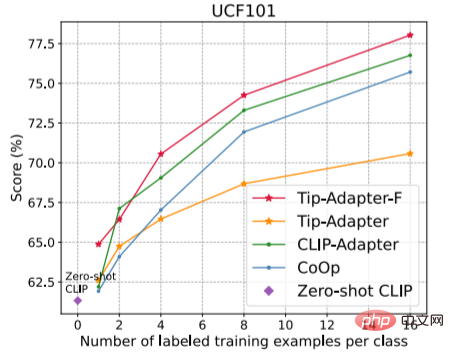

Seperti yang ditunjukkan dalam Rajah 5, kami menyediakan Ketepatan. hasil perbandingan 10 lagi set data klasifikasi imej diperolehi iaitu StandfordCars, UCF101, Caltech101, Flowers102, SUN397, DTD, EuroSAT, FGVCAircraft, OxfordPets dan Food101. Seperti yang ditunjukkan dalam rajah, Petua-Penyesuai-F kami semuanya mencapai ketepatan pengiktirafan tertinggi.

Rajah 5: 1~16 tangkapan kaedah berbeza pada 10 set data lain Imej perbandingan ketepatan klasifikasi

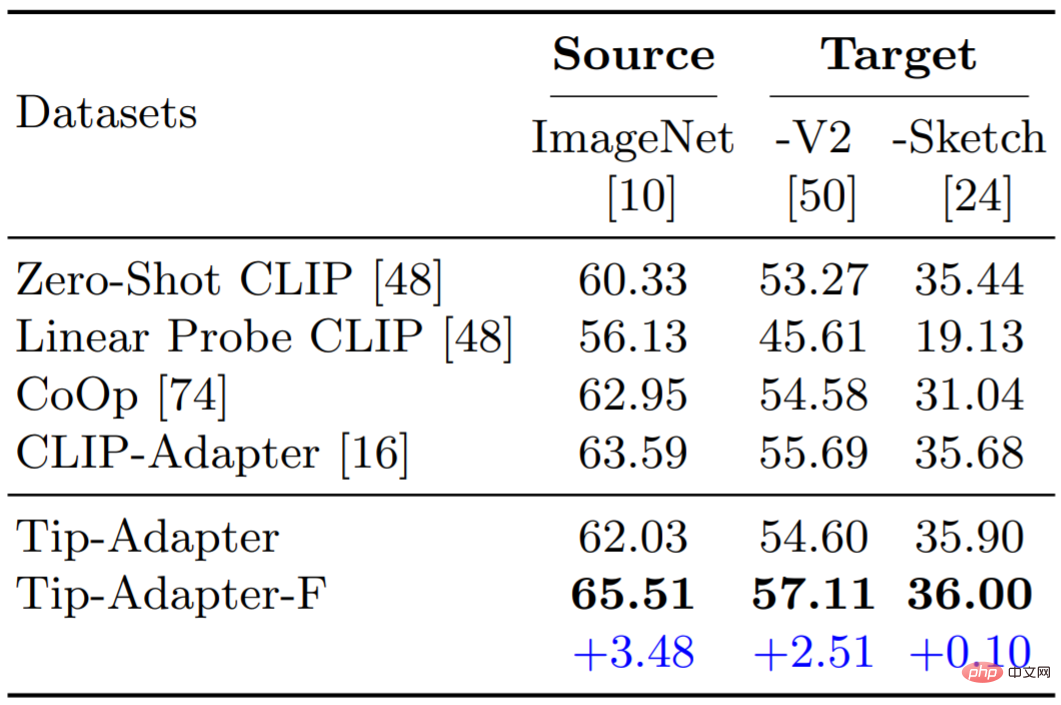

3. Penilaian Keupayaan Generalisasi Domain

Kami juga menguji prestasi Penyesuai Petua dan Penyesuai Petua-F dalam Generalisasi Domain. Seperti yang ditunjukkan dalam Jadual 6, kedua-dua skim kami mempamerkan kekukuhan yang kukuh dan keupayaan pemindahan ciri.

4. Kesimpulan

Kertas kerja ini mencadangkan Tip-Adapter, penyelesaian tanpa latihan untuk menggunakan CLIP untuk klasifikasi imej beberapa tangkapan hiliran. Penyesuai Petua membina Model Cache Nilai Kunci sebagai pangkalan data perolehan pengetahuan untuk Pertanyaan imej ujian, dan memperoleh prestasi pengecaman yang lebih kukuh dengan menggabungkan ramalan Model Cache dan ramalan sifar tangkapan CLIP. Kami berharap Penyesuai Petua dapat memberi inspirasi kepada lebih banyak kerja susulan mengenai pemindahan cekap model pra-latihan.

Atas ialah kandungan terperinci Tanpa latihan hiliran, Tip-Adapter sangat meningkatkan ketepatan klasifikasi imej CLIP. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI